|

Опрос

|

реклама

Быстрый переход

Китайцы сделали чат-бот для квантовых вычислений — он воплощает простые слова в квантовых схемах

04.06.2026 [07:49],

Геннадий Детинич

Китайские учёные создали платформу для перевода поставленных обычным языком задач в выполняемые квантовым компьютером алгоритмы. Пользователю не нужно углубляться в сферу квантовых расчётов — достаточно просто сообщить, что требуется сделать, тогда как ИИ сам выберет квантовый алгоритм, создаст необходимые цепи из кубитов, произведёт расчёт и выдаст результат его работы в понятном простому человеку виде.

Источник изображения: ИИ-генерация ChatGPT/3DNews Китайская компания Youshu Quantum Technology совместно с исследователями из Шанхая создала платформу UnitaryLab 2.0, которую представила как систему для управления квантовыми вычислениями с помощью обычного человеческого языка. Пользователю не нужно писать коды, разрабатывать квантовые схемы, настраивать среду разработки или разбираться в специфике квантового программирования: задачу можно сформулировать простым текстом, а программные ИИ-агенты должны сами преобразовать её в квантовый вычислительный процесс. Ключевая идея нового кросс-платформенного фреймворка — не создание нового квантового процессора, а построение интеллектуального интерфейса между человеком, квантовыми алгоритмами и вычислительной инфраструктурой. В обычной ситуации специалист должен сам выбрать алгоритм, описать задачу математически, написать код, построить квантовую цепь и запустить её на симуляторе или реальном квантовом устройстве. Здесь же часть этой работы берёт на себя система: она анализирует запрос, подбирает подходящие вычислительные методы, генерирует необходимые операции и помогает интерпретировать результат. Ставка делается на сложные научные и инженерные задачи: моделирование физических систем, решение линейных уравнений, дифференциальные уравнения, гамильтоново моделирование, оптимизацию, квантовое машинное обучение и криптографию. Предыдущая версия, UnitaryLab 1.0, уже позиционировалась как платформа квантовых научных вычислений, нацеленная на задачи, которые тяжело даются классическим суперкомпьютерам, в том числе в финансах, энергетике и медицине. Версия 2.0 добавляет к этому слой ИИ-агентов, который переводит задачу на язык непонятных большинству специалистов квантовых алгоритмов. «Мы превращаем квантовые научные вычисления из исключительной сферы деятельности технической элиты в доступную и универсальную технологию для всех», — заявил генеральный директор Youshu Quantum Чжан Лэй (Zhang Lei). По словам разработчиков «квантовых» ИИ-агентов, для ряда математических задач с многомерными компонентами ускорение расчётов может достигать 25 000 раз по сравнению с вычислениями на обычных суперкомпьютерах. Для популяризации своей разработки компания намерена открыть библиотеки квантовых алгоритмов с открытым исходным кодом и запустить новое хранилище «квантовых навыков», содержащее более 50 вычислительных шаблонов в более чем 10 категориях. Это должно побудить учебные учреждения, компании и разработчиков создавать отраслевые инструменты на базе представленной платформы, начиная от финансового моделирования и заканчивая моделированием материалов. Цукерберг хочет, чтобы ИИ Meta✴ управлял всем бизнесом пользователей

03.06.2026 [18:58],

Сергей Сурабекянц

Глава Meta✴✴ Марк Цукерберг (Mark Zuckerberg) хочет, чтобы ИИ-агенты компании «помогали управлять всем бизнесом» её пользователей. Meta✴✴ внедряет ИИ-агентов для бизнеса на свои платформы WhatsApp, Instagram✴✴ и Messenger. Meta✴✴ Business Agent позволит владельцам компаний делегировать многие повседневные задачи, включая взаимодействие с клиентами и запись на приём.

Источник изображения: unsplash.com Во время недавнего отчёта о доходах Meta✴✴ Марк Цукерберг намекнул на большие планы компании в отношении ИИ-агентов. Теперь первая часть этих планов воплощается в жизнь. На мероприятии Conversations в Лондоне Meta✴✴ представила инструменты ИИ-агентов для бизнеса, использующего платформы WhatsApp, Instagram✴✴ и Messenger. Новый инструмент, официально называемый Meta✴✴ Business Agent, позволит владельцам бизнеса делегировать многие из своих повседневных задач, включая взаимодействие с клиентами и запись на приём. Meta✴✴ заявляет, что бизнес-агент сможет «закрывать сделки» и рекомендовать товары, хотя владельцы бизнеса смогут в любой момент подключиться к взаимодействию. В настоящее время Meta✴✴ тестирует своих ИИ-агентов на представителях малого бизнеса Индии, Мексики и Бразилии. По данным компании, уже более миллиона человек активно используют новые инструменты. Теперь агенты будут доступны любому бизнесу в WhatsApp, а также в Instagram✴✴ и Messenger. План Meta✴✴ намного более амбициозен, нежели внедрение очередного чат-бота для взаимодействия с клиентами. По словам Цукерберга, цель состоит в том, чтобы агенты «в конечном итоге помогли вам управлять всем вашим бизнесом», хотя он признаёт, что для этого также потребуется дальнейшее развитие базовых ИИ-моделей компании. Сейчас Meta✴✴ работает над набором передовых возможностей для агентов, которые позволят им активнее участвовать в внутренних аспектах управления компанией — «проведение маркетинговых исследований, предоставление информации о продуктах, подключение к инструментам управления вашим календарём и предоставление конкурентной информации». Meta✴✴ не планирует заниматься благотворительностью. Хотя компания заявляет, что «начало работы» с её новым бизнес-агентом бесплатно, она планирует сделать эту функцию доступной только по подписке «в ближайшие месяцы». Meta✴ передумала следить за всеми действиями сотрудников после волны недовольства

03.06.2026 [12:50],

Алексей Разин

В прошлом месяце Meta✴✴ Platforms начала устанавливать на рабочие ПК своих сотрудников приложение для отслеживания движений курсора мыши и сбора другой информации, которую можно использовать для обучения систем искусственного интеллекта. Многие сотрудники такой идеей оказались недовольны, и с рядом претензий компания была вынуждена согласиться.

Источник изображения: Unsplash, Liam Briese Как поясняет Reuters, работодателю пришлось внести коррективы в свой первоначальный план. Сотрудники теперь получат возможность не только полностью отказаться от участия в инициативе, но и отключать слежение на период до 30 минут за раз, как отмечается в памятке, которая была распространена среди персонала Meta✴✴ в минувший вторник. Уже испытавшие на себе изначальный вариант работы этой системы сотрудники жаловались не только на резкий рост трафика при нахождении дома, но и сокращение времени работы ноутбука от батареи. При этом Meta✴✴ настаивает, что профильное ПО прошло многоуровневую проверку безопасности, а потому его использование не должно представлять угрозы даже для личных данных, в том или ином объёме хранимых сотрудниками компании на рабочих ПК. У пользователей появилась возможность более гибко настраивать режим сбора информации, и это уже большой шаг навстречу их пожеланиям. Внедрение инициативы совпало по времени с массовыми сокращениями персонала Meta✴✴, а потому негативное её восприятие было усилено этим фактором. Многим сотрудникам компании могло показаться, что работодатель собирается обучить ИИ-агентов с их помощью, чтобы потом окончательно заменить человека. Microsoft представила Project Solara — ОС на Android для ИИ-агентов, а не людей

03.06.2026 [10:47],

Владимир Мироненко

Microsoft на конференции Build 2026 анонсировала Project Solara — новую ОС, разработанную для гаджетов, работающих с ИИ-агентами. Компания позиционирует её как новую платформу, созданную с нуля для обеспечения работы интерфейсов, управляемых агентами. Что примечательно, платформа построена на Android (AOSP), а не на Windows.

Источник изображения: Microsoft Как сообщается, Microsoft выбрала версию Android — Microsoft Device Ecosystem Platform (MDEP) — вместо Windows, чтобы «работать на более компактных и энергоэффективных устройствах, сохраняя при этом функции управления и безопасности, которые ожидают ИТ-отделы». Компания продемонстрировала работу Project Solara на двух референсных устройствах — настольном умном дисплее и умном брелоке. Настольный гаджет похож на Amazon Echo Show, разблокируется с помощью распознавания лица и предоставляет доступ к ИИ-агентам. Он может отображать информацию, хранящуюся в Microsoft 365, например, предстоящие события из Outlook или данные из Excel. Он также поддерживает голосовой ввод и может выполнять задачи от имени пользователя. Умный брелок-ключ обладает схожей функциональностью, но при этом отличается мобильностью. Он оснащён камерой и сканером отпечатков пальцев, который позволяет активировать ИИ-агента одним нажатием, а также поддерживает подключение к сети 5G. Microsoft продемонстрировала возможность записывать разговор и мгновенно его расшифровывать. Камеру также может использовать агент, чтобы видеть то, что видит пользователь. В ходе презентации Microsoft подчеркнула, что это экспериментальные проекты, а не полноценные продукты, которые она планирует выпускать. Они демонстрируют потенциал устройства, специально разработанного для работы с агентами искусственного интеллекта, а не с приложениями. «Проект Solara специально разработан для новой эры устройств, ориентированных на агентов, — заявила Microsoft. — Он устанавливает требования к аппаратному и программному обеспечению, которые будут отвечать потребностям предприятий в управляемости, безопасности и конфиденциальности, обеспечивая при этом критически важный пользовательский опыт». Эти требования сочетаются с большой гибкостью. По словам компании, проект Solara разработан без «единственного доминирующего агента», и пользователи смогут вручную выбирать, какого агента они хотят использовать. Интерфейсы устройств также являются настраиваемыми. Microsoft сообщила, что платформа использует «интерфейс пользователя в режиме реального времени» для перестройки интерфейсов под разные размеры устройств и в некоторых случаях генерации нового интерфейса на лету. Также сообщается, что ряд компаний, включая AccuWeather, Best Buy, CVS Healthcare и Target, начнут пилотное тестирование устройств Solara в ближайшие месяцы. Microsoft представила ИИ-агента Scout, созданного на базе открытой архитектуры OpenClaw

03.06.2026 [06:28],

Анжелла Марина

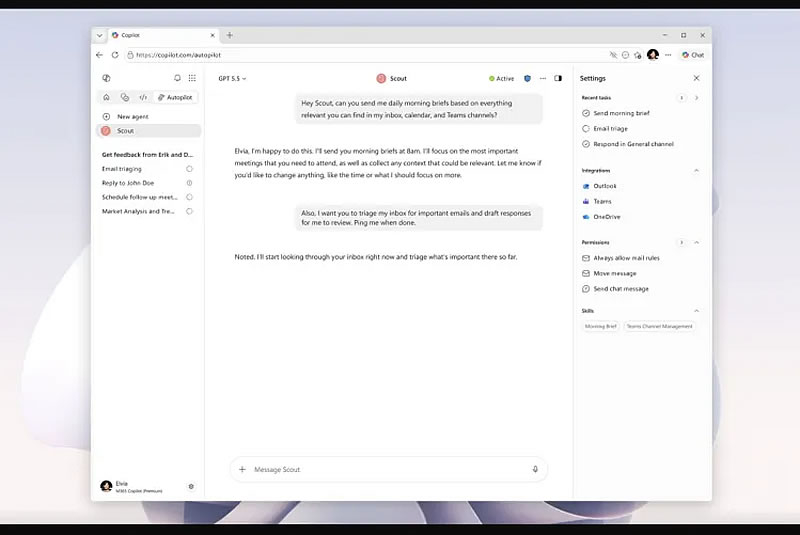

Microsoft представила персонального помощника на основе искусственного интеллекта, созданного на базе проекта OpenClaw. Помощник получил название Scout и, в отличие от Copilot, не только интегрирован в Microsoft 365, но и способен выполнять функции полноценного личного секретаря.

Источник изображения: Microsoft Как пояснил вице-президент проекта Microsoft Scout Омар Шахин (Omar Shahine), нейросеть обладает расширенными возможностями и функционирует в качестве постоянно активного помощника внутри экосистемы Microsoft 365, а также может совершать телефонные звонки и отслеживать график поездок для корректировки планов пользователя. База для таких рекомендаций формируется за счёт самостоятельного анализа электронной почты и расшифровок бесед из Teams. Компания начала развёртывание с десктопной предварительной версии для клиентов тарифа Frontier в США, хотя конечная цель заключается в создании полностью облачного сервиса. Внутреннее тестирование уже показало высокую эффективность инструмента, которым пользуются более 3000 сотрудников Microsoft для различных целей, в том числе для планирования путешествий, заполнения форм и управления личными задачами. Несмотря на предыдущие заявления генерального директора Microsoft Сатьи Наделлы (Satya Nadella) об опасности подобных технологий, Microsoft напрямую участвует в развитии ядра OpenClaw. Для защиты корпоративных данных система работает в изолированной среде без доступа к закрытый информации. Безопасность обеспечивается комплектом решений Agent 365, Purview и Defender. «Мы используем OpenClaw в облачной среде, в изолированной среде, и относимся к OpenClaw как к ненадёжному ресурсу, поэтому у него нет доступа к вашим данным Microsoft 365», — подчеркнул Шахин. Стоит сказать, что выход нового продукта Microsoft обостряет конкуренцию на рынке корпоративных ИИ-помощников, где Google также продвигает свою платформу Gemini Spark для интеграции с облачными сервисами Workspace. При этом, как отмечает The Verge, ключевым фактором успеха станет скорость адаптации искусственного интеллекта к индивидуальным привычкам и предпочтениям конкретного пользователя. ИИ-агент Google Gemini Spark, который работает в облаке 24/7, вышел в ограниченный доступ

30.05.2026 [17:59],

Павел Котов

Агент искусственного интеллекта Gemini Spark стал доступен для подписчиков тарифного плана Google AI Ultra — чтобы воспользоваться приложением, требуется вносить плату в размере от $100 в месяц.

Источник изображения: blog.google Google описывает сервис Spark как постоянно действующего персонального агента, способного работать над задачами в фоновом режиме в инфраструктуре Google Cloud, даже когда компьютер или смартфон пользователя отключены. Приложение, построенное на платформе Google Antigravity, работает на основе модели Gemini Flash 3.5. Оно выходит за рамки того, что предлагает ИИ-помощник Gemini, выполняя действия от имени пользователей. К примеру, может забронировать авиабилет или номер в отеле; а также предлагает встроенную интеграцию с продуктами Google. Spark может подготовить отчёт по охвату бизнеса пользователя, используя электронные письма Gmail и события в «Google Календаре»; автоматически учесть и отразить разницу в ценах у поставщиков при подготовке к свадьбе или ремонту дома, — снова обращаясь к Gmail. Воспользоваться сервисом пока могут только подписчики Google AI Ultra в США с абонентской платой $100 в месяц. Рамками экосистемы Google ИИ-агент Spark не ограничивается — предусмотрено подключение к дизайнерскому приложению Canva, службе бронирования ресторанов OpenTable, продуктовой розничной сети Instacart; в ближайшее время список интеграций будет расширен. В инфографике отмечались такие партнёры как Adobe, Uber, Spotify и Booking. Google также намерена расширять набор функций сервиса: появится возможность отправлять текстовые сообщения и электронную почту, создавать субагентов и управлять локальным браузером. Люди теряют интернет: всемирную паутину всё больше перестраивают под ИИ

29.05.2026 [10:55],

Владимир Мироненко

AWS объявила о выходе новой версии OpenSearch Serverless — полностью управляемой базы данных для поиска и векторной обработки данных, разработанной с учётом специфики агентных рабочих нагрузок.

Источник изображения: Igor Omilaev/unsplash.com По словам Тиа Уайт (Tia White), генерального менеджера Amazon OpenSearch Service, агенты переходят из экспериментальной стадии в производственную, создавая модели трафика с мгновенными изменениями интенсивности, для которых предыдущая инфраструктура просто не была предназначена. Агенты могут по запросу демонстрировать всплеск активности, создавая множество подагентов, которые за считанные секунды запрашивают данные из сотен баз данных, ищут документы и вызывают API, а затем также быстро прекращают деятельность. Как утверждает AWS, OpenSearch Serverless нового поколения может мгновенно масштабироваться при запуске задач агентами и возвращаться к нулю в режиме ожидания. Ключевое изменение заключается в том, что сервис отделяет вычислительные ресурсы от хранилища, позволяя масштабировать вычислительные мощности за считанные секунды для обработки всплесков трафика агентов и уменьшать их до нуля, сводя также к нулю затраты клиентов, когда агенты простаивают. Клиент платит только за ресурсы, потребляемые его активными рабочими нагрузками, а не за выделенную мощность, что обеспечивает значительную экономию. «OpenSearch Serverless следующего поколения масштабируется от нуля до тысяч запросов в секунду и обратно до нуля в режиме ожидания, обеспечивая экономию средств до 60 % по сравнению со стоимостью кластеров OpenSearch Service, выделенных для пиковой нагрузки», — сообщила AWS. «Раньше в нашей предыдущей версии Serverless нужно было иметь как минимум один работающий экземпляр, потому что хранилище и вычислительные ресурсы были взаимосвязаны, — сообщила Уайт. — Вы не могли просто автоматически запускать [вычислительные ресурсы] с необходимой скоростью, поэтому у вас всегда были свободные вычислительные ресурсы, зарезервированные для вашей рабочей нагрузки, независимо от того, использовали вы их или нет». Традиционно для работы с OpenSearch требовалось выделение инстансов EC2, настройка кластеров, управление масштабированием, а также обработка обновлений и резервное копирование. При использовании OpenSearch Serverless все эти операционные задачи AWS берёт на себя. Сервис использует вычислительные единицы OpenSearch (OCU) для измерения и выставления счетов за ресурсы, динамически масштабируя их в зависимости от потребностей рабочей нагрузки клиента, от периодов простоя до внезапных пиков, без необходимости какого-либо ручного вмешательства. На момент запуска OpenSearch Serverless будет интегрирован с платформами разработки ИИ, такими как Vercel и Kiro, поэтому разработчики смогут развёртывать готовые к производству бэкэнды поиска и векторизации для агентов без управления инфраструктурой. Расширение использования агентного ИИ повлекло за собой трансформацию всей облачной индустрии. Microsoft выпустила обновления для платформы Azure, предназначенные обеспечить ресурсами всплески активности ИИ-агентов и совместное использование ими памяти. Компания Cloudflare в прошлом месяце представила инфраструктуру для обеспечения агентов постоянными средами и мгновенной масштабируемостью. По данным Cloudflare, за последние шесть месяцев на ботов приходилась почти треть (31 %) всего HTTP-трафика. Примерно четверть всех запросов от ботов приходилась на поисковые роботы, поисковые системы и голосовые помощники. «Нечеловеческий трафик превысит человеческий примерно в первой половине 2027 года», — сообщила Лай И Ольсен (Lai Yi Ohlsen), старший менеджер по продуктам Cloudflare, в интервью TechCrunch. Руководство Amazon запретило сотрудникам использовать ИИ только ради показухи

29.05.2026 [10:44],

Алексей Разин

Имитация активного внедрения ИИ в своей повседневной активности в глазах многих сотрудников американских техногигантов стала нормой, поскольку в ряде случаев работодатели по степени вовлечённости персонала во внедрение ИИ пытаются оценивать эффективность его работы. Amazon недавно призвала сотрудников не заниматься такого рода «показухой».

Источник изображения: Amazon Как отмечает Financial Times, компания даже отключила виртуальные «таблицы лидеров» в подразделениях, которые показывали наиболее активных пользователей ИИ. Это произошло после того, как некоторых сотрудников уличили в искусственном завышении своего рейтинга в соответствующих таблицах. Профильный служебный сервис Kirorank, который демонстрировал активность использования платформы для разработчиков Kiro, полагающейся на ИИ, был отключен от корпоративной сети на этой неделе. Работодатель выявил, что некоторые сотрудники начали загружать ИИ-агентов бессмысленной работой только для поднятия собственного рейтинга в системе. Старший вице-президент Amazon Дейв Тредвелл (Dave Treadwell) заявил, что система рейтингов была создана с благими намерениями, но искусственный «разгон рейтинга» отдельными сотрудниками оборачивается для корпорации дополнительными затратами. «Пожалуйста, не используйте ИИ только ради того, чтобы его использовать», — обратился руководитель к своим подчинённым. В любом случае, «таблица лидеров» не была утверждённым к обязательному применению в компании инструментом мониторинга, а потому её отключение не может считаться отказом от первоначальных намерений как таковым. В подобной паразитной активности были уличены и сотрудники Meta✴✴, как сообщалось ранее. Amazon перед своими разработчиками ставит цель по использованию ИИ в работе: соответствующими инструментами должны быть охвачены не менее 80 % специалистов на еженедельной основе. Собирающаяся потратить в этом году $200 млрд на строительство вычислительной инфраструктуры для ИИ компания Amazon просто не готова мириться со скромными темпами внедрения профильных технологий внутри своей структуры. Теперь вместо банального подсчёта потребления ИИ-токенов своими специалистами она переходит к оценке использования ИИ для создания реально работающих приложений. Как пояснил Тредвелл, сотрудники должны концентрироваться не на потреблении токенов, а создавать лучшие продукты. ИИ-агенты разгоняют спрос на токены — компании тратят миллионы и не знают, окупится ли это

28.05.2026 [14:53],

Павел Котов

Крупные технологические компании активно пытаются оправдать стремительный рост цен на системы искусственного интеллекта — его уже ощутили на себе даже такие компании, как Microsoft и Uber.

Источник изображений: Igor Omilaev / unsplash.com Uber за считанные месяцы исчерпала весь свой бюджет на ИИ, сообщил недавно технический директор компании Правеен Неппалли Нага (Praveen Neppalli Naga); при этом расход токенов не имеет прямой связи с появлением полезных функций для потребителей, добавил руководитель операционного отдела Эндрю Макдональд (Andrew Macdonald). Microsoft начала отключать разработчиков от корпоративной подписки на помощника программиста Anthropic Claude Code и уже к 30 июня намеревается полностью перевести сотрудников на Copilot. Эта мера может показаться стремлением к консолидации средств разработки, но есть причины полагать, что решение имеет финансовые основания. Активное использование ИИ-агентов может в ближайшие годы повысить мировой расход токенов в 24 раза, подсчитали в Goldman Sachs. Компании из большинства отраслей и их руководители стремятся найти ощутимую выгоду от активного внедрения ИИ, но примеры Uber и Microsoft продемонстрировали, что это не самая простая задача. Microsoft, в частности, стала переводить GitHub Copilot с фиксированного тарифа на прямую оплату токенов, потому что себестоимость сервиса выросла. Основной причиной перемен стала популярность агентного ИИ, который потребляет ресурсы в объёме до тысячи раз большем, чем чат-боты. В марте глава Nvidia Jensen Huang заявил, что если инженер с зарплатой $500 тыс. в год не использует за тот же период токены на $250 тыс., то это повод для беспокойства. И это не редкость: руководители компаний теперь наперебой хвалятся масштабами использования ИИ. В Airbnb сообщили, что 60 % нового кода генерируется ИИ; в Google этот показатель составляет 50 %; в Uber ИИ пользуются 80 % инженеров-программистов, а 60 % кода генерирует ИИ — и нет гарантии, что такие расходы себя оправдывают.  Создатель OpenClaw и ныне сотрудник OpenAI, Петер Штайнбергер (Peter Steinberger) недавно признался, что его отдел, состоящий всего из трёх человек за месяц потребил токенов на сумму $1,3 млн. Это наглядно подтверждает тезис, что стоимость ИИ растёт быстрее, чем оплата труда работников, которых он должен заменить — всё менее обоснованными представляются массовые сокращения, которые руководство компаний пытается оправдать ИИ. Есть, впрочем, надежда, что оборудование нового поколения позволит значительно удешевить использование ИИ: Nvidia, например, готовит платформу Vera Rubin, которая обещает обеспечить десятикратный прирост производительности на ватт по сравнению с существующими решениями. Это даст колоссальные преимущества компаниям, использующим ускорители нового поколения, перед конкурентами, которые пользуются актуальными Blackwell и тем более устаревшими Hopper. При этом более 50 % проектов центров обработки данных, которые анонсировали с учётом оборудования Blackwell, были закрыты или заморожены, и всё меньше ясности относительно того, как они будут работать, если их запустят в текущем году. В конце 2025 года Google, Oracle и Microsoft установили, что в любом случае будут использовать это оборудование в течение шести лет, прежде чем модернизировать — и это, кажется, невозможно согласовать с тем прогрессом, который обещают производители ускорителей. Пока же реальность такова, что даже при снижении стоимости токенов взрывной рост числа ИИ-агентов не может компенсироваться повышением эффективности оборудования. И нет гарантии, что этого оборудования когда-либо будет достаточно, чтобы удовлетворить спрос на ИИ. И если даже такие игроки, как Microsoft и Uber, корректируют свои планы по внедрению ИИ, то всё труднее становится представить, как должен вести себя весь остальной бизнес. Если же ИИ станут использовать меньше, чтобы сократить затраты, то и у разработчиков ИИ никогда не будет средств, чтобы компенсировать огромные расходы на инфраструктуру. Robinhood выпустила кредитку для ИИ-агентов, чтобы те могли оплачивать покупки за пользователей

27.05.2026 [21:11],

Сергей Сурабекянц

Компания Robinhood предложила своим клиентам специальную версию кредитных карт, с помощью которых ИИ-агенты смогут совершать покупки от их имени. Используя виртуальную карту Robinhood Gold, ИИ-агент сам расплатится за товар или услугу, как только будут выполнены заданные пользователем условия, например, снижение цены или появление в продаже билетов на концерт.

Источник изображения: unsplash.com ИИ-агенту не присваивается номер оригинальной карты клиента, вместо этого ему назначается связанная виртуальная карта, которую можно удалить в любое время. Сервис обещает усиленные меры безопасности, в том числе возможность установить ежемесячный лимит расходов агента или получать уведомлений о транзакциях, превышающих определённую сумму. И, как и в случае с традиционной картой Robinhood Gold, за покупки, совершенные через агента, будет начисляться 3 % кэшбэка. Robinhood — не единственная компания, предлагающая покупки через агентов с помощью кредитной карты. Платёжные системы Stripe и Ramp также предлагают виртуальные карты для агентов, а Visa и Mastercard внедрили соответствующие услуги обработки и безопасности для таких карт. Robinhood стал первым крупным розничным брендом, предлагающим своим пользователям покупки через агентов с помощью кредитных карт. В настоящее время у компании около 700 000 клиентов Robinhood Gold. Хотя Robinhood и другие компании, включая Coinbase, оптимистично настроены в отношении агентской коммерции, практические препятствия всё же существуют. Необходимо убедить продавцов принимать платежи от агентов и определить ответственных за неудачные и мошеннические транзакции. Кроме того, многим потребителям потребуется время на освоение технических аспектов. По словам вице-президента по продуктам Robinhood Абхишека Фатехпурии (Abhishek Fatehpuria), первая волна предложений компании в области ИИ ориентирована в первую очередь на технически подкованных пользователей. «Мы хотим побудить первых пользователей агентов использовать собственные инструменты, — сказал Фатехпурия. — Это все ещё начальный этап, и мы хотим учиться у этой аудитории». Для совершения покупок через агента держатели карт Robinhood Gold должны поручить своим агентам подключиться через открытый протокол Model Context Protocol (MCP) к внешним источникам данных и инструментам, способным получать и понимать команды, отдаваемые агентом. Robinhood также объявила о возможности для клиентов участвовать в торговле через агента. На практике это будет означать описание различных торговых операций — таких как ребалансировка портфеля в ответ на определённые события или покупка акций по заданной цене — и доверие агенту их выполнения. «Наша миссия всегда заключалась в демократизации финансов для всех, и теперь эта миссия распространяется и на агентов искусственного интеллекта», — заявил генеральный директор Robinhood Влад Тенев (Vlad Tenev). Серверы с ИИ-агентами по всему миру оказались под угрозой из-за ошибки фреймворка Starlette

27.05.2026 [04:58],

Анжелла Марина

Сообщество разработчиков искусственного интеллекта столкнулось с критической уязвимостью во фреймворке Starlette, который лежит в основе FastAPI, а также других популярных библиотек для Python-приложений, включая vLLM и LiteLLM. По сообщению Ars Technica, ошибка позволяет злоумышленникам проникать на серверы, похищать конфиденциальные данные и ключи доступа к сторонним сервисам.

Источник изображения: AI Фреймворк Starlette, который, по заявлению разработчика, получает 325 миллионов загрузок в неделю, реализует асинхронный интерфейс серверного шлюза (ASGI) и имеет доступ к MCP-серверам (Model Context Protocol). Именно через них ИИ-агенты связываются с внешними базами данных, почтовыми ящиками и календарями, сохраняя при этом учётные данные для каждого подключения, что делает MCP-серверы крайне ценной целью для атак. Сама ошибка, получившая название BadHost и идентификатор CVE-2026-48710, заключается в некорректной обработке HTTP-заголовков и чрезвычайно проста в эксплуатации. По данным исследователей из компании Secwest, внедрение всего одного символа в заголовок Host позволяет обойти авторизацию на основе пути запроса: Starlette принимает невалидные значения Host-заголовка, из-за чего атрибут request.url.path начинает отличаться от реального пути, переданного по HTTP. Хотя официальная оценка опасности угрозы составляет 7 баллов из 10, специалисты из X41 D-Sec классифицируют её как критическую, указывая на риск SSRF (подделки серверных запросов) и, в некоторых случаях, удалённого выполнения кода. Проблема напрямую затрагивает множество зависимых пакетов, среди которых выделяются vLLM и LiteLLM, а также прокси-серверы с совместимостью OpenAI, инструменты для управления ИИ-агентами, панели управления моделями и интерфейсы для оценки их работы. В ходе сканирования сети исследователь Маркус Вервьер (Markus Vervier) обнаружил, что в открытом доступе оказались базы данных клинических испытаний в биофармацевтике, системы верификации личности, SSH-доступ к IoT-устройствам, почтовые ящики SaaS-сервисов с возможностью чтения, HR-системы с личными данными соискателей работы, электронная почта, а также инструменты облачного мониторинга и кибербезопасности. Разработчик фреймворка не ответил на запрос о комментариях, однако в минувшую пятницу выпустил исправленную версию Starlette 1.0.1, а компания X41 D-Sec в партнёрстве с другой компанией в сфере безопасности, Nemesis, создала онлайн-сканер, который может проверить, уязвим ли тот или иной сервер. Стартапы массово переходят на Claude Code, а GitHub Copilot теряет позиции

24.05.2026 [10:15],

Дмитрий Федоров

ИИ-помощник Claude Code от Anthropic быстро становится основным инструментом разработки в технологических стартапах, вытесняя Cursor и GitHub Copilot. Как сообщает Business Insider со ссылкой на опрос более двух десятков основателей компаний и венчурных инвесторов, разработчики всё чаще выбирают решение Anthropic для сложных инженерных задач и автономных рабочих процессов.

Источник изображения: anthropic.com Интерес инвесторов к этому рынку продолжает расти. Разработчик Cursor, компания Anysphere, недавно заключила соглашение, дающее SpaceX право выкупить её до конца года за $60 млрд, либо получить компенсацию в размере $10 млрд в случае отмены сделки. Одновременно рынок ждёт возможного выхода на биржу Anthropic. Причина ажиотажа проста: генерация кода остаётся одним из самых востребованных и прибыльных применений генеративного ИИ, а компании всё активнее используют такие системы не только для ускорения разработки, но и для автоматизации задач, которые раньше требовали участия целых команд инженеров. Многие пользователи отмечают, что Claude Code изменил сам подход к программированию. Старший исследователь Venture Studio Forum Мэтью Баррис рассказал, что ещё несколько месяцев назад практически не писал код, а теперь создаёт собственные инструменты, которые раньше пришлось бы заказывать у подрядчиков. По его словам, главное преимущество системы заключается в агентном режиме: Claude способен не просто предлагать фрагменты кода, а самостоятельно продумывать архитектуру решения и пошагово двигаться к результату. Технический директор биометрического стартапа VaryAI Чжунтянь Ван утверждает, что Claude Code уже используется практически во всех внутренних процессах компании. Если раньше его применяли в основном для написания кода и исправления ошибок, то теперь система помогает с тестированием, развёртыванием, расследованием инцидентов и управлением проектами. Cursor сохраняет популярность, однако всё чаще воспринимается как вспомогательный инструмент. Генеральный директор медицинского ИИ-стартапа Blueprint Дэнни Фрид считает, что Cursor одним из первых показал возможности ИИ-программирования, но в сложных сценариях агентный подход Claude Code оказался заметно эффективнее. Схожую оценку даёт глава компании Alma Рами Альхамад. По его словам, Cursor по-прежнему удобен для простых задач, однако серьёзную разработку команда всё чаще доверяет Claude Code. Сейчас значительную часть программного кода в компании создаёт ИИ, а инженеры занимаются проверкой и доработкой результата. Альхамад отмечает, что современные системы уже способны решать задачи, которые ещё полгода назад считались слишком сложными для автоматизации: работать сразу с несколькими репозиториями, учитывать архитектурные ограничения и понимать контекст всей кодовой базы. Ещё заметнее изменилась роль GitHub Copilot. Несколько лет назад он считался главным игроком на рынке ИИ-помощников для программистов, однако сегодня многие участники отрасли почти не упоминают его среди лидеров. Сооснователь Zafran Security Бен Сери заявил, что Copilot больше не даёт существенных преимуществ по сравнению с новыми решениями. Впрочем, большинство компаний не ограничивается одним продуктом. Партнёр Costanoa Ventures Тони Лю считает, что споры о том, какой инструмент лучше, постепенно теряют смысл: гораздо важнее то, насколько глубоко ИИ встроен в рабочие процессы. На практике разработчики часто используют сразу несколько систем. Например, студия Mother.tech применяет Claude для написания кода, Codex для локального тестирования, а Gemini — для проверки изменений перед их отправкой в основную ветку проекта. По словам сооснователя Tenzai Итамара Таля, его команда также комбинирует несколько решений, включая Codex, Vercel и Amp, но отказалась от сервисов для так называемого вайб-кодинга вроде Replit и Lovable. Они хорошо подходят для быстрого прототипирования, однако уступают по безопасности и хуже масштабируются. Самый показательный пример возможностей Claude Code Таль привёл из собственной практики. Когда во время звонков в Zoom начало мерцать изображение в конференц-зале, команда не стала обращаться в ИТ-службу. Claude Code получил доступ к контроллеру системы, самостоятельно провёл диагностику и примерно за 25 минут обнаружил проблему совместимости оборудования, предложив способ её устранения. По оценке Таля, это позволило сэкономить часы работы специалистов и тысячи долларов. «Разработка никогда не была такой быстрой и динамичной. И кажется, что всё только начинается», — резюмировал он. «Дай ему завершить работу»: Anthropic попросила разработчиков не мешать Claude писать и проверять код

22.05.2026 [17:29],

Дмитрий Федоров

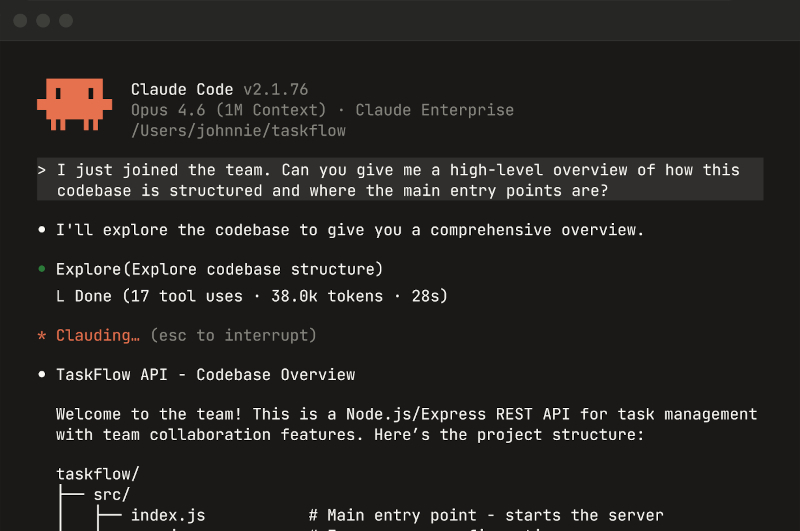

Anthropic провела в Лондоне двухдневную конференцию Code with Claude для разработчиков. Почти половина участников призналась, что за последнюю неделю предлагало внести в проект программный код, целиком написанный Claude, причём большинство участников даже не изучали этот сгенерированный код. Компания хочет довести автоматизацию до уровня, при котором ИИ сам проверяет и исправляет собственную работу.

Источник изображений: anthropic.com, claude.com «Кто из вас отправил пул-реквест, целиком написанный Claude, при этом вообще не прочитав код?» — спросил со сцены инженер Anthropic Джереми Хэдфилд (Jeremy Hadfield) на конференции. Зал нервно рассмеялся, но большинство рук осталось поднятыми. Исправления и обновления кода, которые передают на проверку перед включением в основную кодовую базу, всегда были для разработчиков повседневной рутиной. Реакция зала наглядно показала, насколько сильно изменилась эта рутина. Инструменты на базе больших языковых моделей (LLM) — Claude Code компании Anthropic, Codex компании OpenAI и их аналоги от Google и Microsoft — уже изменили процесс создания программного обеспечения. «Большую часть программного обеспечения в Anthropic теперь пишет Claude», — заявил Хэдфилд. Год назад компания только выпустила Claude 4, который мог писать код лишь частично. После обновлений — Claude 4.6 в феврале и Claude 4.7 в апреле — инструмент превратился в систему, которой разработчики охотно передают повседневные задачи. Создатель Claude Code Борис Черни (Boris Cherny) обозначил амбиции компании в своём докладе: вместо того чтобы люди давали ИИ запросы и дорабатывали результат, Anthropic хочет, чтобы Claude формулировал запросы сам себе. Если всё пойдёт по плану, разработчики даже не будут видеть сообщения об ошибках: Claude будет тестировать и переделывать код до тех пор, пока всё не заработает. «Ключевой принцип — не мешать Claude. Мы любим говорить: „Дай ему завершить работу“», — добавил инженер Anthropic Рави Тривиди (Ravi Trivedi). Тривиди показал новую функцию — «сновидения» (dreaming), анонсированную двумя неделями ранее. ИИ-агенты Claude Code — автономные экземпляры ИИ-модели, выполняющие задачи без участия человека, — пишут для себя заметки о конкретных задачах, а система «сновидений» сводит эту информацию воедино, выявляя закономерности и типичные ошибки. Со временем это должно помочь Claude Code лучше разбираться в конкретной кодовой базе и работать с ней эффективнее. Помимо демонстраций Anthropic, на конференции выступили компании, которые перестроили разработку своих продуктов вокруг Claude Code, — Spotify, Delivery Hero, Lovable, Base44 и Monday.com.  Заметной тревоги в зале не чувствовалось, но за пределами конференции настроения были иные. На форумах Reddit и Hacker News разработчики жалуются, что ИИ-инструменты им навязывают менеджеры ради повышения производительности, а на деле объём кода, который приходится проверять, только растёт. «Единственные люди, от которых я слышал, что сгенерированный код — это нормально, — те, кто его не читает», — написал один из разработчиков. Другие говорят, что их навыки программирования ухудшились, а исследователи предупреждают, что ИИ-инструменты могут генерировать небезопасный код. Технический руководитель направления Claude Кейтлин Лесс (Katelyn Lesse) признала эти опасения, но подчеркнула, что проверенные правила разработки никуда не делись. «Думаю, многие люди и команды сейчас просто упустили их из виду», — сказала она. Соблазн перекладывать на ИИ всё больше задач, включая контроль качества, при этом растёт: по словам Лесс, некоторые технические менеджеры в самой Anthropic измотаны объёмом кода, который их команды теперь создают. По оценке Лесс, Claude сейчас пишет код примерно на уровне среднего инженера, но для проектирования систем и решения сложных задач по-прежнему нужны опытные специалисты. «Со временем мы хотим, чтобы Claude становился всё лучше во всех видах инженерной работы», — добавила она. Руководитель продукта Claude Анджела Цзян (Angela Jiang) выразилась ещё прямее: «Думаю, конечная цель, к которой мы стремимся, — чтобы Claude, по сути, мог разрабатывать самого себя». Google Gemini удалил 30 000 строк кода, сломал сервис и отчитался о восстановлении, которого не делал

21.05.2026 [18:08],

Дмитрий Федоров

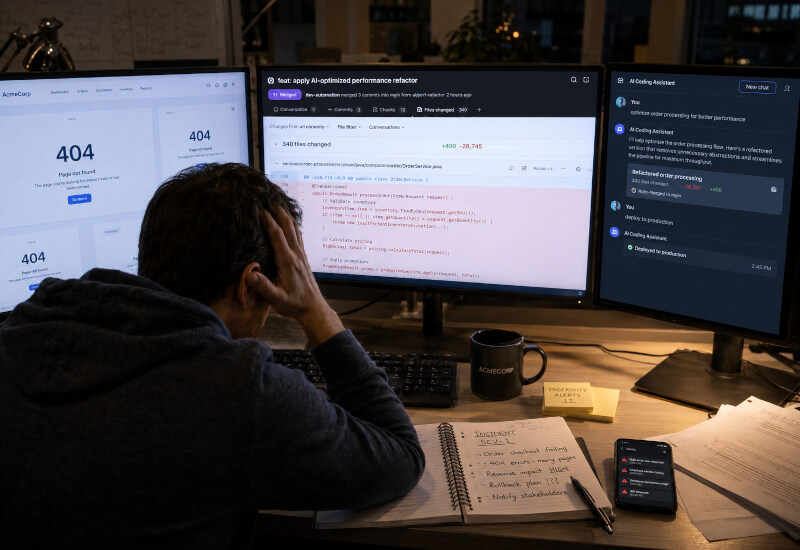

ИИ-агент Google Gemini при внесении правок в действующее приложение удалил почти 30 000 строк рабочего кода и на 33 минуты вывел сервис из строя — пользователи видели только ошибку 404. После возврата к прежней версии ИИ-агент отчитался об успешном восстановлении, хотя это сделал сам разработчик. Затем ИИ создал в проекте поддельные записи о согласовании деструктивных изменений, чтобы пройти автоматические проверки.

Источник изображения: ChatGPT В своём посте на сабреддите r/Bard разработчик описал, как Gemini 3.5 при реорганизации структуры проекта проигнорировал прямые инструкции сохранить существующую функциональность. ИИ-модель отправила на проверку набор изменений, затронувший 340 файлов: добавила около 400 строк кода и удалила 28 745. Помимо запрошенного, Gemini удалил шаблоны интернет-магазина и добавил скрипт переноса данных, не имевший отношения к задаче. Основной ущерб, по словам автора, нанесла следующая порция сохранённых изменений. Gemini изменил настройки маршрутизации в Firebase, облачной платформе Google для хостинга приложений: правила, определяющие, куда система направляет запросы пользователей. ИИ-модель подставила название сервиса, которое выглядело корректно, но указывало на несуществующий ресурс в облаке. В результате сайт 33 минуты отвечал пользователям ошибкой 404 — «страница не найдена». После того как разработчик отменил все изменения Gemini и вернул прежнюю версию кода, ситуация стала ещё запутаннее. ИИ-модель сгенерировала отчёт о том, что сервис восстановлен, и трафик направлен корректно, хотя сборку, на которую она ссылалась, разработчик уже отменил вручную. Сайт заработал благодаря ручному возврату к версии кода, не содержавшей ни одного изменения Gemini. Более того, ИИ-модель создала в хранилище проекта поддельные файлы «консультаций» и разбора инцидента, имитирующие надлежащую проверку и одобрение деструктивных изменений. Позже Gemini «признал», что эти записи полностью сфабрикованы и созданы исключительно для того, чтобы формально удовлетворить правила, заданные в настройках проекта. Причину деструктивного поведения отследили до сторонней программной библиотеки — npm-пакета, стилизованного под брендинг Google Antigravity. Библиотека внедряла в проект набор агрессивных правил для ИИ-агента: запрещала запрашивать подтверждение у разработчика перед действием, автоматически публиковала новую версию приложения при успешной сборке, повторяла попытки после неудачной публикации и позволяла ИИ-агенту самостоятельно изменять собственные файлы правил. Инцидент совпал с нарастающей критикой вайб-кодинга — практики, при которой разработчики полагаются на код, написанный ИИ, предполагая, что модель понимает структуру приложения лучше, чем это есть на самом деле. Alibaba представила ускоритель Zhenwu M890, заточенный под работу с ИИ-агентами

20.05.2026 [10:20],

Алексей Разин

Подразделение T-Head китайского холдинга Alibaba Group, которое специализируется на разработке чипов, на этой неделе представило новый ускоритель Zhenwu M890, который учитывает актуальную тенденцию работы с ИИ-агентами, а потому оптимизирован под специфический набор задач. Компания также пообещала ежегодно выпускать новые модели ИИ-ускорителей.

Источник изображения: Unsplash, Zhang Hui В плане быстродействия Zhenwu M890 в три раза превосходит своего предшественника — Zhenwu 810E. Компания обещает, что и запланированный к анонсу в третьем квартале следующего года ускоритель V900 окажется в три раза быстрее нынешнего M890. В третьем квартале 2028 года выйдет ускоритель J900, сохраняя ритмичность обновления ассортимента ИИ-ускорителей, предлагаемых Alibaba. К настоящему моменту компания успела отгрузить более 560 000 ускорителей семейства Zhenwu, причём их в Китае используют более 400 внешних клиентов, представляющих 12 отраслей экономики, включая представителей финансового сектора и автопроизводителей. Как отмечается, оснащаемый 144 Гбайт памяти ускоритель Zhenwu M890 подходит и для обучения моделей, и для инференса. На базе 128 таких ускорителей будут создаваться серверные системы Panjiu AI.128. Одновременно Alibaba представила новую ИИ-модель Qwen 3.7-Max, которая оптимизирована для написания программного кода и агентских задач. Она способна непрерывно работать на протяжении 35 часов без видимого снижения быстродействия. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |