|

Опрос

|

реклама

Быстрый переход

Xiaomi представила OmniVoice — открытую ИИ-модель, которая озвучит текст почти на любом языке и скопирует голос

08.05.2026 [10:45],

Павел Котов

Xiaomi объявила о выходе открытой модели искусственного интеллекта OmniVoice, предназначенной для преобразования текста в речь — помимо речевого синтеза на нескольких сотнях языков, она поддерживает клонирование голоса и настраиваемую генерацию речи.

Источник изображения: Xiaomi OmniVoice, по словам разработчика, демонстрирует высокие показатели в китайском и английском языках, выступая конкурентом существующих коммерческих систем и превосходя их в ряде задач. Одним из главных преимуществ модели является поддержка языков даже с ограниченными ресурсами — она генерирует речь «почти на любом языке», даже если для него был доступен лишь небольшой объём обучающих данных. Кроме того, отметили в Xiaomi, это первая в отрасли модель для клонирования голоса с охватом нескольких сотен языков. По результатам многоязычного тестирования OmniVoice превзошла несколько коммерческих систем на 24 языках по сходству и разборчивости речи — даже при обучении на открытых наборах данных. При тестировании на 102 языках разборчивость речи OmniVoice была близка к человеческой, а в некоторых случаях и превосходила её. Высокое качество на выходе удалось обеспечить даже в тех случаях, когда по какому-либо языку было менее 10 часов обучающих данных.

Источник изображения: Ali Khadem / unsplash.com По сравнению с современными системами синтеза речи OmniVoice отличает гораздо более простая архитектура: вместо подключения нескольких модулей и этапов прогнозирования здесь развёрнута единая двунаправленная сеть типа трансформер для прямого преобразования текста в речь. Не нужно отдельно моделировать текст, подключать сложные гибридные структуры и многоуровневые системы прогнозирования токенов. Упрощённая архитектура означает высокую скорость работы модели — всего за один день её можно обучить на 100 000 часов данных; а при инференсе (запуске) она работает на величину до 40 раз быстрее реального времени с использованием ИИ-фреймворка PyTorch, то есть относительно просто развёртывается в потребительских приложениях и сервисах. Высокую производительность OmniVoice, рассказали в Xiaomi, обеспечили при помощи двух решений. Во-первых, при обучении модели применили «метод случайного скрытия акустических кодов», что увеличило эффективность обучения и расширило общие возможности модели. Во-вторых, на этапе предварительного обучения к ней подключили большую языковую модель — она помогла повысить точность произношения и разборчивость речи. OmniVoice предлагает несколько практических функций. Модель может сгенерировать голос по описанным пользователем свойствам — учесть возраст, пол, высоту тона, акцент, диалект и стиль речи; без необходимости в эталоне можно генерировать шёпот и другие особые стили речи. Она также умеет удалять из образца шумы и извлекать чёткие характеристики голоса, чтобы копировать его даже тогда, когда исходный аудиофайл записывался в далёких от идеальных условиях. Есть также средства управления интонацией, генерируются вздохи и взрывы смеха, что делает производимую речь более естественной. Наконец, можно вручную корректировать сложные аспекты произношения, например, многозвучные китайские иероглифы или англоязычные имена собственные. Xiaomi представила ИИ-модели MiMo V2.5 для преобразования текста в речь и обратно

24.04.2026 [10:32],

Павел Котов

Xiaomi представила две модели искусственного интеллекта, предназначенные для работы с голосом. MiMo-V2.5-TTS позволяет преобразовывать текст в речь, предлагая широкие возможности настройки с минимальными усилиями; MiMo-V2.5-ASR — напротив, создаёт текстовые расшифровки по звуку речи и пения.

Источник изображения: Xiaomi Семейство Xiaomi MiMo-V2.5-TTS включает три модели, которые какое-то время будут доступны бесплатно на платформе Xiaomi MiMo Studio. Базовая MiMo-V2.5-TTS позволяет преобразовывать текст в речь с минимальными возможностями: есть набор предустановленных голосов, а также функции настройки скорости речи, тона и эмоционального окраса. MiMo-V2.5-TTS-VoiceDesign позволяет создавать новые тембры голоса, используя короткую фразу. MiMo-V2.5-TTS-VoiceClone, как можно догадаться по названию, предназначена для воспроизведения определённого голоса по небольшому набору образцов, сохраняя согласованность по стилям и инструкциям. Чтобы добиться нужного результата, пользователь может разметить текст заданными тегами или поступить проще — простым естественным языком описать, как должен звучать голос. Можно даже составить сценарий для виртуальных постановок с несколькими голосами сразу. Поддерживаются инструкции на китайском и английском языках. Открытая модель Xiaomi MiMo-V2.5-ASR предназначена для распознавания устной речи даже в сложных условиях. Она поддерживает несколько китайских диалектов и английский язык, может создавать расшифровки двуязычных диалогов, даже записывать тексты песен, разбирая вокал, который звучит вместе с музыкой, а также распознавать речь в условиях сильного постороннего шума. Важным достоинством Xiaomi MiMo-V2.5-ASR является поддержка пунктуации — знаки препинания расставляются на основе интонаций. Это значит, что для готовой расшифровки достаточно минимальных усилий по редактированию. Разработана система генерации голосовых дипфейков в реальном времени, и её наверняка будут использовать мошенники

25.10.2025 [17:59],

Павел Котов

Специализирующаяся на технологиях кибербезопасности компания NCC Group создала работающий на основе искусственного интеллекта метод воссоздания голоса любого человека, функционирующий в реальном времени. Система построена на общедоступных программных решениях и общедоступном оборудовании.

Источник изображения: Vitaly Gariev / unsplash.com Средство для создания голосовых дипфейков в реальном времени после обучения активируется всего одним нажатием кнопки — управление осуществляется при помощи веб-интерфейса, и потенциальный злоумышленник может изобразить из себя кого угодно. Невысоким может быть и качество входного сигнала — голос на выходе всё равно звучит убедительно, а задержка оказывается незначительной. Это значит, что данное решение можно использовать даже с микрофонами, встроенными в ноутбуки и смартфоны. Работа в режиме реального времени — важное преимущество. Существующие технологии подделки голоса на выходе выдают звуковой файл. То есть злоумышленник может заранее записать реплики, но потенциальная жертва легко разоблачит схему, если разговор отклонится от ожидаемого сценария. А если мошенник попробует сгенерировать дипфейк на лету, его выдаст задержка в разговоре. Инженеры NCC Group опробовали свою технологию на собственных клиентах — с их разрешения, конечно — и те ни разу не заметили подвоха. В программной части решения используются инструменты с открытым исходным кодом, а для эффективной работы аппаратной желательно использовать мощные видеокарты, но и ноутбук с одной из наименее производительных в актуальной линейке Nvidia RTX A1000 давал задержку всего в полсекунды. К счастью дипфейки с видеорядом пока не работают в реальном времени. Сейчас крупные соцсети, в том числе TikTok, YouTube и Instagram✴✴ захлестнула очередная волна видеодипфейков, для создания которых используются два инструмента: генератор картинок Google Gemini Flash 2.5 Image (он же Nano Banana) и открытый генератор видео Alibaba WAN 2.2 Animate — они позволяют добавлять на видеоролик любого человека. Слабой стороной дипфейков с видео пока остаётся недостаточная согласованность картинки и звукового ряда — мимика не всегда соответствует интонациям, а если человек якобы взволнован, но его лицо остаётся спокойным — это, вероятно, подделка. Но новые решения заставляют задуматься о необходимости усовершенствовать средства защиты: методы аутентификации теперь не должны полагаться на голосовые и видеозвонки, предупреждают эксперты. Холодильники Samsung научились узнавать членов семьи по голосу

11.06.2025 [19:27],

Сергей Сурабекянц

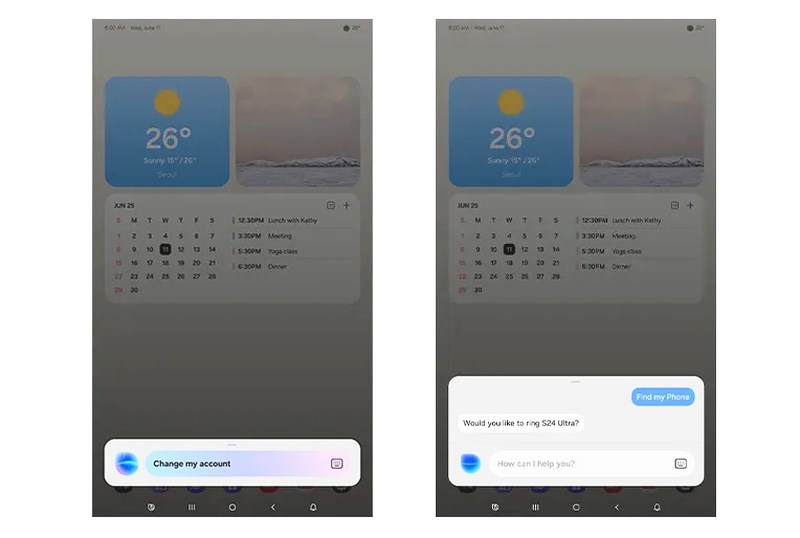

Новейшие умные холодильники Samsung теперь поддерживают распознавание голосов членов семьи с помощью фирменного ИИ-помощника Bixby. Он может использоваться для вывода персонализированной информации на встроенные умные дисплеи в зависимости от того, кто из членов семьи говорит. В условиях отсутствия у Samsung собственной линейки умных колонок, бытовые приборы остаются единственным реальным путём для применения такого рода персонализации.

Источник изображений: Samsung Маркетологи Samsung уверяют, что главное преимущество такого холодильника заключается в возможности отображения календаря или личной фотогалереи каждого члена семьи на основе распознанных голосовых команд. Холодильник можно будет попросить включить будильник на смартфоне или просто отыскать утерянный гаджет (особенно актуально, если он оказался внутри холодильника). Распознавание голоса может оказаться полезным для людей с ослабленным зрением, например умный холодильник может автоматически изменить режим отображения своего экрана в соответствии с настройками смартфона, такими как инверсия цвета или оттенки серого. Samsung добавила новый способ активации ИИ-помощника Bixby на своих холодильниках. Помимо нажатия на значок Bixby или использования голосовых команд, теперь можно просто дважды нажать на выключенный дисплей холодильника.  Функция распознавания голоса и новый способ вызова Bixby появятся в обновлении для холодильников Samsung Bespoke AI с Family Hub, начиная с моделей 2025 года, а позже будут развёрнуты на устройствах с меньшими дисплеями AI Home. Конечно, прогресс не стоит на месте. Но буквально десять лет назад человека, разговаривающего с холодильником, могли запросто (и вполне обоснованно!) отправить в психиатрическую клинику. Apple разработала ИИ, выявляющий нетипичные аспекты устной речи — это поможет диагностировать заболевания

06.06.2025 [18:07],

Павел Котов

В рамках проекта, посвящённого голосовым и речевым моделям искусственного интеллекта, Apple опубликовала материалы (PDF) нового исследования, касающегося одной из сложных проблем машинного обучения: распознавание не только того, что было сказано человеком, но и того, как это было сказано.

Источник изображения: Slavcho Malezan / unsplash.com В статье исследователи описывают схему анализа речи с использованием параметров качества голоса (Voice Quality Dimensions — VQD). Эти параметры указывают на разборчивость, резкость, монотонность речи, придыхание и другие аспекты. На них обращают внимание и логопеды, когда оценивают звучание голоса и влияние на него неврологических состояний и заболеваний. Apple работает над моделями ИИ, также способными их обнаруживать. Большинство речевых моделей обучается на здоровых и типичных для большинства голосах. Если голос человека звучит иначе, ИИ может дать сбой, и это большой недостаток системы, если ей пытается воспользоваться человек с ограниченными возможностями. В работе над этой проблемой исследователи Apple обучили несколько дополнительных моделей ИИ, предназначенных для работы совместно с основными речевыми системами, на большом общедоступном наборе данных аннотированной нетипичной речи, в том числе на голосах людей с болезнью Паркинсона, боковым амиотрофическим склерозом (БАС) и детским церебральным параличом (ДЦП). На этом инженеры компании не остановились — они не стали использовать эти модели для прямой расшифровки сказанного, а составили методику измерения того, как звучит голос, на основе семи основных критериев:

Источник изображения: Iluha Zavaley / unsplash.com Таким образом, ИИ научился «слушать как врач», а не просто регистрировать то, что говорят. Для извлечения звуковых характеристик Apple использовала пять моделей ИИ и обучила дополнительные легковесные алгоритмы, чтобы на основе этих характеристик предсказывать параметры качества голоса. Разработанные компанией дополнительные алгоритмы показали высокие результаты по большинству параметров, хотя качество срабатывания варьировалось в зависимости от конкретного признака и всей задачи. Важнейшим достоинством исследования стало то, что ответы моделей оказались объяснимыми — в отрасли ИИ это встречается нечасто. Вместо того, чтобы показывать условную оценку достоверности (confidence score), система указывает на конкретные характеристики голоса, что упрощает классификацию. Это поможет в клинической оценке и диагностике. Но и на клинической речи в Apple не остановились. Исследователи протестировали свои модели на образцах эмоциональной речи из набора данных RAVDESS: модели VQD не обучались на эмоциональных записях, но также давали прогнозы. Так, в сердитой речи отмечалась низкая «равномерность громкости», а грустные голоса воспринимались как монотонные. Возможно, это поможет улучшить и голосового помощника Apple Siri, который сможет корректировать свои интонации и речь в зависимости от того, как интерпретирует настроение и состояние пользователя, а не только сказанное им. Amazon представила голосовую ИИ-модель Nova Sonic

08.04.2025 [17:47],

Павел Котов

Amazon представила модель генеративного искусственного интеллекта Nova Sonic, способную обрабатывать голос и генерировать речь, которая звучит естественно. В тестах на замеры скорости, распознавание речи и качество разговора Sonic зарекомендовала себя как конкурентоспособная в сравнении с передовыми голосовыми моделями OpenAI и Google.

Источник изображений: aboutamazon.com Nova Sonic — ответ Amazon на новые голосовые модели ИИ, такие как лежащая в основе звукового режима ChatGPT; все они предлагают более естественные форматы общения, чем ранние версии голосового помощника Alexa. Технологические прорывы последних лет позволили сделать устаревшие модели и цифровых помощников, включая Alexa и Apple Siri, намного более естественными во взаимодействии с человеком. Модель Nova Sonic доступна через Bedrock — предлагаемую Amazon платформу для разработчиков корпоративных приложений с ИИ; поддерживается двунаправленный потоковый API. Nova Sonic, добавили в Amazon, обходится в эксплуатации на 80 % дешевле, чем мультимодальная OpenAI GPT-4o, а её компоненты уже работают в обновлённом варианте Alexa+. Она превосходит конкурентов в маршрутизации пользовательских запросов к различным API — модель «знает», когда ей необходимо в реальном времени извлечь информацию из интернета, проанализировать собственный источник данных или выполнить действие во внешнем приложении — и использовать для этого соответствующий инструмент. Во время двустороннего диалога Nova Sonic ждёт, чтобы заговорить «в подходящее время», учитывая свойственные собеседнику паузы и запинки. Она также составляет текстовую расшифровку речи пользователя, которую разработчики могут использовать для различных приложений.  В задачах, связанных с распознаванием речи, она менее склонна к ошибкам, чем другие голосовые модели ИИ, то есть относительно хорошо понимает пользователя, даже если он бормочет, говорит с ошибками или находится в шумной обстановке. В эталонном тесте Multilingual LibriSpeech, позволяющем оценить качество распознавания речи на разных языках и диалектах, Nova Sonic показала коэффициент ошибок в словах (WER) всего 4,2 % в среднем по английскому, французскому, итальянскому, немецкому, и испанскому языках. То есть при подготовке расшифровки речи она неверно распознает примерно четыре из ста слов по сравнению с человеком. В бенчмарке Augmented Multi Party Interaction, оценивающем качество разговора вслух с несколькими участниками, Nova Sonic оказалась на 46,7 % точнее по критерию WER, чем OpenAI GPT-4o-transcribe. Модель от Amazon также оказалась очень быстрой — её средняя задержка составила 1,09 с против 1,18 с, которую показала GPT-4o, лежащая в основе OpenAI Realtime API. Компания намеревается представить ещё несколько моделей ИИ, способных к обработке изображений, видео, голоса и «других сенсорных данных, которые необходимы при переносе в физический мир». Поговорить с ChatGPT теперь можно в веб-версии сервиса — там появился голосовой интерфейс Advanced Voice Mode

20.11.2024 [00:33],

Николай Хижняк

Компания OpenAI запустила голосовой интерфейс Advanced Voice Mode в веб-версии сервиса ChatGPT. Об этом через свою страницу в соцсети X сообщил директор по продуктам компании Кевин Вейл (Kevin Weil). Продвинутый голосовой интерфейс по-прежнему доступен только платным пользователям ChatGPT.

Источник изображения: Mariia Shalabaieva / unsplash.com Голосовой интерфейс Advanced Voice Mode стал доступен для владельцев подписок Plus, Enterprise, Teams или Edu теперь и в веб-версии сервиса ChatGPT. С момента своего дебюта в сентябре продвинутый интерфейс был доступен только в мобильной версии ChatGPT для iOS и Android. Голосовой интерфейс Advanced Voice Mode использует аудиовозможности ИИ-модели GPT-4o, предлагая естественное общение в реальном времени между пользователем и ChatGPT. Чат-бот способен понимать и реагировать на невербальные сигналы пользователя, включая такие вещи, как скорость речи. Кроме того, он может реагировать с «эмоциями». Для начала разговора в веб-версии чат-бота необходимо выбрать значок «Голос» в правом нижнем углу у поля ввода запросов к ChatGPT. Затем необходимо предоставить браузеру разрешение на доступ к микрофону вашего компьютера. После начала голосового чата пользователь попадёт на экран с синим шаром в центре. Функция предлагает на выбор один из девяти голосов для ChatGPT, каждый из которых имеет свой собственный тон и характер. Например, можно выбрать «лёгкий и универсальный стиль Arbor» или «уверенный и оптимистичный Ember». По словам Вайля, OpenAI планирует «в ближайшие недели» внедрить голосовой формат общения с ChatGPT и для бесплатных пользователей. Владельцы подписок Plus и Team могут использовать голосовой формат Advanced Voice Mode лишь определённое количество времени в сутки. Система уведомит, когда у пользователя останется последние 15 минут ежедневного доступа к голосовому общению с ИИ-ботом. Бесплатным пользователям будет предлагаться доступ на непродолжительное время для знакомства с функцией. В Калифорнии приняли законы о защите артистов от искусственного интеллекта

18.09.2024 [19:53],

Сергей Сурабекянц

Достижения в области генеративного ИИ ставят под угрозу существование многих творческих профессий. Актёры опасаются, что имитация их образов может стать обычным явлением. Губернатор Калифорнии Гэвин Ньюсом (Gavin Newsom) подписал 17 сентября два законопроекта, которые призваны помочь актёрам, музыкантам и другим исполнителям защитить свои цифровые копии в аудио- и визуальных постановках от копирования при помощи искусственного интеллекта.

Источник изображения: unsplash.com Подписание этих законопроектов стало реакцией на обоснованную обеспокоенность общества в отношении бума искусственного интеллекта, в процессе которого большие языковые модели, обученные на соответствующем материале, в состоянии создавать фейковые видео, изображения и аудиоматериалы, с высокой точностью имитирующие реальных людей. В связи с этим многие эксперты подняли правовые и этические вопросы использования ИИ. Один из законопроектов, подписанных Ньюсомом, требует, чтобы в «контрактах указывалось использование созданных ИИ цифровых копий голоса или образа исполнителя, а исполнитель должен быть профессионально представлен при обсуждении контракта». Другой законопроект запрещает «коммерческое использование цифровых копий умерших исполнителей в фильмах, телешоу, видеоиграх, аудиокнигах, звукозаписях и многом другом без предварительного получения согласия наследников этих исполнителей». В марте губернатор Теннесси Билл Ли (Bill Lee) подписал подобный законопроект, направленный на защиту артистов, включая музыкантов, от несанкционированного использования их образов и голосов искусственным интеллектом. Ранее администрация президента США пыталась оказать давление на законодателей с целью регулирования ИИ, но поляризованный Конгресс США, где республиканцы контролируют Палату представителей, а демократы контролируют Сенат, не добился большого прогресса в разработке и принятии эффективного законодательства. Евросоюз смог дальше продвинуться в этом направлении: европейский «Закон об ИИ», основанный на оценке рисков, вступил в силу 1 августа 2024 года. Положения документа будут внедряться поэтапно вплоть до середины 2026 года. Уже через шесть месяцев планируется обеспечить соблюдение запретов на несколько видов использования ИИ в конкретных сценариях. OpenAI открыла доступ к гиперреалистичному голосу ChatGPT некоторым платным пользователям

31.07.2024 [13:14],

Павел Котов

OpenAI начала развёртывать голосовой интерфейс Advanced Voice Mode для сервиса ChatGPT — доступ к гиперреалистичным диалогам с GPT-4o получило небольшое число подписчиков ChatGPT Plus. Разработчик пообещал, что к осени новой функцией смогут пользоваться все обладатели платной подписки.

Источник изображения: Mariia Shalabaieva / unsplash.com Впервые OpenAI продемонстрировала голосовой формат GPT-4o в мае — тогда эта функция поразила аудиторию не только способностью давать быстрые ответы, но и сходством одного из голосов с голосом Скарлетт Йоханссон (Scarlett Johansson). Актриса заявила, что отказала главе компании Сэму Альтману (Sam Altman) в праве использовать её голос для этих целей; после чего ей пришлось обратиться к юристам для защиты своих интересов, и в OpenAI отказались от своих намерений, чтобы не доводить дело до конфликта. В июне компания сообщила, что отложит выпуск голосового интерфейса, чтобы завершить разработку мер безопасности. Анонсированные ранее функции ИИ-помощника, такие как поддержка видео и демонстрация экрана, на этапе альфа-тестирования доступны не будут, а появятся «позже». Пока пользователям придётся ограничиться голосовым взаимодействием. Ранее для реализации этой функции OpenAI подключала три модели ИИ: одну для преобразования голоса в текст, вторую (GPT-4) для собственно обработки запросов, а третью для преобразования текстового ответа ChatGPT в голос. Обновлённая GPT-4o является мультимодальной — она решает все эти задачи самостоятельно, обеспечивая минимальную задержку. Модель также способна распознавать в голосе пользователя эмоциональные интонации, определяя, например, грусть или волнение, она также знает, когда человек поёт.

Источник изображения: Growtika / unsplash.com OpenAI будет развёртывать голосовой интерфейс ChatGPT постепенно, чтобы внимательно следить, как он используется в действительности. Включённые в группу альфа-тестирования пользователи получат уведомление через приложение ChatGPT, за которым последует письмо с инструкциями по работе с новыми функциями. К настоящему моменту голосовые возможности GPT-4o протестированы более чем сотней членов закрытой команды тестирования Red Team, говорящих на 45 языках. Голосовой режим ChatGPT будет ограничен четырьмя голосами: Juniper, Breeze, Cove и Ember, которые были созданы при участии актёров. Голос Sky, который сравнивали с голосом Скарлетт Йоханссон, компания исключила. OpenAI также сообщила, что установила фильтры для блокировки запросов на создание музыки и других материалов, которые могут быть защищены авторским правом — для стартапов Suno и Udio это закончилось судебными исками от крупных музыкальных издателей. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |