|

Опрос

|

реклама

Быстрый переход

США столкнутся с дефицитом электроэнергии из-за ИИ уже в 2025 году, предупредил отраслевой регулятор

18.12.2024 [17:46],

Сергей Сурабекянц

Североамериканская электросеть сталкивается с «критическими проблемами надёжности», поскольку производство электроэнергии не успевает за растущим спросом со стороны систем искусственного интеллекта. Рост потребления электроэнергии в следующем десятилетии в сочетании с закрытием угольных электростанций создаст огромную нагрузку на сети США и Канады и может превысить генерирующие мощности, сообщает North American Electric Reliability Corporation (NERC).

Источник изображения: pexels.com NERC — некоммерческая организация, подконтрольная Федеральной комиссии по регулированию энергетики. По данным NERC, дефицит может привести к веерным отключениям электроэнергии в периоды пикового спроса в обеих странах. Проблема может потенциально усугубится из-за задержек с вводом в эксплуатацию мощностей солнечной генерации, ветряных электростанций, аккумулирующих мощностей и гибридных ресурсов. Некоторые районы США могут столкнуться с дефицитом уже в следующем году. Отчёт NERC за 2024 год свидетельствует о том, что растущие потребности ИИ в энергии могут перегрузить и нарушить баланс всей энергосистемы. «Мы переживаем период глубоких изменений, — заявил директор по оценке надёжности NERC Джон Моура (John Moura). — Мы наблюдаем рост спроса, которого не видели десятилетиями и видим, что темпы [роста спроса] только ускоряются». Предполагаемый всплеск спроса совпадёт со сворачиванием генерации на ископаемом топливе, при этом в течение следующих 10 лет планируется закрыть мощности на 115 ГВт. По данным NERC, спрос на электроэнергию за последний год рос быстрее, чем когда-либо за последние два десятилетия на фоне массового строительства центров обработки данных ИИ и майнинга криптовалют, а также по мере роста популярности электромобилей и тепловых насосов. Вместо прогнозируемых 80 ГВт пиковый летний спрос в течение следующего десятилетия вырастет на 132 ГВт, или на 15 процентов. Пиковый зимний спрос вырастет на 18 процентов до 149 ГВт, что в полтора раза превышает прошлый прогноз в 92 ГВт. По прогнозам международного энергетического агентства, глобальный спрос на электроэнергию только от центров обработки данных может превысить 1000 тераватт-часов к 2026 году, что вдвое больше уровня 2022 года и эквивалентно общим потребностям Германии в электроэнергии. Крупные технологические компании изо всех сил пытаются найти способы удовлетворить растущие потребности в электроэнергии, в том числе заключая сделки о строительстве новых атомных электростанций и малых модульных ядерных реакторов. Вместе с Apple Intelligence на старые iPhone пришёл перегрев

18.12.2024 [15:51],

Павел Котов

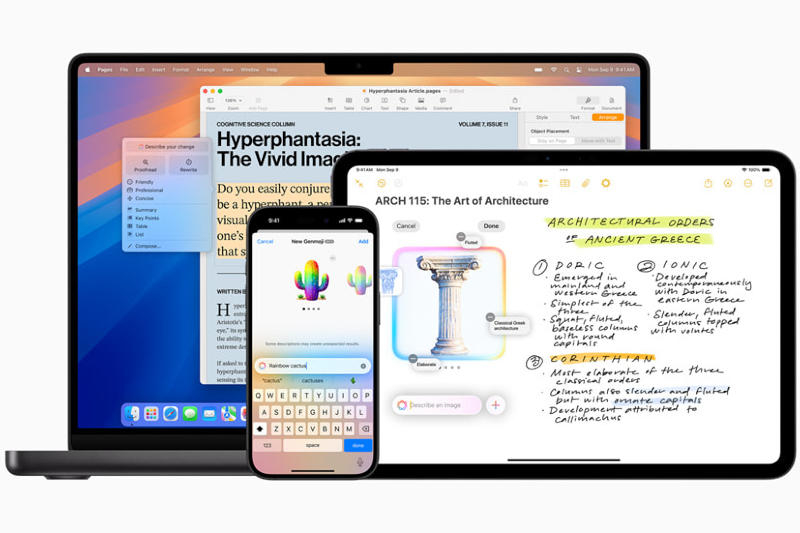

На минувшей неделе Apple начала развёртывать на iPhone обновление iOS 18.2 — оно знаменует выход компании в области искусственного интеллекта, поскольку сопровождается пакетом Apple Intelligence. Но некоторые владельцы iPhone стали сообщать о перегреве устройств при работе с некоторыми функциями пакета.

Источник изображения: apple.com С момента выхода iOS 18.2 прошли уже несколько дней, и владельцы iPhone начали делиться впечатлениями об обновлении — в некоторых случаях ситуация оказалась не вполне радостной. При запуске ряда функций генеративного ИИ стали отмечаться перегрев устройств и сокращение времени их автономной работы. В качестве примера пользователи Reddit привели Image Playground — функцию, которая преобразует картинки из галереи в соответствии с выбранным стилем. Она может переработать портрет человека и выполнить его в виде трёхмерной модели или рисунка; можно также добавить в кадр какой-либо предмет. Но при использовании Image Playground устройства, как сообщается, стали быстро нагреваться. Некоторые проблемы проявляются при запуске функции Genmoji — генератор смайликов вызывает проблемы с производительностью и подтормаживания в работе пользовательского интерфейса. Стоит, однако, отметить, что об этом эффекте сообщают лишь владельцы iPhone 15 Pro и Pro Max, тогда как на iPhone 16 функция работает нормально. Зато перегрев устройства при запуске приложения «Фото» наблюдается уже и на iPhone 16; сообщается также, что с выходом обновления iOS 18.2 стало сокращаться время автономной работы устройств. Официальных комментариев от представителей Apple пока не последовало, но причина проблем представляется очевидной. Аналогичные функции на устройствах под Android чаще запускаются из облака, а Apple, сохраняющая свою приверженность конфиденциальности, решила перенести их локально на свои устройства, что может вызвать и дополнительный нагрев, и сокращение времени автономной работы гаджетов. Возможно, для Apple пришла пора задуматься об установке систем охлаждения на iPhone — в лагере Android они уже не редкость. Nvidia представила крошечный ИИ-компьютер Jetson Orin Nano Super всего за $249 для создания умных роботов и дронов

17.12.2024 [19:10],

Сергей Сурабекянц

Компания Nvidia представила одноплатный компьютер Jetson Orin Nano Super для разработчиков различных систем с искусственным интеллектом, включая дронов, роботов и т.д. Новинка обеспечивает на 70 % большую производительность по сравнению с Jetson Orin Nano и стоит вдвое дешевле. Производительность Jetson Orin Nano Super — 67 TOPS при цене $249, что является серьёзным улучшением по сравнению с 40 TOPS у предшественника стоимостью $499.

Источник изображений: Nvidia Jetson Orin Nano Super оснащён шестиядерным процессором Arm Cortex-A78AE, работающим на частоте 1,7 ГГц, и поставляется с 8 Гбайт оперативной памяти. Графический процессор с частотой 1020 МГц имеет 1024 ядра CUDA и 32 тензорных ядра, что обеспечивает максимальную производительность в 67 TOPS. Система может питаться либо через порт USB Type-C, либо через проприетарный разъём, в любом случае для максимальной производительности мощность источника питания должна составлять не менее 25 Вт. Плата оборудована четырьмя портами USB 3.2 Type-A, которые работают на скорости 10 Гбит/с, двумя портами MIPI CSI, совместимыми с камерой Raspberry Pi и разъёмами M.2 2280 и M.2 2230 для подключения SSD. Jetson Orin Nano Super также оборудован 40-контактным разъёмом GPIO, совместимым с Raspberry Pi, что предполагает возможность использования плат расширения Raspberry Pi Hats. Jetson Orin Nano Super работает под управлением специализированной версии Linux — L4T, созданной специально для работы на оборудовании Nvidia. Загрузка системы может осуществляться как с SSD, так и с карты памяти формата microSD. По данным Nvidia, Jetson Orin Nano Super демонстрирует прирост производительности относительно оригинального Jetson Orin Nano в обучении больших языковых моделях на 37–63 %, задачах машинного зрения — на 36–104 %, и в распознавании изображений — на 43–69 %. Nvidia отметила, что другие её одноплатные компьютеры текущего поколения, включая «обычный» Jetson Orin Nano, также получат прирост производительности до 70 процентов после обновления программного обеспечения. Например, производительность Orin NX 16 Гбайт увеличится со 100 до 157 TOPS, а Orin NX 8 Гбайт — с 70 до 117 TOPS. Одноплатный компьютер Nvidia Jetson Orin Nano Super появится в продаже в конце этого месяца. OpenAI бросила вызов Google: поиск в интернете через ChatGPT открылся для всех пользователей

16.12.2024 [22:31],

Андрей Созинов

Компания OpenAI сегодня открыла поиск в интернете через чат-бота с искусственным интеллектом ChatGPT для всех пользователей. Таким образом разработчики бросили прямой вызов Google, которая тотально доминирует на мировом рынке поисковых систем.

Источник изображения: OpenAI Решение с незамысловатым названием ChatGPT Search, то есть «ChatGPT Поиск», будет доступно любому пользователю, вошедшему в свой аккаунт в мобильных приложениях чат-бота или веб-версии сервиса, объявили в OpenAI в понедельник 16 декабря. Ранее поиск в интернете через ChatGPT был доступен только для платных подписчиков. Как отмечает компания, поиск через ChatGPT позволяет «получать быстрые и актуальные ответы со ссылками на соответствующие веб-источники». Запрос к ChatGPT вводится как обычно и чат-бот сам решит, нужно ли по данному вопросу искать что-либо в интернете. А если пользователь нажмёт кнопку «Поиск», то бот напрямую выполнит поиск в интернете. Также можно попросить чат-бота уточнить условия поиска или подготовить более детальную сводку по результатам. Отдельно стоит отметить, что ChatGPT Search можно будет назначить поисковой системой по умолчанию для своего веб-браузера. У Google, возможно, появится действительно серьёзный соперник, ведь людям будет куда проще спросить о чём-то у ИИ и увидеть в ответ сводку информации, а не формулировать запрос и искать нужную информацию по разным сайтом из выдачи. OpenAI также продемонстрировала новую опцию, которая позволит пользователям задавать вопросы чат-боту — например, о том, чем заняться в Цюрихе перед Рождеством — и получать устные ответы. Расширение фирменной поисковой системы стало частью 12-дневного марафона анонсов от OpenAI. Ранее разработчик представил новую более дорогую подписку ChatGPT Pro за $200 в месяц и открыл для широкой публики инструмент для создания видео с помощью искусственного интеллекта под названием Sora. В ближайшие дни нас ожидает по меньшей мере ещё один анонс от OpenAI, ведь сегодня лишь восьмой день марафона. TSMC к 2026 году утроит мощности по упаковке чипов методом CoWoS, чтобы лучше обслуживать Nvidia

15.12.2024 [08:19],

Алексей Разин

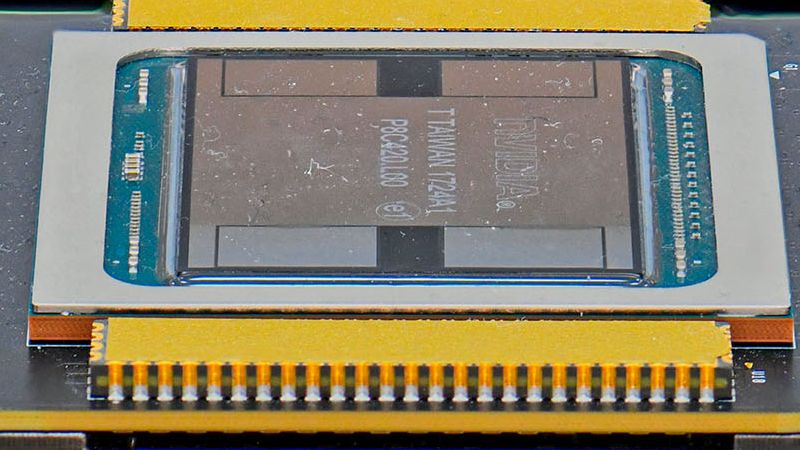

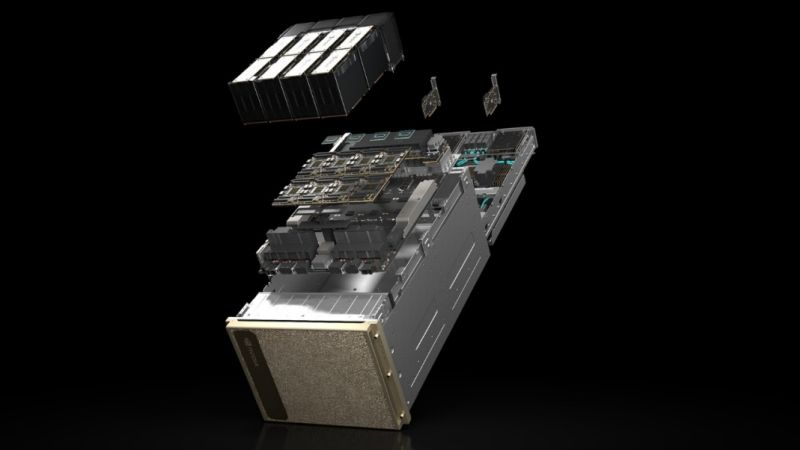

Бурный рост выручки Nvidia на фоне высокого спроса на её ускорители вычислений в действительности сдерживается возможностями её производственных партнёров, главным из которых является TSMC. Последняя не только выпускает чипы для Nvidia, но и упаковывает их передовым методом CoWoS, и возможности подрядчика в этой сфере являются для Nvidia узким местом, которое он готов активно расширять.

Источник изображения: TSMC По информации Commercial Times, компания TSMC интенсивно расширяет на территории Тайваня свои производственные мощности по тестированию и упаковке чипов методом CoWoS. Купленное у Innolux предприятие по производству ЖК-панелей в Тайнане будет переоборудовано под тестирование и упаковку чипов к концу следующего года, и совокупные возможности TSMC в этой сфере к концу 2026 года утроятся до 90 000 кремниевых пластин в месяц, по данным тайваньских источников. Профильное предприятие TSMC в Тайчжуне будет введено в строй в первой половине следующего года, компания также строит два предприятия в других районах острова. В текущем году, по оценкам аналитиков, TSMC была способна упаковывать и тестировать чипы с использованием метода CoWoS в количестве, эквивалентном 35 000 кремниевых пластин в месяц. Выручка от данного вида услуг достигла 7–9 % от совокупной. К концу следующего года мощности удвоятся до 70 000 пластин в месяц, а доля выручки перевалит за 10 %. Наконец, к концу 2026 года TSMC сможет ежемесячно упаковывать по методу CoWoS количество чипов, эквивалентное 90 000 кремниевых пластин. Итого, с 2022 по 2026 годы производительность компании в этой сфере будет увеличиваться ежегодно в среднем на 50 %, причём процесс продолжится и после 2026 года. Одно только предприятие в Тайнане теоретически могло бы ежемесячно обрабатывать по 50 000 кремниевых пластин в месяц. Скорее всего, профильными заказами оно в итоге будет загружено только частично, а остальные мощности выделят под работу с методами упаковки CPO и FoPLP. Бывший сотрудник OpenAI, обвинявший компанию в нарушении авторских прав, найден мёртвым

14.12.2024 [12:45],

Владимир Мироненко

Бывший сотрудник OpenAI, 26-летний Сухир Баладжи (Suchir Balaji), 26 ноября был найден мёртвым в своей квартире в Сан-Франциско, сообщил ресурс TechCrunch. В полиции подтвердили личность Баладжи и заявили, что причиной его смерти стало самоубийство. В октябре в интервью The New York Times он выразил обеспокоенность по поводу нарушения OpenAI закона об авторском праве.

Источник изображения: Levart_Photographer/unsplash.com Сухир Баладжи стажировался в OpenAI и Scale AI. «Я проработал в OpenAI почти 4 года и последние 1,5 года работал над ChatGPT», — сообщил Баладжи в твите в октябре этого года. Баладжи рассказал, что заинтересовался вопросом защиты авторских прав, когда увидел все иски, поданные против компании. «Когда я попытался лучше разобраться в этом вопросе, я в конце концов пришёл к выводу, что добросовестное использование кажется довольно неправдоподобной защитой для многих продуктов генеративного ИИ по той простой причине, что они могут создавать заменители, которые конкурируют с данными, на которых они обучены», — сообщил он. Согласно описанию профиля в LinkedIn, первоначально Баладжи работал над WebGPT, доработанной версией GPT-3, которая могла осуществлять поиск в интернете. Это была ранняя версия SearchGPT, вышедшего в этом году. Впоследствии Баладжи работал в команде предварительного обучения GPT-4, а также в команде разработчиков ИИ-модели o1 со способностью рассуждать и команде постобучения ChatGPT. Баладжи сообщил газете The New York Times, что OpenAI без разрешения использовала огромные объёмы интернет-данных для разработки ИИ-чат-бота ChatGPT, вышедшего в ноябре 2022 года. Он также обвинил компанию в создании собственного программного обеспечения для транскрибирования видео на YouTube для извлечения данных. Из-за использования контента без разрешения со стороны издания, The New York Times подала в конце прошлого года на OpenAI и Microsoft в суд с обвинением в нарушении авторских прав. Трагическое происшествие с Баладжи привлекло дополнительное внимание к продолжающимся дебатам об этичном использовании данных при разработке технологий искусственного интеллекта. Акции Broadcom подорожали на 24 %, капитализация компании впервые превысила $1 трлн

14.12.2024 [08:29],

Алексей Разин

В давно устоявшемся списке компаний с величиной капитализации более $1 трлн вчера появился новичок в лице Broadcom, курс акций которой вчера подскочил на 24 % после публикации квартальной отчётности и невзирая на слухи о намерениях Apple отказаться от использования её компонентов в своей продукции.

Источник изображения: Broadcom По сути, как отмечает CNBC, минувшая пятница стала для акций Broadcom самым успешным днём на фондовом рынке за всю историю существования компании, поскольку курс акций вырос более чем на 24 % по итогам вчерашней сессии. Итоги квартала превзошли ожидания аналитиков, продемонстрировав сильное увеличение выручки в сегменте компонентов для систем искусственного интеллекта. Совокупная выручка компании увеличилась на 51 % год к году до $14,05 млрд и даже немного недотянула до прогнозируемой величины, но в целом на направлении ИИ выручка компании по итогам фискального года выросла на 220 % до $12,2 млрд, по словам руководства. Квартальная выручка в сегменте полупроводниковых решений в годовом сравнении увеличилась только на 12 % до $8,23 млрд. Положительной динамики акциям Broadcom добавило заявление главы компании Хока Тана (Hock Tan) о разработке чипа для систем ИИ по индивидуальному заказу крупных облачных клиентов. Чистая прибыль компании в четвёртом сегменте выросла на 23 % до $4,32 млрд. Аналитики рекомендовали акции Broadcom к покупке, объяснив такую рекомендацию способностью компании увеличить свои доходы в сфере компонентов для систем ИИ. Впрочем, конкуренция со стороны Nvidia представляет определённую угрозу для экспансии бизнеса Broadcom в этой сфере. Потенциал последней в сегменте ИИ, по мнению представителей Morgan Stanley, будет наиболее активно развиваться в ближайшие два или три года. Власти США готовят новые ограничения в сфере ИИ для Китая, которые коснутся третьих стран

14.12.2024 [06:44],

Алексей Разин

Издание The Wall Street Journal к концу недели определилось со спецификой новых ограничений, которые власти США готовят в сфере поставок компонентов и систем искусственного интеллекта в КНР через третьи страны. Усиление экспортных ограничений США в таком ключе грозит ухудшить взаимоотношения с рядом стран Юго-Восточной Азии и Ближнего Востока.

Источник изображения: Nvidia Ближайшим геополитическим союзникам США, как уточняет источник, новые ограничения не грозят, а вот страны, которые в этом смысле стараются быть равноудалёнными от Китая и США, могут попасть под ограничения на закупку компонентов для систем искусственного интеллекта, которые через данные страны могут попадать в Китай, по мнению американских чиновников. Помимо запрета на поставки ускорителей вычислений на базе GPU, власти США готовят и более широкие формулировки, которые позволяют подогнать под ограничения поставок самые разные вычислительные компоненты. Площадь кристалла, количество и плотность размещения транзисторов на нём и некоторые косвенные признаки, указывающие на возможность использования чипа в системах ИИ, станут критериями при формулировании экспортных ограничений. Как сообщается, TSMC и Samsung уже получили письма от американских регуляторов, рекомендующие не принимать заказы от китайских клиентов, касающиеся изготовления высокопроизводительных чипов по передовым техпроцессам. Власти США также стремятся ограничить доступ китайских компаний к вычислительным мощностям, расположенным в других странах. Экспорт программного обеспечения из США также будет подвержен дополнительному контролю, если планируемые меры удастся реализовать. Американские чиновники уже вмешались в процесс сотрудничества Microsoft и компании G42 из ОАЭ, которая была вынуждена отказаться от взаимодействия с китайскими партнёрами и инвесторами в обмен на доступ к ускорителям вычислений Nvidia и американским инвестициям. Малайзия может стать следующей мишенью санкций США, поскольку страна одновременно поддерживает дружественные отношения с Китаем, пытаясь развивать собственную инфраструктуру центров обработки данных и систем искусственного интеллекта. Все описываемые меры только обсуждаются и в конечном итоге могут быть реализованы в модифицированном виде, если дело вообще дойдёт до их внедрения, ведь срок полномочий действующего правительства США истекает в январе. Adobe Photoshop научился удалять отражения в окнах и витринах

13.12.2024 [19:05],

Павел Котов

Adobe представила новый экспериментальный инструмент, который удаляет с фотографий отражения в окнах. Первоначально функцию продемонстрировали на мероприятии Adobe Max 2023, и тогда она называлась Project See Through — теперь с ней могут работать пользователи Adobe Photoshop или Adobe Bridge с подпиской Creative Cloud, скоро она появится в Adobe Lightroom.

Источник изображений: blog.adobe.com Фотолюбители, которым доводилось делать снимки через витрину магазина, вероятно, сталкивались с собственным отражением в кадре или световыми бликами, которые портят картинку. Инструмент под названием «Удаление отражения» (Reflection Removal) позволяет удалять их с минимальными усилиями.  При помощи искусственного интеллекта он разделяет два изображения: отражение в окне и то, что находится по ту сторону этого окна. Для реализации этой функции Adobe обучила ИИ на нескольких тысячах пар фотографий в исходном виде и с искусственно наложенными на них отражениями. Модели поручили определить, какое из двух изображений является исходным, а какое — составным.  Эффективнее всего инструмент справляется с отражениями, которые занимают всё поле зрения на картинке, и он почти неспособен удалять «отражения в окнах, которые имеют небольшой размер или находятся далеко», а также отражения «в винных бокалах, на кузовах автомобилей или отражённые в озере облака». Функция «Удаление отражения» включается отдельно через настройки плагина Camera RAW. Зонд NASA «Юнона» рассказал о «внутренностях» самого вулканически активного объекта Солнечной системы

13.12.2024 [18:56],

Геннадий Детинич

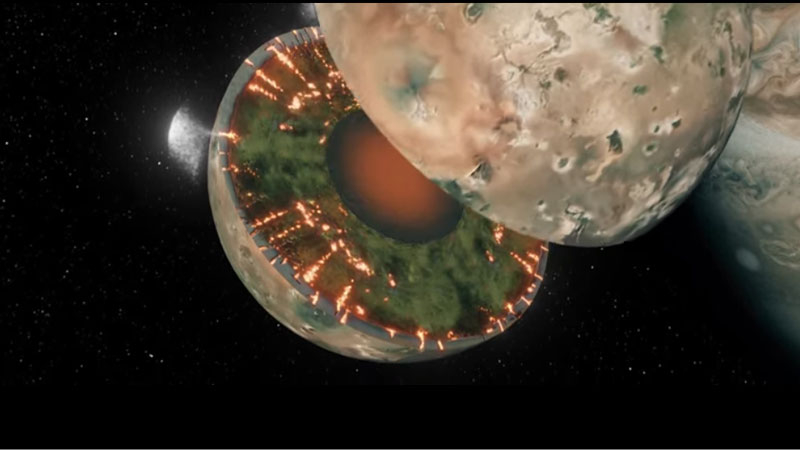

Учёные разгадали одну из главных загадок вулканической активности спутника Юпитера Ио. Они определили глобальную суть вулканических процессов на этой луне, извержения на которой были впервые замечены 44 года назад зондом NASA «Вояджер-1». В основном ожидалось, что в недрах Ио имеется глобальный океан раскалённой магмы. Свежие данные показывают, что это ошибочное мнение — каждый вулкан на Ио имеет свой персональный «ад».

На Ио не обнаружено признаков глобального океана магмы. Источник изображения: NASA О содержании недр небесного тела можно судить по его гравитационному полю. В этом плане Земля и Луна имеют подробнейшие карты гравитационных возмущений, что помогает нам рассчитывать орбиты космических миссий. Карты гравитационных полей Земли и Луны созданы с помощью спутников и измерений их скоростей и ускорений под действием гравитационных сил. Аналогичным образом учёные поступили в случае картирования гравитационного поля Ио. Пробным телом для этого выступил зонд NASA «Юнона» (Juno). Во время двух близких пролётов мимо Ио в декабре 2023 года и феврале 2024 года зонд сближался со спутником до 1500 км. В это время он поддерживал связь с Землёй. Это означает, что радиоканал работал на двух частотах. По изменениям в длинах волн из-за эффекта Доплера можно рассчитать изменения в скорости зонда (ускорение или замедление). Тем самым гравитация Ио, в зависимости от содержимого его недр, повлияла бы на зонд либо так, либо иначе. Как именно, учёные смогли рассчитать и понять, что это означает. Расчёты и моделирование показали, что мантия Ио на небольшой глубине (около 50 км) скорее упруго-вязкая, чем жидкая. Если бы на спутнике был глобальный океан жидкой магмы, отклик был бы совсем другой. Жидкая магма сильнее бы реагировала на приливные силы Юпитера, и это создавало бы более сильные возмущения гравитации, что нашло бы отражение в ускорении «Юноны» во время близкого пролёта этой луны. В случае Ио сотни одновременно действующих вулканов питаются из собственных карманов магмы, а не черпают расплав из общего источника. Проделанная работа помогла понять, что приливные силы не обязательно настолько сильны, как у Юпитера, чтобы расшевелить недра ближайшей луны до состояния расплавленного океана магмы. Очевидно, что это поможет давать оценку экзопланетам и их геологии, а также эволюции. Кроме того, планетологи, похоже, должны пересмотреть возможное строение других близких спутников Юпитера и Сатурна, что со временем непосредственно скажется на наших космических программах. ИИ-бот GigaChat от «Сбера» научился писать музыку по текстовым запросам

13.12.2024 [17:57],

Павел Котов

«Сбер» анонсировал на международной конференции AI Journey новую функцию модели искусственного интеллекта GigaChat — написание музыкальных композиций по текстовому запросу.

Источник изображения: «Сбер» Простые средства управления GigaChat позволяют создавать музыку всем желающим, «включая представителей далёких от музыкальной индустрии профессий, ценящих уникальность и креативный подход», рассказали в «Сбере». ИИ ориентируется в различных жанрах и стилях — при создании композиций он применяет широкий набор инструментов и генерирует голоса; пользователь же при подготовке запроса может пользоваться заготовками, которые предлагает разработчик. Есть также возможность в свободной форме в текстовом поле подготовить описание желаемой композиции: указать стиль, уточнить аранжировку и выбрать вокал — ограничений нет. У GigaChat отсутствует какая-либо библиотека звуков или вокальных партий — всё генерируется в соответствии с запросом; вокал может быть мужским, женским или хоровым. По желанию пользователя ИИ может даже написать текст песни, которую исполнит созданный им голос. Пока воспользоваться новой функцией GigaChat можно только в мини-приложении во «ВКонтакте»; в будущем она появится в веб-версии GigaChat, а также в Telegram и «Одноклассниках». Временная глава Intel не верит в успех ИИ-ускорителей Falcon Shores, но это «первый шаг в верном направлении»

13.12.2024 [17:48],

Николай Хижняк

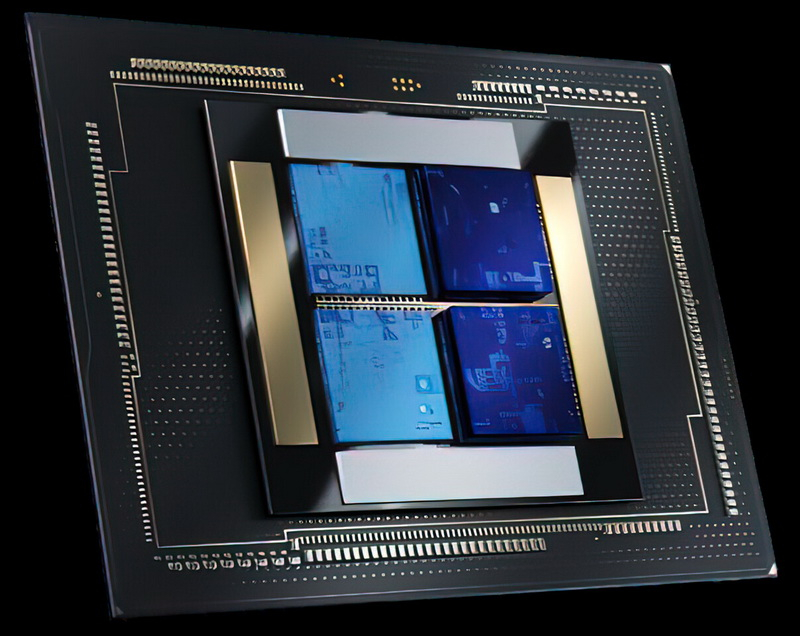

Руководство компании Intel не верит, что компания сможет в скором времени составить достойную конкуренцию Nvidia и AMD в сфере ИИ-ускорителей. Во всяком случае, такое впечатление сложилось после недавних комментариев одной из временно исполняющей обязанности руководителя компании Мишель Джонстон Холтхаус (Michell Johnston Holthaus) на 22-й ежегодной глобальной технологической конференции Barclays.

Источник изображений: Intel Напомним, Intel разрабатывает ускорители вычислений Falcon Shores, в основу которого будет положен графический процессор, заточенный под высокопроизводительные вычислений и задачи ЦОД, а дополнят GPU элементы актуальных ИИ-ускорителей Gaudi. Проект по разработке данного решения получил неожиданную оценку от Холтхаус: «Нам действительно нужно подумать о том, как перейти от Gaudi к нашему первому поколению GPU Falcon Shores. Будет ли новый продукт удивительным? Нет, не будет. Но он станет первым шагом в верном направлении». Хольтхаус ещё раз подчеркнула новый прагматичный подход Intel к вопросам разработки аппаратных решений для ускорения ИИ, когда затронула тему стратегии развития продуктов: «Если всё бросить и начать создать новый продукт, то его разработка займёт очень много времени. Прежде чем что-то появится потребуется два–три года. Вместо этого я предпочла бы создать что-то в меньших объёмах, научиться чему-то новому, последовательно совершенствуясь, чтобы в конечном итоге добиться поставленных целей». Врио главы Intel признала устойчивый характер возможностей рынка ИИ, акцентировав текущий интерес индустрии к обучению ИИ-моделей. Однако Хольтхаус также подчеркнула потенциал широких возможностей в других областях: «Очевидно, что ИИ никуда не денется. Очевидно, что обучение [ИИ] сегодня находится центре внимания, но есть возможности развития и на других направлениях, где также отмечаются потребности с точки зрения нового аппаратного обеспечения». По всей видимости она подразумевала инференс — запуск уже обученных нейросетей. Из сказанного можно сделать вывод, что Falcon Shores не станет для Intel чудесным спасательным кругом, который позволит ей наверстать отставание от Nvidia на рынке GPU-ускорителей. Это в большей степени первая ступень к разработке первоклассного продукта в перспективе. Следующим проектом Intel после Falcon Shores должен стать Jaguar Shores. Его выход ожидается в конце 2025 или начале 2026 года в виде ускорителей ИИ и HPC для центров обработки данных. Однако до его появления компании предстоит проделать немало работы по усовершенствованию не только своего аппаратного, но и программного обеспечения. Доминирующе положение Nvidia на рынке ИИ во многом обязано её программно-аппаратной архитектуре CUDA, поскольку конкуренты, например, AMD, предлагают сопоставимую аппаратную производительность. Перед Intel стоит очень непростая задача. Ей предстоит обеспечить разработку экосистемного программного обеспечения и «бесшовную» интеграцию своих ускорителей следующего поколения, чтобы Jaguar Shores имел шансы догнать остальную часть рынка. Microsoft выпустила компактную, но высококачественную ИИ-модель Phi-4

13.12.2024 [16:16],

Павел Котов

Компания Microsoft представила Phi-4 — свою новейшую большую языковую модель генеративного искусственного интеллекта. Новинка отличается относительно компактными размерами и высокой производительностью. Она доступна в режиме предварительного просмотра для исследовательских целей.

Источник изображения: BoliviaInteligente / unsplash.com Microsoft Phi-4 работает более качественно по сравнению с предшественником по ряду критериев, в том числе в решении математических задач, уверяет разработчик — отчасти это результат более высокого качества данных для обучения. Phi-4 пока присутствует в очень ограниченном доступе на платформе для разработки Azure AI Foundry — в соответствии с лицензионным соглашением пользоваться ей можно только в исследовательских целях. Малая языковая модель нового поколения имеет 14 млрд параметров — она позиционируется как конкурент таким проектам как GPT-4o mini, Gemini 2.0 Flash и Claude 3.5 Haiku. Эти небольшие модели ИИ работают быстрее, их обслуживание обходится дешевле, а качество их работы в последнее время резко подскочило. Microsoft объясняет успехи Phi-4 тем, что при её обучении использовался созданный человеком высококачественный контент совместно с «синтетическими массивами данных высокого качества», а также тем, что после обучения производилась некоторая доработка модели. Примечательно, что Phi-4 стала первой моделью этой серии, выпущенной после ухода Себастьена Бубека (Sebastien Bubeck). Он занимал пост вице-президента по исследованиям в области искусственного интеллекта в Microsoft и был ключевой фигурой в разработке моделей Phi, а в октябре он ушёл из компании в OpenAI. Meta✴ показала ИИ для метавселенной и создала альтернативу традиционным большим языковым моделям

13.12.2024 [13:40],

Павел Котов

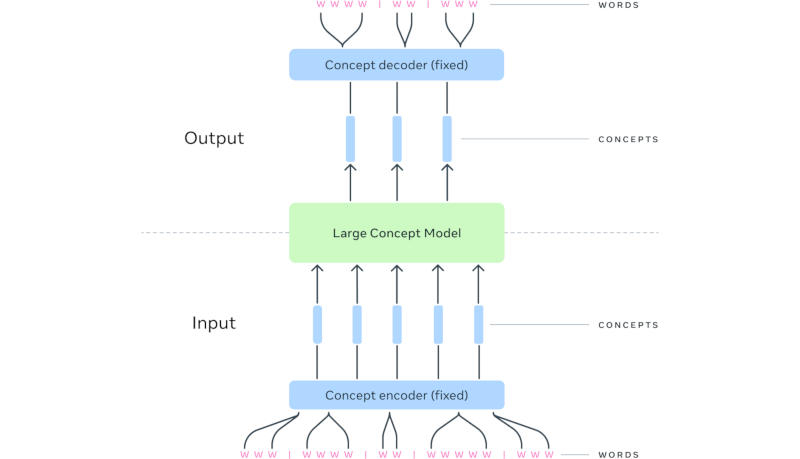

Meta✴✴ доложила о результатах последних исследований в области искусственного интеллекта в рамках проектов FAIR (Fundamental AI Research). Специалисты компании разработали модель ИИ, которая отвечает за правдоподобные движения у виртуальных персонажей; модель, которая оперирует не токенами — языковыми единицами, — а понятиями; и многое другое.

Источник изображения: Google DeepMind / unsplash.com Модель Meta✴✴ Motivo управляет движениями виртуальных человекоподобных персонажей при выполнении сложных задач. Она была обучена с подкреплением на неразмеченном массиве с данными о движениях человеческого тела — эта система сможет использоваться в качестве вспомогательной при проектировании движений и положений тела персонажей. «Meta✴✴ Motivo способна решать широкий спектр задач управления всем телом, в том числе отслеживание движения, принятие целевой позы <..> без какой-либо дополнительной подготовки или планирования», — рассказали в компании. Важным достижением стало создание большой понятийной модели (Large Concept Model или LCM) — альтернативы традиционным большим языковым моделям. Исследователи Meta✴✴ обратили внимание, что современные передовые системы ИИ работают на уровне токенов — языковых единиц, обычно представляющих фрагмент слова, но не демонстрируют явных иерархических рассуждений. В LCM механизм рассуждения отделён от языкового представления — схожим образом человек сначала формирует последовательность понятий, после чего облекает её в словесную форму. Так, при проведении серии презентаций на одну тему у докладчика уже есть сформированная серия понятий, но формулировки в речи могут меняться от одного мероприятия к другому. При формировании ответа за запрос LCM предсказывает последовательность не токенов, а представленных полными предложениями понятий в мультимодальном и многоязычном пространстве. По мере увеличения контекста на вводе архитектура LCM, по мнению разработчиков, представляется более эффективной на вычислительном уровне. На практике эта работа поможет повысить качество работы языковых моделей с любой модальностью, то есть форматом данных, или при выводе ответов на любом языке.

Источник изображения: Meta✴✴ Механизм Meta✴✴ Dynamic Byte Latent Transformer также предлагает альтернативу языковым токенам, но не посредством их расширения до понятий, а, напротив, путём формирования иерархической модели на уровне байтов. Это, по словам разработчиков, повышает эффективность при работе с длинными последовательностями при обучении и запуске моделей. Вспомогательный инструмент Meta✴✴ Explore Theory-of-Mind предназначается для привития навыков социального интеллекта моделям ИИ при их обучении, для оценки эффективности моделей в этих задачах и для тонкой настройки уже обученных систем ИИ. Meta✴✴ Explore Theory-of-Mind не ограничивается заданным диапазоном взаимодействий, а генерирует собственные сценарии. Технология Meta✴✴ Memory Layers at Scale направлена на оптимизацию механизмов фактической памяти у больших языковых моделей. По мере увеличения числа параметров у моделей работа с фактической памятью требует всё больших ресурсов, и новый механизм направлен на их экономию. Проект Meta✴✴ Image Diversity Modeling, который реализуется с привлечением сторонних экспертов, направлен на повышение приоритета генерируемых ИИ изображений, которые более точно соответствуют объектам реального мира; он также способствует повышению безопасности и ответственности разработчиков при создании картинок с помощью ИИ. Модель Meta✴✴ CLIP 1.2 — новый вариант системы, предназначенной для установки связи между текстовыми и визуальными данными. Она используется в том числе и для обучения других моделей ИИ. Инструмент Meta✴✴ Video Seal предназначен для создания водяных знаков на видеороликах, генерируемых при помощи ИИ — эта маркировка незаметна при просмотре видео невооружённым глазом, но может обнаруживаться, чтобы определить происхождение видео. Водяной знак сохраняется при редактировании, включая наложение эффекта размытия, и при кодировании с использованием различных алгоритмов сжатия. Наконец, в Meta✴✴ напомнили о парадигме Flow Matching, которая может использоваться при генерации изображений, видео, звука и даже трёхмерных структуры, в том числе белковых молекул — это решение помогает использовать информацию о движении между различным частями изображения и выступает альтернативой механизму диффузии. ChatGPT обрёл зрение — бот научился на лету понимать видеопоток с камеры смартфона и экрана

13.12.2024 [11:41],

Владимир Мироненко

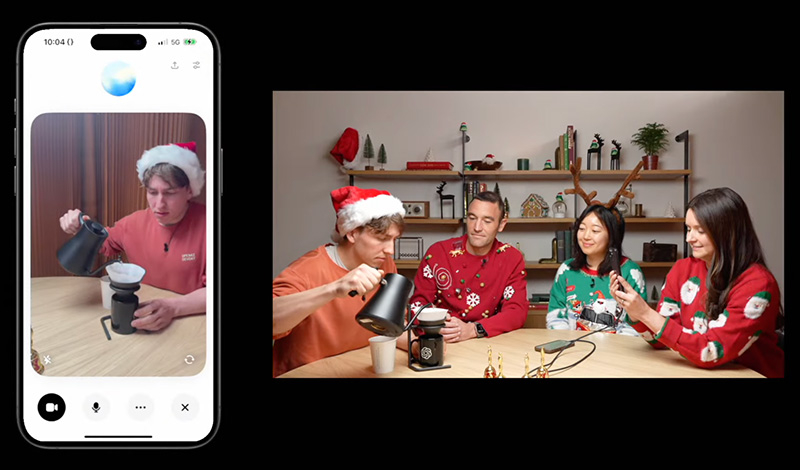

OpenAI объявила о появлении у чат-бота ChatGPT на базе генеративного интеллекта способности обрабатывать видеопоток и говорить с пользователями о том, что он «наблюдает» с помощью камеры смартфона или компьютера, либо что видит на экране устройства. Новая функция доступна в расширенном голосовом режиме (Advanced Voice Mode).

Источник изображения: OpenAI О том, что ChatGPT получит функцию компьютерного зрения, позволяющую ему «видеть» при помощи камеры смартфона пользователя или через трансляцию экрана, компания объявила в мае этого года. Теперь доступ к функции расширенного голосового режима ChatGPT с распознаванием видео получили владельцы платных подписок ChatGPT Plus, Team и Pro. По словам компании, подписчики ChatGPT Enterprise и Edu не получат эту функцию до января, и что пока нет графика по её запуску в ЕС, Швейцарии, Исландии, Норвегии и Лихтенштейне. В недавней демонстрации в программе CNN «60 минут» президент OpenAI Грег Брокман (Greg Brockman) провел тестирование расширенного голосового режима с визуальным распознаванием с участием телеведущего Андерсона Купера (Anderson Cooper) на предмет анатомических навыков чат-бота. Когда Купер рисовал части тела на доске, ChatGPT «понимал», что тот рисует. Вместе с тем ChatGPT в этом режиме допустил ошибку в задаче по геометрии, что говорит о его склонности к галлюцинациям. После анонса в мае компания несколько раз откладывала запуск расширенного голосового режима с визуальным распознаванием. В апреле OpenAI пообещала, что этот режим будет доступен для пользователей «в течение нескольких недель», но спустя несколько месяцев признала, что на это потребуется больше времени, чем планировалось. И когда расширенный голосовой режим запустили для некоторых пользователей в сентябре, у него не было функции компьютерного зрения. Компании Google и Meta✴✴ тоже работают над аналогичными возможностями для своих чат-ботов. На этой неделе Google сделала функцию ИИ для анализа видео в реальном времени Project Astra доступной для группы «доверенных тестировщиков» на платформе Android. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |