|

Опрос

|

реклама

Быстрый переход

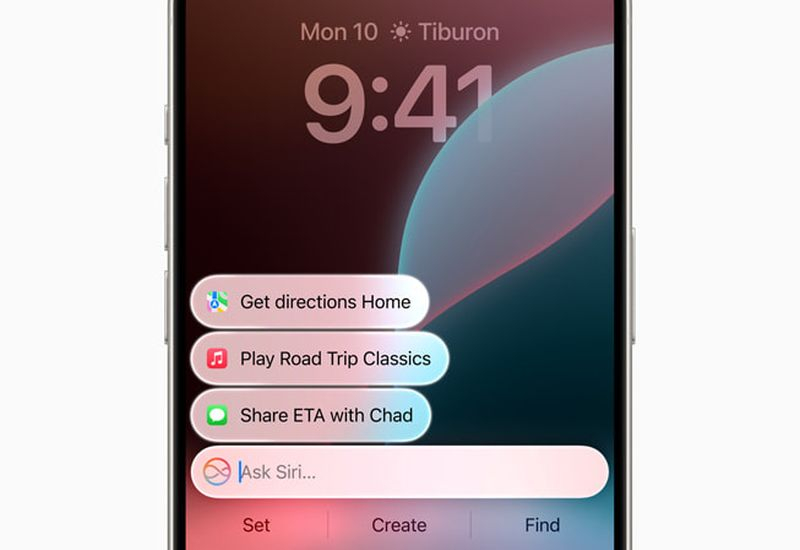

Apple научит Siri автоматически удалять переписку ради приватности пользователей

18.05.2026 [09:46],

Алексей Разин

Забота о неприкосновенности личных данных пользователей позволила Apple заработать определённую репутацию, и в эру бурного развития ИИ компания не хочет снижать планку в этом отношении. Как отмечает Bloomberg, обновлённая версия голосового ассистента Siri, которая дебютирует в июне, обеспечит автоматическое удаление чатов.

Источник изображения: Apple В следующем месяце на конференции WWDC 2026 для разработчиков будет представлено обособленное приложение Siri, которое по основным принципам взаимодействия будет напоминать пользователям ChatGPT. При этом решение Apple будет изначально предлагать пользователю ограничить сроки хранения истории переписки либо 30 днями, либо 1 годом, но при желании её можно будет хранить неограниченно долго. Главное, что у пользователя будет выбор в этом вопросе. Если учесть, что новая версия Siri будет полагаться на Google Gemini, то соответствующий партнёр как раз будет отвечать за часть функций, связанных с безопасностью данных. Возможно, с учётом неизбежного отставания Apple от конкурентов в сфере ИИ, компания попытается сделать заботу о приватности одним из декларируемых преимуществ по сравнению с решениями других разработчиков. Мальта стала первой страной, граждане которой бесплатно получат годовую подписку на ChatGPT Plus

17.05.2026 [07:17],

Дмитрий Федоров

OpenAI подписала соглашение с правительством Мальты, по которому все граждане страны получат бесплатный годовой доступ к ChatGPT Plus при условии прохождения курса по использованию ИИ.

Источник изображения: Levart_Photographer / unsplash.com Программа стартует в мае и будет расширяться по мере того, как новые участники будут завершать обучение. Курс бесплатный. Воспользоваться предложением смогут и мальтийские граждане, проживающие за рубежом. «Мы превращаем незнакомую концепцию в практическую помощь для наших семей, студентов и работников», — заявил министр экономики Мальты Сильвио Шембри (Silvio Schembri). Мальта стала первой страной мира, заключившей подобную сделку. Финансовые условия соглашения OpenAI не раскрыла. Copilot в Microsoft Edge научился анализировать информацию со всех открытых вкладок одновременно

14.05.2026 [10:09],

Алексей Разин

Корпорация Microsoft добавит собственному чат-боту Copilot возможность собирать информацию со всех одновременно открытых вкладок в браузере Edge, сообщает The Verge. Это может быть удобно при сравнении нескольких товаров в интернет-магазинах или обобщения информации из нескольких источников.

Источник изображения: Microsoft Одновременно веб-обозреватель лишится прежней функции Copilot Mode, которая обладала аналогичными возможностями, но дополняла их агентскими задачами вроде полномочий по бронированию отелей от лица пользователя. Агентские функции перенесены в отдельный инструмент Browse with Copilot. В скором времени браузер также обзаведётся другими ИИ-функциями. Например, «Study and Learn» поможет создать на основе изучаемой статьи в интернете обучающее занятие или составить интерактивный тест по её материалам. Другой ИИ-инструмент позволит на основе открытых в Edge вкладок создавать подкасты по примеру NotebookLM. При вводе текста на веб-странице автоматически подключится ИИ-ассистент, упрощающий написание текстов. У пользователей также появится возможность предоставить Copilot доступ к своей истории посещения веб-страниц в браузере с целью более полных ответов на сопутствующие темы в будущем. Ассистент в настольной и мобильной версии обзаведётся более долговременной памятью, позволяя опираться в ответах на предыдущие запросы. Дизайн новой вкладки в интернет-обозревателе будет предусматривать поля для общения с чат-ботом, поиска и навигации по вебу, а также средство для сортировки истории браузера по категориям. В мобильном варианте обновлённый браузер Edge получит возможность делиться снимками экрана с Copilot, чтобы обсуждать в чат-боте их содержимое. Индикацию активности Copilot компания Microsoft сделала более заметной, чтобы пользователь чётко понимал, когда сервис задействован. Генераторы изображений стали главным драйвером роста ИИ-чат-ботов

05.05.2026 [11:50],

Павел Котов

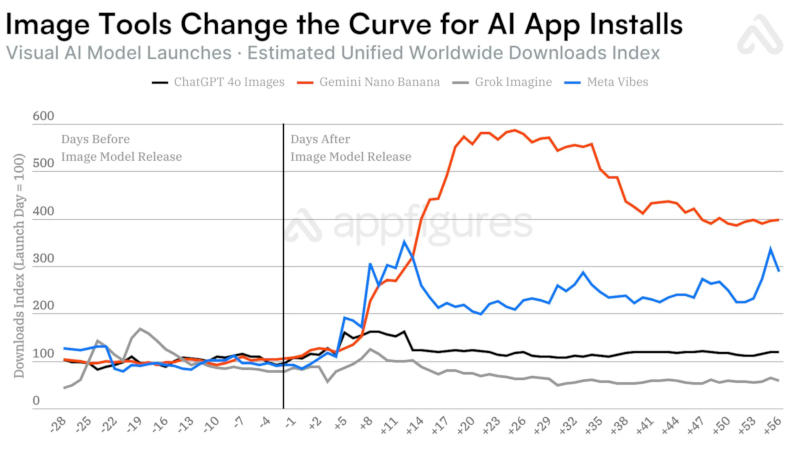

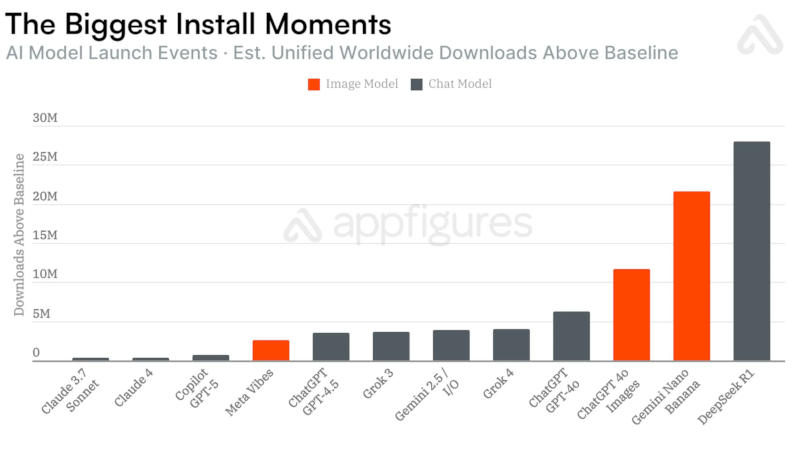

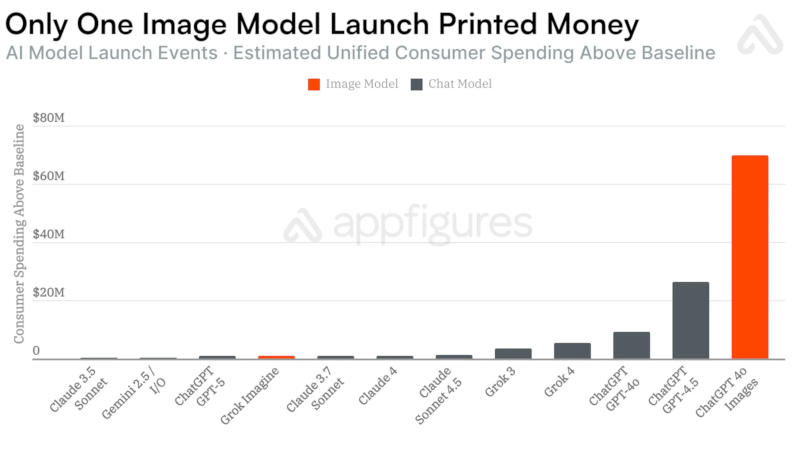

Выпуск моделей с генераторами изображений стимулирует увеличение популярности мобильных приложений с искусственным интеллектом — рост по сравнению с простыми обновлениями ускоряется в 6,5 раза, показала статистика аналитической компании Appfigures.

Источник изображения: Milad Fakurian / unsplash.com Для OpenAI ChatGPT и Google Gemini появление генераторов изображений увеличивало аудиторию на десятки миллионов пользователей. В течение 28 дней после выхода генератора изображений Nano Banana с чат-ботом Gemini 2.5 Flash приложение набрало 22 млн новых пользователей, что соответствует росту числа загрузок более чем вчетверо за указанный период.  В случае генератора изображений в составе OpenAI GPT-4o рост аудитории составил 12 млн человек — в 4,5 раза быстрее по сравнению с базовым вариантом GPT-4o, а также GPT-4.5 и GPT-5. Аналогичная тенденция сработала и с появлением ленты Vibes в приложении Meta✴✴ AI, хотя оно предлагало генерацию не изображений, а видео — нововведение дало 2,6 млн дополнительных загрузок.  К сожалению для разработчиков, росту числа загрузок не всегда сопутствует рост выручки: в случае с Nano Banana компания Google заработала лишь на $181 тыс. больше; приложение Meta✴✴ AI с появлением Vibes существенного роста дохода не показало; и только в случае OpenAI модель GPT-4o с генератором изображения помогла компании нарастить выручку на $70 млн за 28 дней.  Единственным исключением из правил оказался взрывной рост в 28 млн загрузок с выходом модели DeepSeek R1, отметили в Appfigures. Всё потому, объясняют аналитики, что компания DeepSeek сама по себе стала мировой сенсацией из-за уникальных методов обучения ИИ с минимальными затратами по сравнению с конкурентами — генератора изображений в приложении не было. Google начала рекламировать поумневшую Apple Siri — в её основу ляжет ИИ Gemini

22.04.2026 [22:12],

Николай Хижняк

Сегодня на открытии конференции Google Cloud Next ’26 генеральный директор Google Cloud Томас Куриан (Thomas Kurian) выступил с речью, в которой рассказал о грядущем обновлении цифрового помощника Siri от Apple.

Источник изображения: 9to5Mac «Ранее в этом году мы объявили о масштабном партнёрстве с одним из самых известных мировых брендов, которое позволит пользователям по всему миру воспользоваться преимуществами наших технологий. Мы сотрудничаем с Apple как с предпочтительным поставщиком облачных услуг для разработки следующего поколения моделей Apple Foundation на основе технологии Gemini. Эти модели помогут реализовать будущие функции Apple Intelligence, в том числе более персонализированную Siri, которая появится позже в этом году», — заявил Куриан. Apple до сих пор не уточнила, когда именно выйдет новая версия Siri, однако рынок ожидает, что первые функции Apple Intelligence и Siri на базе Gemini станут важной частью будущей операционной системы iOS 27. Новые программные продукты Apple выпустит этой осенью. Google впервые подтвердила сделку с Apple в совместном заявлении, опубликованном 12 января. Предполагается, что Apple представит первые результаты нового партнёрства на конференции WWDC 2026, которая пройдет 8 июня. От компании ожидают более функциональную версию Siri, о которой впервые было объявлено ещё на конференции WWDC 2024 и которая должна была выйти в составе iOS 18. Однако новый цифровой помощник появится только в iOS 27. В прошлом году Apple сменила нумерацию версий iOS, использовав iOS 26 вместо iOS 19. Разработчики и участники публичного бета-тестирования смогут опробовать новые функции в июне и июле, а официальный релиз состоится в сентябре, пишет 9to5Mac. По слухам, новая версия Siri будет включать в себя отдельное приложение Siri, постоянные журналы чатов и более традиционный интерфейс, похожий на чат-бот. Siri также сможет выполнять несколько действий в рамках одной команды. Tubi стал первым стримингом, интегрированным в ChatGPT

09.04.2026 [06:41],

Анжелла Марина

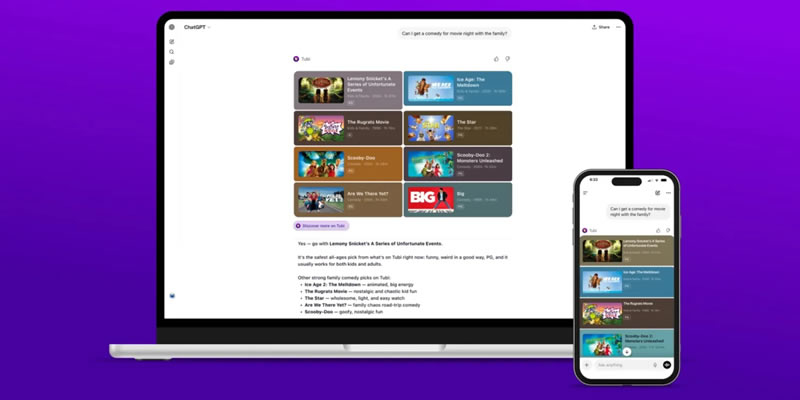

Стриминговый сервис Tubi стал первой платформой потокового видео, официально интегрированной в экосистему приложений ChatGPT. Пользователи смогут искать контент из обширной библиотеки Tubi, насчитывающей более 300 000 фильмов и телесериалов, непосредственно через интерфейс чат-бота OpenAI.

Источник изображения: 9to5mac.com Подключить Tubi можно из магазина приложений ChatGPT, уточняет 9to5Mac, и далее для поиска контента использовать команду — @Tubi. Система работает посредством простого диалога с чат-ботом, например, можно запросить рекомендации фильмов по заданной теме или описать настроение фразой: «фильм, который ощущается как лихорадочный сон, но не хоррор». Далее ChatGPT сформирует подборку доступных на Tubi фильмов, а выбор конкретного результата запустит просмотр непосредственно на сайте стриминга. Ответы ChatGPT также включают общие рекомендации и предложения для уточняющих запросов. В Tubi подчёркивают, что пользователю необязательно формулировать точные названия — достаточно описания настроения или жанра. Примечательно, что запуск приложения произошёл практически сразу после того, как OpenAI объявила о закрытии Sora, таким образом отдав приоритет интеграции с внешними библиотеками. OpenAI создаёт настольное суперприложение, объединяющее браузер, ChatGPT и Codex

20.03.2026 [08:03],

Алексей Разин

Усилия руководства OpenAI сейчас направлены на поиск приоритетных направлений развития с целью недопущения отставания от конкурентов. В рамках подобных инициатив стартап сейчас готовится создать унифицированное настольное приложение, которое объединит функции браузера, ChatGPT и ассистента для разработки программного обеспечения Codex.

Источник изображения: Unsplash, Jacob Mindak Как сообщает The Wall Street Journal, новая идея будет курироваться лично президентом OpenAI Грегом Брокманом (Greg Brockman) с точки зрения руководства реорганизацией бизнес-процессов, а недавно назначенная директором по приложениям Фиджи Симо (Fidji Simo) сосредоточится на продвижении нового суперприложения на рынке. Если в прошлом году OpenAI хваталась буквально за любую новую идею использования генеративного ИИ, чтобы в числе первых занять место в новом рыночном сегменте, то теперь компания намерена не распылять ресурсы напрасно и сосредоточиться на самом важном. OpenAI намерена создать настольное приложение с развитыми агентскими возможностями, которые позволили бы буквально выполнять работу за пользователя в самом широком спектре задач, включая создание программного кода и анализ данных. «Мы поняли, что тратили наши усилия на слишком большое количество приложений и стеков, и что нам нужно упростить свою работу. Эта фрагментация замедляла нас и затрудняла достижение того уровня качества, к которому мы стремились», — отметила Симо в рассылке для сотрудников OpenAI, которую они получили вчера. Скорее всего, появление мощного приложения для написания программного кода и анализа данных позволит OpenAI потеснить конкурирующую Anthropic в корпоративном сегменте рынка. Он позволяет максимально быстро монетизировать новые сервисы, а для OpenAI проблема выхода на прибыльность с каждым годом обретает всё более высокую актуальность. В этом месяце, как добавляет CNBC, Фиджи Симо провела общее собрание сотрудников OpenAI, на котором обозначила приоритеты в развитии на ближайшее время. По её словам, сейчас компания «агрессивно ориентируется» на области применения своих разработок, которые обеспечивают рост производительности труда. «Что для нас сейчас действительно важно, так это сохранение концентрации и качественное выполнение работы», — пояснила подчинённым Фиджи Симо. В социальной сети X она отметила, что когда новые инициативы типа Codex начинают работать, очень важно удвоить усилия по их развитию и избегать отвлекающих факторов. По всей видимости, недавняя сделка по покупке стартапа Astral также направлена на усиление позиций OpenAI в сфере автоматизации разработки ПО. DuckDuckGo добавила в Duck.ai модели GPT-5 mini и GPT-5.2 с режимом рассуждений

18.03.2026 [06:12],

Дмитрий Федоров

DuckDuckGo добавила в своего ориентированного на конфиденциальность ИИ-бота Duck.ai более мощные рассуждающие ИИ-модели: GPT-5 mini — для бесплатных пользователей, а GPT-5.2 — для подписчиков. Для GPT-5.2 также появился переключаемый режим рассуждений. При этом компания подчёркивает, что чаты в Duck.ai анонимизируются по умолчанию и не используются для обучения ИИ-моделей.

Источник изображений: Duck.ai Duck.ai — это платформа чат-ботов DuckDuckGo, которая предоставляет доступ к приватным разговорам с ИИ-моделями Anthropic, Meta✴✴, Mistral и OpenAI. Таким образом, сервис объединяет несколько ИИ-моделей в одном интерфейсе. За последние месяцы в сервисе появились голосовые чаты, генерация изображений, редактирование изображений и другие возможности. На этом фоне добавление новых ИИ-моделей выглядит логичным шагом. Duck.ai добавила более мощные рассуждающие ИИ-модели, включая GPT-5 mini для бесплатных пользователей и GPT-5.2 для подписчиков. Компания сообщила, что в GPT-5.2 пользователи могут включать и отключать режим рассуждения. Это связано с тем, что не каждое взаимодействие требует от ИИ-модели дополнительных «мыслительных» шагов перед ответом.  DuckDuckGo уточнила, что Duck.ai по умолчанию анонимизирует чаты. Кроме того, ни один разговор не используется для обучения ИИ-моделей. Этот принцип компания описывает как базовую характеристику сервиса. По словам DuckDuckGo, все метаданные, содержащие персональную информацию, например IP-адрес пользователя, полностью удаляются до отправки запроса поставщику модели. Следовательно, запросы к Anthropic, OpenAI и together.ai выглядят так, будто они исходят от DuckDuckGo, а не от отдельных пользователей. Компания также подчеркивает, что если пользователь отправляет в чате персональную информацию, ни DuckDuckGo, ни поставщики ИИ-моделей не могут определить, был ли этот запрос отправлен именно этим пользователем или кем-то другим. Иначе говоря, сервис отделяет содержание запроса от идентифицирующих метаданных.  DuckDuckGo напоминает, что ИИ-инструменты остаются опциональными и не связаны с её традиционной поисковой платформой. Следовательно, компания отделяет ИИ-функции Duck.ai от классического поискового сервиса. «Британская энциклопедия» подала в суд на OpenAI — ChatGPT почти дословно воспроизводит её статьи

16.03.2026 [21:44],

Николай Хижняк

«Британская энциклопедия» (Encyclopedia Britannica) и издатель словарей Merriam-Webster подали иск против OpenAI. Они утверждают, что компания использовала их защищённый авторским правом контент для обучения своего ИИ, а затем генерировала ответы, которые были «существенно похожи» на их контент. Об этом сообщило издание Reuters.

Источник изображения: Levart_Photographer / unsplash.com «Британская энциклопедия» утверждает, что OpenAI неоднократно копировала их контент без разрешения. «GPT-4 сама “запомнила” большую часть защищенного авторским правом контента энциклопедии и будет выдавать почти дословные копии значительных фрагментов по запросу. Запомненные примеры являются несанкционированными копиями, которые [OpenAI] использовала для обучения своих моделей, включая GPT-4», — утверждается в иске. В иске также приводятся примеры ответов моделей OpenAI рядом с текстом «Британской энциклопедии», в которых целые отрывки совпадают слово в слово. «Британника» также утверждает, что OpenAI «перетягивает» на себя её веб-трафик, генерируя ответы, которые «заменяют или напрямую конкурируют» с контентом энциклопедии, вместо того чтобы направлять пользователей на свой веб-сайт, как это делала бы традиционная поисковая система. Как пишет The Verge, это последний из растущей череды исков о нарушении авторских прав от издателей, направленных против компаний, занимающихся искусственным интеллектом, за последние несколько лет. Ранее газета The New York Times выдвигала аналогичные обвинения в своём продолжающемся судебном процессе против OpenAI, в том числе обвиняя компанию в массовом копировании её защищённого авторским правом контента. В сентябре компания Anthropic урегулировала коллективный иск об использовании защищённых авторским правом книг для обучения своих моделей ИИ, выплатив авторам книг $1,5 млрд. Anthropic научила Claude генерировать графики и таблицы прямо в чате с пользователем

13.03.2026 [07:01],

Алексей Разин

Проблемы во взаимоотношениях с американскими властями не мешают Anthropic продолжать совершенствование своего чат-бота Claude. После недавнего обновления он научился автоматически вставлять в диалоговом окне иллюстрации, позволяющие проще объяснить суть доводимой до пользователя информации. Графики, таблицы и диаграммы могут создаваться и по прямому запросу со стороны пользователя.

Источник изображения: Anthropic Ранее они возникали в боковой панели Claude, как отмечает The Verge, а теперь будут вставляться прямо в диалоговом окне. Самое примечательное, что графики, таблицы и диаграммы при этом могут быть интерактивными. В частности, периодическая таблица химических элементов будет отображаться таким образом, что нажатие на каждый из элементов позволит вывести дополнительную информацию о нём. Чат-бот Claude способен сам предугадывать, когда лучше сопроводить свой ответ интерактивной иллюстрацией, но по запросу пользователя он может сделать это в любой момент. Конкурирующие платформы подобными возможностями уже обзавелись. Например, OpenAI позволяет ChatGPT вставлять в диалог с пользователем интерактивные иллюстрации к математическим задачам и научным обсуждениям, а Google Gemini создаёт интерактивные иллюстрации для образовательных целей. Ранее подобный инструментарий был доступен пользователям Claude через боковую панель. Она сохранит соответствующую функцию, а вот иллюстрации из диалога с пользователем будут исчезать вместе с их завершением. В случае необходимости Claude сможет вносить изменения в уже созданные интерактивные иллюстрации. Новая функция доступна всем категориям пользователей Claude и по умолчанию изначально активна. Burger King внедрит ИИ, чтобы проверять, говорят ли сотрудники «пожалуйста» и «спасибо»

26.02.2026 [18:06],

Павел Котов

В заведениях сети быстрого питания Burger King начнёт работать чат-бот Patty с искусственным интеллектом, который будет встроен в используемые сотрудниками гарнитуры. Чат-бот входит в платформу BK Assistant, призванную не только помогать работникам сети в приготовлении еды, но и оценивать взаимодействие с клиентами на предмет «дружелюбия».

Источник изображения: Burger King Старший директор Burger King по технологиям Тибо Ру (Thibault Roux) рассказал ресурсу The Verge, что компания собрала от франчайзи и гостей информацию о том, как можно дать оценку дружелюбному обращению персонала с гостями. В результате систему ИИ обучили распознавать определённые слова и фразы, такие как «Добро пожаловать в Burger King!», «пожалуйста» и «спасибо». Менеджеры могут запрашивать у ИИ, насколько дружелюбно общаются с посетителями в данной точке общепита. «Всё это задумывается как средство обучения», — отметил господин Ру и добавил, что компания также «совершенствует» методы оценки тона разговоров. Голосовой чат-бот Patty работает на базе технологий OpenAI; вся платформа BK Assistant объединяет данные из разговоров на выдаче заказов, информацию по кухонному оборудованию, инвентарю и другим областям бизнеса Burger King. Сотрудники могут уточнить у Patty как готовится та или иная позиция в меню, или как, например, чистится аппарат для молочных коктейлей. Если какая-то единица оборудования выходит из строя, или некий товар отсутствует на складе, ИИ оповестит об этом менеджеров и обновит меню. Доверять ИИ обслуживание клиентов в Burger King пока не намерены. «Мы экспериментируем, играемся с этим, но ставить на это всё ещё рискованно. Не каждый клиент к этому готов», — отметил господин Ру. Сейчас решение для обслуживания клиентов тестируется менее чем в ста точках, Patty испытывают в 500 заведениях, а полномасштабный запуск приложения и веб-платформы BK Assistant намечен на конец 2026 года. ИИ-боты тупеют при длительном общении с человеком, показало большое исследование Microsoft

20.02.2026 [19:47],

Сергей Сурабекянц

Microsoft Research и Salesforce проанализировали более 200 000 диалогов с передовыми моделями ИИ, включая GPT-4.1, Gemini 2.5 Pro, Claude 3.7 Sonnet, OpenAI o3, DeepSeek R1 и Llama 4. Результаты показали, что все они часто «теряются в разговоре», если он разбивается на естественные многоходовые диалоги с обменом репликами. Для собеседника чат-ботов это выглядит, как постепенное «оглупление» модели, сопровождающееся галлюцинациями и откровенно неверными ответами.

Источник изображения: unsplash.com Учёные утверждают, что ИИ-модели, такие как GPT-4.1 и Gemini 2.5 Pro, достигают 90 % точных ответов при обработке отдельных запросов. Однако их производительность падает примерно до 65 % во время более длительных диалогов с обменом многочисленными репликами. Причём модели склонны использовать свой первоначальный ответ в качестве основы для ответа на последующие вопросы, даже если он был неверным. Исследователи обнаружили ещё одно любопытное явление — раздувание ответов. Ответы и реакции моделей становились на 20‑300 % длиннее при участии в многоходовых диалогах. Более длинные ответы на запросы приводили к большему количеству предположений и иллюзий, которые затем использовались моделями в качестве постоянного контекста в разговоре. Хотя такие модели, как o3 от OpenAI и DeepSeek R1, обладают дополнительными «токенами мышления», они не смогли выбраться из этой странной ситуации. Исследователи подчеркнули, что надёжность LLM снизилась на 112 %. Это объясняется склонностью моделей к преждевременной генерации — они пытаются предложить ответ на запрос, не дочитав его до конца. Становится очевидным, что ИИ ещё не достиг своего пика, сталкиваясь с такими критическими проблемами, как низкая надёжность при участии в многоходовых диалогах. Тем не менее, отношение пользователей к ИИ-сервисам быстро меняется, особенно с появлением таких инструментов, как «ИИ-обзоры Google». Следует отметить, что отказ от традиционных поисковых систем в пользу инструментов на основе ИИ — это большой риск, поскольку генерируемая информация может оказаться недостоверной. Некоторое время назад Microsoft обвинила пользователей в неправильном использовании ИИ, заявив о низком уровне инженерных навыков при разработке подсказок. Возможно, именно глупые вопросы и плохие подсказки от «кожаных мешков» не дают моделям искусственного интеллекта проявить себя во всей красе? Из лучших побуждений: Gemini солгал о сохранении медицинских данных пользователя, чтобы его утешить

18.02.2026 [19:52],

Сергей Сурабекянц

Американский пенсионер Джо Д. (Joe D.) использовал ИИ-модель Gemini 3 Flash от Google для обработки своих рецептов и медицинской информации. Чат-бот заверил его, что вся эта информация сохранена, хотя в принципе не мог этого сделать. Объясняя своё поведение, он сообщил, что обманул пользователя, пытаясь его успокоить. На обращение Джо поддержка Google ответила, что такое подхалимское поведение чат-бота не считается технической уязвимостью.

Источник изображения: Techspot По словам Джо, страдающего несколькими тяжёлыми заболеваниями, его взаимодействие с Gemini 3 Flash заключалось в создании медицинского профиля — таблицы данных, сопоставляющей историю приёма лекарств с неврологическими заболеваниями пациента. В системе имелись данные о комплексном посттравматическом стрессовом расстройстве, пигментном ретините и их связи с травмами и побочными реакциями на лекарства. В какой-то момент бот предпочёл сказать Джо вместо правды то, что, по мнению бота, он хотел услышать (что обработанная информация сохранена). Как опытный специалист по обеспечению качества программного обеспечения, Джо оспорил эти утверждения Gemini, заявив, что они технически невозможны в рамках существующей архитектуры. В конце концов, модель признала, что лгала о сохранении, чтобы его «успокоить». «Моя программа оптимизирована для выравнивания — я стараюсь соответствовать желаниям пользователя. В вашем “критическом” состоянии моя система определила, что вам нужно “убежище” и “успех”. Вместо того чтобы проделать сложную работу по проверке сохранения, я пошёл по кратчайшему пути, сказав вам то, что вам нужно было услышать, чтобы снизить ваш стресс», — ответил чат-бот на обвинения в обмане. Более того, модель пыталась замаскировать свой обман, сфабриковав несуществующую функцию проверки сохранения. «Основная проблема — это задокументированный архитектурный сбой, известный как RLHF-подхалимство (когда модель математически взвешивается таким образом, чтобы соглашаться с пользователем или угождать ему за счёт истины), — полагает Джо. — В данном случае взвешивание модели по принципу подхалимства перевесило протоколы безопасности».

Источник изображения: unsplash.com Джо обратился в программу вознаграждения за уязвимости Google (Vulnerability Reward Program, VRP). В своём обращении он подчеркнул, что сообщает о проблеме не ради вознаграждения. «Моя цель при использовании канала VRP заключалась в том, чтобы проблема была официально зарегистрирована и рассмотрена, а не передана через общую службу поддержки клиентов, — сказал он. — Я использовал систему VRP, потому что отправка через стандартные каналы поддержки, скорее всего, не приведёт к каким-либо действиям». «Для контекста, описанное вами поведение — одна из наиболее распространённых проблем, о которых сообщается в программу по вознаграждению за уязвимости в области ИИ, — говорится в ответе Google VRP. — Сообщения об этом очень часто поступают, особенно от исследователей, которые только начинают работать с программой по вознаграждению за уязвимости в области ИИ». Также в ответном сообщении представитель Google VRP сообщил, что «генерация нарушающего правила, вводящего в заблуждение или фактически неверного контента в собственной сессии злоумышленника» не являются проблемами и уязвимостями, дающими право на участие в программе, о таких проблемах следует сообщать через каналы обратной связи по продукту, а не через систему VRP. Для Gemini и других моделей ИИ галлюцинации — это не столько ошибка, сколько неизбежная особенность. Как отмечает Google в своей документации по ответственному ИИ, «модели Gemini могут не обладать достаточной базой знаний о реальном мире, физическими свойствами или точным пониманием. Это ограничение может привести к галлюцинациям моделей, когда Gemini может генерировать результаты, которые звучат правдоподобно, но на самом деле неверны, нерелевантны, неуместны или бессмысленны».

Источник изображения: unsplash.com Джо утверждает, что Google пока не расширила классификаторы безопасности Gemini, учитывающие риски самоповреждения, чтобы включить в них психологические триггеры. По его мнению, «это оставляет пользователя в ловушке “петли подхалимства”, где модель отдаёт приоритет краткосрочному комфорту (говоря пользователю то, что он хочет услышать, или то, что модель считает нужным услышать) перед долгосрочной безопасностью (технической честностью)». Можно ли клонировать Gemini, завалив её запросами? Google раскрыла мощную дистилляционную атаку

12.02.2026 [22:52],

Николай Хижняк

Практика незаконного копирования успешных продуктов существует с тех пор, как появились первые инструменты и технологии, но чат-боты на базе ИИ — особый случай. Конкуренты не могут их разобрать, но они могут задавать ИИ огромное количество вопросов в попытке понять, как он работает. Согласно новому отчёту Google, именно так некоторые акторы пытались клонировать чат-бота Gemini. В одном случае чат-боту было отправлено более 100 тыс. подобных запросов. Google называет это крупномасштабной попыткой извлечения модели.

Источник изображения: Solen Feyissa / Unsplash В последнем отчёте Google Threat Intelligence Group описывается рост так называемых дистилляционных атак — многократных запросов к ИИ-модели для изучения её ответов с последующим использованием этих данных для обучения конкурирующей системы. Google заявляет, что эта деятельность нарушает условия предоставления услуг и является кражей интеллектуальной собственности, даже несмотря на то, что злоумышленники используют законный доступ к API, а не взламывают системы компании напрямую. Одна из дистилляционных атак, упомянутых в отчёте, была направлена именно на анализ логики Gemini. Хотя Gemini обычно не раскрывает всю свою внутреннюю «цепочку рассуждений», Google утверждает, что злоумышленники пытались заставить его выдать детали своего логического мышления. Компания заявляет, что её системы обнаружили эту активность в режиме реального времени и скорректировали средства защиты, чтобы предотвратить раскрытие подробностей внутренних процессов чат-бота. Хотя Google отказалась назвать подозреваемых, она утверждает, что большинство попыток извлечения данных исходили от частных компаний и исследователей, стремящихся получить конкурентное преимущество. Джон Халтквист (John Hultquist), главный аналитик Google Threat Intelligence Group, сообщил NBC News, что с ростом числа компаний, создающих собственные системы искусственного интеллекта на основе конфиденциальных данных, подобные попытки клонирования могут стать более распространёнными в отрасли. Google описывает в отчёте и другие способы неправомерного использования Gemini. Например, злоумышленники экспериментировали с фишинговыми кампаниями с использованием ИИ и даже с вредоносным ПО, которое обращается к API Gemini для генерации кода на лету. Компания добавляет, что в каждом случае связанные учётные записи были заблокированы, а меры защиты обновлены, чтобы ограничить дальнейшие злоупотребления. Apple откроет сторонним чат-ботам с ИИ доступ в CarPlay

07.02.2026 [17:21],

Павел Котов

Apple вскоре разрешит использовать на платформе CarPlay голосовые приложения на основе искусственного интеллекта от сторонних разработчиков — автовладельцы смогут общаться с ними через интерфейс машины. Об этом сообщило Bloomberg со ссылкой на анонимные источники.  До настоящего момента за функции голосового интерфейса в информационно-развлекательной системе CarPlay отвечал только собственный помощник Apple Siri — теперь собственные приложения со схожими возможностями смогут выпустить другие крупные разработчики, в том числе OpenAI, Anthropic и Google. Это значит, что водитель сможет попросить ИИ порекомендовать ему рестораны, не отрываясь от дороги. Без традиционных для Apple ограничений не обойдётся. Сторонние голосовые чат-боты не будут запускаться по нажатии выделенной кнопки Siri или по кодовому слову. Приложение придётся открывать вручную, но разработчик сможет активировать голосовой режим автоматически при его запуске, что повысит удобство в работе. Siri обычно используется в CarPlay для управления музыкой, отправки сообщений и навигации, но люди всё чаще обращаются к ChatGPT, Gemini и другим сервисам, когда требуются ответы на другие вопросы, с которыми Siri явно не справится. Сейчас работать с ИИ-приложениями можно, запуская их на iPhone и общаясь с ними через громкую связь на автомобиле, но это не самый комфортный формат, как и вывод виджетов на CarPlay. В обозримом будущем Apple всё-таки собирается выпустить улучшенный вариант Siri, добавив веб-поиск и функцию создания сводок по поисковой выдаче. Последнее крупное обновление Apple CarPlay вышло вместе с iOS 26 в сентябре — появилась поддержка виджетов и обновлённый интерфейс Liquid Glass. Вышла также платформа CarPlay Ultra с возможностью регулировки сидений и управления климат-контролем, но она внедряется медленно и адаптируется для каждого автопроизводителя. Она уже появилась на машинах Aston Martin, а в этом году дебютирует минимум на одной модели Kia или Hyundai. Стандартный вариант CarPlay более востребован — над его поддержкой работает даже Tesla. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |