|

Опрос

|

реклама

Быстрый переход

Meta✴ поставила на паузу проект разработки ИИ-чипа, который должна была выпускать Samsung

06.06.2026 [08:33],

Алексей Разин

Крупнейшие американские компании технологического сектора давно занимаются разработкой собственных процессоров и ускорителей, которые помогут им оптимизировать расходы на содержание вычислительных мощностей и снизить зависимость от поставщиков готовых решений. Сотрудничество Meta✴✴ и Samsung в этой сфере поставлено на паузу.

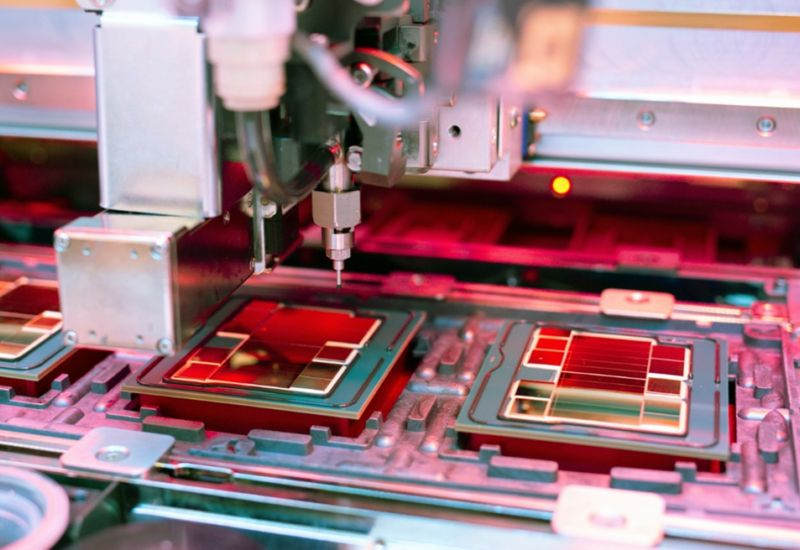

Источник изображения: Samsung Electronics Об этом сообщил ресурс SamMobile со ссылкой на южнокорейские СМИ. Как стало известно, проект по совместной разработке ИИ-чипа Meta✴✴ силами подразделения Samsung LSI был поставлен на паузу по запросу заказчика. Как далеко эта инициатива успела продвинуться до приостановки разработки чипа, сказать сложно. Для Samsung подобное сотрудничество имеет огромное значение, ведь компания сейчас хоть и неплохо зарабатывает на поставках микросхем памяти, многие годы пытается диверсифицировать бизнес в сторону контрактного производства логических компонентов. В случае же с проектом Meta✴✴ речь идёт и об участии специалистов Samsung в разработке чипа, что вызывает дополнительную заинтересованность южнокорейского партнёра. Это не первый случай заморозки разработки ИИ-чипов, в которой принимала участие Samsung. Сообщается, что проект по созданию нейронного процессора (NPU) для OpenAI успел неплохо продвинуться на начальной стадии, но из-за стратегических разногласий с Samsung якобы существенно замедлился к настоящему времени. Несомненно, проблемы сразу с двумя заказчиками не сулят ничего хорошего планам Samsung по превращению в надёжного партнёра по разработке ИИ-чипов и их дальнейшему контрактному производству. Baidu выведет на биржу своего разработчика ИИ-чипов стоимостью до $64 млрд

04.06.2026 [12:59],

Алексей Разин

В самом начале текущего года стало известно о намерениях Baidu вывести на китайские фондовые площадки акции собственного подразделения Kunlunxin Technology, которое специализируется на разработке ИИ-чипов. Была даже подана соответствующая официальная заявка. От этих планов Baidu не отказывается и сейчас, надеясь вывести Kunlunxin на биржу до конца текущего года.

Источник изображения: Baidu Это становится понятно, как отмечает The Wall Street Journal, со слов финансового директора Baidu Генри Хэ (Henry He), который дал интервью в минувшую среду. До конца текущего года Baidu собирается выделить в самостоятельную компанию Kunlunxin, после чего её акции поступят в продажу на китайских торговых площадках в Гонконге и Шанхае. Сторонние аналитики ожидают, что IPO состоится в третьем квартале текущего года. Ещё в прошлом месяце началась техническая подготовка к этому двойному IPO, которое подразумевает размещение акций сразу в Шанхае и Гонконге. По оценкам аналитиков Morningstar, в ходе этого мероприятия Kunlunxin Technology может быть оценена в сумму от $51 до $63,8 млрд в пересчёте по текущему курсу. Материнская Baidu ожидает выраженного роста своей выручки на протяжении ближайших кварталов, поскольку этому будет способствовать высокий спрос на решения в сфере искусственного интеллекта. Broadcom потеряла $300 млрд капитализации, разочаровав инвесторов умеренным прогнозом по выручке от ИИ-чипов

04.06.2026 [07:22],

Алексей Разин

Бум ИИ сформировал у инвесторов завышенные ожидания в сфере темпов роста выручки основных участников рынка, поэтому излишний консерватизм некоторых из них способен вызывать резкое падение котировок, как случилось с Broadcom. Компания не смогла дать те прогнозы по росту выручки, на которые рассчитывали аналитики, в результате её акции просели в цене на 15 %.

Источник изображения: Broadcom Этого было достаточно, чтобы сократить капитализацию Broadcom сразу на $300 млрд. В конце июля в календаре Broadcom завершится третий фискальный квартал, компания рассчитывает за период выручить на направлении ИИ-чипов около $16 млрд, но инвесторы рассчитывали в среднем на $17,2 млрд. По итогам всего фискального года, который завершится в октябре, Broadcom рассчитывает выручить в этой сфере $56 млрд. Инвесторы претендовали на $57,6 млрд, поэтому и этот прогноз стал для них разочарованием. В следующем фискальном году ИИ-выручка Broadcom должна превысить $100 млрд, но такой прогноз уже звучал ранее. Что характерно, в ходе пяти предшествующих публикации квартальной отчётности торговых сессий акции Broadcom в общей сложности подорожали на $270 млрд, но этот прогресс был нивелирован реакцией рынка на её прогнозы. Совокупная выручка Broadcom в текущем квартале достигнет $29,4 млрд, что выше среднего значения по консенсусу на уровне $28,6 млрд. В прошлом квартале выручка компании выросла на 48 % до $22,2 млрд, слегка превысив консенсус-прогноз. Удельный доход на одну акцию тоже оказался выше ожиданий: $2,44 против $2,39. При этом в прошлом квартале направление ИИ-чипов принесло Broadcom $10,8 млрд выручки против ожидаемых $10,7 млрд. Получается, что прогнозные значения повлияли на настроения инвесторов сильнее, чем фактическая отчётность Broadcom. Anthropic собирается закупить у Google ИИ-чипы, которые помогает разрабатывать Broadcom — в количестве, достаточном для ввода в строй вычислительных мощностей в размере более 20 ГВт до 2028 года включительно. Для этих целей финансовые организации даже собирают заёмные средства на сумму $36 млрд для Anthropic. Кроме того, Broadcom будет участвовать в выпуске чипов для OpenAI с текущего года. До 2029 года в строй будет введено 10 ГВт вычислительных мощностей, из которых в 2027 году будет введено 1,3 ГВт. С компанией Meta✴✴ этого разработчика чипов связывают обязательства по введению в строй 3 ГВт вычислительных мощностей к концу 2028 года. Первые поставки начнутся во второй половине 2027 года, они будут охватывать как ИИ-ускорители, так и сетевые решения. Всего Broadcom снабжает кастомными чипами шесть крупных заказчиков, среди которых фигурируют Google, Meta✴✴, OpenAI и Anthropic. Если падение акций Broadcom продолжится после открытия торгов в четверг, то капитализация компании может сократиться на $349 млрд, сделав этот инцидент третьим по величине падения за всю историю наблюдения за американским фондовым рынком. ИИ пожирает всю память: аналитики прогнозируют подорожание DRAM ещё на 60 %

02.06.2026 [22:17],

Николай Хижняк

Из-за продолжающегося дефицита памяти на фоне бума ИИ цены на DRAM в первом календарном квартале выросли практически вдвое. Не исключено, что в текущем квартале они снова увеличатся более чем на 50 %, сообщает издание The Register со ссылкой на прогноз аналитиков TrendForce.

Источник изображения: Samsung Electronics По данным экспертов, отслеживающих ситуацию на рынке, в первом квартале контрактные цены на обычную DRAM выросли на 98 %. Это хорошо для производителей микросхем памяти, чьи доходы за тот же период увеличились на 81 % и составили $97 млрд, но не очень хорошо для покупателей, пишет The Register. По прогнозам TrendForce, ситуация в ближайшее время не улучшится, поскольку запасы DRAM у поставщиков остаются крайне низкими, а все дополнительные мощности направляются в первую очередь на производство высокопроизводительных модулей RDIMM для серверов с искусственным интеллектом. Этот фактор ограничивает доступность памяти для производителей потребительских ПК и смартфонов. На этом фоне ожидается, что рост поставок обычной DRAM по-прежнему будет сдерживаться. По прогнозам TrendForce, в этом квартале контрактные цены на память вырастут ещё на 58–63 %. Согласно TrendForce, гиперскейлеры стали более сговорчивыми в вопросе повышения цен со стороны производителей памяти, что вынудило других клиентов последовать их примеру, чтобы обеспечить себе доступ к поставкам. В результате в проигрыше оказался обычный потребитель. Аналитики считают, что давление на цены снизится только в том случае, если будут расширены производственные мощности по выпуску чипов для потребительских продуктов или снизится спрос на высокомаржинальные чипы памяти с высокой пропускной способностью, которые используются в ИИ-серверах. Однако, как отмечает TrendForce, три крупнейших поставщика памяти — Samsung, SK hynix и Micron — по-прежнему отдают приоритет производству и поставкам высокопроизводительной памяти HBM. На этой неделе председатель правления SK hynix Чхве Тэ Вон (Chey Tae-won) заявил журналистам в Тайбэе, что компания намерена удвоить объём производства кремниевых пластин для чипов памяти, но делать это будет постепенно в течение следующих пяти лет. Таким образом, дефицит может сохраняться до 2030 года, предупредил он. Однако другие аналитики считают, что ситуация может стабилизироваться уже к концу следующего года. В прошлом месяце компания Micron сообщила, что начала производство DRAM на своём заводе в Манассасе, штат Вирджиния, США. Компания также ожидает, что её первый завод в Айдахо начнёт выпуск кремниевых пластин «в середине 2027 календарного года». По прогнозам Micron, новые производственные мощности будут полностью введены в эксплуатацию в 2027 и 2028 годах. В конце мая профсоюз сотрудников Samsung Electronics объявил о приостановке масштабной забастовки после того, как компания согласилась создать фонд, который будет распределять прибыль между работниками. Забастовка могла привести к перебоям в производстве памяти, что усугубило бы глобальный дефицит. Стремясь заполнить ниши, образовавшиеся из-за перехода поставщиков первого эшелона на передовые технологические процессы, тайваньские компании Nanya, Winbond и PSMC продолжают выпускать DRAM на зрелых технологических узлах, сообщает TrendForce. Ожидается, что PSMC будет особенно активно наращивать производственные мощности. «Это победа всей экосистемы»: Qualcomm обрадовалась приходу Nvidia на рынок процессоров для ПК

01.06.2026 [18:32],

Анжелла Марина

Старший вице-президент вычислительных систем Qualcomm Кедар Кондап (Kedar Kondap) прокомментировал выход Nvidia на рынок Windows on Arm с новыми чипами RTX Spark на презентации в рамках Computex 2026. В Qualcomm назвали появление конкурента подтверждением роста экосистемы и позитивным сигналом для всей индустрии.

Источник изображения: Qualcomm Отвечая на вопрос о том, что Qualcomm думает о выходе Nvidia в сегмент ПК, Кондап поприветствовал нового игрока и заявил, что компания испытывает воодушевление. Он подчеркнул, что многолетние инвестиции Qualcomm в развитие периферии и программного обеспечения, а также поддержку более 2500 игр на Snapdragon теперь получили рыночное подтверждение. По мнению Кондапа, появление Nvidia создаёт «попутный ветер для всей экосистемы Arm на Windows».

Источник изображения: Nvidia Qualcomm рассматривает анонс RTX Spark как благо для всей отрасли, хотя компания не упускает возможности напомнить о своей ведущей роли на сегодняшний день в экосистеме Windows на архитектуре Arm. При этом наибольшие опасения сложившаяся ситуация должна вызывать у производителей x86-чипов, поскольку платформа Arm перестала быть второстепенной. В частности, благодаря Snapdragon сейчас выпускаются сотни устройств с Arm SoC, а появление Nvidia создаёт дополнительные преимущества для всей экосистемы Windows on Arm. Журналисты также уточнили позицию Qualcomm касательно заявлений Nvidia об абсолютной совместимости новых чипов с приложениями для Windows. Механизм решения этой проблемы остаётся неизвестным, поскольку текущие устройства на базе Snapdragon вынуждены использовать слой эмуляции Prism из состава Windows 11, который периодически выдаёт ошибки при запуске старых программ и современных игр. Однако Кондап напомнил о многолетнем партнёрстве с Microsoft, включая выпуск первых ПК класса Copilot+ и поддержку NPU в операционной системе, выразив уверенность в прочности этого сотрудничества. «Наше партнёрство с Microsoft продолжается уже несколько лет. Вместе мы представили первые ПК класса Copilot+. Мы запустили первые платформы, на которых ОС Windows обеспечивала поддержку NPU, а также механизмов распределённых вычислений, задействующих различные ядра процессора...», — отметил он. В Qualcomm добавили, что новые чипы Nvidia могут стимулировать разработчиков активнее работать с Arm-архитектурой, что в долгосрочной перспективе выгодно и самой Qualcomm. Пока же компания намерена продолжать обслуживать рынок Windows устройствами на Snapdragon в ценовом диапазоне от $300 до $1699 за флагманскую модель Snapdragon X2 Elite Extreme. Ожидается, что чипы Nvidia будут нацелены на премиальный сегмент с ценами значительно выше текущего верхнего порога для Snapdragon. Anthropic, OpenAI и SpaceX первыми внедрят серверные процессоры Nvidia Vera

01.06.2026 [12:42],

Алексей Разин

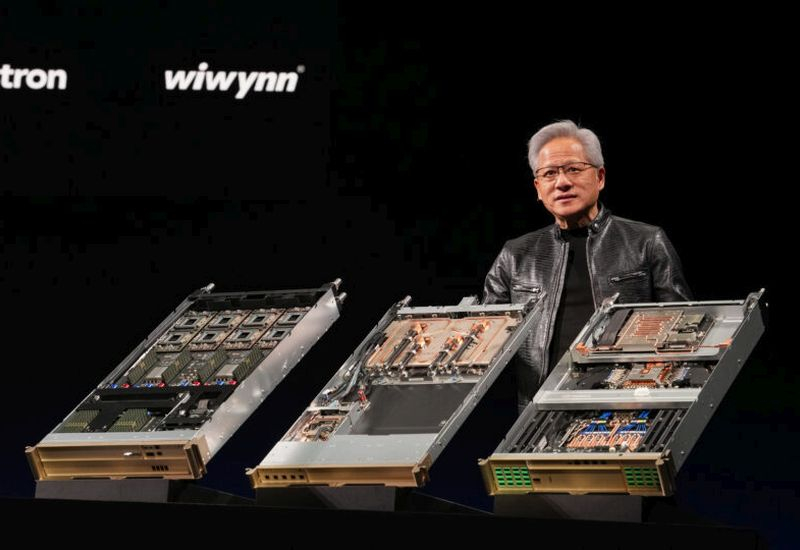

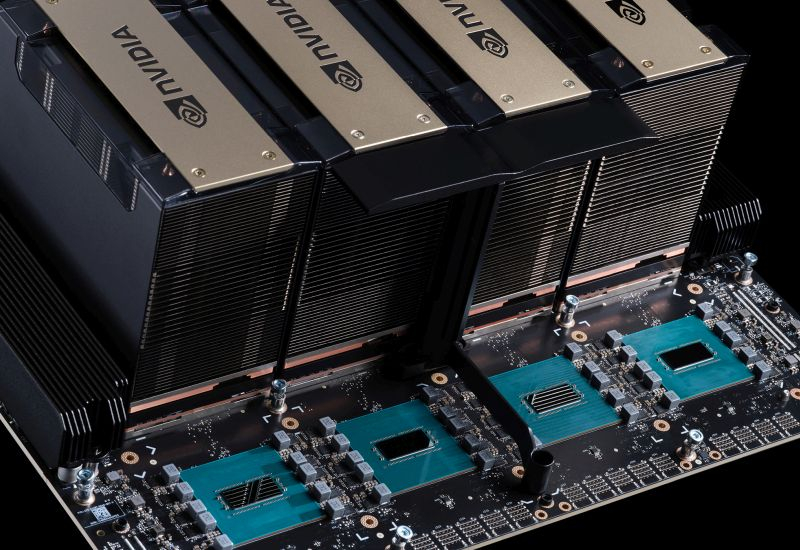

В третьем квартале этого года, как дал понять на Computex 2026 глава и основатель Nvidia Дженсен Хуанг (Jensen Huang), центральные процессоры Vera серверного назначения начнут массово производиться. Ими уже активно интересуются крупные компании ИИ-сегмента типа OpenAI, Anthropic и SpaceX, как добавил Хуанг, они будут первыми использовать их в своих ЦОД.

Источник изображения: Nvidia До сих пор развитие вычислительной инфраструктуры ИИ во многом полагалось на GPU компании Nvidia, но по мере перехода к инференсу они начали отходить на второй план. Центральные процессоры оказались более востребованными, и в этом сегменте Nvidia не собирается уступать рынок Intel и AMD, также предлагая собственные серверные CPU, которые в текущем поколении известны под наименованием Vera. В прошлом месяце Дженсен Хуанг отметил, что доля решений Nvidia в инфраструктуре Amazon (AWS) продолжает расти даже в условиях, когда этот клиент стремится всё активнее использовать компоненты собственной разработки типа тех же чипов семейства Graviton. Именно Nvidia способна предлагать клиентам комплексные готовые решения для ЦОД самого разного назначения. Даже начинающие разработчики с помощью фирменной инфраструктуры Nvidia очень быстро могут развивать бизнес, как убеждён глава компании. По его словам, процессоры Vera в 1,8 раза быстрее в некоторых ИИ-задачах по сравнению с процессорами Intel, использующими x86-совместимую архитектуру. Nvidia также предлагает клиентам продвинутое ПО для управления ЦОД и мониторинга основными показателями, включая уровень энергопотребления. Только за счёт более эффективного управления клиенты Nvidia могут на 40 % увеличить количество используемых ускорителей этой марки, не выходя за рамки общего целевого уровня энергопотребления. В рамках сотрудничества с китайской Unitree компания Nvidia также предложила разработчикам человекоподобных роботов некие эталонные наборы и платформы для быстрого создания таких роботов. По крайней мере, управляющие чипы и прилагаемое к ним ПО будут согласованы и готовы к работе друг с другом, а ещё клиентам будут поставляться уже готовые кисти рук для таких роботов, которые не потребуется обучать базовым манипуляциям с нуля. Intel раскрыла детали серверного ИИ-ускорителя Crescent Island — до 350 Вт и 480 Гбайт LPDDR5X

01.06.2026 [10:59],

Алексей Разин

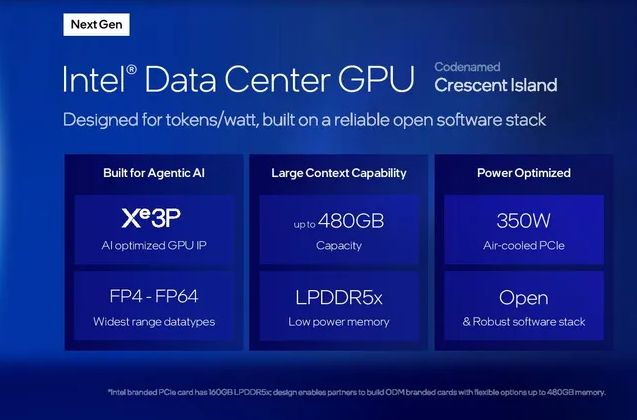

Казалось бы, у корпорации Intel в наличии не было приличных ИИ-ускорителей уже много лет, но смещение спроса на задачи инференса открыло перед компанией новые возможности. Ускоритель Crescent Island будет использовать память типа LPDDR5X в приличном объёме до 480 Гбайт, стараясь лучше себя раскрыть именно с этой стороны.

Источник изображений: Intel, Tom's Hardware Решение с незамысловатым обозначением Xe3P, по мнению Intel, изначально ориентируется на сферу агентских вычислений в ИИ. При уровне энергопотребления не более 350 Вт оно способно обеспечить поддержку до 480 Гбайт памяти типа LPDDR5X, хотя в эталонном исполнении соответствующий ускоритель ограничится втрое меньшим объёмом — 160 Гбайт. Скорее всего, для достижения максимальной ёмкости памяти понадобятся модули памяти LPDDR5X объёмом по 24 Гбайт. Совокупная пропускная способность достигнет 684 Гбайт/с.  Вычисления могут осуществляться с разной точностью, от FP4 до FP64. Уровень быстродействия Crescent Island пока не раскрывается, официальный анонс этого ускорителя должен состояться во второй половине текущего года. Подобное компоновочное решение при работе с ИИ-агентами имеет полное право на жизнь, поскольку в непосредственной близости от GPU будут располагаться относительно большие объёмы данных. Память типа GDDR или HBM в этом случае при сохранении того же объёма не только обошлась бы существенно дороже, но и не могла бы разместиться рядом с GPU в силу технических ограничений. В одной стойке наверняка смогут расположиться до восьми таких ускорителей с совокупным объёмом памяти 3,8 Тбайт. Некоторым разочарованием может стать лишь необходимость полагаться на специфическое ПО в виде стека oneAPI для работы с Crescent Island, но Intel обещает, что проблем с ним не возникнет. До 20 ядер и графика уровня RTX 5070: раскрыты характеристики Arm-процессоров Nvidia N1X и N1

31.05.2026 [16:33],

Владимир Фетисов

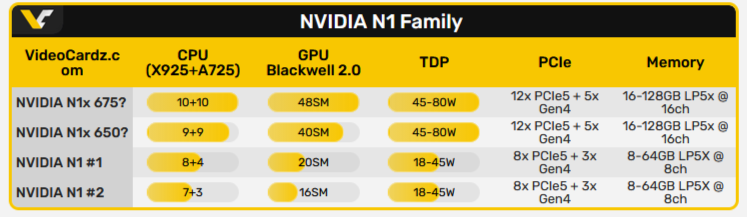

Ожидается, что Nvidia представит Arm-процессоры семейства N1 для ноутбуков под управлением Windows в рамках предстоящей выставки Computex 2026. В преддверии этого события в интернете стараниями VideoCardz появились полные характеристики этих всех чипов семейства.

Источник изображений: videocardz.com По данным источника, конфигурация флагманского процессора N1X совпадает с параметрами чипа GB10, который используется в мини-ПК DGX Spark. Чип имеет 10 ядер Cortex-X925 и 10 ядер Cortex-A725, а также встроенную графику Nvidia Blackwell с 6144 ядрами CUDA, что соответствует количеству блоков у видеокарты GeForce RTX 5070. Урезанная версия чипа получила по девять ядер Cortex-X925 и Cortex-A725, а также встроенную графику с 5120 ядрами CUDA. Оба чипа N1X поддерживают 12 линий PCIe 5.0, 5 линий PCIe 4.0 и разработаны для диапазона энергопотребления от 45 Вт до 80 Вт. Чипы могут работать с оперативной памятью LPDDR5x объёмом от 16 до 128 Гбайт.  Чипы N1 предназначены для использования в более доступных ноутбуках и представлены в двух версиях. Старшая версия оснащена 12 процессорными ядрами (8+4), а младшая — 10 ядрами (7+3). В первом случая используется встроенная графика с 2560 ядрами CUDA, а во втором — с 2048 ядрами CUDA. Оба процессора поддерживают 8 линий PCIe 5.0 и 3 линии PCIe 4.0, от 8 до 64 Гбайт ОЗУ и отличаются более низким энергопотреблением — от 18 Вт до 45 Вт. Nvidia ещё не подтвердила спецификации новых Arm-чипов. Так же нет уверенности, что на предстоящей Computex дебютируют все обозначенные выше процессоры — как отметили в VideoCardz, часть источников данной утечки датирована 2024 годом, что говорит о продолжительной разработке, но за два года планы Nvidia могли поменяться. Тайваньские власти подозревают, что ИИ-чипы Nvidia попадали в Китай через Японию в обход санкций

30.05.2026 [06:09],

Алексей Разин

Трое задержанных на прошлой неделе на Тайване подозреваемых в организации контрабанды лиц, как предполагает следствие, могли бы замешаны как минимум в одной поставке ИИ-ускорителей Nvidia в Китай в обход американских правил экспортного контроля с использованием Японии в качестве промежуточной страны.

Источник изображения: Nvidia Как поясняет Bloomberg, подозреваемым сперва пришлось экспортировать партию ускорителей с Тайваня в Японию, а затем уже организовать её поставку в КНР через Гонконг. В деле фигурирует партия серверного оборудования Supermicro, содержащего ИИ-ускорители Nvidia, поставки которых в Китай запрещены правилами экспортного контроля США. Трио подозреваемых для реализации своего замысла подделало документы на отгружаемую продукцию, как считает следствие. После ареста подозреваемых была выявлена партия из 50 серверов, которые также готовились к поставке в Китай по подложным документам. Установлено, что группа успела провести через тайваньскую таможню как минимум одну партию ИИ-ускорителей Nvidia, которые запрещены к поставкам в Китай. Размер этой партии не уточняется. Следствие предполагает, что и захваченные на Тайване 50 серверов должны были отправиться в КНР через Японию. Последняя из стран впервые фигурирует в подобном контексте, поскольку считается близким геополитическим союзником США, не допускающим подобных проколов в вопросах экспортного контроля. При этом китайские разработчики могут вполне легально арендовать ЦОД с запрещёнными к поставке в КНР ускорителями Nvidia, если соответствующие вычислительные мощности расположены в Японии или других окрестных странах Азии. Тайваньские следователи не предъявляют никаких обвинений Nvidia и Supermicro, чья продукция фигурирует в этом деле. По словам главы первой из компаний, она тщательным образом разъясняет правила экспортного контроля своим клиентам. Supermicro, по его словам, нужно усилить контроль за поставками своей продукции и провести собственное расследование. Как пояснили представители Supermicro, фигурирующие в тайваньском деле серверные системы были изначально проданы авторизованному партнёру компании, который должен был следовать всем сопутствующим ограничениям. По мнению представителей компании, над усилением контроля за цепочками поставок должна работать вся отрасль, чтобы соответствующие меры были достаточно эффективными. MediaTek утверждает, что чипы для её клиентов теперь способна упаковывать и Intel

30.05.2026 [05:18],

Алексей Разин

Корпорация Intel ещё при прежнем генеральном директоре Патрике Гелсингере (Patrick Gelsinger) начала активно продвигать свои услуги по упаковке чипов за пределами собственных потребностей. Похоже, тайваньский разработчик чипов MediaTek счёл их подходящими для собственного использования, и теперь чипы клиентов этой компании смогут упаковывать TSMC и Intel.

Источник изображения: Intel По крайней мере, об этом заявил старший вице-президент MediaTek Винс Ху (Vince Hu), на слова которого ссылается Nikkei Asian Review: «Мы теперь одни из немногих, кто может предложить упаковку чипов силами как TSMC, так и Intel». Непосредственно MediaTek чипы не выпускает, она их только разрабатывает, а изготовлением их традиционно занимаются специализированные подрядчики типа TSMC. Поскольку спрос на чипы со сложной пространственной компоновкой растёт, роль технологий их упаковки возрастает. В этих условиях заполучить ещё одного партнёра в лице Intel для MediaTek крайне важно. MediaTek пользуется услугами TSMC по упаковке чипов передовым методом CoWoS, но она не одинока в этой сфере — подобным образом поступают AMD, Nvidia, Broadcom, Amazon и Google. В результате мощностей TSMC на всех желающих не хватает. Интерес к услугам Intel в этой сфере проявляет не только MediaTek, но и Google. В свою очередь, MediaTek желает активнее участвовать в буме ИИ, который с точки зрения компонентов сосредоточен на серверном направлении, а там возможности упаковки чипов весьма важны. Сотрудничество с Intel, тем самым, откроет перед MediaTek новые возможности. В текущем году компания собирается в сегменте ИИ-серверов выручить $2 млрд, а в следующем готова превзойти этот уровень. По данным Nikkei, компания MediaTek помогает Google разработать кастомные ИИ-чипы, которые будут использовать фирменную упаковку EMIB, предлагаемую компанией Intel. Если такое сотрудничество состоится, новый крупный контракт пойдёт на пользу последней, поскольку контрактный бизнес Intel остаётся глубоко убыточным. Помогать Google разрабатывать ИИ-чипы тайваньская MediaTek начала довольно давно. Сама MediaTek при этом продолжает полагаться на возможности TSMC в сфере производства чипов по передовым технологиям. Она уже получает от этого подрядчика образцы чипов, выполненные по ангстремной технологии A14 (1,4-нм), их массовое производство должно быть запущено в 2028 году. В сфере автомобильной электроники MediaTek готовит для клиентов чипы, которые будут выпускаться по 2-нм техпроцессу. Кроме того, в этом году будет представлен флагманский чип MediaTek для смартфонов, который также будет производиться по 2-нм технологии. Часть 4-нм и 3-нм чипов MediaTek начнёт выпускаться на предприятиях TSMC в Аризоне. Группа инвесторов влезла в долги на $36 млрд, чтобы купить чипы Google TPU для Anthropic

29.05.2026 [12:20],

Алексей Разин

OpenAI не одинока в своих многочисленных кольцевых сделках, в которых деньги многократно передаются друг другу, а сама компания не несёт особой ответственности за их использование. По данным Bloomberg, финансирование нужду конкурирующей Anthropic тоже осуществляется силами сторонних инвесторов с привлечением заёмных средств.

Источник изображения: Google В частности, сообщается о намерениях Apollo Global Management и Blackstone Inc. привлечь дополнительных инвесторов для направления $36 млрд заёмных средств на покупку для нужд Anthropic ИИ-чипов Google TPU. Последние не достанутся в собственность стартапа, а будут всего лишь арендованы, а значительную часть финансовых ресурсов в этой схеме готова предоставить компания Broadcom. По сути, подобная сделка станет крупнейшей в своём роде, если она состоится. Руководство Anthropic не стесняется признаться, что компания испытывает нехватку вычислительных ресурсов в условиях бурного развития отрасли ИИ, спрос на её услуги сейчас заметно превышает возможности стартапа. По всей видимости, аренда ИИ-чипов Google TPU является одним из вероятных способов решения этой проблемы. Anthropic также договорилась с xAI (SpaceX) об аренде ЦОД Colossus в штате Теннесси, хотя на днях и выяснилось, что срок аренды пока ограничен 180 днями. Apollo и Blackstone продадут часть долговых обязательств по обсуждаемой сделке, но основная их сумма останется под их контролем. На этой неделе стало известно, что Anthropic удалось привлечь $65 млрд и поднять свою капитализацию до внушительных $965 млрд, которые позволяют формально говорить о преимуществе над OpenAI. Традиционно кредитные и лизинговые схемы при развитии инфраструктуры ИИ использовались для покупки крупных партий GPU, но ничто не мешает применить такую практику и в отношении TPU. Как ожидается, полученные в лизинг чипы Anthropic собирается использовать на своих площадках в Нью-Йорке, Техасе, Луизиане и Индиане. Broadcom в этой сделке выступает в роли своего рода поручителя, поскольку далёкие от специфики ИИ-отрасли кредиторы могут не доверять стартапу Anthropic при попытках прямого заимствования средств. Поставки чипов будут осуществляться поэтапно. Облигации, за счёт которых будет финансироваться сделка, поделены на три серии. Две первые (A1 и A2), в рамках которых будет привлечён в общей сложности $31 млрд, будут обладать более высоким приоритетом с точки зрения порядка выплаты дохода. Ещё $4,5 млрд будут привлечены через выпуск облигаций менее приоритетной серии B. Структура сделки подразумевает, что если Anthropic не сможет погасить стоимость полученных чипов за счёт лизинговых платежей, то специально созданная под этот проект компания попытается распределить среди кредиторов средства, вырученные от продажи чипов. Если вырученной суммы не хватит для полного покрытия долга, недостающую сумму держателям облигаций серий A1 и A2 доплатит Broadcom. ByteDance взялась за разработку собственных ИИ-процессоров

28.05.2026 [10:30],

Алексей Разин

Недавно стало известно об интересе китайской ByteDance к ИИ-чипам производства Qualcomm, но ими дело не ограничится, как поясняет Reuters со ссылкой на собственные источники. Китайский техногигант разрабатывает собственные центральные процессоры, которые будет применять в своей вычислительной инфраструктуре.

Источник изображения: ByteDance Подобные шаги ByteDance отражают не только тенденцию к смещению фокуса в сторону инференса в сфере вычислительных нагрузок, но и формирующийся дефицит центральных процессоров серверного класса, о котором не стесняется открыто говорить руководство Intel и AMD, например. Американские техногиганты типа Google, Amazon и Microsoft уже давно разрабатывают собственные ИИ-чипы, поэтому для ByteDance аналогичные меры оказались вполне ожидаемыми. Процессоры собственной разработки, как считается, помогут ByteDance подготовить свою вычислительную инфраструктуру к выпуску агентских программных решений, включая платформу Coze. Пока проект разработки собственных процессоров находится на ранней стадии реализации, но ByteDance уже обратилась к нескольким разработчикам чипов, чтобы те не только помогли создать процессоры, но и получить доступ к производственным мощностям подрядчиков типа той же TSMC в условиях дефицита. Как сообщается, ByteDance собирается использовать как Arm-совместимую архитектуру, так и RISC-V, чтобы на определённом этапе понять, какая из них лучше соответствует её долгосрочным целям. В серийное производство будет запущено решение на той архитектуре, которая окажется более предпочтительной для самой ByteDance. Полагаться на серверные процессоры Intel и AMD этой компании становится всё дороже, поскольку эти поставщики за последние несколько месяцев подняли цены на свою продукцию на величину от 10 до 35 %. Nvidia также претендует на свою долю рынка при помощи центральных процессоров Vera и унаследованных от стартапа Groq технологий. Marvell рассчитывает к 2029 году зарабатывать на ИИ-чипах более $10 млрд в год

28.05.2026 [08:37],

Алексей Разин

Облачные гиганты в условиях бурного развития вычислительной инфраструктуры начинают всё чаще задумываться о создании специально адаптированных под свои нужды ИИ-чипов. Компания Marvell Technology подобные услуги готова оказывать, и к 2029 фискальному году рассчитывает получать в этой сфере более $10 млрд выручки в год.

Источник изображения: Marvell Technology Для понимания, 2027 фискальный год в календаре Marvell завершится 31 января следующего года, поэтому указанную выручку на направлении кастомных ИИ-чипов компания должна получить уже к началу 2029 календарного года. В следующем фискальном году Marvell рассчитывает выручить около $16,5 млрд против прежних заложенных в прогноз $15 млрд. По итогам текущего фискального квартала компания ожидает выручить $2,7 млрд, что выше консенсус-прогноза LSEG. Ожидаемая компанией удельная выручка должна составить 93 цента на одну акцию, что также превышает ожидания аналитиков. Генеральный директор Marvell Technology Мэтт Мёрфи (Matt Murphy) пояснил, что компания взаимодействует в сфере создания кастомных чипов со всеми американскими гиперскейлерами. Если учесть, что они готовы только в этом году направить на развитие собственной вычислительной инфраструктуры около $725 млрд, то Marvell наверняка сможет неплохо заработать на таком взаимодействии. В этом году серверная выручка Marvell должна вырасти на 50 %. В прошлом квартале компания выручила в данном сегменте $1,83 млрд. Общая выручка Marvell Technology увеличилась на 28 % до $2,42 млрд, превысив ожидаемую аналитиками сумму $2,4 млрд. Удельный доход на акцию в размере 80 центов также оказался выше ожиданий (79 центов). SpaceX признала: для орбитального ИИ ей катастрофически не хватает чипов — и TeraFab может не спасти

27.05.2026 [16:04],

Николай Хижняк

В преддверии долгожданного IPO компания SpaceX признала, что для реализации амбициозных планов по созданию орбитальной сети дата-центров для искусственного интеллекта ей потребуется больше чипов, чем она может получить в настоящее время. Амбициозный проект TeraFab может решить проблему нехватки чипов, однако компания не исключает, что он может оказаться неудачным. Также SpaceX признаёт, что её нынешние партнёры — Tesla и Intel — не обязаны поддерживать её в долгосрочной перспективе.

Источник изображения: Tesla Как и в случае с любыми другими IPO, Комиссия по ценным бумагам и биржам США (SEC) требует, чтобы SpaceX указывала все факторы риска — как крупные, так и незначительные, включая форс-мажорные обстоятельства, такие как возможные погодные катаклизмы. Поэтому к этим комментариям следует относиться с должной долей скептицизма. Тем не менее они указывают на некоторые препятствия, которые компания может рассматривать как реальные проблемы для своей бизнес-модели. «Наша способность реализовать масштабный проект по созданию орбитального искусственного интеллекта зависит от наличия достаточного количества чипов для ИИ — значительно большего, чем у нас есть сейчас. Производство и поставки серверов и сетевого оборудования для нашей технической инфраструктуры, особенно графических процессоров и других специализированных компонентов, ограничены небольшим числом квалифицированных поставщиков. У нас нет долгосрочных или иных существенных договорных обязательств с нашими непосредственными поставщиками чипов. Вместо этого мы закупаем все наши графические процессоры по разовым заказам», — говорится в документе по форме S-1 для SEC. Текущие деловые отношения с поставщиками графических процессоров, такими как AMD и Nvidia, а также с производственными партнёрами TSMC и Samsung Foundry подвергают SpaceX и её подразделение xAI риску столкнуться с «нехваткой производственных мощностей, дефицитом сырья, геополитическими потрясениями и стихийными бедствиями, затрагивающими регионы производства полупроводников». TSMC, крупнейшая в мире компания по производству полупроводников и крупнейший в мире производитель современных логических микросхем, едва справляется с удовлетворением спроса на процессоры для ИИ. Инсайдеры отрасли предупреждают, что производитель испытывает дефицит поставок на фоне крупных заказов. Например, Nvidia увеличила общий объём закупок у TSMC, включая складские запасы, обязательства по закупкам и предоплаты, до $145 млрд, чтобы обеспечить поставки чипов и других компонентов. Другие компании, как правило, поступают так же. Чтобы хотя бы частично снизить риски, Tesla, SpaceX и xAI намерены построить TeraFab — специализированное предприятие по производству полупроводников, которое будет выпускать чипы исключительно для этих трёх компаний. На данный момент о TeraFab известно лишь то, что фабрику планируется построить в кампусе SpaceX в Техасе и она будет использовать 14-нм техпроцесс Intel для производства чипов. Илон Маск намерен инвестировать в TeraFab десятки миллиардов долларов, но это не гарантирует успеха проекта, о чём предупреждает форма S-1. «Несмотря на то, что мы рассчитываем построить фабрику TeraFab, чтобы решить проблему с поставками, проект может оказаться неудачным, и тогда у нас не будет других источников достаточного количества чипов для искусственного интеллекта, чтобы удовлетворить наши потребности в орбитальных вычислительных мощностях для ИИ. Хотя фабрика TeraFab призвана расширить наши внутренние возможности по производству чипов и решить потенциальную проблему с нехваткой микросхем для искусственного интеллекта в SpaceX, особенно в связи с тем, что мы активно развиваем орбитальные вычислительные мощности для ИИ, мы рассчитываем и дальше закупать значительную часть нашего вычислительного оборудования у сторонних поставщиков. Нет никаких гарантий, что мы сможем достичь наших целей в отношении фабрики TeraFab в ожидаемые сроки или вообще сможем их достичь», — говорится в другом заявлении SpaceX. Интересно, что Intel и Tesla могут выйти из проекта, фактически оставив TeraFab без крупного заказчика и разработчика технологических процессов, что может поставить крест на всем проекте. «Несмотря на то, что у нас есть рамочное соглашение с Tesla, ни Tesla, ни Intel не обязаны оставаться в проекте, и в конечном итоге мы можем не заключить никаких окончательных соглашений», — говорится в форме S-1. Huawei намерена за пять лет догнать 1,4-нм чипы конкурентов с помощью «закона тау» и нового принципа проектирования

25.05.2026 [06:43],

Алексей Разин

На мероприятии ISCAS 2026, которое проходит в Шанхае, представители Huawei Technologies предложили использовать для масштабирования производительности полупроводниковых компонентов не изменение геометрии, которое определялось «законом Мура», а оптимизацию времени передачи сигнала.  Соответствующий принцип в компании назвали «законом масштабирования τ (тау)», а ещё он получил неофициальное обозначение «закон Хэ» в честь президента полупроводникового подразделения компании Хэ Тинбо (He Tingbo, на фото выше), которая и выступила на конференции с докладом на эту тему. Она поступила на работу в Huawei в 1996 году, и в последние годы способствовала успеху в разработке передовых чипов в условиях серьёзнейших западных санкций. Поскольку масштабировать производительность чипов при помощи одного лишь увеличения плотности размещения транзисторов по «закону Мура» Huawei в силу отсутствия доступа к западному литографическому оборудованию не может, пришлось искать другие способы движения вперёд. Уже осенью этого года, как ожидается, Huawei представит чипы Kirin для флагманских смартфонов, разработанные в соответствии с новым принципом масштабирования LogicFolding. Он подразумевает сокращение путей передачи сигнала при проектировании чипов на уровне отдельных контуров, снижении резистивной и ёмкостной нагрузки при распространении сигнала. С другой стороны, отдельные элементы нового подхода к дизайну применялись компанией уже на протяжении предыдущих шести лет, за это время был запущен в производство 381 чип, разработанный по принципу «масштабирования тау».

Источник изображения: Huawei Technologies На уровне устройства Huawei оптимизирует сопротивление и паразитную ёмкость транзисторов и межсоединений, чтобы сократить время передачи сигнала. Наборы команд и архитектура на уровне чипа должны также применяться с учётом данного принципа, чтобы повысить его быстродействие. На уровне системы должны применяться более эффективные протоколы передачи информации, которые снижают задержки. Сопутствующие принципы будут применяться Huawei при проектировании чипов, устройств и готовых систем, в совокупности они позволят компании к 2031 году создать решения, которые догонят по плотности размещения транзисторов зарубежные образцы, выпускаемые при помощи 1,4-нм техпроцесса. Если учесть, что Intel, Samsung и TSMC свои чипы такого класса начнут выпускать примерно с 2028 года, отставание Huawei номинально сократится до трёх лет. При этом компания призывает разработчиков и партнёров по всему миру присоединяться к этой инициативе, которая должна, по её мнению, снять физические ограничения на масштабирование производительности чипов, которые присущи классическому «закону Мура». |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |