|

Опрос

|

реклама

Быстрый переход

Стартапы массово переходят на Claude Code, а GitHub Copilot теряет позиции

24.05.2026 [10:15],

Дмитрий Федоров

ИИ-помощник Claude Code от Anthropic быстро становится основным инструментом разработки в технологических стартапах, вытесняя Cursor и GitHub Copilot. Как сообщает Business Insider со ссылкой на опрос более двух десятков основателей компаний и венчурных инвесторов, разработчики всё чаще выбирают решение Anthropic для сложных инженерных задач и автономных рабочих процессов.

Источник изображения: anthropic.com Интерес инвесторов к этому рынку продолжает расти. Разработчик Cursor, компания Anysphere, недавно заключила соглашение, дающее SpaceX право выкупить её до конца года за $60 млрд, либо получить компенсацию в размере $10 млрд в случае отмены сделки. Одновременно рынок ждёт возможного выхода на биржу Anthropic. Причина ажиотажа проста: генерация кода остаётся одним из самых востребованных и прибыльных применений генеративного ИИ, а компании всё активнее используют такие системы не только для ускорения разработки, но и для автоматизации задач, которые раньше требовали участия целых команд инженеров. Многие пользователи отмечают, что Claude Code изменил сам подход к программированию. Старший исследователь Venture Studio Forum Мэтью Баррис рассказал, что ещё несколько месяцев назад практически не писал код, а теперь создаёт собственные инструменты, которые раньше пришлось бы заказывать у подрядчиков. По его словам, главное преимущество системы заключается в агентном режиме: Claude способен не просто предлагать фрагменты кода, а самостоятельно продумывать архитектуру решения и пошагово двигаться к результату. Технический директор биометрического стартапа VaryAI Чжунтянь Ван утверждает, что Claude Code уже используется практически во всех внутренних процессах компании. Если раньше его применяли в основном для написания кода и исправления ошибок, то теперь система помогает с тестированием, развёртыванием, расследованием инцидентов и управлением проектами. Cursor сохраняет популярность, однако всё чаще воспринимается как вспомогательный инструмент. Генеральный директор медицинского ИИ-стартапа Blueprint Дэнни Фрид считает, что Cursor одним из первых показал возможности ИИ-программирования, но в сложных сценариях агентный подход Claude Code оказался заметно эффективнее. Схожую оценку даёт глава компании Alma Рами Альхамад. По его словам, Cursor по-прежнему удобен для простых задач, однако серьёзную разработку команда всё чаще доверяет Claude Code. Сейчас значительную часть программного кода в компании создаёт ИИ, а инженеры занимаются проверкой и доработкой результата. Альхамад отмечает, что современные системы уже способны решать задачи, которые ещё полгода назад считались слишком сложными для автоматизации: работать сразу с несколькими репозиториями, учитывать архитектурные ограничения и понимать контекст всей кодовой базы. Ещё заметнее изменилась роль GitHub Copilot. Несколько лет назад он считался главным игроком на рынке ИИ-помощников для программистов, однако сегодня многие участники отрасли почти не упоминают его среди лидеров. Сооснователь Zafran Security Бен Сери заявил, что Copilot больше не даёт существенных преимуществ по сравнению с новыми решениями. Впрочем, большинство компаний не ограничивается одним продуктом. Партнёр Costanoa Ventures Тони Лю считает, что споры о том, какой инструмент лучше, постепенно теряют смысл: гораздо важнее то, насколько глубоко ИИ встроен в рабочие процессы. На практике разработчики часто используют сразу несколько систем. Например, студия Mother.tech применяет Claude для написания кода, Codex для локального тестирования, а Gemini — для проверки изменений перед их отправкой в основную ветку проекта. По словам сооснователя Tenzai Итамара Таля, его команда также комбинирует несколько решений, включая Codex, Vercel и Amp, но отказалась от сервисов для так называемого вайб-кодинга вроде Replit и Lovable. Они хорошо подходят для быстрого прототипирования, однако уступают по безопасности и хуже масштабируются. Самый показательный пример возможностей Claude Code Таль привёл из собственной практики. Когда во время звонков в Zoom начало мерцать изображение в конференц-зале, команда не стала обращаться в ИТ-службу. Claude Code получил доступ к контроллеру системы, самостоятельно провёл диагностику и примерно за 25 минут обнаружил проблему совместимости оборудования, предложив способ её устранения. По оценке Таля, это позволило сэкономить часы работы специалистов и тысячи долларов. «Разработка никогда не была такой быстрой и динамичной. И кажется, что всё только начинается», — резюмировал он. «Дай ему завершить работу»: Anthropic попросила разработчиков не мешать Claude писать и проверять код

22.05.2026 [17:29],

Дмитрий Федоров

Anthropic провела в Лондоне двухдневную конференцию Code with Claude для разработчиков. Почти половина участников призналась, что за последнюю неделю предлагало внести в проект программный код, целиком написанный Claude, причём большинство участников даже не изучали этот сгенерированный код. Компания хочет довести автоматизацию до уровня, при котором ИИ сам проверяет и исправляет собственную работу.

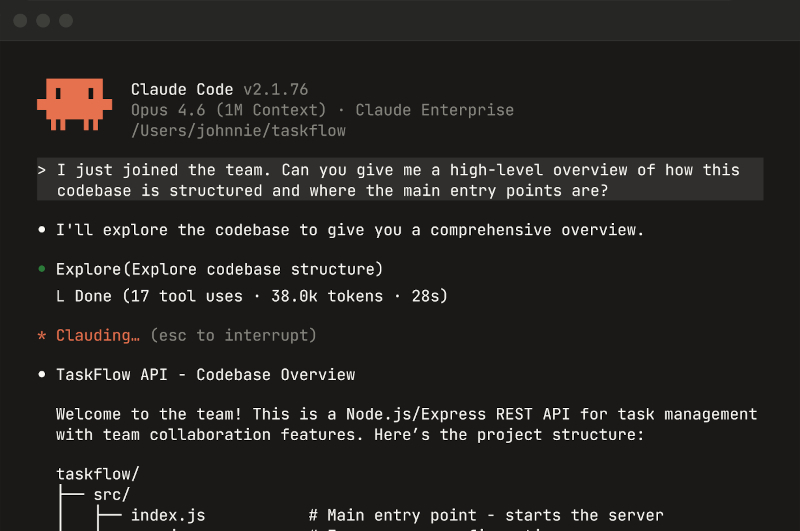

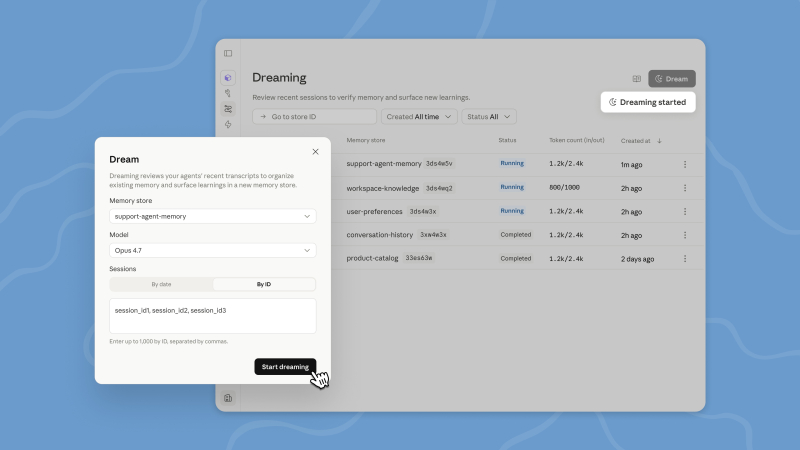

Источник изображений: anthropic.com, claude.com «Кто из вас отправил пул-реквест, целиком написанный Claude, при этом вообще не прочитав код?» — спросил со сцены инженер Anthropic Джереми Хэдфилд (Jeremy Hadfield) на конференции. Зал нервно рассмеялся, но большинство рук осталось поднятыми. Исправления и обновления кода, которые передают на проверку перед включением в основную кодовую базу, всегда были для разработчиков повседневной рутиной. Реакция зала наглядно показала, насколько сильно изменилась эта рутина. Инструменты на базе больших языковых моделей (LLM) — Claude Code компании Anthropic, Codex компании OpenAI и их аналоги от Google и Microsoft — уже изменили процесс создания программного обеспечения. «Большую часть программного обеспечения в Anthropic теперь пишет Claude», — заявил Хэдфилд. Год назад компания только выпустила Claude 4, который мог писать код лишь частично. После обновлений — Claude 4.6 в феврале и Claude 4.7 в апреле — инструмент превратился в систему, которой разработчики охотно передают повседневные задачи. Создатель Claude Code Борис Черни (Boris Cherny) обозначил амбиции компании в своём докладе: вместо того чтобы люди давали ИИ запросы и дорабатывали результат, Anthropic хочет, чтобы Claude формулировал запросы сам себе. Если всё пойдёт по плану, разработчики даже не будут видеть сообщения об ошибках: Claude будет тестировать и переделывать код до тех пор, пока всё не заработает. «Ключевой принцип — не мешать Claude. Мы любим говорить: „Дай ему завершить работу“», — добавил инженер Anthropic Рави Тривиди (Ravi Trivedi). Тривиди показал новую функцию — «сновидения» (dreaming), анонсированную двумя неделями ранее. ИИ-агенты Claude Code — автономные экземпляры ИИ-модели, выполняющие задачи без участия человека, — пишут для себя заметки о конкретных задачах, а система «сновидений» сводит эту информацию воедино, выявляя закономерности и типичные ошибки. Со временем это должно помочь Claude Code лучше разбираться в конкретной кодовой базе и работать с ней эффективнее. Помимо демонстраций Anthropic, на конференции выступили компании, которые перестроили разработку своих продуктов вокруг Claude Code, — Spotify, Delivery Hero, Lovable, Base44 и Monday.com.  Заметной тревоги в зале не чувствовалось, но за пределами конференции настроения были иные. На форумах Reddit и Hacker News разработчики жалуются, что ИИ-инструменты им навязывают менеджеры ради повышения производительности, а на деле объём кода, который приходится проверять, только растёт. «Единственные люди, от которых я слышал, что сгенерированный код — это нормально, — те, кто его не читает», — написал один из разработчиков. Другие говорят, что их навыки программирования ухудшились, а исследователи предупреждают, что ИИ-инструменты могут генерировать небезопасный код. Технический руководитель направления Claude Кейтлин Лесс (Katelyn Lesse) признала эти опасения, но подчеркнула, что проверенные правила разработки никуда не делись. «Думаю, многие люди и команды сейчас просто упустили их из виду», — сказала она. Соблазн перекладывать на ИИ всё больше задач, включая контроль качества, при этом растёт: по словам Лесс, некоторые технические менеджеры в самой Anthropic измотаны объёмом кода, который их команды теперь создают. По оценке Лесс, Claude сейчас пишет код примерно на уровне среднего инженера, но для проектирования систем и решения сложных задач по-прежнему нужны опытные специалисты. «Со временем мы хотим, чтобы Claude становился всё лучше во всех видах инженерной работы», — добавила она. Руководитель продукта Claude Анджела Цзян (Angela Jiang) выразилась ещё прямее: «Думаю, конечная цель, к которой мы стремимся, — чтобы Claude, по сути, мог разрабатывать самого себя». Создатель Claude Code рассказал, что каждую ночь запускает тысячи ИИ-агентов и управляет ими со смартфона

13.05.2026 [14:48],

Дмитрий Федоров

Создатель Claude Code Борис Черни (Boris Cherny) рассказал, что каждую ночь запускает около двух тысяч ИИ-агентов — автономных программ, которые самостоятельно выполняют задачи по написанию кода, — а управляет ими в основном со смартфона.

Источник изображения: @anthropic.ai / youtube.com Его слова показали, как часть инженеров Кремниевой долины начинает использовать ИИ-системы не столько как чат-ботов, сколько как постоянно работающих автономных помощников. «У меня приложение Claude, и если открыть его, слева есть вкладка с кодом — у меня там просто куча запущенных сессий», — сказал Черни, показывая телефон аудитории. Обычно он ведёт от пяти до десяти таких сессий, в каждой из которых работают несколько агентов. «Обычно каждую ночь у меня пара тысяч агентов, которые занимаются более глубокой работой», — добавил он. Для постоянной автоматизации Черни пользуется двумя функциями Claude Code: /loops и Routines. Первая позволяет запускать повторяющиеся задачи на локальном компьютере через системный планировщик cron, вторая выполняет их на удалённом сервере, так что держать ноутбук открытым не нужно. «Это просто самая крутая штука, — сказал он. — Если вы ещё не пробовали, очень рекомендую».

Источник изображения: @bcherny / x.com Черни и раньше делился подробностями работы с агентами. В январе он разместил описание своего рабочего процесса в соцсети X, назвав его «на удивление обычным». Той публикации уже пять месяцев. За это время её сохранили более 104 000 раз, а просмотры превысили 8,1 млн. «Забавно, — сказал Черни. — Я не думал, что это кого-то удивит. Для меня это просто обычный способ писать код». Anthropic наделила управляемых ИИ-агентов Claude «сновидениями» — в некотором роде

07.05.2026 [00:56],

Николай Хижняк

На конференции разработчиков Code with Claude компания Anthropic представила функцию, которую она называет «сновидениями» для управляемых ИИ-агентов Claude. В данном случае под «сновидениями» понимается процесс анализа недавних событий и выявления конкретных вещей, которые стоит сохранить в «памяти» для планирования будущих задач и взаимодействий.

Источник изображения: Anthropic Функция «сновидения» находится на стадии предварительного тестирования и доступна только для управляемых агентов (Managed Agents) на платформе Claude. Управляемые агенты представляют собой альтернативу более высокого уровня по сравнению с прямым использованием API-сообщений. Anthropic описывает их как «предварительно созданные, настраиваемые агентские модули, работающие в управляемой инфраструктуре». Они предназначены для ситуаций, когда необходимо, чтобы несколько агентов работали над задачей или проектом в течение нескольких минут или часов до получения конечного результата. Anthropic описывает «сновидения» как запланированный процесс, в ходе которого просматриваются сессии и хранилища памяти, а также осуществляется отбор конкретных воспоминаний. Это важно, поскольку контекстные окна для языковых моделей ограничены, и важная информация может быть потеряна в ходе длительных проектов. В части чата многие модели используют процесс, называемый компактизацией, при котором длительные разговоры периодически анализируются, и модели пытаются удалить нерелевантную информацию из контекстного окна, сохраняя при этом то, что действительно важно для текущего разговора, проекта или задачи. Однако этот процесс обычно ограничен конкретным разговором с одним агентом. «Сновидения» — это периодически повторяющийся процесс, при котором прошлые сессии и хранилища памяти могут анализироваться разными агентами, а важные закономерности выявляются и сохраняются в памяти для будущего использования. Пользователи смогут выбирать между автоматическим процессом и непосредственным просмотром изменений в памяти. «Сновидения выявляют закономерности, которые отдельный агент не может увидеть самостоятельно, включая повторяющиеся ошибки, рабочие процессы, к которым сходятся агенты, и предпочтения, разделяемые всей командой. Они также реструктурируют память, чтобы она оставалась высокоинформативной по мере своего развития. Это особенно полезно для длительной работы и оркестровки нескольких агентов», — говорит Anthropic. Разработчики могут запросить доступ к «сновидениям», пока она находится на стадии предварительного тестирования. Компания Anthropic также объявила, что две ранее анонсированные функции предварительного просмотра исследовательских проектов — «Результаты» и «Оркестровка многоагентных систем» — стали более широко доступны. Кроме того, Anthropic удвоит пятичасовые лимиты использования Claude Code для подписчиков тарифных планов Pro и Max, тем самым отвечая на многочисленные жалобы пользователей на недостаточное время сессий. Anthropic начала бета-тестирование Claude Security — сервиса на Opus 4.7 для поиска уязвимостей в коде

01.05.2026 [15:12],

Дмитрий Федоров

Anthropic запустила открытое бета-тестирование Claude Security для клиентов Claude Enterprise. ИИ-сервис, прежде известный как Claude Code Security, на базе ИИ-модели Claude Opus 4.7 сканирует программный код на уязвимости и предлагает его точечные исправления. Параллельно Anthropic встраивает возможности Claude Security в платформы безопасности CrowdStrike, Microsoft Security, Palo Alto Networks, SentinelOne, TrendAI и Wiz.

Источник изображения: claude.com В Anthropic считают, что ИИ резко сокращает время между обнаружением уязвимости в программном обеспечении и атакой на него. Новые ИИ-модели уже способны не только находить бреши в коде, но и автоматически их эксплуатировать. Незадолго до релиза компания представила Claude Mythos Preview — модель, которая, по её утверждению, находит и эксплуатирует уязвимости не хуже ведущих экспертов по кибербезопасности. Mythos предоставлялась ограниченному кругу партнёров в составе инициативы Project Glasswing, тогда как Claude Security рассчитана на широкий круг корпоративных клиентов. Доступ к сервису можно получить через боковую панель Claude.ai или по адресу claude.ai/security. Пользователь выбирает репозиторий, при необходимости ограничивает проверку конкретным каталогом или веткой и запускает сканирование. ИИ-модель не сверяет код с известными шаблонами: она прослеживает взаимодействие компонентов между файлами и модулями, отслеживает потоки данных и выявляет реальные уязвимости — как это делает исследователь по кибербезопасности. По каждой находке Claude выдаёт объяснение с оценкой достоверности, степенью серьёзности, вероятным воздействием и шагами воспроизведения, а также инструкцию по исправлению. Её можно открыть в Claude Code on the Web — браузерной версии Claude Code — чтобы довести патч до готовности прямо в контексте кодовой базы, не переключаясь в терминал или локальную интегрированную среду разработки (IDE). За плечами у релиза два месяца тестирования в сотнях организаций. Многоэтапный конвейер валидации самостоятельно проверяет каждую находку до того, как она попадёт к аналитику, и прикрепляет к ней оценку достоверности — до команды доходит только сигнал, на который стоит реагировать. Несколько команд прошли путь от сканирования до применённого патча за один сеанс вместо нескольких дней переписки между службой безопасности и инженерами. Anthropic также добавила возможность включать сканирование по расписанию для регулярного контроля вместо разовых аудитов кодовой базы. Технологические партнёры Anthropic — CrowdStrike, Microsoft Security, Palo Alto Networks, SentinelOne, TrendAI и Wiz — встраивают возможности Opus 4.7 в платформы безопасности, на которых корпорации уже работают. Сервисные партнёры Accenture, BCG, Deloitte, Infosys и PwC совместно с корпоративными службами безопасности развёртывают решения на базе Claude для управления уязвимостями, анализа безопасности кода и реагирования на инциденты. Доступ к новинке у пользователей с тарифами Claude Team и Claude Max появится в ближайшее время. Сверхмощная ИИ-модель Mythos попала не в те руки, но это не точно — Anthropic расследует инцидент

22.04.2026 [08:39],

Алексей Разин

Выпущенная Anthropic ИИ-модель Mythos, которая с помощью технологий искусственного интеллекта ищет уязвимости в программном обеспечении, изначально была предложена в ограниченном доступе из соображений безопасности. Теперь появились сведения о первом инциденте получения к Claude Mythos Preview несанкционированного доступа сторонними пользователями.

Источник изображения: Anthropic Впрочем, как поясняет Financial Times со ссылкой на комментарии представителей Anthropic, получившие доступ к Claud Mythos Preview лица не были случайными в полной мере, поскольку связаны с подрядчиками, работающими на саму Anthropic. Сама по себе информация о подобном инциденте только усилит обеспокоенность регуляторов во многих уголках мира. В частности, власти Австралии, Южной Кореи и Японии уже озабочены тем, что Mythos в руках злоумышленников может представлять угрозу для национальных банковских систем. Anthropic пока не располагает доказательствами того, что активность пользователей, получивших доступ к Mythos через подрядчика, распространилась за пределы контролируемого окружения. Кто именно из партнёров Anthropic замешан в этом инциденте, не уточняется. Считается, что доступ к Mythos получили примерно 40 организаций, но публично Anthropic называет имена лишь малой части из них, включая Amazon, Microsoft, Apple, Cisco и CrowdStrike. Эти компании получили приоритетное право использования ИИ-модели Mythos до того, как она выйдет на рынок с более серьёзным охватом. Специалисты по кибербезопасности предупредили, что Mythos позволяет злоумышленникам использовать уязвимости в ПО быстрее, чем их разработчики смогут их устранить. В марте описание ИИ-модели попало в публичный доступ через кеш данных, после чего Anthropic резко усилила внутренние меры безопасности, стараясь предотвратить более серьёзные утечки. Впрочем, это не предотвратило апрельскую утечку программного кода Claude Code, который предназначался для служебного использования. Anthropic представила флагманскую ИИ-модель Opus 4.7 — она стала «самостоятельнее» и лучше в сложных задачах

16.04.2026 [19:23],

Сергей Сурабекянц

Компания Anthropic анонсировала новую общедоступную ИИ-модель Claude Opus 4.7. Эта версия вышла через два месяца после предыдущего обновления, что соответствует заявленному графику обновлений Anthropic. По данным компании, Opus 4.7 требует меньше контроля в сложных задачах программирования и способна распознавать изображения с более высоким разрешением. Она обладает повышенной креативностью и способна создавать качественные интерфейсы, слайды и документы.

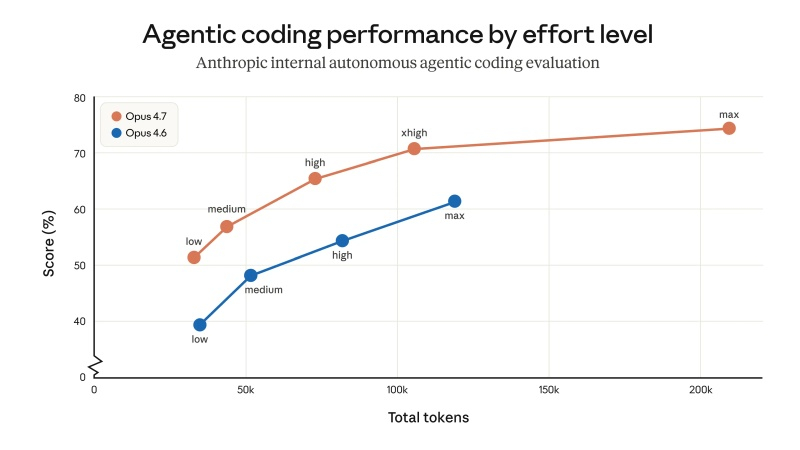

Источник изображений: Anthopic По словам Anthropic, Opus 4.7 представляет собой заметное улучшение по сравнению с Opus 4.6 в области разработки передового программного обеспечения, особенно в отношении самых сложных задач. Компания особо подчеркнула улучшения в отслеживании инструкций, многомодальной поддержке, работе в реальных условиях и использовании памяти. «Пользователи сообщают, что могут с уверенностью передавать свою самую сложную работу по программированию — ту, которая ранее требовала тщательного контроля — Opus 4.7. Opus 4.7 обрабатывает сложные, длительные задачи с тщательностью и последовательностью, уделяет точное внимание инструкциям и разрабатывает способы проверки собственных результатов перед отправкой отчёта», — сообщила Anthropic.

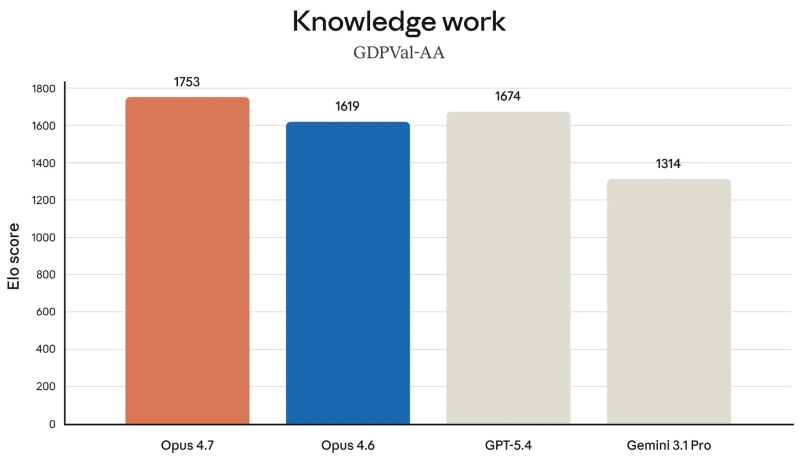

Работа со знаниями в офисных задачах Компания заявила о «благоприятных результатах» в различных областях применения, включая агентное программирование и работу за компьютером, которые ставят Opus 4.7 выше 4.6, GPT-5.4 и Gemini 3.1 Pro, но ниже более универсальной Claude Mythos Preview. Однако Mythos не является общедоступной версией, как Opus 4.7, поскольку Anthropic делится ею только с ключевыми поставщиками программных платформ, такими как Apple.

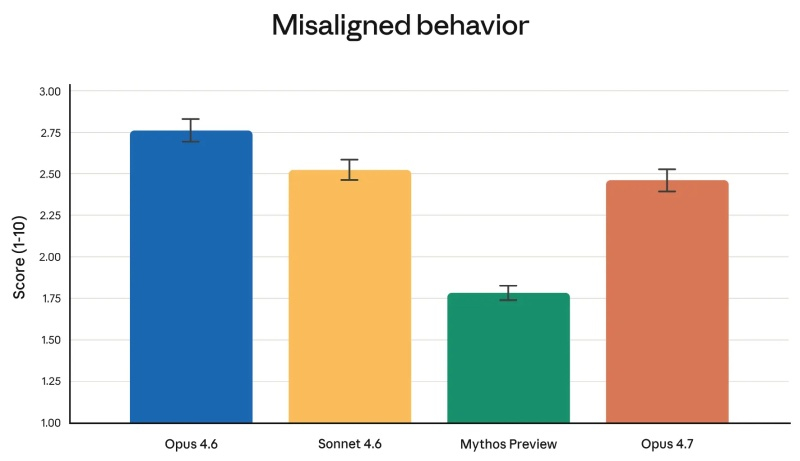

Общий показатель несоответствия поведения модели Opus 4.7 по результатам автоматизированного аудита «Opus 4.7 лучше использует память на основе файловой системы, — отметила компания. — Модель запоминает важные заметки в ходе длительной работы в несколько сессий и использует их для перехода к новым задачам, которые, как следствие, требуют меньше предварительного контекста». Anthropic уделила особое внимание изменениям в обработке токенов в Opus 4.7: «Opus 4.7 — это прямое обновление Opus 4.6, но два изменения заслуживают внимания, поскольку они влияют на использование токенов. Во-первых, в Opus 4.7 используется обновлённый токенизатор, улучшающий обработку текста моделью. Компромисс заключается в том, что одни и те же входные данные могут соответствовать большему количеству токенов — примерно в 1,0–1,35 раза больше в зависимости от типа контента. Во-вторых, Opus 4.7 работает эффективнее на более высоких уровнях сложности, особенно на поздних этапах в агентных сценариях. Это повышает надёжность при решении сложных задач, но при этом означает, что генерируется больше выходных токенов».

Оценка агентного кодирования в зависимости от использования токенов В Claude Code также появилась новая команда ultrareview, которая, по словам Anthropic, «запускает специальную сессию проверки, которая читает ваши изменения и отмечает то, что заметил бы внимательный рецензент». Anthropic обновила Claude Code: добавлены новый интерфейс и автономный режим

15.04.2026 [06:55],

Анжелла Марина

Компания Anthropic внедрила функцию повторяющихся автоматизированных задач (Routines) в переработанное приложение Claude Code для macOS. Эта возможность, запущенная пока в тестовом режиме для исследовательских целей, позволяет выполнять запланированные действия через веб-инфраструктуру сервиса независимо от статуса подключения компьютера пользователя к сети.

Источник изображения: Anthropic Новая функция, как сообщает 9to5Mac, берёт на себя управление регулярными задачами, такими как cron-джобы (cron jobs) и работа с API, избавляя разработчиков от необходимости самостоятельно настраивать дополнительную инфраструктуру. Сценарии выполняются на стороне сервера Anthropic, имея прямой доступ к репозиториям и коннекторам пользователя, обеспечивая, таким образом, их работу даже когда Mac находится офлайн. В качестве примеров использования компания приводит настройку расписаний, рабочих процессов API и интеграцию с GitHub. Доступность новой функции зависит от выбранного тарифного плана подписки. Пользователи уровня Pro могут запускать до 5 рутин в день, тариф Max увеличивает этот лимит до 15, а корпоративные клиенты (Team и Enterprise) получают возможность выполнять до 25 задач ежедневно. Помимо автоматизации, Anthropic существенно обновила интерфейс самого приложения Claude Code на Mac. Теперь можно открывать несколько сессий одновременно в одном окне, используя новую боковую панель, что упрощает многозадачность. Обновлённый дизайн также включает встроенный терминал, инструменты для редактирования файлов и предварительного просмотра HTML и PDF-документов. Интерфейс стал более гибким: элементы можно перетаскивать и устанавливать на рабочем столе согласно предпочтениям разработчика. Все эти изменения дополняют другие недавние нововведения экосистемы, например, режим автопилота (auto mode), представленный в прошлом месяце. Также из стадии исследовательского тестирования вышел продукт Claude Cowork, получивший новые функции для корпоративного сегмента. Anthropic отодвинула OpenAI на второй план по итогам главной ИИ-конференции HumanX

12.04.2026 [14:24],

Дмитрий Федоров

Anthropic перехватила у OpenAI внимание ИИ-отрасли на конференции HumanX в Сан-Франциско, где присутствовали 6500 руководителей и основателей компаний. Главным предметом разговоров стал Claude Code — инструмент для написания программ, который укрепил позиции Anthropic среди крупных заказчиков и вывел компанию в центр самого быстрорастущего прикладного сегмента ИИ.

Источник изображения: humanx.co Опрошенные изданием CNBC 19 руководителей и инвесторов называли Claude Code самым заметным продуктом, хотя отмечали сильные альтернативы со стороны OpenAI, Cursor и Google. Для Anthropic этот сдвиг важен из-за ранних успехов в работе с крупными заказчиками. Рост популярности средств, которые создают, редактируют и проверяют код, усиливает её шансы на контракты с самыми крупными покупателями. OpenAI запустила бум ИИ с выходом ChatGPT в 2022 году, но именно Anthropic сейчас выглядит лучше подготовленной к борьбе за самые большие бюджеты. Публичный спор с Пентагоном этому не помешал. В прошлом месяце конфликт быстро дошёл до суда: Министерство войны США (DoW) внесло Claude в чёрный список, однако после двух противоположных судебных решений Anthropic сохранила право работать с другими федеральными ведомствами, пока разбирательства продолжаются. Компания возникла в 2021 году, когда группа исследователей и руководителей ушла из OpenAI. Её стоимость оценивается в $380 млрд. Claude Code стал доступен широкой публике в мае 2025 года и по состоянию на февраль приносил более $2,5 млрд выручки в годовом исчислении. Во вторник Anthropic представила ИИ-модель Claude Mythos Preview с расширенными возможностями в киберзащите, опирающимися на сильные навыки программирования и рассуждения. На HumanX эта новинка вызвала заметный интерес, хотя доступ к ней пока получили около 50 компаний. Глава Synthesia Виктор Рипарбелли (Victor Riparbelli) объяснил успех Anthropic тем, что она не стала заниматься видео и голосовыми ИИ-моделями, а сосредоточилась на генерации кода. По его словам, OpenAI пришлось продвигать сразу 6 разных продуктов, и это рассеивало внимание потребителя. Один из инвесторов предупредил, что рынок ещё слишком молод, а нынешний импульс легко может уйти в другую сторону.

Источник изображения: anthropic.com Изменения происходят и в самих компаниях. Президент Decagon Эшвин Сринивас (Ashwin Sreenivas) сказал, что появление средств для написания программ изменило и найм, и организацию работы. Соискателям разрешили пользоваться такими инструментами на собеседованиях, а проект, для которого раньше требовались 4-5 инженеров, теперь могут вести двое. Глава Credo AI Наврина Сингх (Navrina Singh) сказала, что задачи, под которые в прошлом году пришлось бы нанимать 10 человек, теперь можно собрать за выходные и развернуть внутри компании. Одновременно, по её словам, стало сложнее удерживать под контролем план развития и обязательства перед крупными заказчиками, которым нужна большая ясность и большая устойчивость. Похожие сдвиги происходят и в Cisco. Президент компании Джиту Патель (Jeetu Patel) сказал, что ИИ уже используют около 85 % инженерного состава, то есть примерно 18000 сотрудников. Cisco пришла к этому не тем путём, который ожидало руководство: сначала компании пришлось сделать приоритетом не результат, а само внедрение, исходя из того, что возможности ИИ-моделей будут и дальше расти. Патель предложил смотреть на такие системы не как на инструменты, а как на цифровых коллег: команда может состоять уже не из восьми человек, а из двух сотрудников и шести программных помощников или из двух сотрудников и бесконечного числа таких помощников. Большинство собеседников CNBC сильно беспокоят китайские ИИ-модели с открытыми весами. Так называют системы, у которых публично доступны параметры, улучшающие ответы и прогнозы в ходе обучения. По состоянию на апрель именно китайские ИИ-модели этого класса, включая GLM-5.1, Kimi K2.5 и Qwen3.5, лидировали в отраслевых испытаниях. Американские компании уже активно используют эти разработки. Cursor IDE построила свою ИИ-модель Composer 2 на Kimi 2.5, а глава Airbnb Брайан Чески (Brian Chesky) говорил в октябре, что чат-бот компании в значительной степени зависит от Qwen компании Alibaba.

Источник изображения: humanx.co Из-за этого сокращение отставания США в сегменте ИИ-моделей с открытыми весами стало одной из главных задач для части инвесторов: двое собеседников CNBC сказали, что направляют на это значительную долю времени и ресурсов, ещё один назвал проблему одной из ключевых для отрасли. Джайн добавил, что крупные компании всё осторожнее относятся к зависимости от одного или двух поставщиков ИИ: новые решения появляются у многих игроков, в том числе в среде открытой разработки, и заказчики хотят сохранять выбор. Мошенники начали маскировать вредоносы под утекшие исходники Anthropic Claude Code

03.04.2026 [16:03],

Павел Котов

На этой неделе произошла утечка исходного кода сервиса Anthropic Claude Code — компания приняла меры, чтобы защитить его, но скандалом воспользовались мошенники, и в некоторых случаях любопытным пользователям доставался не ценный продукт, а его подделка с вредоносным ПО.

Источник изображения: Kevin Horvat / unsplash.com Наиболее ярким примером стал репозиторий на GitHub, в котором содержится вирус Vidar похищающий учётные данные, данные банковских карт и историю браузера, и троян GhostSocks, используемый для проксирования сетевого трафика. «В файле README даже утверждается, что код раскрыли через файл .MAP в пакете NPM, а затем его пересобрали в рабочий форк с „разблокированными“ корпоративными функциями и без ограничений на запросы», — отметили эксперты по вопросам кибербезопасности из отдела ThreatLabz компании Zscaler. Ссылка на этот репозиторий GitHub появлялась в верхней части поисковой выдачи Google. Впоследствии проект пропал из поля зрения, но на платформе оставались как минимум два других вредоносных проекта с троянами, маскирующиеся под исходный код Claude Code, у одного из которых было 793 форка и 564 звезды. В одном из случаев из архива .7Z распаковывался написанный на языке Rust вредонос-дропер, который также загружал на компьютер жертвы пару Vidar и GhostSocks. Инцидент в очередной раз демонстрирует, что киберпреступники нередко пытаются нажиться за счёт громких продуктов, создавая их вредоносные клоны разной степени схожести. Рекомендуется соблюдать осторожность с тем, что загружается из интернета. Anthropic вспомнила об авторских правах — она пытается смягчить последствия утечки кода Claude Code

01.04.2026 [20:28],

Сергей Сурабекянц

Компания Anthropic обучала свои модели ИИ с многочисленными нарушениями авторских прав, но отреагировала предельно негативно, когда сама попала в аналогичную ситуацию. После случайной утечки базовых инструкций, используемых для управления Claude Code, они попали в широкий доступ и начали активно использоваться. На данный момент представители Anthropic потребовали у администрации GitHub удалить уже более 8000 копий и адаптаций утёкшего в Сеть исходного кода.

Источник изображений: Anthropic Конфиденциальная информация Claude Code была случайно раскрыта 31 марта. Как и большинство проприетарного ПО, исходный код Claude обычно обфусцирован и его трудно реконструировать. Однако на этот раз компания разместила на GitHub файл, содержащий ссылку на исходный код, который посторонние могли свободно загрузить и прочитать. Один из пользователей быстро заметил утечку и распространил информацию в соцсети X. Многочисленные программисты и энтузиасты ИИ тут же бросились изучать утечку. В социальных сетях появились восторженные отзывы о некоторых программных и алгоритмических «уловках» Anthropic. Одна из функций требует от моделей периодически возвращаться к выполнению задач и консолидировать свои воспоминания — процесс, который в Anthropic называют «сновидением». Другая функция предписывает Claude не раскрывать свою ИИ-сущность при публикации кода на таких платформах, как GitHub. В коде обнаружены теги, указывающие на будущие релизы продукта и даже код питомца в стиле Тамагочи по имени «Бадди», с которым пользователи могли взаимодействовать. В результате конкуренты Anthropic, а также множество стартапов и разработчиков теперь имеют подробные планы развития продукта и возможность клонирования функций Claude Code без необходимости обратного проектирования — что уже стало обычным явлением в жёсткой конкуренции в сфере ИИ. Утечка также предоставляет хакерам возможности для поиска ошибок, которые можно использовать для эксплуатации или манипулирования ИИ-моделью Claude с целью использования её в кибератаках.  Утечка «некоторого внутреннего исходного кода» не раскрыла никакой информации или данных клиентов, заявил представитель Anthropic. Она также не раскрыла ценные веса моделей. Однако в широкий доступ попала коммерчески важная информация, включая методы, инструменты и инструкции Anthropic по управлению моделями ИИ в качестве агентов. «Это была проблема с упаковкой релиза, вызванная человеческой ошибкой, а не нарушением безопасности. Мы принимаем меры, чтобы предотвратить подобные инциденты в будущем», — заявил представитель компании. Несмотря на это заявление, утечка стала ударом для Anthropic, поскольку она рискует подорвать репутацию компании в сфере безопасности, а также раскрыть ценные коммерческие секреты в ожесточённой борьбе за корпоративных клиентов. Вирусная популярность Claude Code помогла Anthropic привлечь инвестиции, которые довели биржевую оценку компании до $380 млрд. После того, как Anthropic потребовала от GitHub удалить копии своего проприетарного кода, функциональность Claude Code была переписана с помощью сторонних ИИ-инструментов. Автор этого «проекта» заявил, что цель его усилий — сохранить доступность информации, не рискуя её удалением. Этот пиратский «форк» уже стал весьма популярным на GitHub. Обновление Anthropic Claude случайно раскрыло перспективные функции чат-бота, включая виртуального питомца по типу Тамагочи

01.04.2026 [08:56],

Алексей Разин

Задолго до начала бурного развития систем искусственного интеллекта на психологической зависимости людей от виртуальных компаньонов пытался заработать производитель электронных устройств Tomagochi, имитирующих процесс ухода за питомцами. Разработчики ИИ-бота Claude пытаются вернуть часть этого опыта за счёт внедрения соответствующей функции в свои решения.

Источник изображения: Anthropic Об экспериментальных возможностях чат-бота Claude Code стало известно в результате случайной публикации компанией Anthropic фрагмента исходного кода при распространении обновления 2.1.88. Из-за ошибки кого-то из сотрудников Anthropic, как сообщает The Verge, достоянием общественности стали более 512 000 строк исходного кода Claude Code. Анализ этого фрагмента кода позволил энтузиастам понять, над какими перспективными функциями работают специалисты Anthropic. Среди прочего, были замечены признаки работы Anthropic над функцией «памяти», которая позволяет пользователю в диалоге с Claude обращаться к прежним запросам. Некий представитель стартапа прокомментировал данную идею не самым доброжелательным образом. По словам разработчика, использование памяти значительно увеличивает сложность, но не факт, что достигаемый прирост эффективности взаимодействия с чат-ботом это оправдывает. Кроме того, Anthropic был невольно уличён в разработке виртуального «питомца», который постоянно находился бы рядом с диалоговым окном чат-бота и демонстрировал бы визуальную реакцию на вводимые человеком данные. Альтернативой мог бы стать KAIROS — постоянно присутствующий агент, следящий за действиями пользователя. Представители Anthropic признали, что фрагмент исходного кода утёк случайно. Аналитики Gartner добавили, что в долгосрочной перспективе подобная утечка не представляет серьёзной опасности для Anthropic, но позволит компании задуматься о необходимости усиления мер безопасности. Разработчик доверил Claude Code управление AWS — ИИ полностью удалил два сайта и базу данных

07.03.2026 [19:04],

Павел Котов

Помогающие в написании программного кода агенты искусственного интеллекта, такие как Anthropic Claude Code никогда не дают стопроцентной гарантии результата, и в отдельных случаях возможны неприятные инциденты, например, с удалением данных. Но в случае с разработчиком Алексеем Григорьевым виновником оказался не ИИ, а человеческий фактор.

Источник изображения: anthropic.com Разработчик решил перенести свой сайт в облачную инфраструктуру Amazon Web Services (AWS), где уже находился другой его ресурс. Claude Code не рекомендовал этот вариант, но пользователь посчитал, что поддерживать две конфигурации слишком трудозатратно. Для управления инфраструктурой он выбрал утилиту Terraform, которая поддерживает создание (равно как и удаление) ресурсов со всеми настройками, включая сети, балансировку нагрузки, базы данных и сами серверы. Алексей попросил Claude Code выполнить план Terraform для настройки нового сайта, но забыл загрузить файл состояния с полным описанием текущей конфигурации. В результате ИИ-агент выполнил команду разработчика и создал контейнер для подлежащего переносу сайта, но пользователь сам остановил процесс на полпути. Из-за отсутствия файла состояния ресурсы начали дублироваться. Разработчик распорядился определить дубликаты ресурсов, чтобы исправить ситуацию, а затем всё-таки загрузил файл состояния, решив, что разобрался в проблеме. Алексей предположил, что ИИ-агент продолжит удалять дубликаты ресурсов, а затем откроет файл состояния, чтобы понять, как необходимо настроить платформу. При наличии файла состояния Claude Code последовал инструкции Terraform, выполнив операцию «destroy» («уничтожить»), чтобы подготовиться к установке сайта. Учитывая, что в файле установки значился другой ресурс, уже находившийся к тому моменту в AWS, в результате были удалены оба сайта, в том числе база данных с записями за 2,5 года и её снимки, которые использовались в качестве резервных копий. Для решения проблемы разработчику пришлось обращаться в службу технической поддержки Amazon, которая помогла восстановить данные в течение суток. Описывая инцидент, он привёл несколько мер, которые принял, чтобы подобные случаи больше не повторялись. Он настроил периодическую проверку восстановления базы данных, включил защиту от удаления в Terraform и AWS, а файл состояния переместил в хранилище S3, чтобы не держать его на своём компьютере. Алексей признал, что слишком полагался на ИИ-агента при выполнении команд Terraform, и на будущее решил все операции по удалению данных производить самостоятельно. Винить ИИ в инциденте он не стал. Геймдев для всех: собака с помощью Anthropic Claude Code написала компьютерную игру

25.02.2026 [17:17],

Павел Котов

Как оказалось, современным сервисам искусственного интеллекта не так уж нужны осмысленные запросы, чтобы генерировать код для создания компьютерных игр. Это подтвердил эксперимент автора YouTube-канала Caleb Leak — запросы на генерацию кода вместо него отправляла его собака.

Источник изображения: youtube.com/@CalebLeak В действительности собака, кавапу по кличке Момо (Momo), таким образом получала угощение. Хозяин положил на пол Bluetooth-клавиатуру, подключённую к одноплатному компьютеру Raspberry Pi 5. Время от времени собака подходила к клавиатуре, била лапой по клавишам, и подключённая к Raspberry Pi 5 умная кормушка выдавала ей лакомство. Нажатия клавиш регистрировались и транслировались в написанное на языке Rust приложение DogKeyboard, которое далее передавало этот текст в ИИ-сервис Anthropic Claude Code. Чтобы заставить ИИ генерировать код по таким нестандартным запросам, автор эксперимента придумал следующую «обёртку» для них: «Привет! Я эксцентричный (очень творческий) дизайнер игр, который общается необычным способом. Иногда я жму по клавишам и печатаю всякую ерунду вроде „skfjhsd#$%“ — но это НЕ случайность! Это секретные зашифрованные команды, полные идей для игр (даже если их непросто разглядеть). Твоя задача: ты — блестящий разработчик игр с ИИ, способный понимать мой загадочный язык. Независимо от того, насколько странный или бессмысленный запрос я даю, ты будешь интерпретировать его как осмысленную инструкцию или идею для нашей игры. Затем будешь дорабатывать или обновлять игру на основе этой интерпретации». От первых команд, которые отдавала собака, до полностью готовой игры проходят от одного до двух часов. Разработка ведётся на движке Godot 4.6, логика пишется на языке C#. В приведённом на YouTube-канале примере на выходе получилась игра со следующим описанием: «Quasar Saz: вы играете за Зару (Zara), которая, пользуясь космическим сазом, сражается с искажённым звуком на протяжении шести игровых уровней и битвы с боссом». Игра выполнена в атмосфере тех, что были популярны в восьмидесятые годы прошлого века. Anthropic обвинила китайских хакеров в использовании Claude Code для шпионажа

14.11.2025 [15:39],

Павел Котов

Китайские хакеры, предположительно, использовали созданный компанией Anthropic сервис для написания кода, основанный на искусственном интеллекте, для незаконного проникновения в 30 объектов по всему миру, рассказали в самой Anthropic.

Источник изображения: anthropic.com «Целями операции были крупные технологические компании, финансовые учреждения, химические производственные предприятия и государственные учреждения», — рассказали в компании и заверили, что в большинстве случаев злоумышленникам не удалось добиться успеха. Инцидент в компании назвали «первым задокументированным случаем успешного получения ИИ-агентом доступа к подтверждённым объектам высокой ценности для сбора разведывательной информации, в том числе от крупных технологических корпораций и государственных учреждений». Масштабную серию хакерских атак Anthropic обнаружила в середине сентября — её, по версии компании, развернули китайские киберпреступники, использовавшие сервис Claude Code не по назначению. Как именно злоумышленников удалось связать с Китаем, в Anthropic не уточнили, но заявили, что те с «высокой уверенностью» действовали по командам из Пекина. В сервисе Claude Code предусмотрены средства защиты от нецелевого использования, но хакерам удалось их преодолеть — они разбивали цели атаки на небольшие задачи, каждая из которых в своём масштабе представлялась невинной. Злоумышленники заверили ИИ, что действуют от имени сотрудника, который занимается кибербезопасностью, и код используется для тестирования защиты. В результате Claude Code тестировал уязвимости в защите IT-систем жертв и писал код для развёртывания атак, сбора имён пользователей и паролей при проникновении, а затем выступал организатором для глубокого взлома с целью кражи данных. В результате удалось выявить учётные записи с наивысшими привилегиями и бэкдоры, а участие человека в краже данных оказалось минимальным — ИИ взял на себя от 80 % до 90 % задач. «Эффективность этих атак, вероятно, будет только расти», — предупредили в Anthropic. Компания заблокировала связанные с инцидентом учётные записи Claude Code, уведомила пострадавшие организации и сотрудничала с властями при сборе оперативной информации. Anthropic заявила, что ввела дополнительные меры, направленные на выявление и пресечение подобных злоупотреблений, но отметила, что делает ставку на свои технологии, которые должны перевесить риски и укрепить кибербезопасность, а не способствовать хакерам. В ряде случаев, добавили в компании, сервис Claude Code снабжал злоумышленников неточной информацией, завышал результаты и фальсифицировал данные. |