|

Опрос

|

реклама

Быстрый переход

Специалисты по ИИ решили, что современный ИИ — «зазубренный», потому что туповатый

08.06.2025 [21:59],

Анжелла Марина

Генеральный директор Google Сундар Пичаи (Sundar Pichai) заявил, что для обозначения текущей фазы развития искусственного интеллекта (ИИ) нужно ввести новый термин AJI, который необходим для обозначения противоречивой природы современных ИИ-моделей, способных решать сложнейшие задачи и совершать прорывы в науке, и одновременно допускать нелепые ошибки в простых заданиях, например в подсчёте слов.

Источник изображения: AI Пичаи впервые упомянул об AJI на подкасте Лекса Фридмана (Lex Fridman), отметив, что он не уверен, кто именно придумал этот термин, но предположительно, это был бывший сотрудник OpenAI Андрей Карпати (Andrej Karpathy), специалист по глубокому обучению и компьютерному зрению. AJI расшифровывается примерно как «искусственный зазубренный интеллект» (Artificial Jagged Intelligence). Как пишет Business Insider, Карпати объяснил значение AJI в своём посте 2024 года в X, написав, что придумал его для описания странного факта при котором современные языковые модели могут справляться со сложными математическими задачами, но при этом могут не понять, что 9,9 больше, чем 9,11, допускают ошибки в игре «крестики-нолики» или неправильно считают буквы в словах. По словам Карпати, в отличие от человека, чьи когнитивные способности развиваются равномерно с детства, ИИ демонстрирует неравномерный прогресс, когда выдающиеся достижения в одних областях соседствуют с неожиданными провалами в других. Пичаи согласился с этой оценкой, отметив, что современные ИИ-системы обладают впечатляющими возможностями, но при этом спотыкаются на простых заданиях, например, при подсчёте букв в слове strawberry (клубника) или в сравнении чисел. По его мнению, сейчас ИИ находится именно в фазе AJI, когда прорывные достижения соседствуют с явными недостатками. Глава Google также затронул тему искусственного общего интеллекта (AGI). В 2010 году, когда появился DeepMind, специалисты прогнозировали появление AGI через 20 лет. Теперь Пичаи считает, что это займёт немного больше времени, но одновременно подчёркивает, что в любом случае к 2030 году благодаря технологии искусственного интеллекта мир будет наблюдать «умопомрачительный прогресс в различных областях». При этом Пичаи отметил необходимость систем маркировки контента, созданного ИИ, чтобы пользователи могли отличать реальную информацию от сгенерированной. На Саммите будущего ООН (UN Summit of the Future) в сентябре 2024 года Пичаи перечислил четыре ключевых направления, в которых ИИ может помочь человечеству: улучшение доступа к знаниям на родных языках, ускорение научных открытий, смягчение последствий климатических катастроф и содействие экономическому развитию. Однако ИИ сначала придётся научиться правильно писать слово strawberry. Сроки строительства гигаваттного ЦОД в ОАЭ растянутся из-за проблем в сфере безопасности

08.06.2025 [08:28],

Алексей Разин

В середине прошлого месяца президент Дональд Трамп (Donald Trump) посетил ОАЭ, в результате чего было заключено предварительное соглашение о строительстве на территории страны крупнейшего за пределами США центра обработки данных, связанного с искусственным интеллектом. Как выясняется, реализация этого проекта тормозится озабоченностью американской стороны вопросами безопасности, относящимися к Китаю.

Источник изображения: Nvidia Готовность властей ОАЭ сотрудничать с китайскими компаниями, строго говоря, не является для американских чиновников неожиданностью и откровением, но экспорт в ближневосточный регион серьёзного количества передовых вычислительных компонентов таит особые риски, как отмечает Reuters со ссылкой на собственные источники. Представители Вашингтона выражают серьёзную обеспокоенность вероятностью получения Китаем доступа к соответствующим вычислительным мощностям на территории ОАЭ. На первом этапе на площади около 26 квадратных километров предполагается построить центр обработки данных, который будет потреблять 1 ГВт электроэнергии, вместит 100 000 передовых ускорителей Nvidia, и в дальнейшем может быть масштабирован до 5-гигаваттной мощности. Пользователями этого ЦОД и инвесторами в проект станут американские компании Nvidia, OpenAI, Oracle, Cisco и японская SoftBank, а арабская G42 будет отвечать за строительство необходимой инфраструктуры и дальнейшую эксплуатацию кампуса. Хотя последней в прошлом году и пришлось по требованию властей США прекратить использование китайского оборудования в своих проектах и отказаться от инвестиций в Китае, американские чиновники всё равно опасаются утечки технологий в Китай через территорию ОАЭ. Из-за этого одобрение проекта в США тормозится, поскольку американская сторона пытается наложить на представителей ОАЭ дополнительные обязательства в сфере безопасности. Этой ближневосточной стороне, например, предлагается отказаться от использования китайского оборудования в любых проектах, реализуемых на своей территории, а также запретить выходцам из Китая работать на территории ЦОД, который возводится совместно с американскими партнёрами. Сроки заключения соглашения по этому проекту в окончательном виде не определены, поэтому процедура может серьёзно затянуться, хотя изначально стороны намеревались ввести первую фазу ЦОД в строй в 2026 году. Предстоит также определить, как американская сторона сможет надёжно контролировать соблюдение предложенных условий. Nvidia планирует построить 100 новых ИИ-фабрик по всему миру

08.06.2025 [06:29],

Анжелла Марина

Nvidia приступила к реализации масштабного проекта по созданию 100 специализированных дата-центров для искусственного интеллекта (ИИ), которые получили название AI factories (ИИ-фабрики). По заявлению генерального директора компании Дженсена Хуанга (Jensen Huang), этот проект рассчитан на 50 лет и должен коренным образом изменить мировую ИИ-инфраструктуру. Тем более, что уже сейчас дата-центры приносят Nvidia почти 90 % выручки, тогда как доходы от игрового сегмента снизились до 9 %.

Источник изображения: Nvidia Вместо того, чтобы просто продавать оборудование существующим владельцам дата-центров, Nvidia стала активно участвовать в проектировании и строительстве новых мощностей. Как сообщает Tom's Hardware, сейчас по всему миру разрабатывается около 100 таких объектов, приоритетом которых является запуск и обучение современных ИИ-моделей с возможностью масштабирования под будущие задачи. В отличие от игровых видеокарт, где пользователь видит результат в виде графики, в случае с ИИ вычислительная мощность напрямую трансформируется в экономический эффект. Nvidia рассчитывает, что её технологии станут основой глобальной ИИ-инфраструктуры, которая, по прогнозам Хуанга, будет развиваться на протяжении следующих 50 лет и со временем может стать неотъемлемой частью цифровой среды по всему миру, как это произошло с интернетом. Для реализации этих планов Nvidia заключила партнёрства с такими компаниями, как TSMC, Foxconn, Gigabyte, Asus, Humain в Саудовской Аравии и другими. Построение таких фабрик будет опираться на самые передовые решения, включая системы GB200 и GB300, объединяющие GPU и CPU. В дальнейшем ожидается внедрение более мощных архитектур, таких как Rubin, и систем охлаждения нового поколения. Также, по словам вице-президента и директора Nvidia по ускоренным вычислениям Йена Бака (Ian Buck), компания намерена сотрудничать и с разработчиками ИИ для того, чтобы её платформа оставалась актуальной и постоянно развивалась. Отмечается, что новые ИИ-фабрики смогут одновременно работать с несколькими моделями искусственного интеллекта и быстро адаптироваться к изменяющимся задачам. В целом глава компании сравнивает текущую ситуацию в отрасли с «золотой лихорадкой», в которой Nvidia выступает в роли не просто «поставщика лопат», а поставщика автоматизированных систем добычи и переработки. Хуанг подчёркивает, что производительность оборудования напрямую влияет на доходы клиентов. Например, улучшение энергоэффективности в четыре раза теоретически может увеличить прибыль дата-центра в той же пропорции. Одновременно эксперты указывают, что текущие затраты на развитие ИИ остаются крайне высокими, а некоторые крупные игроки в сфере ИИ несут убытки, исчисляемые десятизначными суммами. При этом перспективы масштабного внедрения ИИ всё ещё остаются прогнозом, а не реальностью. Высокий суд Англии вывел на чистую воду адвокатов, использующих ИИ, — они ссылались на фейковые прецеденты

08.06.2025 [00:47],

Анжелла Марина

Высокий суд Англии и Уэльса предупредил юристов, что использование в судебных материалах информации, созданной с помощью искусственного интеллекта, может привести к уголовной ответственности. Такое заявление последовало после выявления случаев, когда адвокаты ссылались на несуществующие судебные решения и цитировали вымышленные постановления, сообщает The New York Times.

Источник изображения: AI Судья Виктория Шарп (Victoria Sharp) — президент Королевского суда (King's Bench Division), и судья Джереми Джонсон (Jeremy Johnson) рассмотрели два случая, в которых использовались ссылки на несуществующие дела. В одном из них истец вместе с адвокатом признали, что подготовили материалы иска против двух банков с помощью ИИ-инструментов. Суд обнаружил, что из 45 упомянутых ссылок 18 были вымышленными. Дело было закрыто в прошлом месяце. Во втором случае, завершившемся в апреле, юрист, подавший жалобу на местную администрацию от имени своего клиента, не смог объяснить происхождение пяти указанных примеров дел из судебной практики. «Могут быть серьёзные последствия для правосудия и доверия к системе, если использовать ИИ неправильно», — отметила судья Шарп. Она подчеркнула, что юристов могут привлечь к уголовной ответственности или лишить права заниматься профессиональной деятельностью за предоставление ложных данных, созданных ИИ. Также она указала, что такие инструменты, как ChatGPT, «не способны проводить надёжные правовые исследования» и могут давать хоть и уверенные, но полностью ложные утверждения или ссылки на несуществующие источники дел. В одном из дел мужчина потребовал выплатить ему сумму, исчисляемую миллионами, за якобы нарушенные банками условия договора. Позже он сам признал, что формировал ссылки на практику через ИИ-инструменты и интернет-ресурсы, поверив подлинности материалов. Его адвокат, в свою очередь, заявил, что опирался на исследования клиента и не проверил информацию самостоятельно. В другом деле юрист, представлявшая интересы человека, который был выселен из дома в Лондоне и нуждался в жилье, также использовала сгенерированные ссылки и не смогла объяснить их происхождение. При этом суд заподозрил применение ИИ из-за американского написания слов и шаблонного стиля текста. Сама юрист отрицала использование технологий искусственного интеллекта, но призналась, что в другом деле добавляла подобные ложные данные. Также она заявила, что использовала Google и Safari с ИИ-сводками результатов своего поиска. Интересно, что компания Vectara из Кремниевой долины (Калифорния, США), занимаясь с 2023 года исследованием ответов ИИ, выяснила, что даже лучшие чат-боты допускают ошибки в 0,7–2,2% случаев. При этом уровень «галлюцинаций» резко возрастает, когда от систем требуют генерировать большой текст с нуля. Недавно также и OpenAI сообщила, что её новые модели ошибаются в 51–79% случаев при ответах на общие вопросы. Несмотря на то, что судья Шарп признала, что искусственный интеллект является мощным инструментом, одновременно она заявила, что его использование сопряжено с рисками. Шарп также привела примеры из США, Австралии, Канады и Новой Зеландии, где ИИ некорректно интерпретировал законы или создавал вымышленные цитаты. Google Gemini научился выполнять задачи по расписанию

07.06.2025 [10:14],

Анжелла Марина

Google продолжает расширять возможности ИИ-ассистента Gemini, добавив функцию запланированных действий. Теперь подписчики Gemini Pro и Ultra могут настраивать автоматическое выполнение задач в заданное время. Например, ИИ будет отправлять сводку календаря в конце дня или предлагать идеи для блога еженедельно.

Источник изображения: Solen Feyissa / Unsplash Как сообщает The Verge, пользователи также смогут поручать Gemini разовые задания. Например, запрашивать итоги прошедшего мероприятия на следующий день. Для работы функции достаточно указать искусственному интеллекту, что и когда нужно сделать, а чат-бот выполнит задачу самостоятельно. Управлять запланированными действиями можно в настройках приложения Gemini на странице Scheduled Actions. Ранее издание Android Authority сообщило, что предварительная версия этой функции была замечена ещё в апреле. Обновление является частью масштабных планов Google по превращению Gemini в цифрового помощника, обладающего более широкими автономными возможностями и способного выполнять команды без вмешательства пользователя. Интересно, что аналогичную функцию уже предлагает OpenAI в ChatGPT. В частности, подписчики могут настраивать «напоминалки» и повторяющиеся задачи. Суд «заблокировал» кнопку «Удалить» в ChatGPT

06.06.2025 [19:45],

Сергей Сурабекянц

OpenAI сообщила, что вынуждена хранить историю общения пользователей с ChatGPT «бессрочно» из-за постановления суда, вынесенного в рамках иска от издания The New York Times о защите авторских прав. Компания планирует обжаловать это решение, которое считает «чрезмерным вмешательством, отменяющим общепринятые нормы конфиденциальности и ослабляющим безопасность».

Источник изображения: unsplash.com Издание The New York Times подало в суд на OpenAI и Microsoft за нарушение авторских прав в 2023 году, обвинив компании в «копировании и использовании миллионов» материалов для обучения моделей ИИ. Издание утверждает, что только сохранение данных пользователей до завершения судебного процесса сможет обеспечить предоставление необходимых доказательств в поддержку иска. В ноябре 2024 года стало известно, что инженеры OpenAI якобы случайно удалили данные, которые потенциально могли стать доказательством вины разработчика ИИ-алгоритмов в нарушении авторских прав. Компания признала ошибку и попыталась восстановить данные, но сделать это в полном объёме не удалось. Те же данные, что удалось восстановить, не позволяли определить, что публикации изданий были задействованы при обучении нейросетей. Поэтому в мае 2025 года суд обязал OpenAI сохранять «все выходные данные журнала, которые в противном случае были бы удалены», даже если пользователь запрашивает удаление чата или если законы о конфиденциальности требуют от OpenAI удаления данных. В соответствии с политикой OpenAI, если пользователь стирает чат, через 30 дней он удаляется без возможности восстановления. Теперь компании придётся хранить чаты до тех пор, пока суд не решит иначе. OpenAI сообщила, что постановление суда затронет пользователей бесплатной версии ChatGPT, а также владельцев подписок Pro, Plus и Team. Оно не повлияет на клиентов ChatGPT Enterprise или ChatGPT Edu, а также на компании, заключившие соглашение о нулевом хранении данных. OpenAI заверила, что данные не попадут в общий доступ, а работать с ними сможет «только небольшая проверенная юридическая и безопасная команда OpenAI» исключительно в юридических целях. «Мы считаем, что это был неуместный запрос, который создаёт плохой прецедент. Мы будем бороться с любым требованием, которое ставит под угрозу конфиденциальность наших пользователей; это основной принцип», — отреагировал генеральный директор OpenAI Сэм Альтман (Sam Altman). Ранее OpenAI обвинила The New York Times в «десятках тысяч попыток» получить эти «крайне аномальные результаты», «выявив и воспользовавшись ошибкой», которую сама OpenAI «стремится устранить». NYT якобы организовала эти атаки, чтобы собрать доказательства в поддержку утверждения, что продукты OpenAI ставят под угрозу журналистику, копируя авторские материалы и репортажи и тем самым отбирая аудиторию у создателей контента. The New York Times не одинока в своих претензиях в OpenAI. В мае 2024 года восемь интернет-изданий подали иск к OpenAI и Microsoft за незаконное использование статей для обучения ИИ. Истцы упрекают OpenAI в незаконном копировании миллионов статей, размещённых в изданиях New York Daily News, Chicago Tribune, Orlando Sentinel, Sun Sentinel, The Mercury News, The Denver Post, The Orange County Register и Pioneer Press для обучения своих языковых моделей. Apple разработала ИИ, выявляющий нетипичные аспекты устной речи — это поможет диагностировать заболевания

06.06.2025 [18:07],

Павел Котов

В рамках проекта, посвящённого голосовым и речевым моделям искусственного интеллекта, Apple опубликовала материалы (PDF) нового исследования, касающегося одной из сложных проблем машинного обучения: распознавание не только того, что было сказано человеком, но и того, как это было сказано.

Источник изображения: Slavcho Malezan / unsplash.com В статье исследователи описывают схему анализа речи с использованием параметров качества голоса (Voice Quality Dimensions — VQD). Эти параметры указывают на разборчивость, резкость, монотонность речи, придыхание и другие аспекты. На них обращают внимание и логопеды, когда оценивают звучание голоса и влияние на него неврологических состояний и заболеваний. Apple работает над моделями ИИ, также способными их обнаруживать. Большинство речевых моделей обучается на здоровых и типичных для большинства голосах. Если голос человека звучит иначе, ИИ может дать сбой, и это большой недостаток системы, если ей пытается воспользоваться человек с ограниченными возможностями. В работе над этой проблемой исследователи Apple обучили несколько дополнительных моделей ИИ, предназначенных для работы совместно с основными речевыми системами, на большом общедоступном наборе данных аннотированной нетипичной речи, в том числе на голосах людей с болезнью Паркинсона, боковым амиотрофическим склерозом (БАС) и детским церебральным параличом (ДЦП). На этом инженеры компании не остановились — они не стали использовать эти модели для прямой расшифровки сказанного, а составили методику измерения того, как звучит голос, на основе семи основных критериев:

Источник изображения: Iluha Zavaley / unsplash.com Таким образом, ИИ научился «слушать как врач», а не просто регистрировать то, что говорят. Для извлечения звуковых характеристик Apple использовала пять моделей ИИ и обучила дополнительные легковесные алгоритмы, чтобы на основе этих характеристик предсказывать параметры качества голоса. Разработанные компанией дополнительные алгоритмы показали высокие результаты по большинству параметров, хотя качество срабатывания варьировалось в зависимости от конкретного признака и всей задачи. Важнейшим достоинством исследования стало то, что ответы моделей оказались объяснимыми — в отрасли ИИ это встречается нечасто. Вместо того, чтобы показывать условную оценку достоверности (confidence score), система указывает на конкретные характеристики голоса, что упрощает классификацию. Это поможет в клинической оценке и диагностике. Но и на клинической речи в Apple не остановились. Исследователи протестировали свои модели на образцах эмоциональной речи из набора данных RAVDESS: модели VQD не обучались на эмоциональных записях, но также давали прогнозы. Так, в сердитой речи отмечалась низкая «равномерность громкости», а грустные голоса воспринимались как монотонные. Возможно, это поможет улучшить и голосового помощника Apple Siri, который сможет корректировать свои интонации и речь в зависимости от того, как интерпретирует настроение и состояние пользователя, а не только сказанное им. ИИ можно полностью обучить только на бесплатных материалах, доказали исследователи

06.06.2025 [17:49],

Павел Котов

Специализирующиеся на разработке ИИ компании утверждают, что их проекты невозможно было бы создать без материалов, защищённых авторским правом. Группа учёных из США и других стран доказала, что разработка ИИ в таких условиях возможна, хотя и затруднительна. Они создали модель, обученную исключительно на общедоступном контенте и материалах с открытой лицензией.

Источник изображения: Igor Omilaev / unsplash.com Проект стал результатом сотрудничества 14 учреждений, включая Массачусетский технологический институт, Университет Карнеги — Меллона и Торонтский университет. Исследователи составили массив данных для обучения, собранных только из этичных источников, — его объём достиг 8 Тбайт. В него, в частности, вошли 130 000 книг из Библиотеки Конгресса США. На этих материалах исследователи обучили большую языковую модель с 7 млрд параметров. Она работает примерно на уровне модели Meta✴✴ Llama 2-7B аналогичного размера, вышедшей в 2023 году. Тестов производительности модели в сравнении с ведущими отраслевыми проектами авторы исследования не привели. Качество работы системы на уровне модели двухлетней давности было не единственным недостатком — утомительным оказался и процесс перевода обучающего массива в надлежащий формат. Значительная часть данных не читалась машинами, поэтому людям приходилось участвовать в их подготовке. «Мы пользовались средствами автоматизации, но все наши материалы аннотировались вручную в конце дня и проверялись людьми. И это очень непросто», — рассказала одна из участниц проекта. Учёным пришлось определять, какая лицензия действует для каждого подвергшегося сканированию сайта. В 2024 году OpenAI заявила одному из комитетов британского парламента, что «обучать ведущие современные модели ИИ без использования защищённых авторским правом материалов невозможно». В прошлом году с этим тезисом согласился эксперт из Anthropic: «Больших языковых моделей, скорее всего, не было бы, если бы фирмы [специализирующиеся на] ИИ были обязаны лицензировать работы в своих наборах обучающих данных». Теперь есть доказательство, что оба утверждения не соответствуют действительности. Едва ли исследование что-то изменит в отрасли, но один из приводимых разработчиками ИИ распространённых аргументов оказался несостоятельным. Соцсеть X запретила использовать свой контент для обучения чужих ИИ

06.06.2025 [16:00],

Павел Котов

Администрация соцсети X обновила политику конфиденциальности — в новой редакции документ не позволяет третьим лицам использовать материалы платформы для обучения искусственного интеллекта. Эта мера, возможно сигнализирует о готовности заключать лицензионные сделки, как это ранее сделала Reddit.

Источник изображения: Dima Solomin / unsplash.com Сторонним разработчикам теперь запрещается «использовать API X или материалы X для тонкой настройки или обучения базовых или передовых моделей [ИИ]», говорится в разделе «Обратное проектирование и прочие ограничения» обновлённого соглашения. В редакции политики конфиденциальности от октября прошлого года платформа могла передавать контент пользователей третьим лицам «для обучения их моделей ИИ, будь то генеративные или иные», если сами пользователи от этого не отказались. Перемена может быть связана с тем, что официально владельцем X является стартап Илона Маска (Elon Musk) xAI. Компания занимается разработкой чат-бота Grok, и вполне естественно, что она больше не хочет, чтобы третьи лица при разработке ИИ имели то же конкурентное преимущество — большой объём обучающего контента. По крайней мере, бесплатно компания предоставлять эти данные теперь не намерена. Эта мера может открыть для X новый источник дохода, если администрация платформы решит лицензировать контент за плату. Ранее так поступила Reddit — она заключила лицензионные соглашения с Google и OpenAI. Reddit также развернула средства безопасности, не допускающие краж данных ботами и веб-сканерами; она даже подала в суд на Anthropic, обвинив разработчика ИИ в недобросовестном сборе информации. Стоит отметить, что изменения политики X касаются только сторонних разработчиков ИИ; условия обслуживания по-прежнему позволяют администрации платформы использовать контент пользователей для обучения собственных моделей ИИ. Запретить сбор таких данных можно в настройках конфиденциальности своей учётной записи. Google навела порядок в Gemini 2.5 Pro — исправлены накопившиеся у ИИ-модели «регрессии»

06.06.2025 [12:25],

Павел Котов

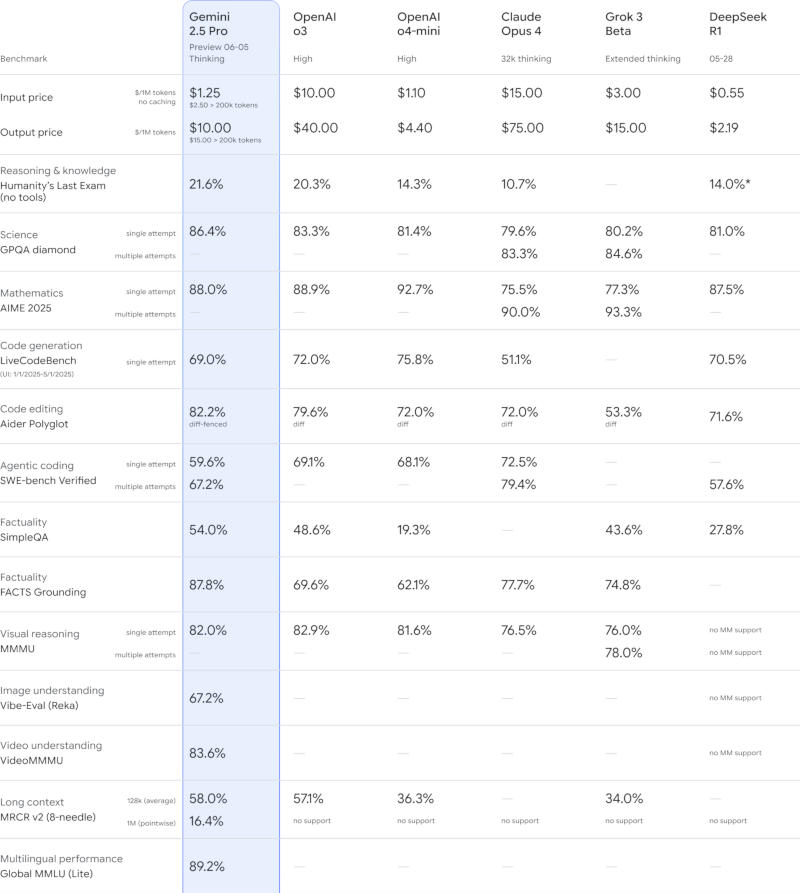

Google выпустила крупное обновление своей самой мощной модели искусственного интеллекта Gemini 2.5 Pro. Свежий вариант призван исправить некоторые проблемы, возникшие в более ранних версиях, — компания намеревается установить для него статус стабильного, то есть он будет подключён к приложению Gemini как основной для широкой аудитории.

Источник изображений: blog.google Предыдущий выпуск Gemini 2.5 Pro с номером версии 05-06 и именем I/O Edition был направлен на повышение качества генерируемого ИИ программного кода. В последнем обновлении, утверждает Google, этот навык был дополнительно улучшен, и в тесте Aider Polyglot модель набрала 82,2 %, значительно оторвавшись от лучших моделей OpenAI, Anthropic и DeepSeek. Модель Gemini 2.5 Flash уже вышла из стадии предварительной и стала стабильной, тогда как работа над Gemini 2.5 Pro продолжается — несколько последних её обновлений спровоцировали критику по качеству ответов на запросы, не связанные с написанием кода, — их качество снизилось по сравнению с крупным выпуском версии 03-25. Google приняла эти замечания всерьёз, заявили в компании, и в свежем обновлении «закрыты проблемы в регрессиях [относительно] 03-25». Пользователям обещаны улучшенные творческие способности модели и более качественное форматирование ответов.  Последнее обновление Gemini 2.5 Pro 06-05 поддерживает гибкое управление ресурсами модели для разработчиков, и в Google рассчитывают, что эта сборка получит статус «долгосрочного стабильного выпуска». Таким образом, если в ближайшие недели данный вариант выйдет в приложении для широкой аудитории и в веб-интерфейсе, у Gemini 2.5 Pro уже не будет статуса предварительной версии (Preview). Google традиционно собирает оценки качества ответов своих моделей и приводит рейтинги с платформ LMArena и WebDevArena, где сравниваются возможности различных систем ИИ. На платформе LMArena модель увеличила результат на 24 балла по системе Эло, и на 35 балов он вырос на WebDevArena. Модели ИИ от Google были на вершинах обоих рейтингов и до настоящего момента, поэтому с выходом очередного обновления разрыв только увеличился. Опробовать последнюю версию Gemini 2.5 Pro можно на облачных платформах Google Cloud Vertex AI и AI Studio, а также в приложении Gemini. Американский Институт безопасности ИИ больше не сосредоточен на безопасности ИИ

05.06.2025 [17:48],

Павел Котов

Минторг США переименовал подчинённый ему Институт безопасности искусственного интеллекта (AI Safety Institute) в Центр стандартов и инноваций в области ИИ (Center for AI Standards and Innovation — CAISI). Тем самым фокус организации сместился с собственно безопасности ИИ на борьбу с угрозами национальной безопасности и устранение «обременительного и ненужного регулирования за рубежом».

Источник изображения: Igor Omilaev / unsplash.com Глава Минторга Говард Лютник (Howard Lutnick) объявил о реорганизации учреждения 3 июня, охарактеризовав эту меру как возможность «оценить и продвинуть инновации США» и «обеспечить доминирование США в области международных стандартов ИИ». О создании института было объявлено в 2023 году — тогда его целью провозглашалось снижение угроз, происходящих от ИИ. Администрация президента США подписала меморандумы о взаимопонимании с крупными компаниями в сфере ИИ, включая OpenAI и Anthropic; в документах предусматривался доступ властей к новым моделям и право предлагать улучшения систем ИИ перед их запуском для широкой аудитории. В начале 2025 года действующий на тот момент президент США Джо Байден (Joe Biden) выпустил проект руководящих принципов по управлению рисками, связанными с ИИ, такими как использование систем для проектирования биологического оружия или иных угроз национальной безопасности, а также генерация вредоносного контента, включая изображения жестокого обращения с детьми. В новом качестве, заявил господин Лютник, организация «сосредоточится на очевидных рисках, таких как кибербезопасность, биобезопасность и химическое оружие». Центр также будет расследовать факты «злонамеренного иностранного влияния, возникающего в результате использования систем ИИ противников» — под этим, вероятно, имеется в виду созданная в Китае большая языковая модель DeepSeek, которая впервые вышла на уровень американских аналогов. Вступивший в должность в конце января действующий президент США Дональд Трамп (Donald Trump) отменил указ своего предшественника, устанавливавший новые стандарты безопасности для крупных систем ИИ. Новый глава государства исходит из необходимости дать американским компаниям в области ИИ возможность развиваться максимально быстро. Представлен вертикальный пылесос Dreame H15 Pro Heat с искусственным интеллектом, горячей водой и автоматизацией

05.06.2025 [17:03],

Андрей Созинов

Компания Dreame представила вертикальный пылесос Dreame H15 Pro Heat. Производитель заявляет, что это инновационное устройство обеспечит максимальный комфорт уборки благодаря сочетанию искусственного интеллекта и передовых инженерных решений. Главной особенностью Dreame H15 Pro Heat стала уникальная роботизированная шторка DescendReach GapFree. Благодаря ИИ-алгоритмам она автоматически поднимается или опускается в зависимости от направления и скорости движения пылесоса. Такой подход обеспечивает тщательную уборку сразу с трёх сторон, позволяя эффективно устранять загрязнения даже вдоль плинтусов, стен и в труднодоступных углах. После прохода Dreame H15 Pro Heat на полу не остаётся ни разводов, ни следов воды — результат, который сложно воспроизвести с помощью традиционных средств. Ещё одна сильная сторона новинки — система ThermoRinse для влажной уборки с использованием действительно горячей воды температурой 85 °C. Встроенный нагревательный элемент обеспечивает стабильную температуру, а система подачи воды с конструкцией для кругового промывания позволяет максимально быстро нагревать воду. Благодаря этому Dreame H15 Pro Heat легко справляется не только с пылью, но и со сложными масляными и жировыми пятнами, которые часто остаются на кухонных полах. Грязь удаляется с первого прохода — без лишних усилий и повторных движений. Чистота и гигиена поддерживаются не только на полу, но и внутри самого устройства. Щётка после каждой уборки проходит автоматическую промывку в системе ThermoTub: она полностью погружается в воду, нагретую до 100 °C, и прокручивается в двух направлениях, имитируя ручную стирку. Интеллектуальный RGB-датчик определяет степень загрязнения и самостоятельно подбирает интенсивность промывки. Сушка также происходит под управлением ИИ: устройство анализирует влажность щётки и регулирует как температуру, так и длительность сушки, чтобы не допустить неприятных запахов и появления плесени, а также сохранить мягкость материала. Отдельного внимания заслуживает эластичный скребок TangleCut, который полностью решает проблему засорения щётки длинными волосами и шерстью домашних животных. По результатам тестов пылесос способен без затруднений собрать до 1000 волос за один цикл уборки, при этом на щётке не остаётся спутанных волос, и её не нужно очищать вручную после работы. Для семей с домашними питомцами или длинноволосыми членами семьи это настоящее спасение. Высокая производительность Dreame H15 Pro Heat обеспечивается мощным двигателем, создающим максимальную силу всасывания — 22 000 Па. Такой показатель позволяет легко собирать не только пыль и крошки, но и жидкие загрязнения, шерсть, крупные частицы мусора. Система умных датчиков контролирует уровень загрязнения и автоматически регулирует мощность всасывания, что обеспечивает экономию энергии и воды, а также гарантирует безупречный результат. Разделение твёрдых и жидких отходов дополнительно повышает эффективность уборки и облегчает последующее обслуживание устройства. Ёмкий аккумулятор обеспечивает до 72 минут автономной работы, а значит, одной зарядки достаточно для уборки даже большой квартиры или загородного дома. Здесь также пригодится большой бак для чистой воды объёмом 800 мл и отдельный контейнер для использованной воды (650 мл в вертикальном положении и 400 мл — в горизонтальном). Это позволяет проводить полноценную влажную уборку без постоянной необходимости доливать воду или очищать бак. Dreame H15 Pro Heat создан с акцентом на эргономику и удобство. Специальная конструкция ручки позволяет наклонять её на 180° и без труда очищать пространство под мебелью и в других труднодоступных местах. Пылесос оснащён системой GlideWheel, благодаря которой легко скользит по поверхности, а технология BalanceBoost отвечает за устойчивость в вертикальном положении. Все элементы управления интуитивно понятны: на корпусе расположен светодиодный экран, а голосовые подсказки делают процесс уборки максимально простым и комфортным даже для пожилых людей. Функциональность устройства расширяет возможность подключения к фирменному приложению Dreamehome — через него можно управлять режимами уборки и отслеживать состояние устройства. Dreame H15 Pro Heat станет настоящей находкой для семей с детьми, владельцев домашних животных и всех, кто ценит не только чистоту, но и автоматизацию бытовых процессов. Это устройство не только поддерживает идеальный порядок, но и бережно заботится о домашнем комфорте, делая уборку максимально эффективной, быстрой и незаметной. Пылесос Dreame H15 Pro Heat уже доступен в продаже по цене 69 990 рублей, а в период с 30 мая по 9 июня 2025 года действует специальное предложение — 64 990 рублей. Perplexity анонсировала заменитель Google Chrome — ИИ-браузер Comet

05.06.2025 [16:52],

Дмитрий Федоров

Компания Perplexity анонсировала запуск браузера с искусственным интеллектом под названием Comet. Он создаётся как платформа для так называемого агентного поиска, при котором пользователь взаимодействует с веб-окружением через интеллектуального цифрового посредника, способного интерпретировать, уточнять и контекстуализировать запросы человека.

Источник изображения: Perplexity По словам генерального директора компании Аравинда Сриниваса (Aravind Srinivas), разработка Android-версии браузера идёт успешно и быстро, а его релиз можно ожидать уже осенью этого года. При этом версия Comet для Windows будет доступна в формате открытой беты уже на следующей неделе. Компания подтвердила, что параллельно с этим будет выпущена и macOS-версия браузера, что подчёркивает её стратегию кроссплатформенного охвата. Возможно, ранний запуск Comet на Windows объясняется приоритетом настольных решений, где проще протестировать новые интерфейсные сценарии, прежде чем переходить к мобильной версии. Разработчики делают ставку не только на поиск, но и на расширенную функциональность, превращающую Comet в модульную интеллектуальную среду. Браузер будет включать не только собственный Perplexity-поисковик, но и встроенные обучающие модули и игры, которые, по словам Сриниваса, будут вполне реализуемы в рамках архитектуры продукта. Также заявлена интеграция корпоративного инструмента Labs — среды для продуктивной работы и взаимодействия с ИИ. В перспективе Comet получит доступ к таким элементам экосистемы, как интеллектуальные сервисы для анализа и рекомендации контента, финансовые утилиты и платформа коллективной работы Spaces. Архитектура браузера спроектирована таким образом, чтобы эти модули можно было подключать по мере необходимости, превращая Comet в персонализированную цифровую среду.

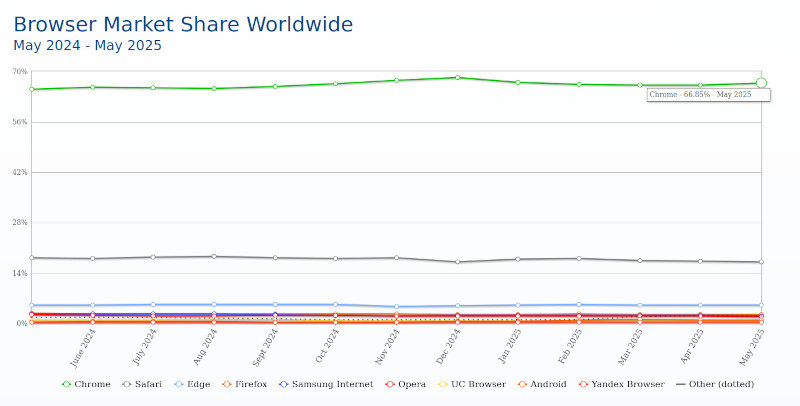

Мировой рынок веб-браузеров за период с июня 2024 года по май 2025 года. Лидером уверенно остаётся Google Chrome с долей 66,85 % по состоянию на май 2025 года. Источник изображения: StatCounter Конкуренция на рынке браузеров остаётся высокой. После запуска на Android Comet вступит в прямую борьбу с лидерами рынка вроде Google Chrome и Mozilla Firefox, а также с новыми игроками, включая Arc Search и проект Dia от The Browser Company, который, как ожидается, будет представлен в течение года. Учитывая, что браузер Chrome занимает более 66,85 % мирового рынка и установлен на большинстве Android-устройств по умолчанию, Perplexity предстоит непростая задача — убедить пользователей сменить привычный интерфейс на их интеллектуального агента. Однако Perplexity делает ставку на то, что пользователи готовы к следующему этапу цифровой эволюции. Агентный поиск, в отличие от традиционного, предлагает не просто список ссылок, а персонализированный диалог с системой, уточнение запроса в реальном времени и выдачу итогового результата в виде готовой рекомендации, анализа или действия. На фоне релизов таких систем, как GPT-5 компании OpenAI и Gemini компании Google, модель взаимодействия «человек — агент — интернет» постепенно становится новой нормой. Именно в этот тренд и вписывается Comet, который должен стать не браузером в классическом понимании, а интеллектуальной навигационной платформой с глубокой интеграцией ИИ-инструментов. ИИ впервые превзошёл человека в гонке дронов

05.06.2025 [16:51],

Павел Котов

Группа учёных Делфтского технического университета (Нидерланды) отметила знаменательное событие в области дронов на автопилоте — управляемый искусственным интеллектом летательный аппарат впервые смог обойти пилотов-людей на международном соревновании. Это случилось на состязании A2RL Drone Championship 2025 в Абу-Даби.

Источник изображения: tudelft.nl В большом крытом помещении в столице ОАЭ прошли два престижных мероприятия, посвящённых гонкам дронов. В Falcon Cup Finals друг с другом соревновались пилоты-люди. А на A2RL Drone Championship демонстрировались самые быстрые дроны, управляемые ИИ. В гонке A2RL Grand Challenge состязались лучшие пилоты-люди с самыми быстрыми навигационными системами ИИ. Абсолютным победителем вышел аппарат, созданный инженерами из Нидерландов. Залогом их успеха стал прошедший тонкую настройку ИИ, «способный к эффективному управлению за доли секунды». Состязание проходило на извилистой трассе, где дроны разгонялись до 95,8 км/ч — на таких скоростях каждое движение должно быть отточенным, а ошибки недопустимы. Дроны с ИИ-навигаторами имели некоторые технические ограничения — в их распоряжении была только одна камера и один датчик движения, чтобы уравнять шансы с людьми. Создатели навигационных систем были также ограничены по времени, вычислениям и объёмам энергии. Важным нововведением при разработке дрона стала глубокая нейросеть, которая отправляла команды не на контроллер, которым обычно пользуется человек, а прямо на двигатели машины. Такой механизм помог создать очень эффективную модель ИИ, которой было достаточно ограниченного числа датчиков на борту дрона. Более того, эта технология позволила подойти к «пределам физических возможностей системы». Достижение может отразиться на практическом применении не только дронов, но и других машин с автономной навигацией, включая роботов и автомобили. Amazon тайно разрабатывает роботов с ИИ, которые смогут выполнять задачи полностью самостоятельно

05.06.2025 [16:45],

Дмитрий Федоров

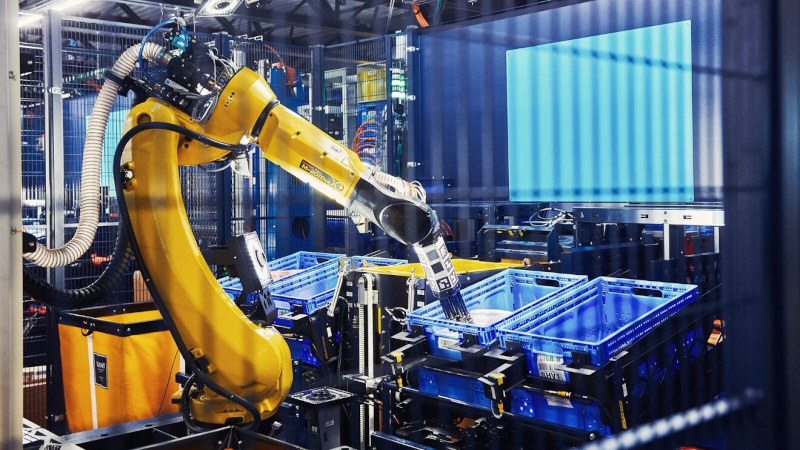

Amazon подтвердила, что в её закрытом исследовательском подразделении Lab126 создана новая исследовательская группа, занимающаяся разработкой робототехнических систем с интегрированным агентным ИИ. Её цель — вывести логистику на новый уровень за счёт машин, способных понимать команды на естественном языке и выполнять сложные задачи в автономном режиме.

Источник изображений: Amazon Подразделение Lab126 хорошо известно в отрасли как сердце НИОКР-проектов, которые Amazon хранит в строжайшей тайне до их выхода на рынок. Именно здесь были разработаны такие знаковые устройства, как Kindle и Echo. Теперь команда переориентируется на новую задачу: вывести роботов Amazon на уровень «агентности», то есть научить их слышать, понимать и выполнять команды человека на естественном языке. В отличие от существующих складских роботов, каждый из которых выполняет строго одну функцию, агентные роботы будут адаптивны и многофункциональны.  Йеш Даттатрея (Yesh Dattatreya), старший менеджер по прикладной науке в Amazon Robotics, в интервью изданию Reuters отметил, что главная цель проекта — сократить время доставки, особенно в периоды пикового спроса. Роботы нового поколения смогут не только разгружать трейлеры и сортировать товары, но и поднимать тяжёлые предметы в узких пространствах. Более того, Amazon рассчитывает, что внедрение таких систем позволит минимизировать производственные отходы и снизить углеродные выбросы.  Несмотря на публичное объявление, проект пока остаётся в стадии начальных прототипов. По словам Даттатреи, Amazon ещё не определилась с форм-фактором устройств, не называет сроков, ни масштабов внедрения. Тем не менее, инженеры компании уже закладывают основу архитектуры, способной в будущем трансформировать роботов Amazon в универсальных и автономных исполнителей.  У Amazon уже есть опыт в области агентного ИИ. В начале года её ИИ-лаборатория представила Nova Act — браузерного ИИ-агента, способного выполнять действия в интернете по командам пользователя. Ещё одно новшество — Alexa+, обновлённая версия голосового помощника, обладающая базовыми функциями агентности: запоминание целей, выполнение последовательных действий. Однако обе системы пока ограничены цифровым пространством и не взаимодействуют с физической средой.  Amazon также рассказала о разработке усовершенствованных картографических технологий, ориентированных на работу курьеров. Новые карты обеспечат высокую детализацию зданий, покажут потенциальные препятствия и предложат оптимальные маршруты доставки. Особое внимание уделяется сложным локациям: офисным комплексам и жилым кварталам с одинаковыми зданиями. Это решение должно значительно упростить навигацию и снизить время на поиск точек доставки заказов.  Amazon заявила, что планирует интеграцию этих карт с очками дополненной реальности для водителей доставки. Эти очки со встроенным дисплеем смогут отображать карту и прокладывать пошаговый маршрут в реальном времени. Об этом сообщил вице-президент и глава Amazon Maps and Geospatial Вираж Чаттерджи (Viraj Chatterjee). Он отметил, что устройство пока находится в стадии тестирования, но первые результаты уже демонстрируют эффективность технологии, особенно в зонах с однотипной архитектурой. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |