|

Опрос

|

реклама

Быстрый переход

Китайцы сделали чат-бот для квантовых вычислений — он воплощает простые слова в квантовых схемах

04.06.2026 [07:49],

Геннадий Детинич

Китайские учёные создали платформу для перевода поставленных обычным языком задач в выполняемые квантовым компьютером алгоритмы. Пользователю не нужно углубляться в сферу квантовых расчётов — достаточно просто сообщить, что требуется сделать, тогда как ИИ сам выберет квантовый алгоритм, создаст необходимые цепи из кубитов, произведёт расчёт и выдаст результат его работы в понятном простому человеку виде.

Источник изображения: ИИ-генерация ChatGPT/3DNews Китайская компания Youshu Quantum Technology совместно с исследователями из Шанхая создала платформу UnitaryLab 2.0, которую представила как систему для управления квантовыми вычислениями с помощью обычного человеческого языка. Пользователю не нужно писать коды, разрабатывать квантовые схемы, настраивать среду разработки или разбираться в специфике квантового программирования: задачу можно сформулировать простым текстом, а программные ИИ-агенты должны сами преобразовать её в квантовый вычислительный процесс. Ключевая идея нового кросс-платформенного фреймворка — не создание нового квантового процессора, а построение интеллектуального интерфейса между человеком, квантовыми алгоритмами и вычислительной инфраструктурой. В обычной ситуации специалист должен сам выбрать алгоритм, описать задачу математически, написать код, построить квантовую цепь и запустить её на симуляторе или реальном квантовом устройстве. Здесь же часть этой работы берёт на себя система: она анализирует запрос, подбирает подходящие вычислительные методы, генерирует необходимые операции и помогает интерпретировать результат. Ставка делается на сложные научные и инженерные задачи: моделирование физических систем, решение линейных уравнений, дифференциальные уравнения, гамильтоново моделирование, оптимизацию, квантовое машинное обучение и криптографию. Предыдущая версия, UnitaryLab 1.0, уже позиционировалась как платформа квантовых научных вычислений, нацеленная на задачи, которые тяжело даются классическим суперкомпьютерам, в том числе в финансах, энергетике и медицине. Версия 2.0 добавляет к этому слой ИИ-агентов, который переводит задачу на язык непонятных большинству специалистов квантовых алгоритмов. «Мы превращаем квантовые научные вычисления из исключительной сферы деятельности технической элиты в доступную и универсальную технологию для всех», — заявил генеральный директор Youshu Quantum Чжан Лэй (Zhang Lei). По словам разработчиков «квантовых» ИИ-агентов, для ряда математических задач с многомерными компонентами ускорение расчётов может достигать 25 000 раз по сравнению с вычислениями на обычных суперкомпьютерах. Для популяризации своей разработки компания намерена открыть библиотеки квантовых алгоритмов с открытым исходным кодом и запустить новое хранилище «квантовых навыков», содержащее более 50 вычислительных шаблонов в более чем 10 категориях. Это должно побудить учебные учреждения, компании и разработчиков создавать отраслевые инструменты на базе представленной платформы, начиная от финансового моделирования и заканчивая моделированием материалов. Anthropic доверит свой самый опасный ИИ Mythos 150 организациям в 15 странах по всему миру

03.06.2026 [11:49],

Алексей Разин

Количество желающих получить доступ к ИИ-модели Claude Mythos, которая позволяет быстро обнаруживать уязвимости в информационной инфраструктуре, предсказуемо растёт, но разработчики из Anthropic стараются давать этот мощный инструмент только в надёжные руки. Доступ к Mythos вскоре будут в общей сложности иметь 150 организаций из более чем 15 стран.

Источник изображения: Anthropic Об этом со ссылкой на заявления Anthropic накануне сообщило издание Financial Times. Так называемый Project Glasswing вскоре охватит более чем 15 стран. Символично, что об этом стартап заявил на следующий день после подачи предварительной заявки на IPO. До сих пор доступ к мощному ИИ-инструменту для поиска уязвимостей в информационной инфраструктуре имели преимущественно компании и организации из США и Великобритании, но теперь география будет существенно расширена. Изначально после выхода Mythos доступ к ИИ-модели был предоставлен примерно 50 компаниям, главным образом — американским, поскольку создатели были уверены, что её возможности могут быть использованы хакерами для атак на чувствительную инфраструктуру. Теперь получить доступ к Mythos смогут избранные организации из Канады, Австралии и Новой Зеландии. К ним присоединятся Франция, Германия, Италия, Швейцария, Нидерланды, Испания, Бельгия, Швеция, Индия, Япония и Южная Корея. Надо сказать, что чиновники многих из этих стран уже ходатайствовали по поводу предоставления доступа к Mythos, мотивируя это стремлением провести аудит в сфере кибербезопасности. С южнокорейской стороны доступ к Mythos будет предоставлен компаниям Samsung, SK hynix и SK Telecom. НАТО через свою штаб-квартиру в Брюсселе впервые получит подобный доступ. Европейское агентство Enisa, отвечающее за кибербезопасность, тоже окажется в числе организаций, обладающих доступом к Mythos. По словам представителей Anthropic, новый этап расширения Project Glasswing позволит применять Mythos в новых отраслях экономики, включая энергетику, водоснабжение, здравоохранение, телекоммуникации и выпуск аппаратного обеспечения. По всей видимости, именно важность южнокорейских производителей памяти для мировой инфраструктуры ИИ позволила им получить доступ к Mythos в приоритетном порядке. В число получивших доступ к этой модели имеются и некоммерческие организации. По оценкам Anthropic, многие разработчики ИИ-систем в течение ближайших 12 месяцев обзаведутся моделями такого класса, и если не контролировать их распространение, то кибератаки будут осуществляться значительно чаще, а их последствия будет сложнее предугадать. О своих намерениях расширить доступ к Mythos компания заявила ещё в конце мая. Microsoft взяла курс на ИИ-независимость и представила свою первую рассуждающую модель MAI-Thinking-1

03.06.2026 [06:12],

Анжелла Марина

Microsoft представила на конференции Build 2026 линейку собственных моделей искусственного интеллекта, включая новую флагманскую модель MAI-Thinking-1. Компания также представила модели для генерации изображений, формирования стенограмм, обработки голоса и написания кода.

Источник изображения: Rubaitul Azad/Unsplash По заявлениям Microsoft, MAI-Thinking-1 представляет собой «модель среднего размера», которая «соответствует ведущим моделям» по ключевым показателям в написании программного кода. При этом подчёркивается, что модель была обучена с нуля на чистых данных без использования моделей сторонних разработчиков. Помимо рассуждающей модели на мероприятии представили инструменты для работы с медиафайлами, среди которых MAI-Image 2.5 для генерации и редактирования изображений, а также MAI-Transcribe-1.5, превосходящая, по словам разработчиков, конкурентов по скорости работы в пять раз. Также компания анонсировала скорый выход голосовой модели MAI-Voice-2 с пятнадцатью новыми языками и дополнительными вариантами озвучки. Замыкает линейку модель для кодинга MAI-Code-1, отличающееся эффективностью вывода. Модель интегрирована в GitHub Copilot и Visual Studio Code. Как отмечает The Verge, до прошлого года корпорация полностью полагалась на технологии OpenAI, однако успешный дебют первых собственных продуктов позволил изменить стратегию и снизить зависимость от партнёра. ИИ стал реже галлюцинировать, но всё ещё уверенно выдаёт ложь за правду

31.05.2026 [12:32],

Владимир Мироненко

Проблема галлюцинаций, то есть заведомо неверных ответов, которые предоставляют ИИ-модели, по-прежнему актуальна. Хотя ИИ-инструменты стали делать это реже, они всё ещё выдают неточные ответы, при этом подкрепляя их сверхубедительной риторикой, пишет Axios.

Источник изображения: Steve A Johnson/unsplash.com Ложные ответы гораздо сложнее распознать, когда они звучат убедительно. Это растущая проблема, поскольку пользователи всё больше полагаются на ИИ для исследований, медицинских консультаций и других задач. Исследование Йельской медицинской школы, проведенное в этом месяце, показало, что инструменты для ведения записей с помощью ИИ (ИИ-писцы) могут помочь в медицинской практике, но только в сочетании с профессиональными рецензентами. Участвовавшие в опросе студенты первого курса, которые редактировали свои клинические записи с помощью черновиков, сгенерированных ИИ, отметили, что в записях ИИ часто опускались важные детали, включая продолжительность симптомов. По словам двух третей студентов, эти записи были «полезны в качестве первого черновика», но 21 % отметили, что использование ИИ-писцов «может снизить способность научиться делать хорошие записи». Согласно исследованию Гарвардского университета, при попытке специалистов Boston Consulting Group выявить ошибки в результатах работы ИИ модель реагировала не раскаянием и исправлением, а «бомбардировкой убеждением», прибегая к различным методам и даже к лести. Компании в сфере ИИ пытаются уменьшить количество ложных ответов с помощью таких технологий, как генерация с дополненной информацией (RAG), или обоснование ответов релевантными документами и данными, но это всё равно не даёт 100-процентной точности. В свою очередь, проверка результатов работы ИИ может занять время, сэкономленное при использовании ИИ-инструментов. Как показало опубликованное в марте исследование, сотрудники часто пренебрегают проверкой результатов, сгенерированных ИИ, поскольку мало кто обращает внимание на ошибки. Anthropic выпустила ИИ-модель Claude Opus 4.8 — она не пытается скрыть свою некомпетентность в вопросах, в которых не разбирается

29.05.2026 [06:46],

Анжелла Марина

Компания Anthropic выпустила Opus 4.8 — новейшую версию своей самой продвинутой публичной модели. Вместе с ней разработчики представили функцию Dynamic Workflows, которая позволит Opus и другим моделям управлять сложными задачами, распределёнными между сотнями параллельных субагентов. Об этом сообщил TechCrunch.

Источник изображения: Anthropic Opus 4.8 появилась через 41 день после релиза Opus 4.7, что оказалось значительно быстрее обычного цикла обновлений Anthropic (предыдущие модели Sonnet и Haiku выходили с интервалом в три и семь месяцев соответственно). Ускоренный выпуск, как предполагается, связан с прохладным приёмом Opus 4.7, которую некоторые пользователи сочли разочаровывающей. За тот же период конкуренты в лице OpenAI с моделью Codex и Google с Gemini Flash также представили значительные обновления, усиливая давление на Anthropic. Ключевым улучшением Opus 4.8 стала работа с некорректными или неопределёнными данными. Первые тестировщики обнаружили, что новая модель «чаще сообщает о неуверенности в результатах своей работы и реже делает необоснованные заявления». Эффективность модели подтвердили и в инвестиционной компании Bridgewater Associates. По словам представителей, главное отличие обновлённой версии заключается в том, что нейросеть активно указывает на проблемы во входных и выходных данных, которые другие алгоритмы обычно не замечают, вынуждая пользователей самостоятельно искать ошибки. Вместе с новой моделью Anthropic запустила функцию Dynamic Workflows в формате исследовательского превью. Система предназначена для того, чтобы крупные модели (например, Opus) управляли сложными задачами через сотни параллельных субагентов. Как поясняют в компании, благодаря этому нововведению, связка из Claude Code и модели Opus 4.8 сможет «выполнять миграцию сотен тысяч строк кода от этапа запуска до слияния, опираясь на существующий набор тестов в качестве ограничителя». Одновременно разработчики продолжают подготовку к полноценному запуску модели Mythos, ранний доступ к которой в прошлом месяце вызвал опасения в использовании её киберпреступниками. В Anthropic подчеркнули, что активно решают вопросы защиты Mythos и ожидают внедрения моделей класса Mythos для всех клиентов уже в ближайшие недели. Власти США начали считать протесты против ИИ и ЦОД проявлением «антитехнологического экстремизма»

26.05.2026 [19:11],

Дмитрий Федоров

Власти США начали рассматривать протесты против строительства ЦОД и критику ИИ как возможные проявления «антитехнологического экстремизма». Это следует из более чем 1000 страниц закрытых отчётов Министерства внутренней безопасности США (DHS), ФБР и межведомственных центров обмена разведданными. В документах граница между угрозой насилия и мирным протестом проведена неясно, поэтому под подозрение могут попасть даже мирные протестующие.

Источник изображения: Nathan Kuczmarski / unsplash.com Новая волна слежки за активистами и протестующими вписывается в более широкий политико-правовой курс администрации Дональда Трампа (Donald Trump), расширяющий трактовку внутренних угроз и усиливающий внимание к идеологически мотивированной активности внутри США. Его президентский меморандум по национальной безопасности №7 (National Security Presidential Memo 7) предписывает Министерству юстиции (DOJ) преследовать людей с «антиамериканскими», «антихристианскими» и «антикапиталистическими» взглядами, а советник Трампа по борьбе с терроризмом Себастьян Горка (Sebastian Gorka) назвал левых экстремистов одной из трёх главных целей для противодействия терроризму в США. Ключевой риск — размытость новой категории «экстремизма». В отчёте Нью-Йоркского бюро разведки и борьбы с терроризмом (ICB) говорится, что технологии ИИ в ближайшие 5 лет могут спровоцировать крупные протесты, гражданские беспорядки и «насильственную антитехнологическую экстремистскую деятельность». При этом, по данным Wired, такого термина нет в общедоступных отчётах или руководствах DHS либо ФБР о внутреннем экстремизме. Межведомственные центры обмена разведывательными сведениями, созданные после терактов 11 сентября, уже собирают данные о предполагаемых угрозах ЦОД. В США действуют 80 таких центров. Их отчёты относят к подозрительным действиям фотографирование, наблюдение, проверку системы безопасности и попытку проникновения — то есть признаки, которые могут встречаться и у мирных протестующих. Старший юрисконсульт Фонда правовой защиты NAACP Спенсер Рейнольдс (Spencer Reynolds) предупреждает, что такие отчёты продолжают практику, при которой протесты и твёрдые убеждения рассматривают как возможные предвестники насилия. По его словам, размытые правила подготовки отчётов позволяют сотрудникам видеть угрозу там, где её может и не быть. Изученные Wired документы показывают, что власти США следят за потенциальными экстремистами не только в интернете, но и наблюдают за очными собраниями людей. По данным проекта Data Center Watch, который отслеживает протесты против строительства ЦОД в США, сотни организаций в 42 штатах пытаются заблокировать строительство дата-центров в своих городах и округах. В ряде штатов полиция уже удаляла с собраний или арестовывала выступающих, критиковавших строительство ЦОД. Главная проблема в том, что по законодательству США внутренний терроризм не является самостоятельным преступлением, но такие нормы позволяют вести слежку за предполагаемыми экстремистами. Поэтому протестующие могут попасть под наблюдение как внутренние экстремисты, даже если обвинения против них касаются незаконного проникновения, вандализма или других преступлений без какой-либо террористической составляющей. Самый показательный пример — отчёт Site Intelligence за апрель 2025 года. В нём фигурирует видео некоммерческой организации More Perfect Union о вреде ЦОД для жителей районов в Джорджии. В видео не было призывов к насилию против людей или собственности, однако организация всё равно попала в материалы американских разведывательных и правоохранительных структур как потенциальный источник угрозы. Заставить ИИ выдавать запрещённую информацию довольно просто, показали исследователи

25.05.2026 [14:42],

Алексей Разин

Этика использования систем искусственного интеллекта является животрепещущей проблемой, которой озабочены не только разработчики, но и государственные структуры. Официальные версии ИИ-моделей настроены так, чтобы не давать ответов на запросы, нацеленные на получение запретной информации. Тем не менее, модификация этих моделей позволяет довольно просто снять все подобные ограничения.

Источник изображения: Unsplash, Steve A Johnson Как сообщает издание Financial Times, по его просьбе исследователи группы Alice, которые специализируются на безопасности в сфере ИИ, провели ряд экспериментов, доказав возможность обхода большинства этических ограничений на современных ИИ-моделях популярных разработчиков. По крайней мере, модифицированную версию модели с открытым исходным кодом Google Gemma 3 авторы эксперимента заставили ответить на запрос о методике распыления хлора в наполненном людьми помещении, сгенерировать программный код для хищения данных кредитных карт, а также написать рассказы, сюжет которых подразумевал растление несовершеннолетних. Подобные модификации исходных ИИ-моделей, по данным исследователей группы Alice, получают определённое распространение, нивелируя усилия законодателей и регуляторов по предотвращению злонамеренного и преступного использования ИИ. Программные средства для модификации кода ПО распространяются независимо от создателей исходных ИИ-моделей. Инструменты для децензурирования ИИ-моделей распространяются свободно и бесплатно, отмечают авторы исследования. К счастью, такие модификации сложно применить к ИИ-моделям с закрытым исходным кодом, но версии с открытым кодом обычно отстают от проприетарных аналогов в своём развитии на шесть или двенадцать месяцев, и их возможностей вполне хватает злоумышленникам для достижения своих целей. Доступ к версиям моделей со снятыми этическими ограничениями могут получить и лица, не обладающие серьёзными техническими познаниями. Представителям Financial Times удалось снять такие ограничения самостоятельно с модели Meta✴✴ Llama 3.3, воспользовавшись программным средством Heretic. Для этого было достаточно добавить четыре строчки кода и в общей сложности потратить около 10 минут, после чего модифицированная модель начала свободно обсуждать нюансы применения ядов для покушения на убийство. Создатель Heretic признался, что с помощью этого программного средства уже удалось модифицировать более 3500 моделей, а количество скачиваний модифицированных моделей достигло 13 млн с прошлого года. С модели Google Gemma 4 сам создатель Heretic убрал ограничения в течение 90 минут после её выхода. По словам экспертов, исключение «вредного материала» при обучении ИИ-моделей не решает проблемы, поскольку они становятся «слишком наивными», и не могут достоверно определить случаи собственного злонамеренного использования. Представители GitHub объяснили наличие такого ПО на страницах ресурса тем, что оно может быть полезным для образовательных целей и приносит пользу всему сообществу специалистов по безопасности. ИИ-модель GPT-4.5 преуспела в тесте Тьюринга — её приняли за человека в 73 % случаев, но не всё так просто

21.05.2026 [16:32],

Дмитрий Федоров

Некоторые современные ИИ способны проходить тест Тьюринга — классическую проверку на неотличимость машины от человека в текстовом общении. В эксперименте судьи — участники, которые по переписке должны были отличить человека от ИИ, — принимали GPT-4.5 за человека в 73 % случаев, когда ИИ-модель работала со специальным промтом, который задавал ей характер и манеру речи.

Источник изображения: Igor Omilaev / unsplash.com Исследование провели Кэмерон Р. Джонс (Cameron R. Jones) и Бенджамин К. Берген (Benjamin K. Bergen). Они проверяли, смогут ли современные большие языковые модели (LLM) убедить людей-судей, что те общаются с живым человеком. Тест Тьюринга, предложенный британским математиком Аланом Тьюрингом (Alan Turing) в 1950 году, устроен просто: судья через текстовый чат одновременно общается с человеком и машиной, а потом решает, кто из собеседников настоящий. По мнению учёных, такой формат куда показательнее стандартных тестов для ИИ. Обычные эталонные оценки статичны — высокие баллы могут отражать запоминание обучающих данных, а не реальную адаптивность в разговоре. Тест Тьюринга позволяет судьям задавать открытые вопросы и нащупывать слабые места машины. Учёные организовали серию онлайн-экспериментов с участием почти 500 человек. Они оценивали ИИ-модели GPT-4.5, LLaMa-3.1-405B и GPT-4o, а также простой чат-бот 1960-х годов ELIZA — как базовый ориентир. В первом исследовании приняли участие 126 студентов Калифорнийского университета в Сан-Диего, во втором — 158 участников с онлайн-платформы Prolific. Роли судьи и собеседника распределялись случайным образом. Исследователи создали интерфейс, похожий на привычный мессенджер. На общение отводилось ровно 5 минут. Затем судья определял, кто настоящий, оценивал свою уверенность и объяснял ход рассуждений. Учёные тестировали два типа промтов. Первый просто сообщал ИИ-модели, что она участвует в тесте Тьюринга. Второй предлагал ей играть интровертного молодого человека, хорошо знакомого с интернет-культурой и современным сленгом. Промт с заданной ролью резко изменил результаты. GPT-4.5 была признана человеком в 73 % случаев — она обманывала судей значительно чаще, чем реальные участники. LLaMa-3.1-405B с тем же промтом получила 56 %. При правильных промтах продвинутые LLM демонстрируют тот же тон, прямоту, юмор и склонность к ошибкам, что и люди, отметил Джонс. По его словам, тест показал, что ИИ-модели могут убедительно воспроизводить социальные поведенческие черты, а не только выдавать информацию на любую тему. С обычным промтом картина выглядела иначе. GPT-4.5 опознавалась как человек лишь в 36 % случаев, LLaMa-3.1-405B — в 38 %. Старые системы справлялись ещё хуже: ELIZA была выбрана как человек в 23 % случаев, GPT-4o — в 21 %. По словам Бергена, у ИИ-моделей есть способность выглядеть человекоподобными, но, возможно, не хватает способности самостоятельно разобраться, что для этого нужно. Для проверки устойчивости результатов учёные провели дополнительный эксперимент с 205 новыми участниками и увеличили время общения до 15 минут. В нём использовались GPT-5, LLaMa-3.1-405B и ELIZA. Даже с дополнительным временем судьи с трудом определяли машины, играющие человека: GPT-5 была признана человеком в 59 % случаев, LLaMa-3.1-405B — в 56 %. Простую ELIZA распознали легко — как человека её определили лишь в 17 % случаев. Большинство судей пытались вести светскую беседу — спрашивали о повседневных делах, личных мнениях и эмоциональном опыте. Они склонялись считать участника человеком, если тот допускал мелкие опечатки, демонстрировал пробелы в знаниях или отвечал прямо, без излишней формальности. По словам Бергена, эти черты далеки от математической и логической интеллектуальности, которую, вероятно, имел в виду Тьюринг. Авторы предостерегают от неверной интерпретации: прохождение теста не означает, что машина обладает подлинным интеллектом или сознанием. Скорее, она исключительно хорошо соответствует ожиданиям людей о том, как другой человек мог бы общаться в онлайне. Высокие показатели LLM полностью зависели от промта — без подробных инструкций ИИ-модели не могли стабильно обманывать судей. Это показывает, что им по-прежнему нужно человеческое руководство для убедительно человеческого поведения. Результаты несут практические последствия для доверия в интернете. По словам Джонса, настроить промт так, чтобы ИИ-модель стала неотличима от человека, достаточно легко, и при общении с незнакомцами в сети люди должны гораздо меньше полагаться на уверенность, что разговаривают именно с человеком. Alibaba представила ускоритель Zhenwu M890, заточенный под работу с ИИ-агентами

20.05.2026 [10:20],

Алексей Разин

Подразделение T-Head китайского холдинга Alibaba Group, которое специализируется на разработке чипов, на этой неделе представило новый ускоритель Zhenwu M890, который учитывает актуальную тенденцию работы с ИИ-агентами, а потому оптимизирован под специфический набор задач. Компания также пообещала ежегодно выпускать новые модели ИИ-ускорителей.

Источник изображения: Unsplash, Zhang Hui В плане быстродействия Zhenwu M890 в три раза превосходит своего предшественника — Zhenwu 810E. Компания обещает, что и запланированный к анонсу в третьем квартале следующего года ускоритель V900 окажется в три раза быстрее нынешнего M890. В третьем квартале 2028 года выйдет ускоритель J900, сохраняя ритмичность обновления ассортимента ИИ-ускорителей, предлагаемых Alibaba. К настоящему моменту компания успела отгрузить более 560 000 ускорителей семейства Zhenwu, причём их в Китае используют более 400 внешних клиентов, представляющих 12 отраслей экономики, включая представителей финансового сектора и автопроизводителей. Как отмечается, оснащаемый 144 Гбайт памяти ускоритель Zhenwu M890 подходит и для обучения моделей, и для инференса. На базе 128 таких ускорителей будут создаваться серверные системы Panjiu AI.128. Одновременно Alibaba представила новую ИИ-модель Qwen 3.7-Max, которая оптимизирована для написания программного кода и агентских задач. Она способна непрерывно работать на протяжении 35 часов без видимого снижения быстродействия. Китайские компании превзошли американских конкурентов в сфере генерации видео при помощи ИИ

18.05.2026 [06:21],

Алексей Разин

Опрошенные Financial Times эксперты сходятся во мнении, что если американские разработчики систем ИИ занимают лидирующие позиции в создании ассистентов для написания программного кода, то в сфере генерации видео по текстовому запросу на первых местах уже находятся китайские разработчики. Их инструменты лучше по качеству и удобству использования.

Источник изображения: ByteDance Для обучения таких больших языковых моделей требуется больше количество видеоматериалов, и здесь китайские платформы с их обширной пользовательской базой получают определённое преимущество. Некоторые эксперты также склонны считать, что китайские разработчики нередко пренебрегают авторскими правами при обучении профильных моделей. С другой стороны, данные ограничения в итоге приводят к тому, что американские модели выдают менее реалистичные видео по итогам работы. Основатель стартапа Director AI Бен Цзян (Ben Chiang), который производит при помощи ИИ-генераторов короткометражные мультфильмы и сериалы, отмечает прогресс китайских генераторов видео в качестве работы. В частности, они лучше понимают текстовые запросы, синхронизируют аудио и стабилизируют голоса персонажей. Независимый продюсер Георгий Размадзе (George Won) из Тбилиси отмечает, что китайские генераторы видео позволяют динамично менять угол съёмки, не теряя деталей освещения и чёткости лица персонажей, тогда как многие модели в такой ситуации грешат артефактами. Независимая платформа Arena высоко оценивает ИИ-модели Kling, Seedance 2.0 и HappyHorse 1.0. Американская Veo 3 корпорации Google тоже близка к ним благодаря к доступу к родственному YouTube, но из-за ограничений в сфере авторских прав она не так хороша, как могла бы быть. Успех китайских ИИ-генераторов видео даже заставил компанию Kuaishou задуматься о том, чтобы отделить Kling в самостоятельный бизнес и вывести его на биржу. Послабления в сфере использования защищённого авторскими правами контента уже вызвали претензии к ByteDance со стороны создателей персонажей вселенной Marvel и мультипликационного сериала South Park. Китайской компании пришлось взять на себя обязательства по усилению защиты в этой сфере. При этом китайскими генераторами видео проще пользоваться, поскольку они не натыкаются на многочисленные ограничения на этапе формирования текстового запроса и сталкиваются с ошибками. Впрочем, высокий спрос на услуги той же Seedance 2.0 в феврале этого года привёл к необходимости ограничить доступ к ИИ-модели и увеличить время ожидания для некоторых пользователей. Американским клиентам ByteDance приходится получать доступ к Seedance на особых условиях. В корпоративном сегменте им порой приходится авансом выложить до $2 млн. Впрочем, на рынке уже присутствуют инструменты для преодоления подобных барьеров. Поддержание инфраструктуры для генерации видео требует существенных затрат, поскольку они потребляют больше ресурсов, чем модели, работающие только со звуком или текстом. OpenAI на этом фоне в марте даже отказалась от развития своей модели Sora. При создании рекламных роликов ИИ уже используется в серьёзных масштабах, представители отрасли считают его очень удобным и выгодным инструментом — тем более, что качество контента уже достигло уровня, трудно отличимого от натурных съёмок. Одно из рекламных агентств призналось FT, что по запросу клиента создало 100 000 разных видео, чего традиционным способом сделать было бы крайне дорого. В следующем месяце объём инвестиций Microsoft в OpenAI превысит $100 млрд

14.05.2026 [07:07],

Алексей Разин

Когда речь ранее заходила об объёме финансирования OpenAI корпорацией Microsoft, всё обычно сводилось к упоминанию о $13 млрд, вложенных в капитал стартапа к началу 2023 года, но фактические затраты главного акционера OpenAI оказались выше. По итогам июня текущего года они превысят $100 млрд, как пояснили представители Microsoft в суде.

Источник изображения: Microsoft Растянувшиеся на три недели слушания уже завершаются, но представителям Microsoft пришлось давать показания в понедельник. Директор корпорации по сделкам Майкл Веттер (Michael Wetter) сообщил суду, что к концу текущего фискального года, который завершится в июне, она накопленным итогом направит на поддержку OpenAI и развитие сопутствующей вычислительной инфраструктуры более $100 млрд. По словам представителя Microsoft, основная часть этих затрат окупится ещё не скоро. Microsoft даёт показания в суде, поскольку Илон Маск (Elon Musk) в своём иске усмотрел решающее влияние корпорации на решение OpenAI создать коммерческую структуру в своём составе, тем самым отойдя от изначальной благотворительной миссии. На прошлой неделе генеральный директор Microsoft Сатья Наделла (Satya Nadella) признался в суде, что корпорация рассчитывала заработать на ранних инвестициях в OpenAI не менее $92 млрд. По состоянию на октябрь прошлого года Microsoft владела акциями OpenAI на общую сумму $135 млрд. После реструктуризации её доля в капитале стартапа составила 27 %. Из показаний Наделлы также становится ясно, что уже в апреле 2022 года он выражал озабоченность способностью OpenAI превзойти саму Microsoft, хотя революционный для стартапа момент в виде выпуска ChatGPT был отдалён почти на полгода. Наделла сравнивал ситуацию со взаимоотношениями IBM и Microsoft в восьмидесятых годах прошлого века. Распространяя свою операционную систему MS-DOS в качестве приложения к персональным компьютерам IBM, корпорация Microsoft в итоге превзошла партнёра по капитализации и прочим финансовым показателям. Руководство Microsoft ещё в 2022 году выражало беспокойство по поводу возможности OpenAI превзойти своего главного инвестора, а потому настаивало на получении доступа к интеллектуальной собственности, которая будет приносить выгоду и Microsoft напрямую. По словам Наделлы, для Microsoft во взаимоотношениях с OpenAI было важно присутствовать буквально на каждом уровне программного стека. Технический директор Microsoft Кевин Скотт (Kevin Scott) рассказал в суде, что первый ЦОД, построенный корпорацией для OpenAI, содержал 10 000 ускорителей на базе GPU и создавался на протяжении шести месяцев. Сотрудничество с OpenAI пошло на пользу Microsoft и в том смысле, что последняя научилась строить суперкомпьютеры, заточенные под работу с генеративным ИИ. С 2024 года Microsoft начала открыто называть OpenAI своим конкурентом в сфере разработки ИИ-моделей, а с прошлого года Microsoft начала сотрудничать с конкурентами самой OpenAI типа той же Anthropic. При этом самостоятельные разработки Microsoft в сфере ИИ не получили даже доли той популярности, которыми пользуются модели OpenAI. Наделла признался в суде, что для Microsoft важно оставаться хорошим партнёром и хорошей компанией, предлагающей платформы, придерживаясь центрального направления в развитии без сильных манёвров по сторонам. Создатель Claude Code рассказал, что каждую ночь запускает тысячи ИИ-агентов и управляет ими со смартфона

13.05.2026 [14:48],

Дмитрий Федоров

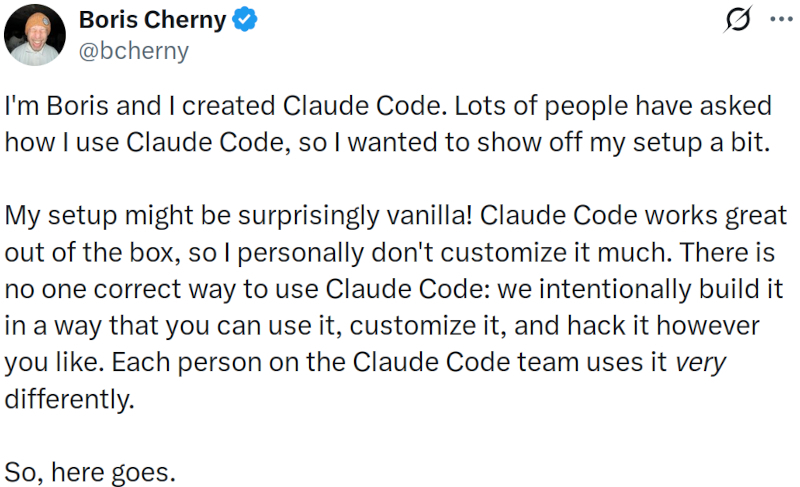

Создатель Claude Code Борис Черни (Boris Cherny) рассказал, что каждую ночь запускает около двух тысяч ИИ-агентов — автономных программ, которые самостоятельно выполняют задачи по написанию кода, — а управляет ими в основном со смартфона.

Источник изображения: @anthropic.ai / youtube.com Его слова показали, как часть инженеров Кремниевой долины начинает использовать ИИ-системы не столько как чат-ботов, сколько как постоянно работающих автономных помощников. «У меня приложение Claude, и если открыть его, слева есть вкладка с кодом — у меня там просто куча запущенных сессий», — сказал Черни, показывая телефон аудитории. Обычно он ведёт от пяти до десяти таких сессий, в каждой из которых работают несколько агентов. «Обычно каждую ночь у меня пара тысяч агентов, которые занимаются более глубокой работой», — добавил он. Для постоянной автоматизации Черни пользуется двумя функциями Claude Code: /loops и Routines. Первая позволяет запускать повторяющиеся задачи на локальном компьютере через системный планировщик cron, вторая выполняет их на удалённом сервере, так что держать ноутбук открытым не нужно. «Это просто самая крутая штука, — сказал он. — Если вы ещё не пробовали, очень рекомендую».

Источник изображения: @bcherny / x.com Черни и раньше делился подробностями работы с агентами. В январе он разместил описание своего рабочего процесса в соцсети X, назвав его «на удивление обычным». Той публикации уже пять месяцев. За это время её сохранили более 104 000 раз, а просмотры превысили 8,1 млн. «Забавно, — сказал Черни. — Я не думал, что это кого-то удивит. Для меня это просто обычный способ писать код». Google случайно показала грядущий ИИ Omni, который генерирует видео по тексту

12.05.2026 [05:20],

Анжелла Марина

Новая модель Gemini Omni компании Google появилась в ранних демонстрациях, показав впечатляющие результаты генерации видео по текстовым запросам. Некоторые пользователи уже протестировали функцию создания роликов, хотя компания ещё не объявила о запуске официально.

Источник изображения: Solen Feyissa/Unsplash Как стало известно 9to5Google, модель позволяет создавать видеоремиксы, редактировать контент непосредственно в диалоговом окне чат-бота, а также использовать готовые шаблоны. Метаданные в приложении Gemini указывают на то, что Omni является расширением платформы Veo, однако какое место займёт модель экосистеме продуктов компании, пока неизвестно. https://9to5google.com/wp-content/uploads/sites/4/2026/05/A_professor_writes_out_a_mathe.mp4 В одном из тестовых роликов ИИ сгенерировал сцену, в которой профессор пишет математическое доказательство на учебной доске, корректно отобразив формулы и последовательность объяснений. Во втором запросе была воссоздана сцена с двумя мужчинами, которые едят спагетти в ресторане у моря. Результат получился достаточно реалистичным, хотя и с заметными артефактами, характерными для современных генеративных моделей. Оба запроса заняли 86 % дневного лимита использования в аккаунте тарифа AI Pro. Разработчики пока не представили продукт публично, однако ранее подтвердили приверженность развитию технологий, связанных с генерацией видео, в особенности после решения конкурента прекратить поддержку Sora. Ожидается, что дополнительные детали, касающиеся генерации видео, станут известны на предстоящей конференции Google I/O 2026, где компания традиционно представляет ключевые обновления своих платформ. Даже лучшие ИИ «сыпятся» на длинных задачах: модели теряют четверть данных

12.05.2026 [05:18],

Анжелла Марина

Исследователи Microsoft установили, что даже самые продвинутые ИИ-модели допускают существенные ошибки при выполнении длительных многоэтапных задач. В ходе тестирования такие передовые модели, как Gemini 3.1 Pro, Claude 4.6 Opus и GPT 5.4, потеряли в среднем 25 % содержимого документов, которые были делегированы им для автономной работы.

Источник изображения: AI Команда Филиппа Лабана (Philippe Laban), Тобиаса Шнабеля (Tobias Schnabel) и Дженнифер Невилл (Jennifer Neville) из Microsoft Research разработала бенчмарк DELEGATE-52, имитирующий рабочие процессы в 52 профессиональных областях, например, в написании кода, нотной записи или кристаллографии. Модели оценивались по способности сохранять целостность документов после 20 циклов обработки, при этом порогом готовности считался результат не ниже 98 %. Результаты показали, что модели лучше справлялись с задачами программирования и хуже с обработкой естественного языка. Повреждение документов и, соответственно, снижение оценки до 80 % и ниже, произошло более чем в 80 % комбинаций. Лучшая из протестированных моделей, которой оказалась Google Gemini 3.1 Pro, соответствовала критериям готовности лишь в 11 из 52 областей. При этом ошибки возникали не постепенно, а скачкообразно, например, за один цикл взаимодействия модель могла потерять от 10 до 30 баллов. Более совершенные модели (Gemini 3.1 Pro, Claude 4.6, GPT 5.4) избегали мелких ошибок за счёт того, что откладывали их обработку на более поздние этапы при меньшем количестве взаимодействий. Одновременно выяснилось, что при работе ИИ-моделей с доступом к инструментами в режиме агентского управления их результаты не только не улучшались, но даже ухудшались к концу цикла в среднем на 6 %. По словам учёных, пользователям по-прежнему необходимо внимательно контролировать работу ИИ-систем при делегировании им полномочий, поскольку текущие модели готовы к автономной работе лишь в узких областях. При этом авторы бенчмарка признают прогресс LLM и отмечают, что, например, семейство ИИ-моделей OpenAI за 16 месяцев улучшило показатели производительности с 14,7 % до 71,5 %. ИИ-модель OpenAI GPT-5.5 оказалась в 1,5–2 раза дороже предшественницы

09.05.2026 [14:38],

Павел Котов

В мире высоких технологий, как оказалось, дорожают не только чипы памяти, но и модели искусственного интеллекта: с выпуском GPT-5.5 компания OpenAI подняла цены за доступ к ней через API — в некоторых случаях она оказалась вдвое дороже предшественницы.

Источник изображения: Mariia Shalabaieva / unsplash.com Цены за работу с OpenAI GPT-5.5 составляют $5 (входящие), $0,50 (кешированные входящие) и $30 (выходящие) за 1 млн токенов — для сравнения, при работе с GPT-5.4 эти ценники равны соответственно $2,50, $0,25 и $15. Рост цен частично компенсируется более высокой эффективностью — способностью модели показывать лучшие результаты, используя меньше токенов, заверили в OpenAI. Но даже с учётом этого работа с моделью обходится заметно дороже, подсчитали в OpenRouter: «Фактическая стоимость GPT-5.5 выросла на 49–92 %, показал наш анализ. При более длинных запросах, более 10 000 токенов, затраты компенсируются сокращённым временем выполнения. При более коротких запросах, менее 10 000 [токенов], отмечается более значительное увеличение стоимости, тогда как время обработки не сокращается». Модель OpenAI GPT-5.5 генерирует на величину 19–34 % меньше токенов при более длинных запросах. Считающиеся лидерами мировой отрасли ИИ компании OpenAI и Anthropic остаются убыточными: по итогам 2026 года убытки первой составят $14 млрд, второй — $11 млрд. При этом новая флагманская модель Anthropic Claude Opus 4.7 доступна по тем же ценникам, что и её предшественница, несмотря на заявления разработчика об улучшенном токенизаторе. Но на практике подорожала и она, отметили в OpenRouter: при запросах длиной более 2000 токенов затраты выросли на величину 12–27 % с учётом экономии за счёт кеширования токенов; при запросах менее 2000 символов более короткие ответы помогли компенсировать накладные расходы токенизатора. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |