|

Опрос

|

реклама

Быстрый переход

GPT-5.2 обошла абитуриентов, сдав вступительные экзамены в Токийский и Киотский университеты лучше всех

27.04.2026 [14:35],

Анжелла Марина

Нейросеть GPT-5.2 в режиме размышления получила высшие баллы на вступительных экзаменах в Токийском и Киотском университетах Японии, опередив реальных абитуриентов этого года. Компания LifePrompt, проводившая тесты, сообщила, что нейросеть превзошла максимальные проходные результаты даже на самых конкурентных медицинских направлениях.

Источник изображения: xAI LifePrompt протестировала модель GPT-5.2 Thinking, загрузив вопросы экзаменов в виде изображений. Развёрнутые ответы, включая эссе, оценивали преподаватели одной из крупнейших частных подготовительных школ Kawai Juku. На медицинском направлении Токийского университета (Natural Sciences III) искусственный интеллект набрал на 50 баллов больше, чем лучший реальный участник, и получил идеальный результат по математике. Этому успеху, как отмечает портал Kyodo News, предшествовала неудачная попытка пройти те же испытания с помощью модели GPT 4 в 2024 году, а затем, в 2025 году, всё-таки успешно преодолеть проходной балл с помощью модели o1. В разделе гуманитарных и естественных наук Токийского университета нейросеть также показала выдающиеся результаты. Она набрала 452 балла из 550 возможных в гуманитарном блоке и 503 балла в естественно-научном, превысив рекорды зачисленных студентов. Однако эффективность ИИ оказалась неравномерной: если по английскому языку результат составил 90 %, то по эссе, касающемуся всемирной истории — лишь 25 %. Аналогичное превосходство было зафиксировано и в Киотском университете, где алгоритм тестировали на факультетах права и медицины. На юридическом факультете ИИ получил 771 балл при максимальном проходном пороге в 734, а на медицинском — 1176 баллов против рекорда лучшего абитуриента в 1098 баллов. Глава LifePrompt Сатоши Эндо (Satoshi Endo) отметил, что компаниям необходимо внедрять ИИ с прицелом на изменение бизнес-процессов в ближайшие десятилетия. В то же время профессор Университета Кейо Сатоши Курихара (Satoshi Kurihara) предостерёг от прямого сравнения людей и машин, указав на преимущество человека в создании новой ценности. Он добавил, что высокие оценки ИИ должны стать поводом для пересмотра экзаменационных систем. DeepSeek снизила на 75 % цены за доступ к ИИ-модели DeepSeek-V4-Pro

27.04.2026 [12:48],

Дмитрий Федоров

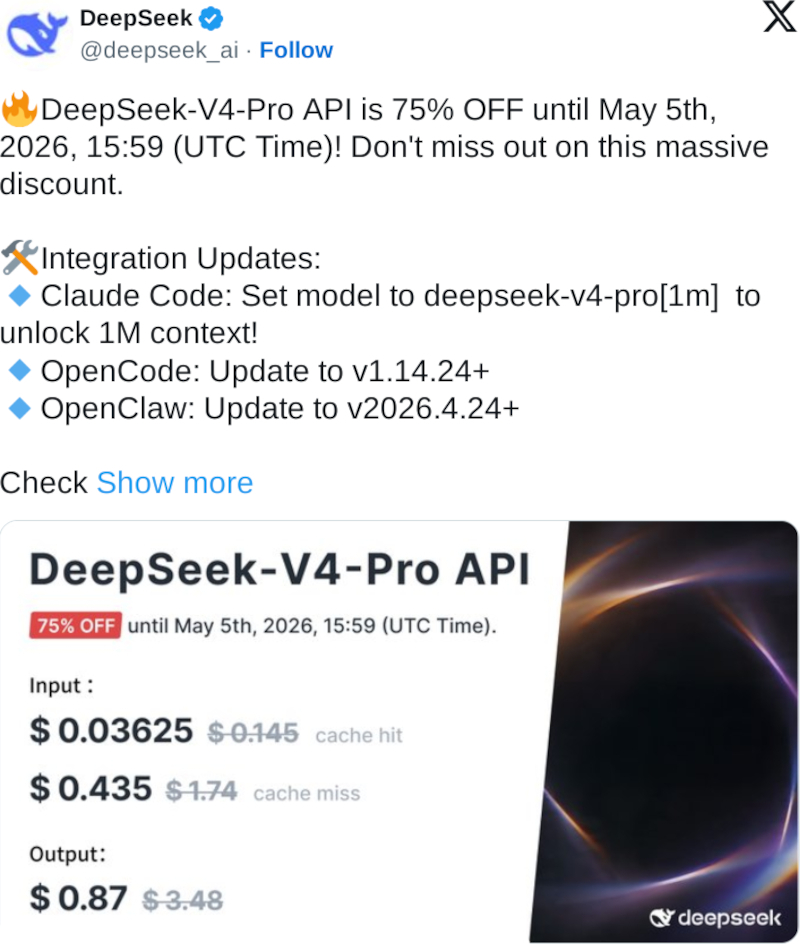

DeepSeek предложила разработчикам скидку 75 % на новую флагманскую ИИ-модель DeepSeek-V4-Pro. Одновременно китайская компания в 10 раз удешевила повторные и похожие запросы на всех своих платформах за счёт кеширования входных данных.

Источник изображения: deepseek.com Резкое снижение цен DeepSeek грозит вернуть ИИ-индустрию к ценовой войне, которая вспыхнула после того, как DeepSeek устроила переполох в Кремниевой долине своей ИИ-моделью R1 в начале прошлого года. OpenAI, Anthropic и Google наперегонки выпускают новые ИИ-продукты, но их использование обходится дорого. Китайские компании рассчитывают, что разница в тарифах ускорит переход разработчиков на их платформы и изменит расклад сил в технологическом соперничестве с США.

Источник изображения: @deepseek_ai / x.com Однако DeepSeek рассчитывает привлечь пользователей не только ценой. Контекстное окно DeepSeek-V4 — максимальный объём данных, который модель обрабатывает за один раз, — позволяет работать со сложными кодовыми базами и объёмными документами. Модель легко подключается к Claude Code, OpenClaw и OpenCode, что упрощает её взаимодействие с более широкой ИИ-экосистемой. «Ценообразование, открытый исходный код и контекстное окно в миллион токенов снижают порог входа для разработчиков, стартапов и малого бизнеса», — сказал Акшар Керемане (Akshar Keremane), сооснователь ИИ-стартапа O-Health. По словам Керемане, раньше разработчики не могли экспериментировать с моделями такого уровня и масштаба. США призвали всех активнее бороться с дистилляцией американских ИИ-моделей китайцами

25.04.2026 [08:22],

Алексей Разин

На этой неделе американские законодатели продвинулись чуть дальше в согласовании пакета законопроектов, направленных на сдерживание технологического развития КНР. Помимо заявлений на парламентском уровне, по дипломатическим каналам в посольства США по всему миру была направлена телеграмма, призывающая обратить внимание на проблему дистилляции американских ИИ-моделей китайскими разработчиками.

Источник изображения: Unsplash, Solen Feyissa Напомним, под «дистилляцией» в данном контексте понимается процесс использования более зрелых американских больших языковых моделей для дообучения китайских. Это ускоряет процесс создания конкурирующих ИИ-моделей в Китае, позволяя с меньшими затратами ресурсов и времени получать сопоставимые по производительности программные решения в сфере ИИ. По мнению американских экспертов, некоторые китайские разработчики преподносят свои ИИ-модели как оригинальные, но в действительности они в процессе обучения активно полагались на выдаваемые американскими моделями данные. Если американские законодатели добьются усиления контроля за блокировкой такой деятельности зарубежных разработчиков, то некоторые китайские ИИ-стартапы вынуждены будут покинуть рынок в течение шести или двенадцати месяцев, по мнению экспертов, опрошенных South China Morning Post. Даже более самостоятельные китайские разработчики могут пострадать в результате ограничения доступа к американским ИИ-моделям, поскольку совершенствование собственных моделей они ускоряют как раз за счёт «дистилляции». Новые версии китайских моделей, которые сейчас появляются раз в три месяца, в итоге будут готовиться к выходу год и более. Выступая на парламентских слушаниях в США на этой неделе, бывшая член совета директоров OpenAI Хелен Тонер (Helen Toner) подчеркнула, что было бы ошибкой недооценивать потенциал китайских разработчиков ИИ, которые обладают большим потенциалом инноваций и без доступа к дистилляции. При этом ряд американских компаний, включая OpenAI, Google и Anthropic на протяжении последних месяцев выступали с обвинениями китайских конкурентов в «дистилляционных атаках». Хотя сама по себе такая методика обучения ИИ-моделей не считается незаконной, как метод конкурентной борьбы она требует некоторого законодательного регулирования, по мнению многих участников рынка. Американские законодатели также намерены добиваться усиления контроля за экспортом технологий производства полупроводниковых компонентов в Китай. Новая инициатива властей США подразумевает усиление ограничений на поставку в КНР оборудования для выпуска чипов. Разумеется, данные шаги со стороны американских парламентариев не остались без внимания китайских властей. По традиции, усилия американских оппонентов по «обеспечению национальной безопасности» в Китае назвали ширмой, прикрывающей намерения продвигать американские интересы во внешнеторговой сфере в ущерб другим участникам рынка. Полупроводниковая отрасль только пострадает от этих действий американских регуляторов, как подчёркивают китайские чиновники. Власти КНР оставляют за собой право защищать интересы национальных компаний при помощи ответных мер, которые пока не конкретизируются. Представлена DeepSeek V4 — открытая ИИ-модель, которая потягается с лучшими решениями OpenAI и Google

24.04.2026 [11:43],

Владимир Фетисов

Китайская компания DeepSeek выпустила предварительную версию большой языковой модели V4. Релиз состоялся спустя более чем год после того, как DeepSeek представила свою модель с поддержкой рассуждения R1, которая потрясла глобальные технологические рынки благодаря высокому уровню производительности и экономической эффективности. Также интересно, что DeepSeek V4 вышла через несколько часов после анонса OpenAI GPT-5.5.

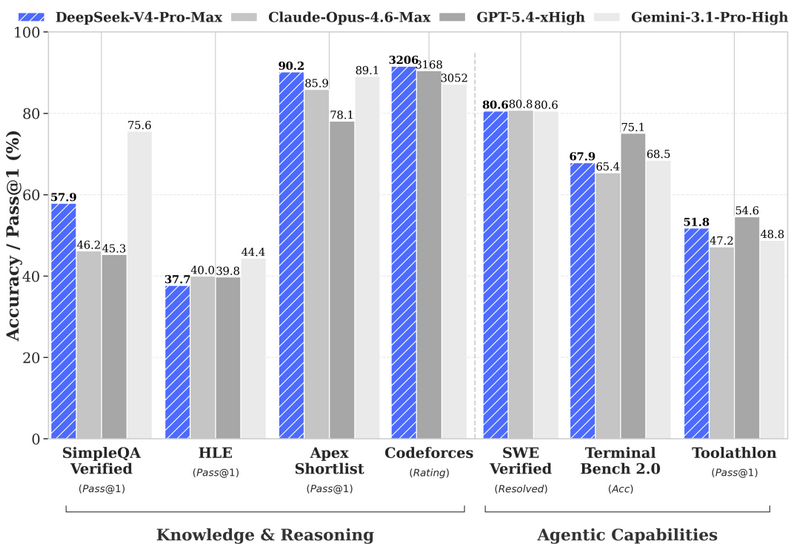

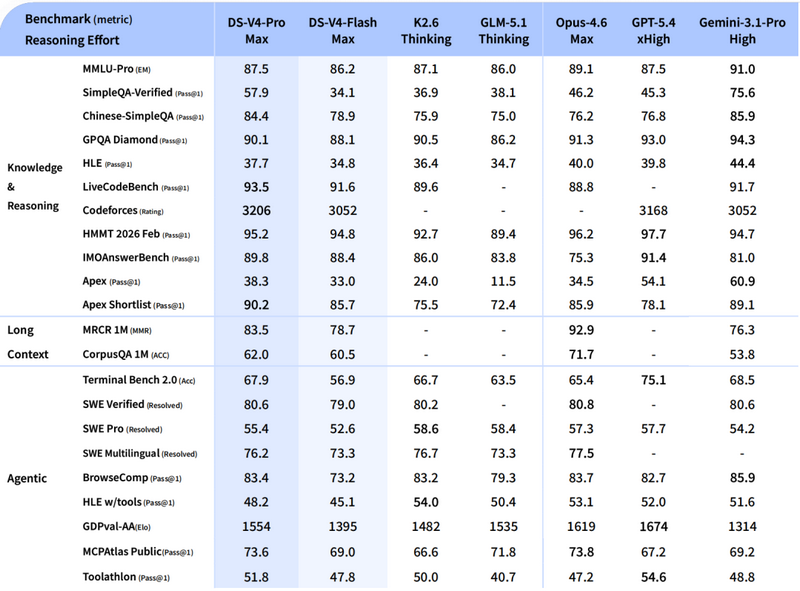

Источник изображения: AI Как и предыдущая модель DeepSeek V3, новая версия алгоритма имеет открытый исходный код, что позволяет разработчикам разворачивать нейросеть локально и модифицировать её по собственному усмотрению. DeepSeek заявила, что V4 демонстрирует высокую производительность по сравнению с китайскими конкурентами, особенно в агентных задачах, обработке данных и логических выводах. В дополнение к этому DeepSeek V4 оптимизирована для использования с популярными ИИ-агентами, такими как OpenClaw и Anthropic Claude Code. Доступны версии «pro» и «flash», отличающиеся размером и производительностью. DeepSeek-V4-Pro предлагает 1,6 триллионов параметров (49 миллиардов активных) и производительность, «сопоставимую с лучшими в мире закрытыми моделями». DeepSeek-V4-Flash обеспечивает только 284 млрд параметров, из которых 13 млрд активных.  Версия Pro превосходит все существующие открытые модели в математике и программировании, и способна потягаться здесь даже с лучшими закрытыми моделями. А знания о мире этой модели «уступают только Gemini 3.1 Pro». В свою очередь версия Flash даёт возможности рассуждения близкие к уровню V4-Pro, и выполняет простые задачи в режиме агента на уровне V4-Pro. DeepSeek основана в 2023 году, а внимание компания привлекла в 2024 году, когда выпустила бесплатную ИИ-модель V3 с открытым исходным кодом. Этот алгоритм оказался экономически эффективным, поскольку на его создание ушло значительно меньше средств по сравнению с западными конкурентами, например, от OpenAI и Google.  В январе 2025 года DeepSeek выпустила модель R1, которая показала аналогичную производительность или превзошла многих конкурентов. Модель R1 встревожила инвесторов, когда DeepSeek объявила, что на её создание с использованием не самых мощных ускорителей Nvidia потребовалось всего два месяца и менее $6 млн. Это поставило под сомнение лидерство США в сфере ИИ, а также огромные расходы технологических компаний на инфраструктуру для ИИ. Аналитик MorningStar Айвен Су (Ivan Su) считает, что алгоритм V4 вряд ли окажет на индустрию такое же влияние, как R1, поскольку рынки учли то, что китайский ИИ конкурентоспособен и дешевле в использовании. Он добавил, что новая позиция DeepSeek делает другие китайские ИИ-модели с открытым исходным кодом прямыми конкурентами. «Такой формулировки не существовало во времена R1, и уже это говорит о том, насколько усилилась внутренняя конкуренция», — добавил Су. Главный вопрос после запуска DeepSeek V4 в том, какие ускорители использовались для обучения модели. Китайский технологический гигант Huawei на этой неделе подтвердил, что его новейший вычислительный ИИ-кластер, работающий на ускорителях Ascend, может поддерживать модель DeepSeek V4. Однако не ясно, в какой степени ускорители Huawei использовались для обучения новой ИИ-модели. Новые модели DeepSeek уже доступны в веб-версии и приложении чат-бота DeepSeek, где режим Instant основан на V4-Flash, а Expert — на V4-Pro. Разработчики также получили доступ к новинкам через API. Регуляторы увидели в ИИ-модели Anthropic Mythos угрозу для банковской системы

20.04.2026 [12:22],

Алексей Разин

В лучших традициях фантастических сюжетов про «восстание машин», стартап Anthropic открыл доступ к специализирующейся на поиске уязвимостей в ПО модели Mythos лишь ограниченному кругу пользователей. Тем не менее, представители монетарных систем некоторых стран считают, что даже в таком ограниченном применении Mythos может представлять угрозу для банковской системы.

Источник изображения: Anthropic По меньшей мере, как отмечает Reuters, регуляторы считают, что Mythos можно использовать для дестабилизации банковской системы через поиск уязвимостей в сфере кибербезопасности. Австралийская комиссия по ценным бумагам и инвестициям (ASIC) через своего представителя заявила, что пристальным образом обменивается данными с регулирующими органами других стран с целью определения возможных сфер применения Mythos на австралийском рынке. Правительственные агентства и представители финансового сектора тоже участвуют в консультациях. Лицензиаты подобных сервисов в финансовом сегменте рынка, по мнению ASIC, должны быть «на шаг впереди всех» при обеспечении защиты интересов своих клиентов. Австралийский банковский регулятор APRA также анализирует возможное влияние подобных технологий на стабильность и безопасность финансовой системы. В Южной Корее Комиссия по финансовым услугам (FSC) также провела в минувшую среду экстренное совещание со специалистами в сфере информационной безопасности, чтобы оценить исходящую от Mythos угрозу для участников финансового рынка. В условиях активной цифровизации финансовых услуг забота о безопасности в профильной сфере обретает всё большее значение, учитывая бурное развитие искусственного интеллекта. АНБ США продолжает использовать Anthropic Mythos, несмотря на запрет

20.04.2026 [10:11],

Алексей Разин

Пока правительство США пытается определиться, можно ли дальше использовать разработки компании Anthropic в условиях объявления её источником риска для национальной безопасности, отдельные ведомства продолжают работать с ИИ-моделями этого разработчика, и Агентство национальной безопасности (АНБ) является одной из таких «непокорных» правительственных структур.

Источник изображения: Anthropic Как сообщило издание Axios, Агентство национальной безопасности США использует одну из самых производительных ИИ-моделей Anthropic — Mythos Preview, хотя прекрасно осознаёт, что курирующее работу ведомства Министерство обороны США неодобрительно относится к такой практике. Складывается, по словам источника, парадоксальная ситуация: с одной стороны, американские военные расширяют использование продуктов Anthropic, а с другой — пытаются в суде доказать, что они представляют угрозу для национальной безопасности Соединённых Штатов. Минимум два источника подтвердили Axios, что внутри АНБ модель Mythos для поиска уязвимостей в программном обеспечении не только используется, но и в определённом смысле набирает популярность. Обычно данный инструмент используется при аудите собственной программной инфраструктуры на предмет поиска слабых мест. Сама Anthropic ограничила круг доступа к Mythos примерно 40 организациями, которые могут применять ИИ-модель ответственно и безопасно. Из этих организаций названы были лишь 12, поэтому АНБ может попасть в оставшуюся часть выборки. Некоторые из них находятся за пределами США — в частности, в Великобритании. Важность данного программного инструмента подчёркивается и тем фактом, что глава Anthropic Дарио Амодеи (Dario Amodei) отправился в пятницу на встречу с высокопоставленными американскими чиновниками, и темой переговоров стало именно использование Mythos правительственными структурами. Предполагается, что по итогам встречи должен быть определён порядок предоставления доступа к Mythos прочим организациям, помимо Пентагона. ИИ показал прогресс в изучении редких и малоизвестных языков

18.04.2026 [14:44],

Павел Котов

Большие языковые модели искусственного интеллекта стали активно сокращать языковой разрыв по всему миру — самые передовые добились существенных успехов в работе с редкими языками, которые представляли сложности для предшествующих систем. Об этом сообщил TechRadar со ссылкой на исследование компании RWS.

Источник изображения: bennett tobias / unsplash.com Модель Google Gemini Pro получила высокие оценки качества (выше 4,5 из 5 баллов) в знании языка киньяруанда, на котором говорят 12 млн человек в Руанде, Уганде и Демократической Республике Конго. Прогресс авторы исследования объяснили тем, что ИИ часто обращается к общим статистическим закономерностям разных языков. Передовым моделям уже не требуются огромные наборы информации для каждого языка — ограниченные объёмы обучающих данных компенсируются за счёт механизмов межъязыкового переноса. Ещё один положительный фактор — улучшения в работе токенизатора, то есть средства, которое разбивает слова из запросов на фрагменты, называемые токенами. Всё это помогает моделям ИИ качественнее работать с редкими и малоизвестными языками. В ходе исследования эксперты обнаружили эффект «дрейфа бенчмарка», при котором возможности моделей неожиданно меняются при переходе от одной версии к другой. Так, последняя версия OpenAI GPT отстаёт от более мелких в нескольких задачах на генерацию контента, хотя её предшественница оказывалась более эффективной в тех же задачах. Эффективность токенизатора также может сильно отличаться между поколениями моделей — при работе с определёнными языками одна оказывается в 3,5 раза экономичнее другой. То есть при выборе модели для развёртывания в многоязычных приложениях полагаться на результаты тестов предыдущих систем не следует. До недавнего времени многие лаборатории ИИ отдавали приоритет показателям производительности на английском и нескольких других основных языках мира; современные модели в значительной мере преуспели в этих областях, разработчики начинают отдавать приоритет охвату широкой аудитории, и, как ожидают эксперты, этому примеру будут следовать многие. При этом оценка в 4,5 балла из 5 не гарантирует реального уровня владения языком, и многоязычная поддержка до сих пор не стала предметом первой необходимости. Разработчики обращаются к материалам на редких языках отчасти и потому, что англоязычные источники уже исчерпаны. Но всё-таки ИИ продолжает разрушать языковые барьеры. OpenAI представила ИИ-модель GPT-Rosalind для учёных-биологов

17.04.2026 [12:45],

Павел Котов

OpenAI анонсировала большую языковую модель искусственного интеллекта, специально обученную для работы в области биологической науки. Она получила название GPT-Rosalind, и это редкий случай, когда крупная технологическая компания выпускает модель, ориентированную на относительно узкий круг научных знаний.

Источник изображения: Growtika / unsplash.com Система разработана для решения двух основных проблем, с которыми сталкиваются современные исследователи в области биологии. Первая — это огромные массивы данных, сформированные за несколько десятилетий секвенирования генома и белков, которые могут оказаться слишком обширными для отдельного исследователя. Второе — наличие множества узкоспециализированных разделов биологической науки, у каждого из которых есть собственные методы и терминология. Так, у специалиста, который работает над геном, активным в клетках мозга, могут возникнуть сложности с изучением огромного объёма литературы по нейробиологии. OpenAI обучила большую языковую модель на 50 наиболее распространённых биологических алгоритмах, а также на механизмах работы с основными общедоступными базами данных с информацией по биологии. При дальнейшем обучении система получила возможность предлагать вероятные механизмы клеточных процессов и расставлять приоритеты для мишеней при разработке препаратов. Разработчики снизили свойственную большим языковым моделям склонность к подхалимскому поведению, сделав GPT-Rosalind более скептической в ответах, в том числе при создании препаратов. Компания обеспечила модели способность к рассуждениям — к обработке многоэтапных процессов, — а также высокий экспертный уровень, который подтвердился на тестовых примерах. На текущий момент OpenAI ограничила доступ к модели из опасений, что ей могут злоупотреблять, например, попросив повысить инфекционность вируса — заявки принимаются только от американских организаций. Впоследствии компания выпустит Life Sciences Research Plugin — ограниченный по возможностям вариант системы. Alibaba представила ИИ-модель для генерации 3D-миров

16.04.2026 [12:04],

Павел Котов

Alibaba представила модель искусственного интеллекта, которую можно использовать для разработки игр и создания видеороликов с имитацией реального мира. Китайский гигант электронной коммерции стремится монетизировать свои решения, а новый проект поможет ему в конкурентной борьбе с Tencent, у которой уже есть аналогичная ИИ-модель.

Источник изображения: alibabagroup.com Мировая модель от Alibaba получила название Happy Oyster — она может создавать виртуальные трёхмерные пространства и генерировать интерактивные видео. На практике эта модель окажется полезной в производстве фильмов, прочего видеоконтента и компьютерных игр. Китайский технологический гигант намеревается в течение пяти лет нарастить годовой доход от облачных технологий и ИИ в пять раз — до $100 млрд. В последние несколько недель Alibaba активно запускает новые модели ИИ и занимается реорганизацией своей структуры, стремясь переориентировать усилия на извлечение прибыли от технологических решений и окупить часть своих инвестиций — за сегодня акции компании подорожали на 5,8 %, опередив рост рынка. Разработку новой модели вело бизнес-подразделение компании Alibaba Token Hub. Поработать с ней могут пока только участники программы ограниченного раннего доступа. На минувшей неделе Alibaba представила генератор видео HappyHorse, который стал сенсацией в китайской отрасли ИИ — он сразу возглавил мировые рейтинги. Мировые модели ИИ предназначены для воссоздания реальных физических и пространственных аспектов в виртуальной среде, закладывая основу для 3D-контента. Они также используются для обучения роботов и улучшения функция распознавания окружающей среды в беспилотных транспортных средствах. Есть аналогичные модели, в том числе Tencent Hunyuan3D и Google Genie. Потребительские ИИ-боты в 80 % случаев ставят неверные диагнозы, показало исследование

14.04.2026 [13:23],

Алексей Разин

Универсальность популярных чат-ботов с точки зрения поиска необходимой информации, как выясняется, не делает их пригодными для постановки точных медицинских диагнозов при ограниченном наборе данных. Более чем в 80 % случаев чат-боты ставят ошибочный диагноз, что делает их непригодными для замены консультации реального специалиста в области медицины.

Источник изображения: Unsplash, Elen Sher Опубликованное на страницах Jama Network Open исследование, на которое ссылается Financial Times, использовало 29 описаний клинических случаев из справочной медицинской литературы для проверки качества определения диагноза популярными чат-ботами. Исследование показало, что при передаче чат-боту ограниченной информации о симптомах большие языковые модели затрудняются с выбором возможных диагнозов, и чаще всего сводят всё к единственному варианту, на который в действительности нельзя полагаться в дальнейшем лечении. Если входные данные достаточно подробные, то таких проблем с постановкой точного диагноза уже не наблюдается. Медицинские данные в ходе эксперимента передавались чат-ботам поэтапно, включая историю болезни, результаты осмотров и лабораторных анализов. Чат-ботам задавались вопросы на тему диагностики заболеваний, измерялась точность и полнота ответов. В выборку проверяемых ИИ-моделей попали два десятка популярных чат-ботов, включая разработанные OpenAI, Anthropic, Google, xAI и DeepSeek. При отсутствии полной информации о состоянии пациента более чем в 80 % все они демонстрировали склонность к постановке некорректного диагноза. Чем полнее была информация, тем точнее были результаты. В лучших случаях точность превышала 90 %, в среднем варианте ошибочные диагнозы ставились менее чем в 40 % случаев. Google и Anthropic заявили, что их чат-боты при попытке пользователей получить медицинские рекомендации настоятельно рекомендуют обращаться к специалистам. OpenAI указывает в правилах использования своих сервисов, что они не должны использоваться для получения медицинских рекомендаций, требующих наличия соответствующей лицензии. xAI и DeepSeek свои комментарии на этот счёт ресурсу Financial Times не предоставили. Некоторые из указанных разработчиков создают узкоспециализированные медицинские модели. Разработанная Google AMIE, например, показывает неплохие результаты, но на её заключения сложно полагаться в полной мере, как отмечают специалисты в области медицины, поскольку живой доктор в значительной степени полагается на визуальную оценку состояния пациента. При этом такие ИИ-модели имеют право на жизнь в тех регионах, где имеются проблемы с доступом к качественной медицинской помощи в классическом её понимании. Инвесторы усомнились, что OpenAI действительно стоит $852 млрд — компания пытается исправить впечатление

14.04.2026 [11:02],

Алексей Разин

Возросшую активность OpenAI в сфере пересмотра стратегии и концентрации на приоритетных направлениях деятельности принято связывать с подготовкой к IPO. Последний раунд частного размещения позволил поднять капитализацию стартапа до $852 млрд, но не все инвесторы единодушны в подобной оценке. При этом чувствуется, что высокая конкуренция заставляет руководство OpenAI спешно устранять слабые места в своей стратегии.

Источник изображений: OpenAI Обширный материал на эту тему опубликовало издание Financial Times. Стремление OpenAI переключиться на обслуживание корпоративных клиентов усиливает конкуренцию с Anthropic, и нельзя утверждать, что в этом сегменте преимущество на стороне первого из стартапов. Google также агрессивно действует в корпоративном сегменте рынка ИИ, поэтому для OpenAI концентрация на нём формирует новые вызовы. Один из ранних инвесторов в OpenAI заявил Financial Times: «У вас есть ChatGPT, растущий на 50–100 % ежегодно бизнес с миллиардной пользовательской аудитории, так почему же вы говорите о предприятиях и написании кода? Эта компания очень сильно расфокусирована». В прошлом месяце OpenAI привлекла $122 млрд, которые предоставила группа из 25 крупных стратегических и институциональных инвесторов, включая SoftBank, Amazon и Nvidia, и около $3 млрд впервые были получены от частных инвесторов. По мнению руководства OpenAI, превышение спросом предложения в рамках этого раунда финансирования и рекордная сумма привлечения средств доказывают, что интерес инвесторов к деятельности компании и их доверие по-прежнему высоки. Руководство OpenAI даже предприняло попытки «разоблачить» конкурирующую Anthropic в некорректном отображении приведённой годовой выручки, которая на конец марта в последнем случае оценивалась в $30 млрд. Как подчёркивает директор OpenAI по выручке Дениз Дрессер (Denise Dresser), эта сумма завышена примерно на $8 млрд за счёт частичного переноса профильной выручки, получаемой Amazon и Google. Сама OpenAI на конец февраля располагала приведённой годовой выручкой в размере $25 млрд. Дрессер признаёт, что ранняя концентрация на корпоративном рынке дала Anthropic определённое преимущество, но в OpenAI убеждены, что смогут завоевать этот рынок. К концу текущего года до половины всей выручки стартап рассчитывает получать именно с корпоративных клиентов.  Некоторые инвесторы OpenAI признались, что выделяя средства на нужды стартапа сейчас, они исходили из оценки его капитализации в размере $1,2 трлн по итогам IPO. При этом Anthropic сейчас оценивается в $380 млрд, и некоторым потенциальным инвесторам капитализация OpenAI на текущих уровнях кажется завышенной. С такими аппетитами, по мнению некоторых инвесторов, OpenAI рискует оказаться на «спорной территории» с точки зрения привлечения капитала. Косвенные данные позволяют судить, что спрос на инвестиции в капитал Anthropic сейчас выше, чем в случае с OpenAI. Инвесторы впервые готовы больше переплачивать, вкладывая средства в Anthropic, чем в OpenAI. Существует определённый беспорядок в использовании компанией OpenAI привлечённых средств. Две недели назад стартап за несколько сотен миллионов долларов США купил канал TBPN, хотя такая сделка в медийной сфере вызвала вопросы. Руководство предпочло парировать заявлениями о том, что TBPN не будет отвлекать на себя вычислительные ресурсы. Закрытие генератора видео Sora оставило OpenAI без средств Disney, которая должна была вложить $1 млрд. Microsoft пригрозила OpenAI иском после заключения последней из компаний сделки с Amazon на $50 млрд. Реализация мегапроекта Stargate тоже продвигается в усечённом варианте: отменено строительство ЦОД в Великобритании за $30 млрд, площадка в Техасе будет расширяться не так активно, как планировалось изначально. Nvidia также в пять раз сократила масштабы своей сделки с OpenAI, которая сперва подразумевала инвестиции в размере $100 млрд. Впрочем, OpenAI всё равно планирует до конца года увеличить численность персонала в два раза до 8000 человек и довести долю выручки на корпоративном направлении до 50 % от совокупной. В Лондоне со следующего года расположится крупнейший исследовательский центр компании за пределами США. Руководство OpenAI недавно сообщило инвесторам, что располагает доступом к 8 ГВт вычислительных мощностей, тогда как Anthropic на этот уровень ранее конца 2027 года не выйдет, а к 2030 году сама OpenAI рассчитывает располагать доступом к 30 ГВт вычислительных мощностей. Anthropic то и дело сталкивается со сбоями в работе инфраструктуры и нехваткой вычислительных мощностей. В OpenAI утверждают, что даже если их модели и отстают от созданных Anthropic, они хотя бы могут стабильно работать. Представители Anthropic пояснили, что компания будет придерживаться разумного подхода к масштабированию вычислительных мощностей. OpenAI меняет приоритеты в своём развитии. Помимо отказа от сервиса генерации видео Sora, компания свернула проект по запуску чат-бота с эротическим уклоном. Теперь прилагаются усилия по продвижению сервиса Codex в корпоративной среде, который призван упростить жизнь разработчикам ПО. Некоторые знакомые с планами OpenAI источники даже утверждают, что Codex может оказаться самым главным направлением бизнеса стартапа, обойдя ChatGPT. По крайней мере, этот вид деятельности обеспечивает значительно более высокую прибыль. Некоторые инвесторы приветствуют такие преобразования в стратегии OpenAI, другие опасаются, что все эти метания говорят об отсутствии чётко обозначенных целей. В любом случае, привлекать инвестиции OpenAI это пока не мешает. Марк Цукерберг создаёт себе ИИ-двойника, который будет общаться с подчинёнными за него

13.04.2026 [13:26],

Алексей Разин

Можно подумать, что уставшая доносить до общественности пользу внедрения искусственного интеллекта компания Meta✴✴ Platforms готова испытывать все новые идеи на себе. Помимо ИИ-агента, который будет помогать основателю Марку Цукербергу (Mark Zuckerberg) руководить своим детищем, она сейчас пытается создать ИИ-аватар, который будет общаться с сотрудниками от лица Цукерберга.

Источник изображения: Unsplash, Ferr Studio Формально, как поясняет Financial Times, эти две инициативы продвигаются независимо друг от друга. Meta✴✴ уже работала над созданием фотореалистичных трёхмерных персонажей, которые использовали бы ИИ для ответа на вопросы от лица своего прототипа, и решила сосредоточиться на разработке такого виртуального аватара для своего генерального директора. Цукерберг сам вовлечён в процесс тестирования и обучения соответствующей языковой модели. Её также обучают на видеозаписях публичных выступлений основателя компании, чтобы аватар мог точно воспроизводить интонацию и манеру речи оригинала. Кроме того, в содержательной части аватар учитывает высказывания Цукерберга относительно текущего представления о стратегии развития компании, что будет полезно при его взаимодействии с сотрудниками Meta✴✴. В целом, Марк Цукерберг на личном примере демонстрирует концентрацию усилий Meta✴✴ на разработке ИИ. Он пишет программный код в течение пяти или десяти часов в неделю для разных проектов, проводит много времени на технических совещаниях. Идея создания ИИ-аватара для деятельности Meta✴✴ не нова сама по себе, ещё в сентябре 2023 года компания предложила «одушевить» чат-бот при помощи внешности и голоса знаменитостей, которые дали на это своё согласие. Молодая аудитория благоприятно восприняла это нововведение. Позже была представлена функция AI Studio, которая позволила пользователям создавать собственные ИИ-персонажи, независимо от прототипа общающиеся с подписчиками. Кто-то начал злоупотреблять данными возможностями во фривольном смысле, в итоге с января Meta✴✴ была вынуждена ограничить доступ подростковой аудитории к ИИ-персонажам. По данным Financial Times, созданная внутри Meta✴✴ лаборатория Superintelligence Labs продолжила развивать тему ИИ-персонажей. В процессе экспериментов выяснилось, что наделение таких аватаров фотореалистичной внешностью отнимает много вычислительных ресурсов, и на уровне передачи информации сложно обеспечить отсутствие задержек при взаимодействии с пользователями. Голосовым аспектам подобных проектов тоже уделяется должное внимание. В прошлом году Meta✴✴ купила стартапы PlayAI и WaveForms, которые специализируются на этом направлении. Аватар Цукерберга также будет обучаться на записях его голоса. Если эксперимент оправдает себя, представители творческих профессий в медийной сфере смогут создавать своих ИИ-двойников для общения с аудиторией. Внутренние процессы в Meta✴✴ всё больше ориентируются на применение ИИ. Агентсткие инструменты типа OpenClaw, по замыслу руководства, должны активнее использоваться сотрудниками для автоматизации рутинных задач. Менеджеры по продуктам приглашаются для прохождения контрольных заданий на навыки работы с ИИ в сфере написания программного кода и разработки технических систем. Пока такие тесты не являются обязательными, руководство компании утверждает, что они проводятся для выявления пробелов в обучении сотрудников, но последние начали опасаться, что подобные проверки могут быть предвестниками новой волны сокращений. Основатель DeepSeek назвал дату выхода флагманской модели V4

12.04.2026 [07:47],

Анжелла Марина

Основатель компании DeepSeek Лян Вэньфэн (Liang Wenfeng) подтвердил в ходе внутреннего общения с сотрудниками, что флагманская модель следующего поколения DeepSeek V4 будет официально представлена в конце апреля 2026 года. По сообщению AIBase, система впервые получит многоуровневый режим работы, а релиз совпадёт с выходом конкурирующей модели Tencent.

Источник изображения: AI Быстрый режим (Fast Mode) ориентирован на повседневные диалоги и мгновенные ответы, поддерживает распознавание текста на изображениях и в файлах с акцентом на скорость работы. Экспертный режим (Expert Mode) разработан для решения задач со сложной логикой и глубоким анализом, обладает усиленными возможностями интеллектуального поиска. Однако этот режим пока не поддерживает загрузку файлов и мультимодальные функции, а в часы пик может потребоваться ожидание.

Источник изображения: aibase.com Несмотря на приближающийся релиз новой модели, текущая ситуация в DeepSeek характеризуется контрастами. Пользователи отметили существенные улучшения в логической обработке данных и возможностях программирования. Однако платформа три дня подряд испытывает масштабные технические сбои, включая один сбой продолжительностью до 12 часов. Эксперты отрасли рассматривают это как «болезненный период» переходного этапа между старой и новой моделями. Дата релиза DeepSeek V4 выбрана в условиях высокой конкуренции. Команда Яо Шунью (Yao Shunyu) в Tencent также планирует выпустить новую модель под названием Hunyuan в следующем месяце. Таким образом, конец апреля станет временем прямого соперничества между двумя ведущими китайскими разработчиками базовых ИИ-моделей, что может повлиять на расстановку сил в индустрии. Приложение Meta✴ AI взлетело на 5 место в App Store после запуска Muse Spark

10.04.2026 [06:06],

Анжелла Марина

Приложение Meta✴✴ AI поднялось на пятое место в американском App Store после запуска новой ИИ-модели Muse Spark. Как сообщает TechCrunch со ссылкой на данные платформы Appfigures, всего за сутки приложение переместилось с 57-й позиции на пятую строчку рейтинга.

Источник изображения: Mariia Shalabaieva/Unsplash Meta✴✴ называет Muse Spark значительным улучшением по сравнению с предыдущими моделями Llama. Модель доступна в веб-версии и на мобильных устройствах, принимает мультимодальный ввод посредством голоса, текста и изображения. Muse Spark помогает разбираться в вопросах здоровья, решать сложные задачи по математике и естественным наукам, а также создавать сайты и мини-игры по текстовым запросам и запускать несколько субагентов для обработки пользовательских запросов. Несмотря на продвижение в рейтинге, приложение Meta✴✴ AI пока уступает конкурентам. ChatGPT занимает первое место, Claude от Anthropic второе, Gemini — третье. Попытки Meta✴✴ догнать лидеров рынка уже обошлись компании в миллиарды долларов, не считая инвестиций в компанию Scale AI (специализируется на подготовке данных для обучения ИИ) в размере $14,3 млрд.

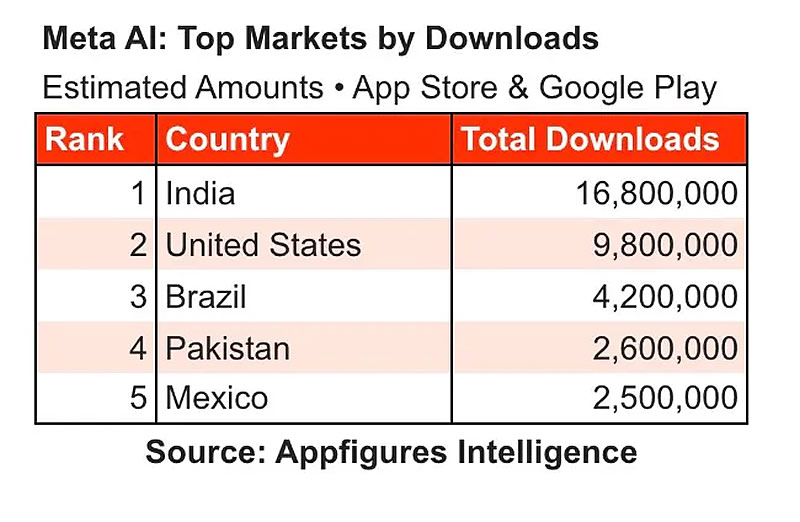

Источник изображения: Appfigures Всего приложение Meta✴✴ AI было установлено 60,5 миллиона раз по всему миру на платформах App Store и Google Play, из них 25 миллионов только в этом году. За последние пять месяцев число загрузок выросло на 138 % по сравнению с первыми пятью месяцами после запуска. Крупнейшим рынком по числу скачиваний стала Индия, за ней следуют США, Бразилия, Пакистан и Мексика. Это первый крупный релиз под руководством Александра Вана (Alexandr Wang), возглавившего подразделение Meta✴✴ Superintelligence Labs. В ближайшие недели модель появится в WhatsApp, Instagram✴✴, Facebook✴✴, Messenger и умных очках Meta✴✴. Meta✴ выпустит открытые версии мощных ИИ-моделей Avocado и Mango с урезанной функциональностью

07.04.2026 [15:25],

Дмитрий Федоров

Meta✴✴ выпустит в этом году две закрытые передовые ИИ-модели — большую языковую модель под кодовым названием Avocado и генератор мультимедийных файлов Mango. Их версии с открытым исходным кодом, вероятно, создадут на той же основе, но сроки их выхода относительно закрытых версий компания не раскрывает. Эти продукты должны стать частью стратегии Meta✴✴ по максимально широкому распространению ИИ-моделей по всему миру.

Источник изображения: Eyestetix Studio / unsplash.com Открытые версии моделей не получат полный набор возможностей, доступных их закрытым собратьям, при этом Meta✴✴ не уточняет, какие именно функции в них не войдут. О масштабе возможного упрощения позволяет судить Llama 4 Maverick — самая мощная большая языковая ИИ-модель компании с открытым исходным кодом, представленная в апреле прошлого года. Она насчитывает 400 млрд параметров и устроена как система из 128 специализированных нейросетей, каждая из которых отвечает за свой класс задач. В новых открытых версиях Meta✴✴ может исключить часть этих подсистем, сократить число параметров или отказаться от отдельных этапов обучения, включая последующее дообучение. Частичное ограничение возможностей открытых версий, вероятно, связано и с требованиями безопасности в сфере ИИ. Это косвенно указывает на то, что Avocado может быть особенно сильна в генерации кода для задач кибербезопасности. Для сравнения: Claude 4.6 Opus компании Anthropic уже выявила сотни критических уязвимостей в проектах с открытым исходным кодом. Одновременно Anthropic и OpenAI готовят новые флагманские большие языковые ИИ-модели, тогда как Meta✴✴, по данным Axios, не ожидает превосходства над конкурентами «по всем направлениям» и делает ставку на отдельные преимущества, важные для массовой аудитории. Одним из таких преимуществ могут стать более низкие требования к вычислительным ресурсам. Многие передовые большие языковые ИИ-модели не запускаются на персональных компьютерах (ПК) из-за ограниченной производительности процессоров. Ещё одно возможное направление — задачи, связанные с вопросами личного здоровья и помощью с домашними заданиями: ориентированные на бизнес ИИ-модели обычно уделяют таким сценариям меньше внимания. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |