|

Опрос

|

реклама

Быстрый переход

ИИ заполоняет интернет: 35 % появившихся за последние годы сайтов были созданы нейросетями

28.04.2026 [19:39],

Сергей Сурабекянц

Группа исследователей, в которую входят учёные и энтузиасты проекта «Архив интернета», опубликовала свои выводы в статье под названием «Влияние текста, сгенерированного ИИ, на интернет». По их данным, начиная с 2022 года более трети всех сайтов создано с помощью ИИ. Исследование также показало, что контент, сгенерированный ИИ, делает интернет более позитивным и менее разнообразным.

Источник изображений: unsplash.com Вдохновлённые теорией «мёртвого интернета» — идеей о том, что большая часть интернета теперь состоит из ботов, обменивающихся сообщениями, — команда исследователей обратилась в «Архив интернета», чтобы получить образцы сайтов за 33 месяца с августа 2022 года по май 2025 года. Проект «Архив интернета» (Internet Archive) — это некоммерческая организация, которая, как и следует из названия, занимается сохранением цифрового контента Сети для будущих поколений. «Для каждого выбранного URL-адреса мы получаем самый старый доступный архивный снимок через API сервера CDX Wayback Machine, — говорится в исследовании. — Исходный HTML-код каждого снимка загружается и сохраняется локально для последующей обработки». Исследователи использовали программное обеспечение для обнаружения ИИ Pangram v3, которое, по их данным, оказалось самым точным инструментом для определения контента, созданного нейросетью. «Опасения вызывают распространение в интернете текста, сгенерированного и обработанного с помощью ИИ, что может привести к ухудшению семантического и стилистического разнообразия, фактической точности и другим негативным последствиям, — пишут исследователи. — Мы обнаружили, что к середине 2025 года примерно 35 % вновь опубликованных сайтов были классифицированы как сгенерированные или обработанные с помощью ИИ, по сравнению с нулевым показателем до запуска ChatGPT в конце 2022 года».  «Я считаю невероятную скорость захвата интернета искусственным интеллектом просто поразительной, — заявил соавтор статьи Йонаш Долежал (Jonáš Doležal). — После десятилетий, в течение которых люди формировали интернет, значительная его часть всего за три года стала определяться искусственным интеллектом. На мой взгляд, мы являемся свидетелями масштабной трансформации цифрового ландшафта за гораздо меньшее время, чем потребовалось для его создания изначально». Исследователи проверили шесть распространённых критических замечаний в адрес текста, сгенерированного ИИ:

«Для каждой гипотезы мы определяем измеримый сигнал, вычисляем его для каждой ежемесячной выборки сайтов и проверяем, коррелирует ли он с совокупным показателем вероятности ИИ за месяцы», — пояснили учёные. Например, чтобы проверить, заполняет ли ИИ интернет ложной информацией, команда извлекла основанные на фактах утверждения с выбранных ими сайтов, а затем проверила их достоверность. Чтобы выяснить, ссылается ли ИИ на источники, команда вычисляла плотность исходящих ссылок в тексте, сгенерированном ИИ.  К удивлению исследователей, только две из шести проверенных ими теорий о влиянии текста, сгенерированного ИИ, оказались верными. ИИ делал интернет менее семантически разнообразным и в целом более позитивным, но он не вызывал распространения лжи и не устранял её источники. «Самым удивительным результатом стало то, что наша гипотеза о распаде истины не подтвердилась, — отметил Долежал. — Мы целенаправленно искали увеличение количества заведомо ложных утверждений, но не обнаружили. Но всё же возможно, что ИИ незаметно увеличивает объём утверждений, которые нельзя проверить с помощью существующих инструментов и инфраструктуры проверки фактов. Или же интернет изначально не был особенно склонен к соблюдению истины». Исследователи заявили, что продолжат изучать влияние ИИ-контента на интернет. В настоящее время они создают «непрерывный инструмент», который будет непрерывно анализировать ситуацию, а не создавать статичный «снимок» ресурсов Сети. Учёные планируют выяснить, какие типы сайтов сильнее всего наполнены нейросетевым контентом, с разбивкой по категориям и языкам, а также оценить, где наиболее ярко проявляются последствия применения ИИ.  Для Долежала подобные исследования имеют решающее значение для обеспечения полезного и продуктивного интернета. «По мере распространения контента, созданного с помощью ИИ, задача состоит в том, чтобы найти применение этим моделям, которое не приведёт просто к созданию очищенного, повторяющегося контента, — считает он. — Скорее, вместо того чтобы заставлять модели быть идеально покладистыми и уступчивыми, стоит предоставить им больше индивидуальности или конфликтности, что может помочь им выступать в качестве творческого партнёра, а не замены человеческого голоса». Google, Meta✴ и другие бигтехи больше не смогут избегать ответственности за контент пользователей, как делали 30 лет

03.04.2026 [18:21],

Сергей Сурабекянц

Meta✴✴ и Google, доминирующие на американском рынке цифровой рекламы, в последнее время оказались ответчиками по множеству похожих судебных исков. Все иски оформлены с целью обойти статью 230 «Закона о пристойности коммуникаций», принятого на заре интернета в 1996 году, который защищал сайты от ответственности за размещённый пользователями контент, наделяя их лишь ролью модераторов. Такие компании, как TikTok и Snap, также оказались в затруднительном положении.

Источник изображений: unsplash.com На прошлой неделе суд признал Meta✴✴ виновной в деле, связанном с безопасностью детей, в то время как присяжные в Лос-Анджелесе признали Meta✴✴ и YouTube виновными в халатности по делу о телесных повреждениях. Вердикт против Meta✴✴ и YouTube стал первым случаем, когда соцсети были признаны ответственными за формирование зависимости у несовершеннолетних. Истцы утверждали, что сочетание таких функций, как автовоспроизведение, алгоритмы рекомендаций, уведомления и определённые фильтры, действовало как «цифровые казино», что привело к серьёзным проблемам с психическим здоровьем. Обе компании заявили, что планируют оспорить вынесенные вердикты, но судебная перспектива этих обжалований далеко не самая радужная.  Через несколько дней жертвы печально известного сексуального преступника Джеффри Эпштейна подали коллективный иск против Google и администрации США по обвинениям в неправомерном разглашении личной информации. Истцы утверждают, что сводки и ссылки, созданные с помощью ИИ Google, «не являются нейтральным поисковым индексом». «Так долго технологические компании использовали статью 230 как предлог, чтобы избегать принятия значимых мер по защите пользователей, но особенно детей, от вопиющего вреда, преследования и злоупотреблений, мошенничества и афер, — заявил сенатор Брайан Шац (Brian Schatz). — Дело не в том, что они не знают, что происходит или даже почему это происходит. Дело в том, что любые действия по этому поводу нанесут ущерб их прибыли. И пока федеральный закон обеспечивает защиту, зачем вообще этим заниматься?» Политики обеих партий на протяжении многих лет предлагали всевозможные реформы статьи 230, а руководители компаний подвергались публичному допросу на слушаниях в Конгрессе по поводу предполагаемого вреда, причинённого их платформами. Но в то время как проблема застопорилась в Вашингтоне, адвокаты истцов находят другие пути привлечения крупных технологических компаний к ответственности. Коллективный иск против Google, поданный на прошлой неделе истцом под псевдонимом Джейн Доу, утверждает, что режим искусственного интеллекта компании создавал собственные резюме и ссылки, раскрывая личную идентификационную информацию жертв Эпштейна, включая имена, номера телефонов и адреса электронной почты. По мнению истцов, «Google намеренно предоставляет эту личную информацию таким образом, который или, по крайней мере, с большой долей вероятности призван разжигать преследование и страх».  Мэтью Бергман (Matthew Bergman), один из адвокатов, представляющих истцов по делу в Лос-Анджелесе, заявил, что технологическая индустрия полагается на чрезмерно широкие толкования статьи 230, чтобы «избежать любой возможной юридической ответственности просто потому, что контент третьих лиц находится где-то в причинно-следственной цепочке их неправомерных действий». Ставки огромны, поскольку технологический сектор выходит из эры традиционного онлайн-поиска и социальных сетей и входит в мир, где доминируют нейросети. Они генерируют контент, оценка которого может варьироваться от спорного до потенциально незаконного. На сегодняшний день финансовые санкции минимальны — менее $400 млн в виде компенсаций в рамках двух вердиктов, — но эти дела создают тревожный прецедент для технологических гигантов, которые делают ставку на ИИ. «Адвокаты истцов выигрывают войну против статьи 230 посредством систематических, неустанных судебных разбирательств, которые приводят к появлению ямок и трещин в её защите», — полагает профессор права Университета Санта-Клары Эрик Голдман (Eric Goldman).  «Википедия» целиком и полностью запретила статьи, написанные нейросетями

26.03.2026 [18:51],

Сергей Сурабекянц

Новая политика «Википедии» больше не позволит редакторам писать или переписывать статьи с помощью нейросетей. В обновлении, добавленном в руководство «Википедии» в конце прошлой недели, в качестве причины запрета указывается тенденция к нарушению статьями, написанными с помощью ИИ, «нескольких основных правил контента "Википедии"».

Источник изображений: «Википедия» Пока это изменение касается англоязычной версии «Википедии» и по-прежнему позволяет редакторам использовать ИИ в определённых сценариях, которые включают использование больших языковых моделей для «предложения базовой корректуры» в текстах, если это «не добавляет собственного контента». Редакторы также могут использовать ИИ для перевода статей из «Википедии» на другом языке на английский, однако они по-прежнему должны соблюдать правила сайта, которые требуют от редакторов достаточного знания исходного языка для подтверждения точности перевода. В тексте новой политики «Википедии» отмечается, что стиль письма некоторых людей «может быть схож со стилем большой языковой модели», и редакторам потребуется опираться не только на «стилистические или лингвистические признаки», чтобы обосновать потенциальные ограничения на их возможности редактирования. Руководство рекомендует «учитывать соответствие текста основным правилам контента и недавние правки соответствующего редактора». Это последнее изменение в руководстве Википедии вызвало длительную дискуссию между редакторами, но в итоге было принято подавляющим большинством голосов. Редакторы пришли к заключению, что новая политика «направлена на явно проблемные вопросы использования больших языковых моделей, при этом оставляя место для того, что считается достойным использованием». Редакторы «Википедии» уже несколько месяцев борются со статьями, созданными ИИ, что ранее уже привело к внедрению сообществом новой политики, позволяющей «быстро удалять» плохо написанные статьи. Редакторы также создали WikiProject AI Cleanup, инициативу, призванную бороться с контентом, написанным ИИ, и помогать другим в его выявлении. 15 января «Википедия» отметила юбилей — 25 лет с момента запуска. За это время скромный сайт с сотней страниц превратился в один из крупнейших источников знаний в интернете. Сегодня на платформе размещено более 65 миллионов статей на множестве языков, которые ежемесячно получают около 15 миллиардов просмотров. OpenAI отложила запуск эротических чатов в ChatGPT из-за опасений по поводу их безопасности

16.03.2026 [09:32],

Алексей Разин

Многие отрасли в своё время получили развитие, в том числе, и благодаря природному интересу человека к материалам эротического содержания, а потому сфера искусственного интеллекта не является исключением. Компании борются с соблазном использовать эротику для продвижения своих платформ, пытаясь при этом остаться в каких-то законодательных и этических рамках. OpenAI пока не готова запустить эротические чаты.

Источник изображения: Unsplash, Alexander Krivitskiy О возможности появления такого направления в работе ChatGPT ещё в середине прошлого года заявил генеральный директор OpenAI Сэм Альтман (Sam Altman). Сперва он вынашивал идею запуска функции эротических чатов к декабрю прошлого года, потом сроки перенесли на текущий квартал, но теперь становится понятно, что и этот график не будет выдержан. Как минимум, задержка с дебютом функции эротических чатов будет измеряться одним месяцем, сообщает The Wall Street Journal. Эксперименты в использовании ИИ для создания текстового контента эротического содержания OpenAI предпринимала задолго до запуска ChatGPT. Ещё в 2021 году клиентам OpenAI предлагалась игра AI Dungeon с нелинейным сюжетом, направление развития которого могли задавать пользователи. Тогда специалисты OpenAI установили, что ИИ-платформа порой предлагает игрокам обсудить темы сексуальных взаимоотношений, даже если они никак не провоцировали подобный поворот сюжета. Если же пользователь сам предлагал умеренную степень эротизма, ИИ буквально «перегибал палку» в проявлениях откровенности соответствующих бесед. OpenAI уже тогда задумалась о привлекательности подобного применения чат-ботов, но при этом осознала и необходимость введения этических ограничений. Руководство OpenAI в последнее время всё более благосклонно высказывалось в отношении идеи запуска эротических чатов, подчёркивая, что всё ограничится только текстовой информацией, без создания изображений и видео откровенного содержания. Конкуренты тоже не стоят на месте. В прошлый четверг Илон Маск (Elon Musk) заявил, что его чат-бот Grok в части генерирования видео скоро сможет создавать контент, относящийся к категории «18+». Meta✴✴ позволяет пользователям своего чат-бота вести романтические ролевые игры, но только при наличии уверенности в их совершеннолетии. У самой OpenAI с механизмами подтверждения возраста пока имеются проблемы. Сейчас профильная система в 12 % случаев ошибочно принимает подростков за совершеннолетних. С учётом наличия примерно 100-миллионной аудитории несовершеннолетних пользователей ChatGPT, такой уровень погрешности позволил бы миллионам подростков на регулярной основе получать доступ к эротическим чатам. Созванная OpenAI в январе экспертная комиссия также выразила озабоченность угрозой появления запретного с точки зрения общественной морали и законодательства контента, который подразумевает насильственные действия сексуального характера, упоминание несовершеннолетних и другие специфические сценарии. Кроме того, увлечение подобным контентом может вызывать у людей психологическую зависимость и снижать их мотивацию поддерживать взаимоотношения с реальными партнёрами в офлайне. OpenAI хочет принудительно напоминать таким увлекающимся натурам, что им следует строить отношения с реальными людьми. Это особенно важно с учётом наличия не совсем приятных инцидентов, возникших по мере распространения чат-ботов. Существуют примеры доведения людей до самоубийства в результате длительного общения с вымышленными персонажами в чат-боте, включая и подростковые суициды. Эксперты опасаются, что эротический уклон подобных бесед только спровоцирует рост количества таких случаев. В части механизмов проверки возраста пользователей у представителей OpenAI особых иллюзий нет — они, по их словам, никогда не смогут быть идеальными и в 100 % случаев рабочими. С 2021 года часть сотрудников OpenAI выражает сопротивление идее запуска эротических чатов на платформе из опасения окончательного сползания в эту сферу: «Мы не хотели быть просто компанией, распространяющей эротику». На данный момент руководство OpenAI считает целесообразным запуск эротических чатов, руководствуясь следующими принципами: «Мы всё ещё верим, что со взрослыми надо обращаться как со взрослыми, но формирование правильного опыта потребует большего времени». Roblox задействует ИИ для модерирования чатов в режиме онлайн

06.03.2026 [13:37],

Владимир Фетисов

Платформа Roblox начала использовать алгоритм на базе искусственного интеллекта для корректировки содержания пользовательских сообщений в чатах. Перефразирование сообщений в режиме реального времени выходит за рамки уже действующей на платформе фильтрации запрещённых слов, которые при обнаружении заменяются символами «#».

Источник изображений: Roblox Corporation Теперь же такие слова и фразы будут автоматически трансформироваться в более корректные и уважительные, но с сохранением первоначального смысла, заложенного отправителем. Например, если пользователь напишет в чат «Hurry TF up!» («Давай быстрее, черт возьми!»), алгоритм изменит сообщение на «Hurry up!» («Поторопись!») Каждый раз, когда происходит подобная замена, «все участники чата уведомляются о том, что текст был перефразирован для сохранения вежливого обращения». Функция автоматического перефразирования сообщений в режиме онлайн на платформе Roblox в настоящее время доступна во внутриигровых чатах между игроками, которые прошли возрастную проверку и находятся в схожих возрастных группах. В прошлом месяце в Roblox появилась функция прохождения возрастной проверки для использования чатов на платформе. После подтверждения возраста пользователь может общаться с другими игроками из близких возрастных категорий. Например, пользователи возрастной группы 9-12 лет могут общаться с представителями группы 13-15 лет. Великобритания запустила расследование по поводу «отвратительных» порнографических дипфейков от Grok в соцсети X

12.01.2026 [19:28],

Сергей Сурабекянц

Сегодня британское Управление связи (Office of Communications, Ofcom) начало расследование с целью определить, нарушают ли созданные в соцсети X с помощью чат-бота Grok AI дипфейки сексуального характера законы Великобритании. На прошлой неделе премьер-министр страны Кир Стармер (Keir Starmer) назвал изображения, созданные Grok, «отвратительными» и «незаконными».

Источник изображения: unsplash.com «Поступили сообщения о том, что аккаунт чат-бота Grok AI на платформе X используется для создания и распространения изображений людей без одежды — что может быть расценено как злоупотребление интимными изображениями или порнография — и изображений детей сексуального характера, которые могут быть расценены как материалы, содержащие сцены сексуального насилия над детьми», — говорится в заявлении Ofcom. На вопрос о возможности запрета X в Великобритании, министр по делам бизнеса Питер Кайл (Peter Kyle) ответил: «Да, конечно», уточнив, что такие действия входят в компетенцию Ofcom. Другие британские официальные лица приветствуют официальное расследование Ofcom и ожидают его быстрого завершения. Создание или распространение интимных изображений или материалов, содержащих сексуальное насилие над детьми, без согласия пользователя, включая изображения сексуального характера, созданные с помощью ИИ, является незаконным в Великобритании. Кроме того, технологические платформы должны предотвращать доступ британских пользователей к незаконному контенту и удалять его, как только им станет известно о нем. В официальном заявлении Ofcom сказано, что в наиболее серьёзных случаях несоблюдения законов Великобритании Управление связи может обратиться в суд с требованием обязать «платёжных провайдеров или рекламодателей отозвать свои услуги с платформы» или обязать интернет-провайдеров заблокировать доступ к сервису. Представитель соцсети X ранее заявил, что платформа принимает меры против незаконного контента, включая материалы, содержащие сцены сексуального насилия над детьми, путём его удаления, постоянной блокировки аккаунтов и сотрудничества с местными органами власти и правоохранительными органами по мере необходимости. «Любой, кто использует Grok или побуждает его к созданию незаконного контента, столкнётся с теми же последствиями, что и при загрузке незаконного контента», — говорится в заявлении компании. Кроме того, X заявила, что запросы на изображения с раздеванием людей доступны только для платных пользователей. Соцсеть X подверглась осуждению и в других странах из-за возможности создания сексуального контента. Французские чиновники обратились в прокуратуру и регулирующие органы, назвав контент «явно незаконным», а индийские власти потребовали официальных объяснений от руководства компании. Pornhub потерял 80 % трафика и потребовал изменить подход к проверке возраста в интернете

20.11.2025 [19:42],

Сергей Сурабекянц

Aylo, материнская компания Pornhub, Brazzers, Redtube и YouPorn, настоятельно рекомендует Apple, Google и Microsoft использовать альтернативный способ для ограничения доступа несовершеннолетних к просмотру взрослого контента на основе проверки на устройствах пользователей. Aylo утверждает, что законы США и Великобритании о проверке возраста привели к резкому падению трафика у легальных поставщиков контента для взрослых, что на руку пиратам и киберпреступникам.

Источник изображения: unsplash.com Aylo настоятельно рекомендовала технологическим гигантам внедрить проверку возраста на основе устройств в своих магазинах приложений и во всех операционных системах. «Мы решительно поддерживаем инициативу по защите несовершеннолетних в интернете, — говорится в письме главного юридического директора компании Энтони Пенхейла (Anthony Penhale). — Однако мы обнаружили, что подходы к проверке возраста на основе сайтов в корне ошибочны и контрпродуктивны». Пенхейл утверждает, что методы проверки возраста на основе сайтов «не достигли своей главной цели: защитить несовершеннолетних от доступа к материалам, не соответствующим их возрасту». По его словам, аутентификация на основе устройств — лучшее решение этой проблемы, поскольку после определения возраста зрителя с помощью телефона или планшета информация о его возрасте может быть передана через API сайтам для взрослых.

Источник изображения: pornhub.com В США и Великобритании последовательно принимаются законы о проверке возраста, которые требуют от пользователей перед просмотром сексуально откровенного контента подтвердить свой возраст при помощи удостоверения личности или других документов. В настоящее время 25 штатов США ввели ту или иную форму проверки личности, в каждом из которых действуют свои правила. Выполняя требования этих законов Pornhub столкнулся с резким (на 80 %) падением трафика. По утверждению компании, пользователи из-за угрозы их конфиденциальности начинают искать контент для взрослых на платформах, не соблюдающих законы. Вице-президент по бренду и сообществу Pornhub Алекс Кекеси (Alex Kekesi) утверждает, что компания «наблюдает экспоненциальный рост числа поисков альтернативных сайтов для взрослых без возрастных ограничений и каких-либо стандартов безопасности».

Источник изображения: unsplash.com Представитель Google Карл Райан (Karl Ryan) прокомментировал обращение Pornhub следующим образом: «Google стремится защищать детей в интернете, в том числе разрабатывая и внедряя новые инструменты контроля возраста, такие как наш API Credential Manager […]. Мы не допускаем приложения для взрослых развлечений в Google Play и хотели бы подчеркнуть, что некоторым высокорискованным сервисам, таким как Aylo, всегда необходимо инвестировать в специальные инструменты для выполнения своих юридических и административных обязательств». Microsoft от комментариев отказалась, сославшись на свою недавнюю публикацию с рекомендациями по политике, в которой говорится, что «контроль возраста должен применяться на уровне сервиса, учитывать конкретные функции дизайна, представляющие повышенный риск, и обеспечивать индивидуальный подход для детей». Apple также не стала комментировать обращение Pornhub. По правилам Apple, дети младше 13 лет должны иметь детскую учётную запись, «которая изначально включает в себя такие средства защиты, как фильтры веб-контента и ограничения приложений», а подростки в возрасте от 13 до 17 лет обязаны использовать аналогичные меры защиты, соответствующие возрасту. Недавние исследования Нью-Йоркского университета и некоммерческой организации государственной политики Phoenix Center показывают, что существующие законы о проверке возраста не работают, поскольку люди находят способы их обойти, в том числе используя VPN и обращаясь к сайтам, которые не регулируют свой контент. «Проверка на платформах похожа на сухой закон, — утверждает директор по государственной политике «Коалиции за свободу слова» Майк Стабайл (Mike Stabile). — Мы наблюдаем, как поведение потребителей перенаправляется с легальных, соответствующих требованиям сайтов на иностранные сайты, которые не соблюдают никаких правил или законов». Он утверждает, что эти законы «удобны для преступников и ужасны для индустрии легального контента для взрослых».

Источник изображения: unsplash.com С введением проверки возраста и общей деанонимизацией интернета эти проблемы становятся актуальными практически для всех. Нынешний всплеск законов о защите детей по всему миру приводит к значительным изменениям в том, как люди взаимодействуют с интернетом, и также влияет на индустрии, не связанные с порнографией, включая игры и социальные сети. Например, с 10 декабря в Австралии, в соответствии с правительственным запретом на социальные сети, дети младше 16 лет будут удалены из Facebook✴✴, Instagram✴✴ и Threads. По словам Стабайла, в США «сторонники этих законопроектов в основном разделились на две группы: религиозные организации, которые не считают, что контент для взрослых должен быть легальным, и поставщики услуг по проверке возраста, которые хотят получить прибыль от ограничений в интернете». По его мнению, цель религиозных организаций — дестабилизировать индустрию для взрослых и отговорить взрослых от её использования, в то время как последние стремятся максимально расширить свой рынок, «даже если это означает сговор с правыми цензорами». Он считает, что проблема в том, что законодатели с благими намерениями часто плохо разбираются в интернете: «Гораздо проще нападать на политическую грушу вроде Pornhub, чем на Apple или Google. Но если вы не учитываете реалии интернета, если ваше законодательство противоречит поведению потребителей, вы в конечном итоге создадите только неэффективные системы». В интернете появилась система, которая заставит разработчиков ИИ платить за контент

10.09.2025 [18:38],

Сергей Сурабекянц

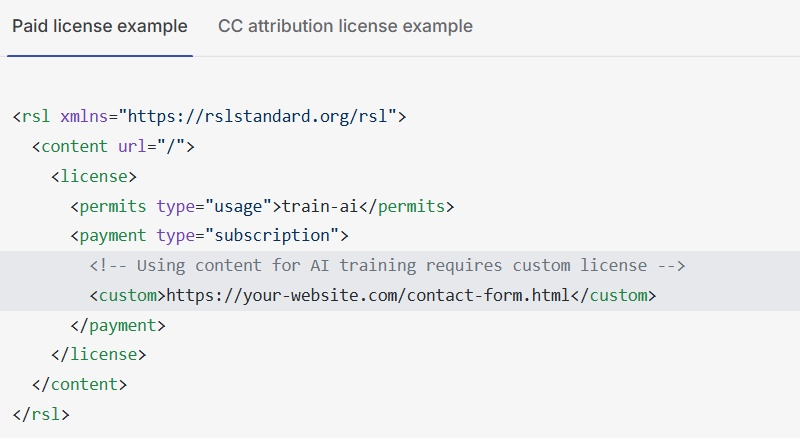

Представлен открытый стандарт лицензирования контента Really Simple Licensing (RSL), который даст медиакомпаниям возможность определять условия оплаты за сбор ботами данных для обучения ИИ. Новый стандарт позволит веб-издателям прямо в файле robots.txt на своих сайтах устанавливать условия использования их произведений. Многие крупные компании, в том числе Reddit, Yahoo, Medium, Quora, IGN и People Inc., уже объявили о поддержке RSL.

Источник изображений: RSL Стандарт RSL основан на протоколе robots.txt, который позволял издателям давать инструкции поисковым роботам о том, к каким разделам сайта они могут получить доступ, а к каким — нет. Но вместо того, чтобы просто говорить «да» или «нет» конкретным ботам, сайты теперь могут добавлять условия лицензирования и выплаты роялти в свой файл robots.txt. Они также могут встраивать эти условия в онлайн-книги, видео и обучающие наборы данных, за которые необходимо получить компенсацию. За стандартом RSL стоит недавно созданная правозащитная организация RSL Collective, возглавляемая Экартом Вальтером (Eckart Walther), соавтором стандарта Really Simple Syndication (RSS) и Дугом Лидсом (Doug Leeds), бывшим генеральным директором IAC Publishing и Ask.com. «Цель — создать новую масштабируемую бизнес-модель для интернета, — сообщил Вальтер. — RSL берёт некоторые из этих ранних идей RSS и создаёт новый уровень для всего интернета, где определяются права лицензирования и права на компенсацию».  Стандарт RSL поддерживает различные модели лицензирования, включая бесплатные. Владельцы сайтов могут попросить компании, работающие с ИИ, оплатить подписку или назначить плату за каждое сканирование. Они также могут ввести плату за вывод, позволяя сайтам получать компенсацию, когда модель ИИ ссылается на их работу для генерации ответа. Боты, сканирующие сайты для других целей, например, для архивирования или включения в поисковые системы, могут работать в обычном режиме. Некоторые медиакомпании, включая Vox Media, материнскую компанию The Verge, News Corp, владеющую The Wall Street Journal, и The New York Times, уже заключили лицензионные соглашения с отдельными разработчиками ИИ, такими как OpenAI и Amazon. RSL Collective стремится упростить этот процесс, позволяя любому владельцу или создателю сайта получать оплату за свою работу без заключения множества отдельных соглашений. Как и в случае со многими другими стандартами, успех RSL зависит от того, насколько его поддержат крупные игроки отрасли. Разработчиков ИИ неоднократно обвиняли в игнорировании файлов robots.txt, и не существует простого способа подсчитать размер платы за вывод без их участия. RSL Collective делает ставку на то, что объединение усилий крупнейших веб-издателей сделает принятие стандарта более привлекательным. «Наша задача — выйти и убедить большую группу людей заявить, что это в ваших интересах. Это эффективно, поскольку вы можете договориться со всеми сразу, и юридически значимо, поскольку, если вы этого не сделаете, вы нарушите все сразу», — говорит Лидс. Стандарт RSL сам по себе не может блокировать посещение веб-сайта ботами, в отличие от системы «оплаты за сканирование», предлагаемой Cloudflare. RSL Collective в настоящее время работает с сетью доставки контента Fastly, чтобы допускать ботов ИИ на сайты только при согласии с политикой лицензирования. Fastly — это «вышибала у входа в клуб, и они не впустят людей без соответствующего удостоверения личности», — образно пояснил Лидс.  Лидс считает, что RSL Collective также может юридически обеспечивать соблюдение лицензий, что позволит, по его словам, «всем участникам организации коллективных прав участвовать в борьбе с любыми нарушениями» и совместно нести судебные издержки. Он сравнивает RSL с существующими организациями по защите цифровых прав, такими как группа по защите музыкальных прав ASCAP, которая собирает лицензионные сборы и распределяет их между участниками. Хотя традиционное лицензирование музыки пользуется особенно сильным и устоявшимся правовым прецедентом защиты авторских прав, несанкционированный сбор данных и использование медиафайлов для обучения систем ИИ всё ещё находятся в «серой зоне» правового регулирования. В настоящее время крупные игроки на рынке ИИ выступают ответчиками по судебным искам от Reddit, Getty Images и многих других онлайн-издателей. «Всегда стоял вопрос о том, соглашаются ли боты на условия, которые они не видят, — поясняют разработчики. — RSL меняет это принципиально, информируя поисковые роботы об условиях ещё до того, как они зайдут на сайт». Они рассчитывают, что новый стандарт лицензирования контента сможет создать интуитивно понятный способ навигации по лицензированию обучения ИИ. В Китае заработал закон о повсеместной маркировке сгенерированного ИИ контента

03.09.2025 [10:12],

Владимир Мироненко

Крупнейшие китайские социальные сети, включая WeChat (принадлежит Tencent Holdings) и Douyin (ByteDance), начали с 1 сентября маркировать весь онлайн-контент, сгенерированный ИИ, в соответствии с вступившим в силу законом, пишет ресурс SCMP.

Источник изображения: ZHIDA LI/unsplash.com Принятый в марте законопроект был подготовлен Государственной канцелярией интернет-информации КНР (Cyberspace Administration of China, CAC) совместно с Министерством промышленности и информатизации КНР (MIIT), Министерством общественной безопасности (MPS) и Государственным управлением радиовещания и телевидения (NRTA) Китая. Согласно установленным требованиям, ресурсы должны размещать явные и неявные метки для текстов, изображений, аудио, видео и другого виртуального контента, созданного с помощью ИИ. Явные метки должны быть видны пользователям, а неявные идентификаторы, такие как цифровые водяные знаки, должны быть встроены в метаданные. Соцсеть WeChat, аудитория которой превышает 1,4 млрд пользователей, заявила, что авторы контента должны добровольно сообщать о всех материалах, созданных с помощью ИИ, при их публикации, а также предупредила, что «строго запрещается удаление, искажение, подделка или сокрытие меток ИИ, добавленных платформой, а также использование ИИ для создания или распространения ложной информации, контента, нарушающего авторские права, или любой незаконной деятельности». Другие популярные китайские социальные сети опубликовали аналогичные заявления. В частности, Douyin, китайский аналог TikTok с аудиторией около 766,5 млн активных пользователей в месяц, заявил, что призывает авторов контента добавлять видимые метки к каждой публикации, созданной с помощью ИИ. Видеосервис добавил, что также определяет источник каждого контента по метаданным. В свою очередь, китайский сайт микроблогов Weibo сообщил, что добавил опцию «Немаркированный ИИ-контент», которая позволит пользователям сообщать о неприемлемом контенте. TikTok заменит сотни британских модераторов на искусственный интеллект

22.08.2025 [18:37],

Сергей Сурабекянц

Лондонское подразделение TikTok готовится уволить сотни сотрудников, занимающихся модерацией и безопасностью контента, как раз в момент, когда в Великобритании вступает в силу «Закон о безопасности в интернете», требующий от международных технологических компаний предотвращать распространение опасных материалов. Компания объяснила, что «начинает процесс коллективных консультаций в рамках глобальной реорганизации своей деятельности по модерации контента».

Источник изображения: unsplash.com Несколько сотен рабочих мест в отделе доверия и безопасности TikTok будут сокращены в Великобритании, а также в Южной и Юго-Восточной Азии, поскольку, по словам представителя компании «технологические достижения, такие как усовершенствование больших языковых моделей, меняют наш подход». Этот шаг был предпринят всего через несколько недель после вступления в силу ключевых положений британского «Закона о безопасности в интернете», который обязывает компании вводить проверку возраста пользователей, пытающихся получить доступ к потенциально опасному контенту. Компаниям, не соблюдающим новые требования по оперативному удалению опасных и незаконных материалов, грозит штраф в размере до £18 млн или 10 % от мирового оборота, в зависимости от того, какая сумма больше. В прошлом месяце в TikTok были введены новые правила «контроля возраста», чтобы соответствовать последним требованиям по ограничению воздействия вредоносного контента на лиц младше 18 лет. Как и другие социальные сети, TikTok планирует использовать технологии машинного обучения для определения возраста пользователя на основе истории использования сайта и круга общения. Эти системы на основе ИИ пока не получили одобрения регулятора. Решение TikTok об увольнении сотрудников принято на фоне более масштабных усилий китайской технологической группы по рационализации своей деятельности в Европе. Компания уделяет особое внимание сокращению или закрытию групп модераторов на отдельных рынках и централизации этих функций в региональных центрах, таких как Дублин и Лиссабон. В этом месяце была закрыта команда TikTok по доверию и безопасности в Берлине.

Источник изображения: Pixabay «Мы продолжаем реорганизацию, начатую в прошлом году, чтобы укрепить нашу глобальную операционную модель доверия и безопасности, которая включает в себя концентрацию нашей деятельности в меньшем количестве локаций по всему миру, чтобы обеспечить максимальную эффективность и скорость развития этой критически важной для компании функции с использованием технологических достижений». — заявил представитель TikTok. Национальный организатор профсоюза работников связи Джон Чедфилд (John Chadfield) уверен, что компания просто планирует перенести свою деятельность в юрисдикции с более дешёвой рабочей силой. «Им не нужны модераторы-люди, их цель — передать всё это ИИ, — заявил он. — ИИ создаёт впечатление, что они умные и передовые, но на самом деле они просто собираются вывести его за пределы страны». Сокращения в TikTok происходят на фоне продолжающегося роста доходов компании в Великобритании и Европе. Выручка компании в 2024 году выросла на 38 % в годовом исчислении до $6,3 млрд, при этом убытки до налогообложения сократились с $1,4 млрд в 2023 году до $485 млн в прошлом году. Google, TikTok и другие сервисы разместили серверы поближе к России, чтобы ускорить загрузку контента

26.06.2025 [18:42],

Сергей Сурабекянц

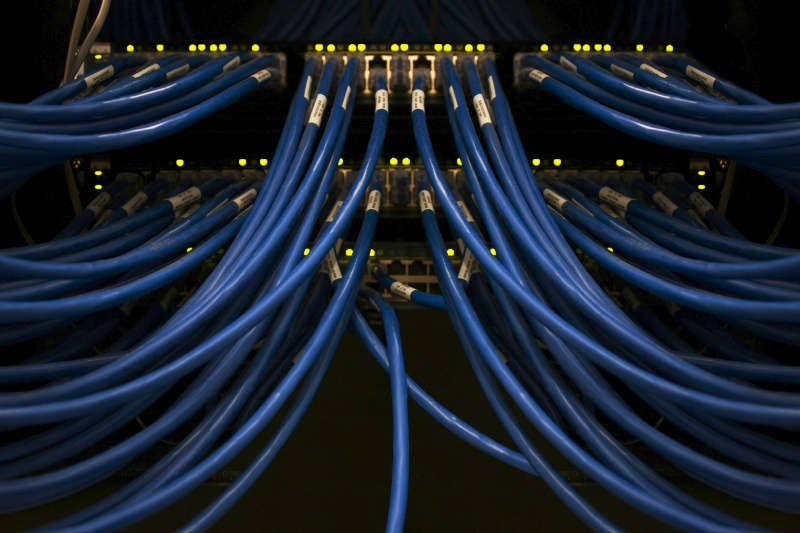

Заместитель главы белорусского Национального центра обмена трафиком (НЦОТ) Виталий Карбовский рассказал на конференции International Night Telecom Forum, что в последнее время многие крупные иностранные компании с большим объёмом трафика стали размещать свои кэширующие серверы в дата-центрах столицы Польше, Варшаве, чтобы повысить скорость загрузки контента для российских и белорусских пользователей.

Источник изображений: unsplash.com Карбовский пояснил журналистам РБК, что традиционная для операторов из России, Беларуси и Казахстана точка обмена трафиком во Франкфурте-на-Майне заметно перегружена — в том числе из-за роста числа пользователей VPN-сервисов. Кроме того, задержки при передаче пакетов из Варшавы до Москвы через Беларусь на 14–15 миллисекунд меньше, чем из Франкфурта. Он сообщил, что своё оборудование в Варшаве разместили Google, Facebook✴✴, Akamai (CDN-провайдер, работающий с Apple, Steam, Microsoft и другими крупными игроками), ByteDance (владелец видеосервиса TikTok) и другие компании. По его словам, «как минимум Google и Akamai обращались к белорусским операторам с просьбой оказать содействие в подключении российских операторов» через варшавское оборудование. Эту тенденцию подтвердил глава компании Piter-IX Николай Метлюк. Точка обмена трафиком в Санкт-Петербурге, принадлежащая Piter-IX, подключена к кэширующим серверам, размещённым в Варшаве. «Мы более двух лет просили зарубежных партнёров разместить там серверы — это наиболее близкая из возможных точек с учётом санкций и других нюансов», — пояснил он. Скорость загрузки контента зависит не только от ширины интернет-канала, но и от географии маршрута, по которому передаются пакеты. До 2022 года кэширующие серверы многих крупнейших поставщиков контента располагались на территории России. В ряде случаев доставка контента обеспечивалась крупными мировыми провайдерами CDN (Content Delivery Network — «сеть доставки контента»).  В 2022 году Google приостановила деятельность в России и прекратила модернизацию соответствующего оборудования. Именно этим представители Роскомнадзора объясняют резкое замедление работы YouTube, хотя в самой Google отрицают, что проблема связана с неисправностью их оборудования. Крупные операторы начали получать трафик Google с зарубежных точек обмена, что в сочетании с ростом популярности VPN-сервисов привело к увеличению общего трафика почти на треть. Мнения других участников рынка отличаются от позиции Карбовского и Метлюка. Многие считают, что перенос оборудования зарубежных поставщиков контента в Варшаву не приведёт к ускорению передачи данных. Генеральный директор принадлежащей «Ростелекому» московской точки обмена трафиком MSK-IX Евгений Морозов заявил, что большая часть контент-провайдеров подключена к ним напрямую, «их трафик доступен для всех участников и продолжает стабильно расти». Представитель «ВымпелКома» отметил, что Франкфурт «давно является традиционным местом обмена трафиком в Европе и активно развивается, оставаясь основной площадкой для операторов связи». По его словам, «изменения инфраструктуры в Варшаве никак не влияют на работу сети “Билайн”». Некоторые аналитики полагают, что размещение оборудования поставщиков контента в Варшаве теоретически может дать небольшой выигрыш в скорости, но разница будет незначительной. Тем не менее такая стратегия в любом случае повышает надёжность и связность Сети за счёт диверсификации инфраструктуры. YouTube перестал удалять видео, если в них «ценность свободы слова перевесит риск вреда»

09.06.2025 [19:33],

Сергей Сурабекянц

Видеосервис YouTube смягчил свою политику модерации и теперь не удаляет контент, который может нарушать правила платформы, если он «соответствует общественным интересам». Теперь модераторам не следует удалять контент, если «ценность свободы слова может перевесить риск вреда», включая обсуждение выборов, идеологий, движений, расы, пола, сексуальности, абортов, иммиграции, цензуры.

Источник изображений: unsplash.com Представитель YouTube Николь Белл (Nicole Bell) пояснила, что этот шаг расширяет изменение, внесённое перед выборами в США 2024 года, которое позволяет контенту от политических кандидатов оставаться на сайте, даже если они нарушают руководящие принципы сообщества. «Признавая, что определение ‘общественного интереса’ постоянно меняется, мы обновляем наши рекомендации по этим исключениям, чтобы отразить новые типы обсуждений, которые мы видим на платформе сегодня, — заявила она. — Наша цель остаётся прежней: защищать свободу слова на YouTube, одновременно смягчая вопиющий вред». YouTube показал реальные результаты внедрения новой политики. Видео, содержавшее освещение изменений политики министра здравоохранения в отношении вакцинации против COVID не было удалено, поскольку общественный интерес «перевешивает риск вреда». В 43-минутном видео о чиновниках правительства США присутствовали оскорбления трансгендеров, но оно прошло модерацию. YouTube также рекомендовал рецензентам не удалять видео из Южной Кореи, в котором говорилось о казни бывшего президента страны на гильотине. Эти изменения в политике модерации отражают общую тенденцию онлайн-платформ к смягчению цензуры после переизбрания Дональда Трампа (Donald Trump). Ранее в этом году Meta✴✴ аналогичным образом изменила свою политику в отношении разжигания ненависти и прекратила проверку фактов в заметках пользователей.  YouTube ужесточил свою политику в отношении дезинформации во время первого срока Трампа на посту президента США и пандемии COVID, начав удалять видео, содержащие ложную информацию о вакцинах от COVID и выборах в США. Apple разрешила переносить купленные приложения, музыку и контент между аккаунтами

12.02.2025 [19:14],

Владимир Фетисов

Компания Apple разрешила владельцам своих устройств перемещать купленные приложения, музыку и другой контент между разными учётными записями. Это нововведение будет доступно пользователям устройств компании по всему миру, за исключением Евросоюза, Великобритании и Индии.

Источник изображения: Apple Нововведение пригодится пользователям, у которых есть разные учётные записи для iCloud и покупок на платформе App Store. Если аккаунт использовался только для покупок, то их можно переместить в другой аккаунт, а уже оттуда осуществлять загрузку контента на устройство. Аналогичным образом подписки будут перемещаться вслед за приобретённым контентом. При этом нововведение не затронет данные iCloud, поскольку они не связаны с покупками. Перенесённый контент заменит контент в основном аккаунте следующим образом:

В некоторых случаях владельцы устройств Apple не смогут перемещать контент между аккаунтами:

В дополнение к этому купленный контент нельзя переносить из удалённой, деактивированной, заблокированной или отключённой УЗ. Ни один аккаунт Apple не сможет получить особый доступ к приложениям или контенту при переносе данных. Оба пользовательских профиля должны находиться в одном регионе. Ещё требуется включить двухфакторную аутентификацию на обеих УЗ, а также выполнить ряд других требований. Что нужно сделать, чтобы перенести купленный контент из одного аккаунта Apple в другой:

Apple отмечает, что пользователь может не увидеть опцию «Перенос покупок», если вы не имеете на это права. Telegram снова оштрафовали на 80 тыс. рублей за хранение данных россиян за границей

05.02.2025 [19:53],

Геннадий Детинич

ТАСС сообщил, что судебный участок мирового судьи № 422 Таганского района Москвы назначил административный штраф в размере 80 тыс. рублей в отношении мессенджера Telegram за отказ выполнить обязательства по локализации персональных данных россиян. Это уже второй такой штраф для компании. Предыдущий штраф был назначен в августе 2023 года и составил тогда 50 тыс. рублей.

Источник изображения: Rubaitul Azad / unsplash.com Компания Telegram Messenger Inc должна была выполнить распоряжение в рамках закона «О персональных данных», который обязывает российские и иностранные компании хранить персональные данные россиян только на территории страны. Требование о локализации применяется к иностранным компаниям, которые не имеют физического присутствия в РФ и осуществляют деятельность на территории страны. К другим компаниям закон оказался более строг. Сегодня стало известно о назначении штрафа в 2 млн рублей мессенджеру Discord за аналогичное правонарушение, а компаниям Apple и Google в прошлом году пришлось заплатить по аналогичной статье (ст. 13.11 КоАП РФ) по 12 и 15 млн рублей соответственно. Но больше всего заплатил в 2023 году Zoom — 115 млн рублей. Впрочем, Telegram тоже расставалась с шестизначными суммами в прошлом году. Суммы штрафов за неудаление контента экстремистского и порнографического содержания превысили 21 млн рублей. Французская сторона поступила иначе: Дурова арестовали в Париже, и это сразу возымело эффект. Блокировка каналов и удаление материалов сразу же подскочили в числе и превысили 15 млн случаев за год, что стало рекордом за всё время работы мессенджера. Стало известно, о чём Дуров говорил и что обещал на допросе во французском суде

18.01.2025 [13:21],

Владимир Фетисов

Основатель мессенджера Telegram Павел Дуров пообещал французским судьям улучшить модерацию контента на платформе. Об этом сообщила радиостанция France Info со ссылкой на собственные осведомлённые источники.

Источник изображения: Rubaitul Azad / unsplash.com Речь идёт о допросе, который состоялся 6 декабря и длился около 10 часов. В ходе допроса Дуров ответил на вопросы двух судей. «Отвечая на вопросы судей о незаконном контенте, который массово распространяется через Telegram, а также каналах, через которые реализуются наркотические средства, о похищенных банковских реквизитах, о возможности нанять киллера или о группах, предлагающих контент для педофилов, Павел Дуров, находившийся в сопровождении трёх адвокатов, пообещал "улучшить процедуры модерации" контента в Telegram», — говорится в сообщении France Info. Павел Дуров отметил, что Telegram уже ведёт работу по улучшению алгоритмов модерации контента и ежемесячно с платформы за нарушение законов удаляются «от 15 до 20 млн учётных записей пользователей» по всему миру. Он также добавил, что Telegram не является единственной соцсетью или мессенджером, используемым разного рода недобросовестными пользователями для распространения незаконного контента. Напомним, Дурова задержали во французском аэропорту Ле-Бурже в августе прошлого года. Позднее ему предъявили несколько обвинений, в том числе в соучастии в деятельности организованной группы по управлению онлайн-платформой для проведения незаконных транзакций, отказе от предоставления информации по запросу уполномоченных органов и др. Дурова отпустили из-под ареста, но на время проведения следствия он не имеет права покидать Францию. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |