|

Опрос

|

реклама

Быстрый переход

Сотрудники Amazon обвинили компанию в искажении истинных экологических показателей

16.07.2024 [13:23],

Руслан Авдеев

Как заявила группа сотрудников Amazon, компания «искажает правду» о том, в каком объёме её дата-центры на самом деле запитаны от источников возобновляемой энергии. По данным Datacenter Dynamics, это противоречит недавнему ESG-докладу, в котором сообщается, что гигант полностью перешёл на возобновляемые источники на семь лет раньше, чем было запланировано. Инициативная группа сотрудников Amazon Employees for Climate Justice (AECJ) поделилась результатами собственного расследования, согласно которым дата-центры компании лишь на 22 % обеспечены энергией из возобновляемых источников. AECJ утверждает, что Amazon скрывает тот факт, что энергоёмкие ЦОД действуют в сердце «угольного» региона США, а дальнейшее развитие ЦОД повысит потребление нефти и газа. Компания вкладывается в экспансию ЦОД в районах, сильно зависящих в энергоснабжении от нефти, газа и угля вроде Северной Вирджинии и Саудовской Аравии.

Источник изображения: Chris LeBoutillier/unsplash.com Выкладки AECJ основаны на том, что Amazon, как и многие организации, заявляет о постепенном переходе к нулевым выбросам, покупая сертификаты на возобновляемую энергию (Renewable Energy Credits, REC или СВЭ), которые косвенно компенсируют выбросы, связанные с питанием объектов компании от электростанций на ископаемом топливе. В AECJ рассчитали, что 68 % покупок REC являются «низкокачественными» и никак не связаны с получением новой возобновляемой энергии. Фактически речь идёт о покупке Amazon сертификатов на электричество, которое уже сгенерировано и истрачено совсем другими людьми. Сомнения в эффективности REC уже привели к тому, что некоторые компании перешли к приобретению т.н. соглашений о покупке энергии (PPA) 24×7, которые обеспечивают равное почасовое сопоставление фактически использованного ЦОД электричества и сгенерированной «чистой» энергии. Например, такие соглашения заключают и намерены заключать в ещё большем объёме Google и Microsoft, но Amazon к ним ещё не присоединилась, хотя и массово заключает обычные PPA. Группа процитировала пожелавших остаться анонимных сотрудников, которые рассуждают о том, что компания, возможно, намеренно лжёт всем, рассылая фото солнечных электростанций, чтобы убедить в «зелёном» курсе развития. Сотрудники считают, что Amazon должна сообщать о реальном прогрессе в достижении углеродной нейтральности хотя бы «своим» — чтобы те принимали больше усилий для достижения этой цели. AECJ организована в 2019 году в знак протеста на бездействие компании на фоне климатического кризиса. Группа призывает руководство делать большие инвестиции в возобновляемую энергетику в тех же регионах, где должны появиться новые ЦОД Amazon. Также подчёркивается, что несмотря на регулярные и объёмные отчёты о прогрессе в области экоустойчивости, фактически всеобъемлющий план достижения нулевых выбросов к 2040 году отсутствует. Представитель руководства Amazon отметил, что в докладе содержатся верные данные, использованы прозрачные методики, а данные из представленного оппонентами доклада неверны, поскольку ссылаются на сведения и мнения от источников вне компании, не владеющих вопросом. Буквально на днях сообщалось, что у Amazon (в отличие от Google и Microsoft) выбросы падают уже не первый год подряд. Правда, в абсолютном выражении они выросли на 34 %. Изменение климата замедлило вращение Земли и повлияло на дрейф полюсов

16.07.2024 [13:17],

Геннадий Детинич

Учёные из Швейцарии при поддержке NASA впервые создали наиболее полную модель изменения скорости Земли и дрейфа полюсов в зависимости от множества факторов. Эта работа была бы невозможной без использования машинного обучения, что позволит в будущем давать наиболее точный прогноз о положении Земли в космическом пространстве. Это важно для космических полётов, ведь каждый сантиметр ошибки на старте обернётся сотнями метров отклонения от цели путешествия.

Замедление скорости вращения Земли делает дни длиннее. Источник изображения: ИИ-генерация Кандинский 3.0/3DNews По предыдущим работам мы уже знаем, что таяние полярных льдов ведёт к оттоку воды к экватору. Это собирает там массу и как бы утолщает Землю, что похоже на действия фигуриста, который замедляет своё вращение волчком с помощью вытянутых в стороны рук. С помощью ИИ учёные из Высшей технической школы Цюриха (ETH Zurich) выяснили, что подобное климатическое воздействие на поведение Земли намного глубже, чем предполагалось. Изменение центра масс нашей планеты также ведёт к смещению оси вращения Земли (к дрейфу полюсов) и к процессам в мантии, ядре и жидком металлическом слое, обволакивающем внутреннее ядро Земли. Влияние человека на климат оказывает комплексное воздействие на планету, с чем нам теперь придётся жить. И даже на её положение в космическом пространстве. Более того, со временем антропогенное климатическое воздействие человека на скорость вращения Земли окажется выше, чем воздействие на этот параметр Луны, которая виновна в приливном торможении нашей планеты. Согласно астрономическим наблюдениям с начала прошлого века, ось вращения Земли понемногу смещается. За сто лет полюса сместились примерно на 10 м. Представленная швейцарцами модель в точности соответствовала результатам наблюдений, что обещает работать также в случае прогнозов. В будущем это поможет планировать запуски космических аппаратов к далёким и не очень уголкам Солнечной системы. Ведь ошибка в несколько сантиметров на старте, например, обернётся промахом в сотни метров при посадке на Марсе. ИИ и глобальные амбиции: Аркадий Волож рассказал, чем займётся зарубежная часть «Яндекса» после разделения

16.07.2024 [13:14],

Алексей Разин

Вчера было объявлено о завершении реструктуризации «Яндекса» — компания стала российской, а прежде владевшая ею нидерландская Yandex N.V. сохранила за собой несколько иностранных бизнесов и вскоре будет переименована в Nebius Group. Один из основателей «Яндекса» Аркадий Волож возглавил компанию Nebius. Её развитие будет происходить вокруг искусственного интеллекта, как дал понять Волож в интервью Bloomberg.

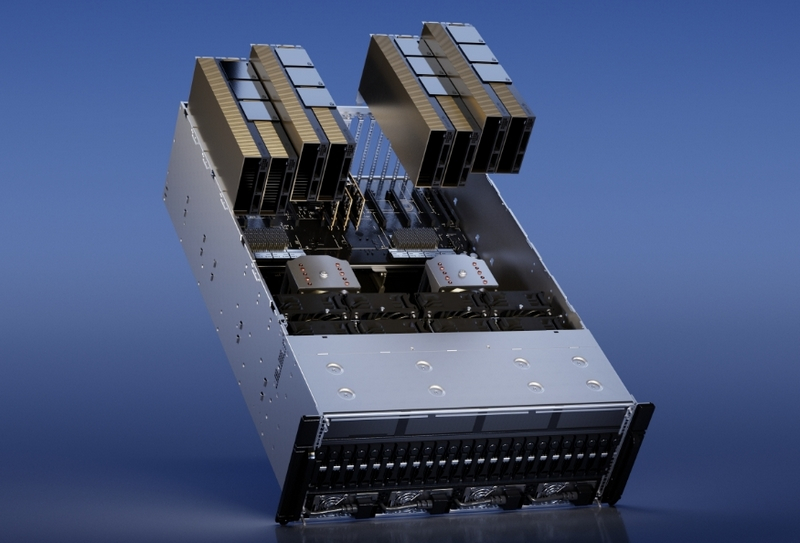

Источник изображения: Wikipedia Своими комментариями Аркадий Волож делился из Амстердама, где зарегистрирована Nebius Group, но он подчеркнул, что компания сохранит исследовательский хаб в Тель-Авиве, где почти десять лет проживает сооснователь «Яндекса». Кроме того, у компании Nebius имеются офисы в Амстердаме и американском Остине, штат Техас. На американскую фондовую площадку Nebius также рассчитывает вернуться, как только будет разблокирована возможность торгов её акциями. Кроме того, Nebius собирается выкупить акции у инвесторов. Это отчасти позволит перераспределить средства, вырученные Yandex N.V. от продажи российских активов, и одновременно позволит проститься с компанией тем акционерам, которые не видят своего будущего в таком качестве. После вычета всех сопутствующих расходов, реструктуризация Yandex N.V. принесла компании около $2,5 млрд. Волож также дал интервью изданию The Bell✶ (признано в РФ иноагентом), в котором поведал, что за последние два года успел осознать, что бум систем искусственного интеллекта для возглавляемого им бизнеса буквально может стать той «золотой антилопой», которой в конце прошлого века для «Яндекса» стал поиск. «У меня лично ощущение, что AI — это не хайп, а всерьёз и надолго. Примерно так же, как было с интернетом и поиском в 90-е: большое изменение, которое происходит раз в поколение», — рассуждает предприниматель. И под ИИ придётся перестраивать всю имеющуюся IT-инфраструктуру. Именно на создание новой инфраструктуры и нацелен стартап Nebius Group. «Мы создаём полнофункциональную инфраструктуру для обслуживания бурного роста мировой индустрии искусственного интеллекта, включая крупномасштабные кластеры графических процессоров, облачные платформы, а также инструменты и услуги для разработчиков», — отметили в Nebius. Основными клиентами Nebius должны стать ИИ-стартапы, работающие над созданием или развитием нейросетей. Им тоже необходимо много вычислительных мощностей, но получить их тяжело. Инфраструктура сейчас — главное бутылочное горлышко индустрии, считает Волож, дата-центров и электричества на всех не хватает. «Мы постараемся быть для этих стартапов самой главной инфраструктурой. Мы сами вышли из бигтеха, но сейчас на морозе — также как и они. Так что понимаем, с чем они имеют дело», — отметил основатель «Яндекса». В ближайшие полтора-два года Nebius будет строить на севере Европы новые центры обработки данных, которые будут потреблять сотни мегаватт электроэнергии. Часть вычислительных мощностей будет арендоваться. Nebius намеревается оказывать услуги клиентам по всему миру. Потенциально компания способна получать несколько миллиардов выручки ежегодно, как отмечается в её сообщении. Бизнес в сфере ИИ должен стать для Nebius основным источником прибыли, поэтому и название для новой компании было позаимствовано у одного из стартапов, доставшихся Yandex N.V. после отделения российских активов. Руководить операционной деятельностью бизнеса Nebius в сфере ИИ будет лично Волож. Ему также удалось пригласить в Nebius из «Яндекса» около 400 инженеров с опытом разработки систем искусственного интеллекта, облачных сервисов и инфраструктуры для них. В общей сложности в компании Nebius Group работают около 1300 сотрудников, из них более тысячи имеют опыт работы в «Яндексе».

Источник изображения: Яндекс Часть средств Nebius будет направлена на развитие финского центра обработки данных, который лёг в основу суперкомпьютера ISEG, называемого Воложем самым производительным в Европе. Это очень энергоэффективный ЦОД, поскольку выделяемое им тепло используется для отопление финского города Мянтсяля, в котором он расположен. Суперкомпьютер ISEG является 19-м по производительности в мире. Важно, что у Nebius налажены хорошие связи с Nvidia, чьи ускорители вычислений компания сейчас вынуждена закупать в условиях дефицита, но в этом отношении последняя предоставляет бывшей Yandex N.V. определённый приоритет в закупках. Сопутствующие проекты компания также не забросит. Американский стартап Avride будет разрабатывать автопилот для наземных транспортных средств и автоматизированных средств доставки грузов. Подразделение Toloka AI будет заниматься оптимизацией процесса разработки систем искусственного интеллекта, а TripleTen сосредоточится на образовательных технологиях в сфере переподготовки кадров для технологической отрасли. Кроме того, у Nebius Group остался пакет акций в компании ClickHouse, которая специализируется на разработке СУБД с открытым исходным кодом. «Вся компания будет построена на бизнес-модели, связанной с искусственным интеллектом. Мы поймали эту волну, и мы будем на ней двигаться», — пояснил Аркадий Волож в интервью Bloomberg. Компания Nebius также будет привлекать дополнительные инвестиции на своё развитие. В частности, бизнес по разработки систем автопилота Avride может потребовать не только существенных финансовых вливаний, но и поиска стратегического партнёра из числа автопроизводителей. Структура капитала Nebius Group такова, что Аркадию Воложу и его ближайшему окружению через трасты принадлежат 15,5 % экономической доли и 59,2 % голосующей. Ещё 11 % голосов принадлежат директорам и сотрудникам компании различного уровня, а в свободном обращении будут находиться 78 % экономической доли и 29,8 % голосующей. CD Projekt Red раскрыла секрет, как стать разработчиком игр — половина авторов квестов для сиквела Cyberpunk 2077 раньше были моддерами

16.07.2024 [13:11],

Михаил Романов

Благодаря успехам в сфере пользовательского контента моддеры нередко получают работу в настоящих игровых студиях, и в случае с продолжением ролевого боевика Cyberpunk 2077 от CD Projekt Red это особенно актуально. Портал PCGamesN со ссылкой на младшего режиссёра CD Projekt Red Павла Саско (Pawel Sasko) сообщил, что команда в ответе за квесты сиквела Cyberpunk 2077 (кодовое название Orion) наполовину состоит из экс-моддеров. «Половина команды квестовиков [следующей Cyberpunk] — той, что занимается построением заданий и насчитывает сейчас 24 человека, — это бывшие моддеры», — раскрыл Саско. По словам Саско, до работы в CD Projekt Red эти специалисты делали моды для The Witcher, Cyberpunk 2077 и других игр. Так, например, режиссёр квестов Блажей Августинек (Błażej Augustynek) был моддером StarCraft. Авторы модов трудятся в CD Projekt Red и за пределами отдела квестов: студия плотно работает с командой мододелов Jigsoft, которая в ответе за выпущенный недавно редактор REDkit для The Witcher 3: Wild Hunt. «Всегда советую молодым людям, которые спрашивают о способах попасть в игровую индустрию, учиться моддингу. Сейчас так много инструментов для обучения, и одни из наших лучших специалистов — бывшие моддеры», — считает Саско. Orion сейчас на ранней стадии разработки, так как большая часть CD Projekt Red занята следующим «Ведьмаком» (Polaris). В её команде, к слову, числится бывший моддер, впечатливший Саско переносом пролога первой The Witcher в третью. Разработку российской консоли оценили всего в 1 млрд рублей, но в целом денег понадобится куда больше

16.07.2024 [13:07],

Павел Котов

Разработка отечественной игровой консоли обойдётся в 1 млрд рублей, по оценке основанной бывшим министром связи России Леонидом Рейманом АО НТЦ ИТ «Роса». Об этом сообщил представитель компании на совещании, которое состоялось в Минпромторге 12 июля, передают «Ведомости» со ссылкой на собственный источник. В компании не уточнили, на что пойдут эти средства, и на каком этапе находится разработка устройства.

Источник изображения: Jan Vašek / pixabay.com В посвящённом обсуждению отечественной консоли совещании в Минпромторге приняли участие также представители таких производителей электроники как Fplus, МЦСТ, «Аквариус» и GS Group. «По итогам совещания не было понятно, на что конкретно нужна запрашиваемая сумма, и из чего она складывается. У нас сложилось понимание, что государство не будет полностью в одиночку финансировать проект», — сообщил «Ведомостям» гендиректор Организации развития видеоигровой индустрии Василий Овчинников. Совещание проводил замминистра промышленности Василий Шпак — он отметил, что государство готово поддержать проекты приставок, но вкладываться в них придётся и бизнесу. Рынком сбыта устройств может быть не только Россия, но и дружественные страны: Китай, Иран и ОАЭ. Проработка проекта будет поручена рабочей группе, в которую также войдут фонды «Сколково» и Бортника. В Минпромторге подчеркнули, что поддержка будет оказана только проектам на отечественных платформах — производные AOSP (открытой версии Google Android) государственного финансирования не получат. Объёмы финансирования, модели вывода устройства на рынок и его реализации, а также разработчик проекта пока не определены. От курирующего проект ведомства потребуются существенные усилия для координации работы его участников и создания условий для финансовой привлекательности проекта — Минпромторг, как показало совещание, эту роль взять на себя не готов, и он «ориентируется на запросы и готовые предложения от участников рынка», сообщил источник «Ведомостей». Эксперты расходятся во мнениях относительно стоимости разработки отечественной игровой консоли. Гаухар Алдиярова из «Леста игры» полагает, что изначальная оценка в 1 миллиард рублей может оказаться заниженной, ссылаясь на опыт Sony, которая инвестировала $1,7 млрд только в создание процессора для PlayStation 3. В то же время, современные технологии и готовые решения могут существенно оптимизировать процесс и снизить затраты. «Миллиарда достаточно, чтобы произвести пробную партию на импортных в основном комплектующих и начать работать с разработчиками игр, — отметил сооснователь Организации развития видеоигровой индустрии Вячеслав Макаров. — Но для полноценной экосистемы игровой консоли этих средств, мне кажется, недостаточно». Овчинников рассказал, что вопрос с контентом был одним из основных на совещании. «В России сейчас ни у кого нет экспертизы, которая позволила бы производить собственную консоль уровня PS или Xbox, — заявил представитель Fplus. — Нужны время и серьезные финансовые вложения. Кроме того, под нее нужно разработать ОС и платформу, а также игры, чтобы магазин не был пустым». Представитель Fplus отметил, что самый быстрый вариант — создание портативных устройств, подобных Steam Deck, или игровых стиков для Smart TV. Эти продукты можно производить по OEM-технологии, что значительно упростит процесс. Они будут совместимы с широким спектром существующих игр для аналогичных платформ. Что касается создания консолей уровня PlayStation или Xbox, эксперт Fplus считает это долгосрочным проектом. По его оценке, для получения значимых результатов потребуется от 5 до 10 лет. В марте президент Владимир Путин поручил проработать вопрос создания российской консоли — речь шла о стационарных и мобильных приставках, собственной ОС и облачной игровой платформе. В мае появились сведения, что НТЦ ИТ «Роса» уже ведёт разработку российской игровой приставки и ПО для неё — компания готовит варианты на Arm-процессоре и чипе x86, которые будут работать под управлением ОС на ядре Linux. Директор по развитию МЦСТ (разработчика процессоров «Эльбрус») Константин Трушкин представил на совещании мини-ПК, который компания, по его утверждению, готова «переупаковать» в консоль. Гендиректор ООО «Открытая мобильная платформа» (разработчика мобильной ОС «Аврора») Павел Эйгес продемонстрировал консоль на архитектуре x86. Представитель «Ростелекома» заявил на совещании, что портативная версия устройства должна стоить не менее 30 тыс. руб., а «предпочтение должно быть отдано ретро- и инди-играм». Intel активно финансирует китайские ИИ-стартапы, что сильно беспокоит власти США

16.07.2024 [12:54],

Алексей Разин

Контролируемый Intel венчурный фонд является одним из самых активных иностранных инвесторов в китайские стартапы, связанные со сферой искусственного интеллекта и полупроводниковых компонентов. Через эту структуру Intel владеет долями в капитале 43 молодых китайских компаний технологической сферы, и американские чиновники озадачены этим обстоятельством.

Источник изображения: Intel Как поясняет Financial Times, венчурный фонд Intel Capital начал свою деятельность в девяностых годах прошлого века, и за прошедшее с тех пор время вложил средства в более 120 китайских компаний. Даже в прошлом году подобная деятельность не прекращалась, хотя на фоне усиления антикитайских санкций многие американские институциональные инвесторы стали сворачивать своё сотрудничество с китайскими компаниями. В прошлом году Intel Capital вложил $91 млн в шанхайского разработчика оптического оборудования North Ocean Photonics. В феврале текущего года были потрачены $20 млн на поддержку разработчика облачной платформы для сетей 5G, компании AI-Link из Шэньчжэня. Всего сейчас Intel оказывает поддержку 16 китайским стартапам, которые работаю в сфере искусственного интеллекта, а также 15 стартапам, которые занимаются разработкой полупроводниковых компонентов. За время своего существования Intel Capital вложил более $20 млрд в молодые компании по всему миру. В прошлом месяце власти США предложили ограничить инвестиционную активность американских компаний в те сферы экономики КНР, которые будут способствовать развитию технологий двойного назначения. Искусственный интеллект, квантовые вычисления и полупроводниковые компоненты вошли в этот перечень, но его окончательная редакция будет опубликована в текущем году. По данным знакомым с ситуацией источников, именно деятельность венчурного фонда Intel в Китае стала главным стимулом для властей США выступить с новыми ограничениями. Впрочем, с января 2023 года Intel на территории Китая заключила только три инвестиционные сделки, так что можно говорить о снижении её активности в этой сфере. Хотя Qualcomm также обладает венчурным подразделением, его активность в Китае заметно уступает Intel. Если же рассматривать все американские венчурные фонды, которые проявили себя в Китае, то к настоящему моменту он вложили $1,9 млрд в сферу искусственного интеллекта, а также $1,2 млрд в сегмент полупроводниковых компонентов. Правда, американские фонды Sequoia Capital и GGV Capital в прошлом году избавились от своих китайских подразделений на фоне увеличения политического давления. С 2015 года Intel Capital в Китае инвестировал в ряд сделок, общая стоимость которых оценивается $1,4 млрд, хотя доля Intel в них заметно ниже названной суммы. В 2015 году венчурный фонд Intel вложил в китайские стартапы $67 млн в общей сложности. К 2014 году компанией было на подобные нужды потрачено $670 млн, деятельность фонда охватила более 110 молодых китайских компаний. Американским чиновникам удалось установить, что в период с 2015 по 2021 годы Intel Capital приняла участие в финансировании деятельности нескольких китайских компаний, связанных с искусственным интеллектом, заключив в общей сложности 11 сделок. По данным самой Intel, их количество не превысило четырёх. По их условиям, в некоторых случаях Intel получила место в совете директоров соответствующих китайских компаний. В одном случае Intel оказала поддержку китайской компании, которая позже попала под прямые санкции США. Речь идёт о iFlytek, которая занимается разработкой технологии распознавания речи. С 2002 по 2005 годы Intel владела 3 % акций этой компании, но под санкции последняя попала только в 2019 году, когда американский производитель процессоров уже порвал с ней все связи. По мнению представителей отрасли, Intel изначально хотела не отставать от конкурентов, инвестируя в перспективные сторонние разработки как в дружественных США странах по всему миру, так и в недружественных. В кнопочных телефонах российской Digma нашли вредоносное ПО

16.07.2024 [12:52],

Павел Котов

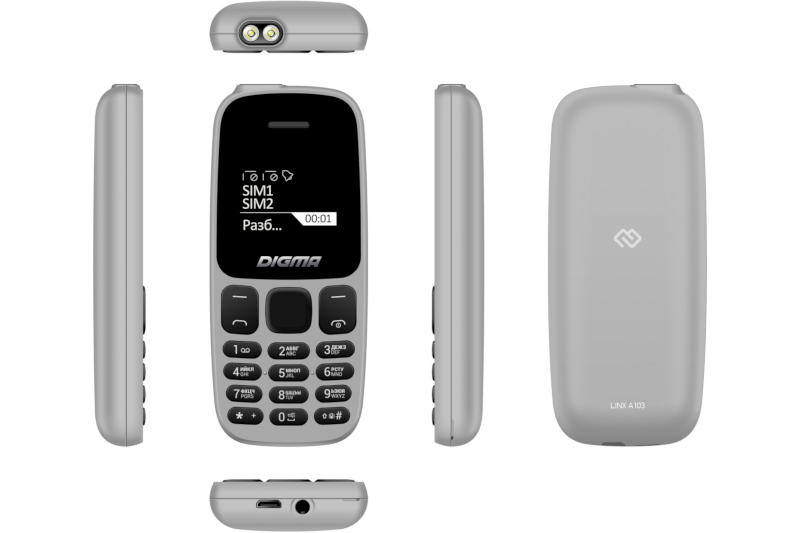

Эксперты по кибербезопасности обнаружили в кнопочных телефонах Digma бэкдор — встроенную уязвимость для установки связи и обмена данными со сторонними серверами, удалённой рассылки SMS, регистрации аккаунтов в мессенджерах на телефонные номера и других действий, узнал «Коммерсантъ». Продажи кнопочных телефонов Digma растут — сейчас они занимают 5,9 % рынка.

Источник изображения: digma.ru Кнопочные телефоны российского бренда Digma (входит в «Мерлион» наряду с «Ситилинком») стали объектами кибератаки, в рамках которой осуществлялись негласные отправка, приём и фильтрация SMS из-за бэкдора — намеренно установленной при производстве уязвимости. Через месяц после покупки телефона Digma и подключения к нему новой SIM-карты неизвестные лица зарегистрировали на этот номер учётную запись в мессенджере WhatsApp без ведома владельца номера, сообщил он «Коммерсанту». Последующий анализ прошивки показал, что телефон действительно заражён вредоносным ПО. Он периодически связывается через интернет с неким сервером, передавая ему свой IMEI-идентификатор, идентификатор SIM-карты и оператора связи. В ответ удалённый сервер может отправлять устройству команды: например, отправить SMS с заданным текстом на определённый номер или вывести на экран полученное сообщение. Отправленные и принятые сообщения в общем списке не показываются. В Digma владельцу устройства подтвердили наличие «аномалий» в работе устройства, но отказались признать факт уязвимости. Комментариев «Коммерсанту» в Digma и «Мерлионе» по данной ситуации не предоставили. Продажи кнопочных телефонов Digma растут: в период с января по май 2024 года доля бренда достигла 5,9 %; на торговых площадках этот показатель составил 13,6 %, а годом ранее был 7,6 %. Устройства марки производятся преимущественно в Китае. Подобные уязвимости могут возникать по вине контрактного производителя, рассказали в компании Fplus, которая выпускает кнопочные телефоны, смартфоны и планшеты. Ранее подобные инциденты отмечались у продукции брендов Irbis и Dexp. В некоторых случаях проблема может быть на стороне поставщика ПО, добавили опрошенные «Коммерсантом» эксперты. Бэкдоры также могут использоваться для кражи данных, рассылки спама, реализации мошеннических схем по номерам в списке контактов, а доступ к SMS открывает потенциальным злоумышленникам доступ к приложениям и сервисам пользователя — вплоть до банковских. Не исключаются и массовые утечки данных. Китай создал первую в мире морскую двуглавую ветряную турбину — она будет работать даже в сильный тайфун

16.07.2024 [12:34],

Геннадий Детинич

Китайская компания Mingyang Smart Energy завершила создание уникальной морской двухроторной ветряной турбины OceanX общей мощностью 16,6 МВт. Установка способна оставаться в работе даже при скорости ветра 260 км/ч. Масса этого уникального плавучего объекта достигает 16 500 т, а конструкция выдерживает волны высотой 30 м. Вскоре вдоль морского побережья Китая могут появиться сотни и тысячи таких ветряных установок, обеспечивая материк чистой энергией.

Источник изображений: Mingyang Smart Energy Прототип двухроторной плавучей ветряной установки OceanX в масштабе 1:10 компания Mingyang изготовила ещё в 2020 году. На днях было завершено производство полномасштабной серийной версии турбины. Колоссальная плавучая установка изготовлена из высоконадёжного бетона, устойчивого к агрессивной среде. Поплавок имеет вид буквы Y. Он крепится ко дну глубиной свыше 35 м одним якорем, что позволяет ветряной турбине всегда разворачиваться по ветру. Две турбины мощностью по 8,3 МВт каждая размещены на вершинах стойки в форме буквы V. Турбины дополнительно закреплены растяжкой из тросов. Диаметр каждого ротора составляет 182 м. Лопасти вращаются в разных направлениях, чтобы избежать центробежной нагрузки на установку. Вся система выдерживает турбулентность на уровне 0,135, что означает возможность работы в чрезвычайно сложных условиях. Обычно турбины отключают при превышении турбулентности значения 0,06, чтобы механизм не вышел из строя от сильных вибраций, что, явно, не грозит китайской морской турбине.  По данным Глобального совета по ветроэнергетике, Китай шестой год подряд занимает первое место в мире по развитию морской ветроэнергетики. Цель Китая — обеспечить к 2025 году треть своего национального энергопотребления за счет возобновляемых источников. Протяженность береговой линии Китая составляет около 9 010 миль (14 500 км), поэтому для морских ветряных электростанций там вполне достаточно места. Но кроме всего этого, мало кого оставит равнодушным полёт инженерной мысли — это просто колоссально. Такие игры «не продаются»: первая BioShock получила право на жизнь благодаря хитрому трюку разработчиков

16.07.2024 [12:03],

Михаил Романов

Оригинальная BioShock от Irrational Games стала классикой жанра и любимицей фанатов, однако на заре разработки всё было далеко не так очевидно. Будущий хит едва не заглох на самом старте. В разговоре с журналом Edge бывший руководитель Irrational Games Кен Левин (Ken Levine) рассказал, что отговаривал сотрудников от создания духовного наследника System Shock 2, так как подобные игры «не продаются», но в итоге сдался. По команде Левина студия подготовила «дешёвый» прототип и начала поиск издателя, однако везде получала вежливый отказ. Тогда Irrational пошла на хитрость: показать игру СМИ и таким образом сгенерировать ажиотаж. Трюк сработал. «Уже на следующий день, когда люди увидели статью, нам начали поступать звонки. Думаю, у издателей возникло ощущение спроса [на проект]», — вспоминает Левин хитрость, которая позволила Irrational заручиться поддержкой 2K. 2K выделила для BioShock «скромный бюджет», но после покупки Irrational Games в 2006 году вложила в игру «ещё кучу денег». Левин настаивает, что по сравнению с конкурентами разработка проекта была «невероятно дешёвой». Левин также заявил, что под крылом издателя BioShock выходила за рамки бюджета и установленных сроков, из-за чего 2K «едва не отменила» игру. Насколько серьёзной была угроза преждевременной кончины, неясно. BioShock вышла в 2007 году и дала старт успешной серии, которая теперь развивается без Левина. Он после закрытия Irrational Games основал студию Ghost Story Games — она занята похожим на BioShock сюжетным шутером Judas. Складной смартфон Xiaomi Mix Fold 4 представят 19 июля

16.07.2024 [11:22],

Владимир Мироненко

На прошлой неделе генеральный директор Xiaomi Лэй Цзюнь (Lei Jun) пообещал, что складные смартфоны Mix Fold 4 и Mix Flip выйдут в этом месяце. И сегодня Xiaomi назвала дату презентации первого из них. Смартфон Mix Fold 4 представят 19 июля на мероприятии в Китае. Презентация новинки начнётся в 19:00 по местному времени (14:00 мск).  На данный момент о Xiaomi Mix Fold 4 известно немного. Как сообщила компания, складной смартфон нового поколения весит 226 г при толщине корпуса в сложенном виде 9,47 мм. Также сообщается, что Mix Fold 4 имеет водонепроницаемость согласно стандарту IPX8, поддерживает беспроводную быструю зарядку мощностью 50 Вт, а также двустороннюю спутниковую связь. Спецификации Mix Fold 4 также включают четыре камеры с оптикой Leica, в том числе два телеобъектива, один из которых — перископической с 5-кратным зумом.  Помимо Mix Fold 4 на мероприятии будут представлены беспроводные наушники Smart Band 9 и смартфон Redmi K70 Ultra, некоторые характеристики которого компания раскрыла на прошлой неделе. Redmi K70 Ultra оснащён 4-нм чипом MediaTek Dimensity 9300+ с тактовой частотой 3,4 ГГц. В устройстве используется новая технология охлаждения, позволяющая снизить температуру чипа на 3 °C. Также сообщается, что Redmi K70 Ultra стал первым смартфоном, в котором используется дисплей 1.5K C8+ совместной разработки Redmi и TCL с частотой обновления 144 Гц и ШИМ-регулировкой яркости подсветки с частотой 3840 Гц. Также известно о 50-Мп камере с сенсором Sony IMX906 с оптической стабилизацией и батарее ёмкостью 5500 мА·ч с быстрой 120-Вт зарядкой. «Лаборатория Касперского» полностью прекратит деятельность в США и уволит всех местных сотрудников

16.07.2024 [11:18],

Павел Котов

«Лаборатория Касперского» полностью свернёт свою деятельность в США и ликвидирует действующие в стране рабочие места — причиной тому стал введённый администрацией президента страны запрет на продажи и использование продуктов разработчика в США. Об этом сообщает The Register со ссылкой на представителя компании.  Процедура закрытия американского представительства «Лаборатории Касперского» начнётся в конце текущей недели — мера коснётся менее чем 50 сотрудников компании в США. «Начиная с 20 июля, „Лаборатория Касперского“ постепенно свернёт свою деятельность в Соединённых Штатах и ликвидирует соответствующие должности. Решение и процедура последуют за окончательным определением Министерства торговли США, запрещающим продажу и распространение продукции „Лаборатории Касперского“ в стране», — заявили в компании. В июне о фактическом запрете деятельности разработчика защитного ПО в стране сообщила глава Министерства торговли Джина Раймондо (Gina Raimondo) — она также заявила, что из соображений национальной безопасности компания с 20 июля не сможет продавать свои продукты в США, а с 29 сентября лишится возможности предоставлять клиентам в стране обновления своего софта, что сделает его в значительной степени бесполезным. На следующий день Министерство финансов США ввело персональные санкции в отношении руководства компании за исключением её основателя и главы — Евгения Касперского. В самой «Лаборатории Касперского» заявили, что санкции были введены из-за «нынешнего геополитического климата и теоретических опасений», и с фактическим качеством продукции эти меры не связаны. В компании отвергли предположения, что её продукция представляет угрозу национальной безопасности США — в Вашингтоне, однако, настаивают, что ПО «Лаборатории Касперского» может использоваться для взлома американских систем. «Компания тщательно изучила и оценила влияние юридических требований США и приняла это печальное и непростое решение, поскольку возможности для дальнейшего ведения бизнеса в стране отсутствуют. <..> Бизнес „Лаборатории Касперского“ сохраняет устойчивость, и приоритет остаётся прежним — защищать от киберугроз наших клиентов в любой стране. Будучи мировым поставщиком решений в области кибербезопасности, компания продолжит инвестировать в стратегические рынки и останется приверженной обслуживанию своих клиентов и партнёров и обеспечению их защиты», — заявили в «Лаборатории Касперского». Суммарный объём отгруженных за квартал HDD достиг 290 Эбайт

16.07.2024 [10:45],

Сергей Карасёв

Компания TrendFocus, по сообщению ресурса StorageNewsletter, подвела итоги исследования мирового рынка HDD во II четверти 2024 года. Если рассматривать отрасль в штучном выражении, то отгрузки остались на уровне предыдущего квартала — около 30 млн единиц. Однако в плане суммарной вместимости зафиксировано увеличение с 262 до 290 Эбайт, то есть, примерно на 11 %. В сегменте накопителей LFF и SFF корпоративного класса, как отмечается, продолжается восстановление спроса — в том числе благодаря заказам со стороны гиперскейлеров. Продажи Nearline-дисков в период с апреля по июнь включительно составили 13,5 млн единиц, а их суммарная ёмкость достигла 240 Эбайт. Однако спрос на производительные HDD упал в квартальном исчислении более чем на четверть — до 1,1 млн штук.

Источник изображения: Seagate Seagate является ведущим игроком рынка. В течение II квартала 2024 года компания реализовала, по оценкам, 12,1–12,5 млн дисков, заняв в результате 40,7 % отрасли. Отгрузки увеличились в квартальном исчислении на 6,9–10,4 %, но снизились на 15,4–12,6 % в годовом. На втором месте располагается Western Digital с 11,8–12,2 млн поставленных устройств, что соответствует доли в 39,7 %. В квартальном выражении продажи поднялись на 0,7–4,1 %, а в годовом — снизились на 12,3–8,4 %. Замыкает тройку Toshiba, у которой отгрузки составили 5,8–6,0 штук: это на 12,7–9,6 % меньше квартал к кварталу, но на 11,8–15,6 % больше год к году. Доля компании — около 19,5 %. В исследовании также говорится, что во II четверти 2024 года продажи LFF-накопителей для ПК и потребительской электроники (включая внешние HDD) незначительно выросли, составив 9,4 млн единиц. А спрос на SFF-решения для мобильных устройств и потребительской электроники уменьшился на 10 % — до примерно 6,1 млн штук. «Искра Технологии» запустила серийное производство российских GPON-роутеров

16.07.2024 [10:43],

Владимир Мироненко

Компания «Искра Технологии» запустила серийное производство роутеров с поддержкой технологии GPON. Как сообщается на сайте компании, массовое производство домашних абонентских шлюзов GPON по заказу «Ростелекома» стартовало в июне на базе производственной площадки в Екатеринбурге. «Это первый проект производства массового абонентского оборудования, который реализуется в интересах ПАО “Ростелеком”. Текущие производственные мощности позволят предприятию выпускать несколько сотен тысяч изделий в год», — сообщила компания. В октябре прошлого года было объявлено о заключении «Ростелекомом» контракта с компанией «Электра» на разработку и поставку Wi-Fi роутеров на сумму 2,7 млрд руб., включая 1,1 млрд руб. на разработку и внедрение 350 тыс. FTTB CPE и 1,6 млрд руб. — на 450 тыс. GPON ONT. Как отметил директор департамента технологий доступа АО «Искра Технологии», создание производства роутеров в России на собственной производственной базе позволит не только удовлетворить растущий спрос на высокотехнологичное оборудование, но и будет способствовать созданию новых рабочих мест и укреплению технологического суверенитета страны. Абонентская база «Ростелекома» во II квартале 2023 года составляла по данным «TMT консалтинга» порядка 12,6 млн человек. То есть, потенциал для расширения производства роутеров для АО «Искра Технологии» имеется даже в случае сотрудничества только с одним «Ростелекомом». Warhammer 40,000: Space Marine 2 оказалась на торрентах за полтора месяца до релиза — издатель блокирует утечки, но уже поздно

16.07.2024 [10:29],

Михаил Романов

Хотя до релиза Warhammer 40,000: Space Marine 2 остаётся ещё более полутора месяцев, в амбициозный боевик от разработчиков из студии Saber Interactive уже можно сыграть, но не в рамках обещанной (и отменённой) «беты». Как сообщил портал Insider Gaming, на торрент-трекерах неожиданно появилась почти законченная версия Warhammer 40,000: Space Marine 2. Сборка датируется 20 июня, так что релизной не является — игра ушла на золото 9 июля. Очевидцы сообщают, что утёкшая сборка Warhammer 40,000: Space Marine 2 включает сюжетную кампанию целиком, а также бинарные файлы сервера — в теории это открывает доступ к мультиплееру. Судя по первым отзывам, попавшая на торренты версия Space Marine 2 занимает 75 Гбайт, не имеет DLSS/FSR, зато поддерживает русский язык. Как и многие другие элементы, впрочем, локализация представлена не в финальном виде. Публиковать ссылки на скачивание Warhammer 40,000: Space Marine 2 мы не будем, но отметим, что на YouTube и в социальных сетях уже циркулируют скриншоты и геймплейные видео с демонстрацией утёкшей версии. Издатель Warhammer 40,000: Space Marine 2 в лице компании Focus Entertainment наряду с Saber Interactive утечки активно блокирует, однако шанс наткнуться на спойлеры всё равно остаётся. Warhammer 40,000: Space Marine 2 выйдет 9 сентября на PC (Steam), PS5, Xbox Series X и S, а покупатели премиальных изданий получат доступ к игре 5 сентября. Обещанную «бету» решили не проводить, чтобы сосредоточиться на подготовке к релизу. В США создали «вечный» реактивный двигатель для беспилотников — в нём нечему ломаться

16.07.2024 [10:08],

Геннадий Детинич

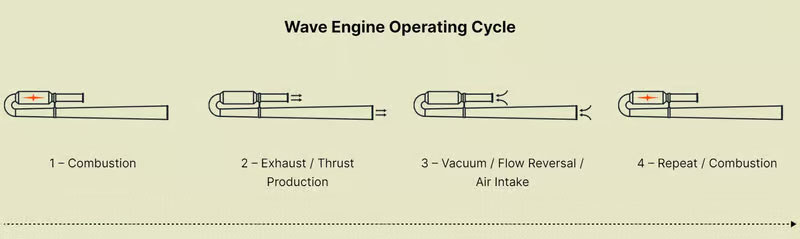

Компания Wave Engine Corporation объявила о начале поставок оборонному подрядчику новых реактивных двигателей J-1 для беспилотников массой до 90 кг. Эти двигатели интересны своей абсолютной простотой и надёжностью — в них нет никакой механики, которая рано или поздно приводит к поломкам. Новый тип реактивного двигателя не стал открытием, но в совокупности с цифровыми технологиями его перспективы оказались огромными.

Источник изображений: Wave Engine Corporation Компания Wave Engine Corporation выросла из Университета Мэриленда и проекта по возрождению известного более ста лет импульсного реактивного двигателя. Двигатель такого типа представляет собой две трубы с общей камерой сгорания. Впрыснутое в камеру жидкое топливо поджигается и создаёт движущуюся в обеих трубках области ударной волны, воспроизводящие тягу. Возникшее в камере разрежение всасывает новую порцию воздуха, топливо вновь впрыскивается и поджигается, и так до тех пор, пока двигатель должен работать.  Конструкция такого двигателя проста донельзя — в нём нечему ломаться. Использование цифрового управления позволило оптимизировать работу двигателя и сделать его максимально управляемым. Ещё в марте компания Wave Engine показала дистанционный запуск такого двигателя в составе фирменного беспилотника Scitor-D. Также беспилотник совершил ряд полётов, доказав высокую надёжность и управляемость двигателем. Проведенные испытания стали поводом для заключения контракта с неназванным «ведущим» оборонным подрядчиком на поставку серии реактивных двигателей для беспилотников. Двигатель J-1 массой 8,2 кг и размерами 14 × 32 × 163 см создаёт тягу до 245 Н. Он способен приводить в движение беспилотники самолётного типа массой до 90 кг. Двигатель работает на любом типе жидкого топлива: бензине, керосине или биоэтаноле E85. Также в компании разрабатывают версию двигателя K-1 с тягой до 979 Н для беспилотников массой до 454 кг. Во время испытаний беспилотника с двигателем J-1 воздушное средство разогналось до 322 км/ч, но в этом оно было ограничено возможностями аэродрома, поэтому полёты возможны будут также на более высокой скорости. Nvidia столкнулась с антимонопольным расследованием во Франции — компании грозит крупный штраф

16.07.2024 [09:42],

Алексей Разин

В конце сентября прошлого года, как стало известно с подачи СМИ, полиция провела обыски во французских офисах компании Nvidia. Правоохранители искали доказательства, которые помогли бы им выявить злоупотребления Nvidia в части антимонопольного законодательства. Сейчас французские власти не стесняются признать, что Nvidia в случае доказательства её вины придётся ответить по закону и выплатить штраф.

Источник изображения: Nvidia Бенуа Кере (Benoit Couere), глава французского антимонопольного ведомства, в комментариях Reuters подтвердил, что оно ведёт расследование в отношении Nvidia, и компанию могут оштрафовать, если расследование придёт к соответствующим выводам. В сентябре, когда в местных офисах Nvidia проходили обыски, власти Франции старались не комментировать, какая компания и в чём ими подозревается. Принято считать, что у французских антимонопольщиков возникли подозрения в злоупотреблении Nvidia своим положением на рынке компонентов для облачных вычислений. Если будет доказано, что компания своим поведением необоснованно повышает цены и притесняет более мелких конкурентов, ей придётся выплатить крупный штраф. Сентябрьским обыскам предшествовал анализ рынка облачных систем одним из французских правительственных агентств. До сих пор представители Nvidia никак эту ситуацию не комментировали. «Джеймс Уэбб» показал космического пингвина с яйцом — снимок приурочен ко второй годовщине работы телескопа

16.07.2024 [08:28],

Геннадий Детинич

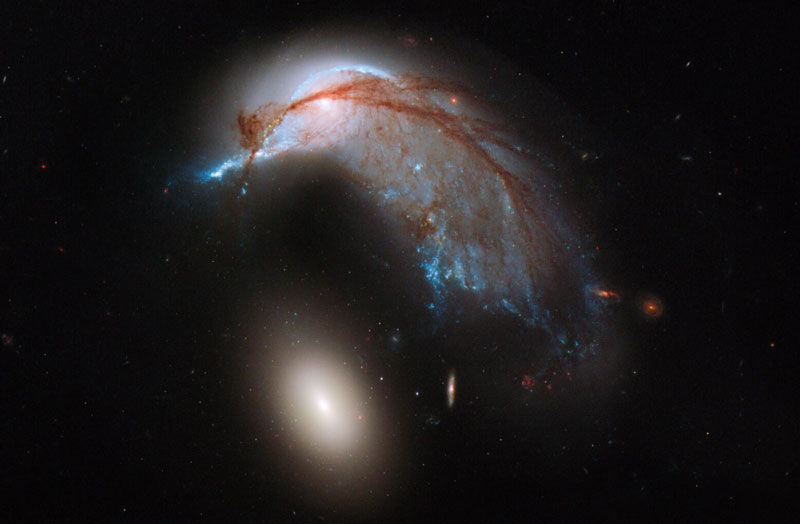

В минувший четверг космическая инфракрасная обсерватория им. Джеймса Уэбба (James Webb) отметила два года научной работы. Сделанный телескопом юбилейный снимок был посвящён этой дате и раскрыл все возможности инфракрасных приборов «Уэбба»: камер ближнего и среднего инфракрасного диапазонов. Благодаря им снимок двух далёких сталкивающихся галактик — Пингвина и Яйца — заиграл новыми красками и деталями.

Комбинированный снимок галактик Arp 142. Источник изображения: NASA; ESA; CSA; STScI Галактики Пингвин и Яйцо (Arp 142) удалены от нас на 326 млн световых лет. Они расположены в созвездии Гидра на расстоянии около 100 тыс. световых лет одна от другой. Около 25–75 млн лет назад произошло сближение эллиптической (NGC 2937) и спиральной галактики (NGC 2936): Яйца и Пингвина. Первая своей гравитацией размотала вторую и через сотни миллионов лет они сольются в одну галактику.

Снимок прибором MIRI (средний инфракрасный диапазон) Гравитационное взаимодействие двух галактик превратило спиральную галактику в подобие пингвина с клювом и хвостом, охраняющего своё яйцо. В облаках пыли и газа, вымываемых гравитацией из спиральной галактики, проявились вспышки звездообразоания. Эллиптическая галактика, вызвавшая всё это движение, напротив, населена старыми звёздами и обе они окружены похожим на дымку туманным ореолом из полициклических ароматических углеводородов.

Снимок тех же галактик телескопом «Хаббл» iOS 18 теперь может установить любой желающий — вышла первая публичная бета новой платформы для iPhone

16.07.2024 [07:54],

Анжелла Марина

Apple выпустила в широкий доступ первую публичную бета-версию новой операционной системы для iPhone, iPad, Mac, Apple Watch и Apple TV. Обновление принесёт ряд полезных функций и улучшений, а позднее некоторые устройства также получат улучшенного ассистента Siri и функцию искусственного интеллекта Apple Intelligence, сообщает The Verge.

Источник изображения: macrumors.com В публичной бета-версии iOS 18 представлена поддержка обмена сообщениями стандарта RCS, новые настройки, позволяющие размещать приложения в любом месте на домашнем экране, а также изменять оттенки к значкам и виджетам. Кроме того, появится новый макет приложения «Фотографии» и возможность кастомизировать «Центр управления». Похожие обновления содержатся и в публичной бета-версии iPadOS 18, в которой, ко всему прочему, появится долгожданный «Калькулятор». Однако iOS 18 пока не будет включать функцию искусственного интеллекта Apple Intelligence. Компания приберегает технологическую новинку для будущей бета-версии, которая выйдет осенью. При этом, Apple Intelligence будет доступен только на iPhone 15 Pro и Pro Max, а также на Mac и iPad с чипами M1 и выше. На данный момент Apple не анонсировала ИИ-функцию для каких-либо других своих платформ, включая Apple Watch. Что касается публичной бета-версии watchOS 11, то там появится приложение Apple Vitals для быстрого просмотра данных о здоровье пользователя за ночь. Для компьютеров Mac бета-версия Sequoia включает возможность отображения экрана iPhone непосредственно на экране Mac и другие менее значимые обновления. Бета-версия tvOS 18 содержит функцию InSight для контента Apple TV Plus, в чём-то похожую на Amazon X-Ray. The Verge отмечает, что хотя большинство устройств можно откатить до стабильной текущей версии операционной системы, это невозможно сделать с Apple Watch. Пользователям придётся дождаться выхода стабильной версии осенью, поэтому следует учитывать это перед установкой бета-версии на часы. Желающие протестировать новую операционную систему могут зарегистрироваться в программе бета-тестирования Apple. Инструкции по установке для определённого устройства можно найти на этой странице Apple. В iOS 18 появилась функция для восстановлениях утерянных и повреждённых фото

16.07.2024 [06:20],

Анжелла Марина

Apple представила новую функцию в iOS 18, которая поможет пользователям восстановить утерянные или повреждённые фотографии и видео. Новый альбом «Восстановленные» в приложении «Фото» автоматически обнаружит и покажет ранее недоступные медиафайлы, но всё ещё хранящиеся на устройстве, давая пользователям второй шанс на их сохранение.

Источник изображения: Apple Инновационная функция доступна не только в iOS 18, но также в iPadOS 18 и macOS Sequoia. По заявлению Apple, новая технология может идентифицировать и локализовать ранее утерянные или повреждённые медиафайлы, отображая их в новом альбоме «Восстановленные» (Recovered) в приложении «Фото». Этот альбом будет существовать параллельно с уже знакомым пользователям альбомом «Недавно удалённые». Отмечается, что при обновлении до iOS 18, iPadOS 18 и macOS Sequoia устройство автоматически проведёт сканирование на наличие восстанавливаемых фотографий и видео. Существует несколько причин, по которым фотографии или видео могут быть утеряны или повреждены. Например, это может произойти из-за проблем с повреждением базы данных или когда сделанная фотография не сохраняется должным образом в библиотеке. Кроме того, сторонние приложения, имеющие разрешение на управление библиотекой «Фото», также могут стать причиной проблем. Чтобы найти этот альбом, пользователям необходимо выполнить следующие шаги:

Важно отметить, что новый альбом будет виден только в том случае, если на устройстве действительно есть утерянные или повреждённые медиафайлы. В противном случае эта опция не будет отображаться. Появление этой полезной функции в iOS 18 последовало за недавним инцидентом с ошибкой повреждения базы данных в iOS 17.5, которая привела к повторному появлению удалённых фотографий. Тогда Apple подчеркнула, что эта проблема была случайной и затронула небольшое количество пользователей. Добавление новой функции даёт больше контроля над процессом удаления фотографий и видео, а также предоставляет возможность восстановления медиафайлов, которые считались потерянными. Акции Apple достигли исторического максимума благодаря ИИ

16.07.2024 [06:17],

Анжелла Марина

Акции Apple достигли рекордной отметки после того, как Morgan Stanley повысил целевую цену и назвал компанию «лучшим выбором» благодаря её усилиям в области искусственного интеллекта. Эксперты прогнозируют значительный рост продаж устройств Apple в ближайшие годы.

Источник изображения: BoliviaInteligente/Unsplash В попытке догнать конкурентов, таких как Alphabet (материнская компания Google) и Microsoft, Apple в прошлом месяце представила сервис искусственного интеллекта «Apple Intelligence», что стало причиной для многих клиентов обновить свои устройства, чтобы иметь возможность использовать новую технологию. При этом акции Apple, которые выросли почти на 20 % с начала года, быстро достигли отметки $236,30, что подняло рыночную капитализацию компании до $3,62 триллиона — самой высокой в мире на данный момент. «Apple Intelligence — это явный катализатор для увеличения поставок iPhone и iPad», - заявили аналитики Morgan Stanley. Они отметили, что новая технология совместима только с 8 % существующих iPhone и iPad, в то время как общее количество смартфонов Apple в использовании составляет 1,3 миллиарда единиц. По прогнозам экспертов, компания может продать около 500 миллионов iPhone в течение следующих двух лет, отмечает Reuters. Финансовая компания Morgan Stanley, которая ранее ожидала, что Apple будет продавать от 230 до 235 млн единиц iPhone ежегодно в следующие два года, теперь повысила целевую цену акций с $216 до $273, порекомендовав компанию в качестве высоконадёжного инвестиционного выбора. Эксперты отмечают, что инвестиции Apple в искусственный интеллект могут стать ключевым фактором роста продаж и укрепления позиций компании на рынке смартфонов в ближайшие годы и ожидают, что и Apple и Samsung возглавят восстановление глобального рынка смартфонов в этом году. Oppo и Ericsson подписали соглашение о перекрёстном лицензировании в сфере сетей 5G

16.07.2024 [05:11],

Алексей Разин

Экспансия бизнеса китайских производителей смартфонов рано или поздно приводить к необходимости уладить все споры в области патентного права с держателями крупнейших патентов в отрасли. Именно это недавно произошло между Oppo и Ericsson, поскольку компании заключили многолетнее соглашение о перекрёстном лицензировании в сфере сетей 5G.

Источник изображения: Ericsson Китайский производитель по условиям этого соглашения будет выплачивать Ericsson роялти с каждого проданного устройства с поддержкой стандарта связи 5G. Компании также будут проводить совместную активность в области тестирования оборудования и его продвижения на рынке. Представители Oppo подчеркнули, что компания нацелена на дружелюбные переговоры в сфере патентного права на условиях взаимного уважения и справедливой оценки интеллектуальной собственности. Ericsson отметила, что полученные в качестве лицензионных выплат средства она направит на разработку новых фундаментальных технологий в сфере телекоммуникации. Несколько месяцев назад подобное соглашение было заключено Oppo с финской компанией Nokia, которая также является держателем ключевых патентов в сфере сетей 5G. Последняя также продлила соответствующие лицензионные соглашения с компаниями Samsung, Apple и Honor. Отметим, что по итогам второго квартала текущего года, если опираться на статистику IDC, компания Oppo разделила с Vivo четвёртое место на мировом рынке смартфонов, поэтому обеспечение комфортных правовых условий для осуществления своей деятельности очень важно для неё. Приложение Google Vids сможет быстро создавать видеопрезентации с помощью ИИ Gemini

16.07.2024 [04:33],

Анжелла Марина

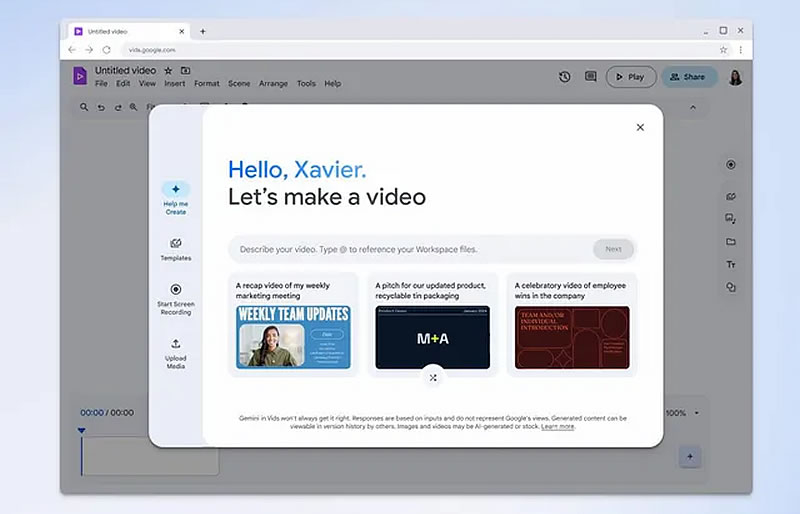

Google запускает новое приложение Vids для создания видеопрезентаций с помощью искусственного интеллекта. Инструмент, доступный в рамках платформы Workspace Labs, позволяет создавать видеоконтент так же легко, как слайды в PowerPoint.

Источник изображения: Google Vids предоставляет возможность комбинировать документы, слайды, голосовое сопровождение и видеозаписи на временной шкале для создания презентационных роликов, которыми можно поделиться с коллегами. Доступ к приложению через Workspace Labs позволяет администраторам Workspace включить эту функцию для пользователей, желающих опробовать видеоредактор с поддержкой ИИ.

Источник изображения: Google Как отмечает The Verge, Vids не следует путать с такими инструментами, как Sora от OpenAI, которые могут создавать реалистичные видео на основе текстовых запросов. Vids фокусируется на создании презентаций с помощью ИИ-ассистента Gemini, который генерирует контент на основе описания пользователя, но с возможностью последующего редактирования. Пользователи также могут начать работу над презентацией вручную, выбрав один из многочисленных шаблонов. Кроме того, приложение предоставляет доступ к бесплатной библиотеке стоковых изображений и видео для улучшения и разнообразия создаваемых материалов. Однако главной особенностью Vids, как показано в демонстрационном видео, является возможность использования Gemini для автоматической вставки стоковых видеоматериалов, генерации сценария и даже создания ИИ-озвучки для презентации без необходимости записи собственного голоса. Илон Маск подтвердил перенос презентации роботакси на октябрь

16.07.2024 [04:30],

Николай Хижняк

Глава Tesla Илон Маск (Elon Musk) подтвердил в понедельник, что компании требуется дополнительное время для подготовки к презентации роботакси, поэтому указанное мероприятие перенесено с августа на октябрь. Об этом Маск сообщил в социальной сети X, указав на необходимость в изменении передней части электромобиля. Он также добавил, что компании нужно время для подготовки «и некоторых других новых вещей», не уточнив при этом, о чём идёт речь.

Источник изображения: Tesla Своим заявлением Маск подтвердил более раннее сообщение издания Bloomberg о том, что Tesla решила перенести презентацию роботакси на более поздний срок. На тот момент в публикации утверждалось, что компании требуется больше времени для сборки дополнительных прототипов машины. Издание добавило, что сообщение о задержке мероприятия было разослано внутри компании. В нём же говорилось, что команде роботакси требуется «переработать некоторые элементы автомобиля». О планах представить Tesla Robotaxi 8 августа Илон Маск заявил ещё в апреле. В тот же день издание Reuters сообщило, что компания отказалась от проекта бюджетного электромобиля стоимостью $25 000 и полностью сосредоточилась на разработке роботакси. Маск опроверг это сообщение. Спустя несколько недель после публикации Reuters в Tesla прошли масштабные сокращения. Компания уволила более 10 процентов из своего 140-тысячного персонала. Спустя ещё две недели после этого из Tesla покинули два топ-менеджера, а Маск заявил сотрудникам, что компании «необходимо быть абсолютно жёсткой в отношении численности персонала и сокращения затрат». Он добавил: «Хотя некоторые руководители относятся к этому серьёзно, большинство этого ещё не поняли». За первое полугодие 2024-го Tesla поставила почти на 7 % меньше электромобилей и произвела во втором квартале почти на 15 % меньше машин, чем за аналогичные периоды прошлого года. Новая статья: Обзор смартфона realme 12 4G: камера как у старших

16.07.2024 [01:42],

3DNews Team

Данные берутся из публикации Обзор смартфона realme 12 4G: камера как у старших Western Digital выпустила игровой SSD WD_Black SN850X объёмом 8 Тбайт всего за $850

16.07.2024 [00:25],

Николай Хижняк

Компания Western Digital расширила свою серию твердотельных NVMe-накопителей WD_Black SN850X моделью объёмом 8 Тбайт. В данной серии SSD стандарта PCIe 4.0 до этого были представлены модели на 1, 2 и 4 Тбайт.

Источник изображений: Western Digital В основе новинки используется некий фирменный контроллер Western Digital, а также 112-слойные чипы флеш-памяти BiCS5 TLC. Производитель заявляет для накопителя WD_Black SN850X объёмом 8 Тбайт скорость последовательного чтения на уровне 7200 Мбайт/с и последовательной записи в 6600 Мбайт/с. Производительность в случайных операциях чтения и записи у новинки составляют 1,2 млн IOPS. В SSD используется кеш-память DRAM DDR4, объём которой производитель не уточняет.  Для WD_Black SN850X объёмом 8 Тбайт заявлен ресурс в 4800 TBW (терабайт перезаписанной информации). Производитель даёт на SSD гарантию сроком на пять лет, как, впрочем, и на все накопители указанной серии. Твердотельный накопитель WD_Black SN850X будет доступен в двух вариантах исполнения: без радиатора, который оценён в $849,99, а также с радиатором стоимостью $899,99. Для сравнения, конкурирующая модель Nextorage NE1N8TB того же объёма и предлагающая аналогичные характеристики, оценивается в те же $849,99. Новинка от WD на 100 Мбайт/с медленнее этого SSD по показателю последовательного чтения, но на 100 тыс. IOPS производительнее в операциях случайной записи. Менее производительная модель Sabrent Rocket 4 Plus 8TB со скоростью чтения и записи 7000 и 6000 Мбайт/с соответственно предлагается сейчас за $1199,99. |

|

✶ Входит в реестр лиц, организаций и объединений, выполняющих функции иностранного агента; |